Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Peut-on vraiment utiliser un sous-répertoire unique pour gérer plusieurs marchés internationaux avec hreflang ?

- □ Peut-on utiliser des avis tiers pour les résultats enrichis produits ?

- □ Comment savoir si Google vous pénalise vraiment ?

- □ Faut-il abandonner les URI de thésaurus NALT pour optimiser son référencement ?

- □ Pourquoi les erreurs robots.txt unreachable sont-elles toujours de votre faute ?

- □ Faut-il vraiment rediriger vos 404 vers la homepage ?

- □ Faut-il vraiment maintenir les redirections lors d'une migration de domaine ?

- □ Faut-il s'inquiéter de millions d'URLs non indexées sur son site ?

- □ Faut-il vraiment éviter le cloaking de codes HTTP entre Googlebot et utilisateurs ?

- □ Google traite-t-il vraiment les redirections 308 et 301 de la même manière ?

- □ La qualité du contenu influence-t-elle vraiment la vitesse d'indexation par Google ?

- □ WiFi vs Wi-Fi : Google fait-il vraiment la différence pour le référencement ?

- □ Un nombre d'avis à zéro pénalise-t-il le référencement d'une page produit ?

- □ Pourquoi certains sites migrés apparaissent-ils dans Google en quelques minutes et d'autres mettent des mois ?

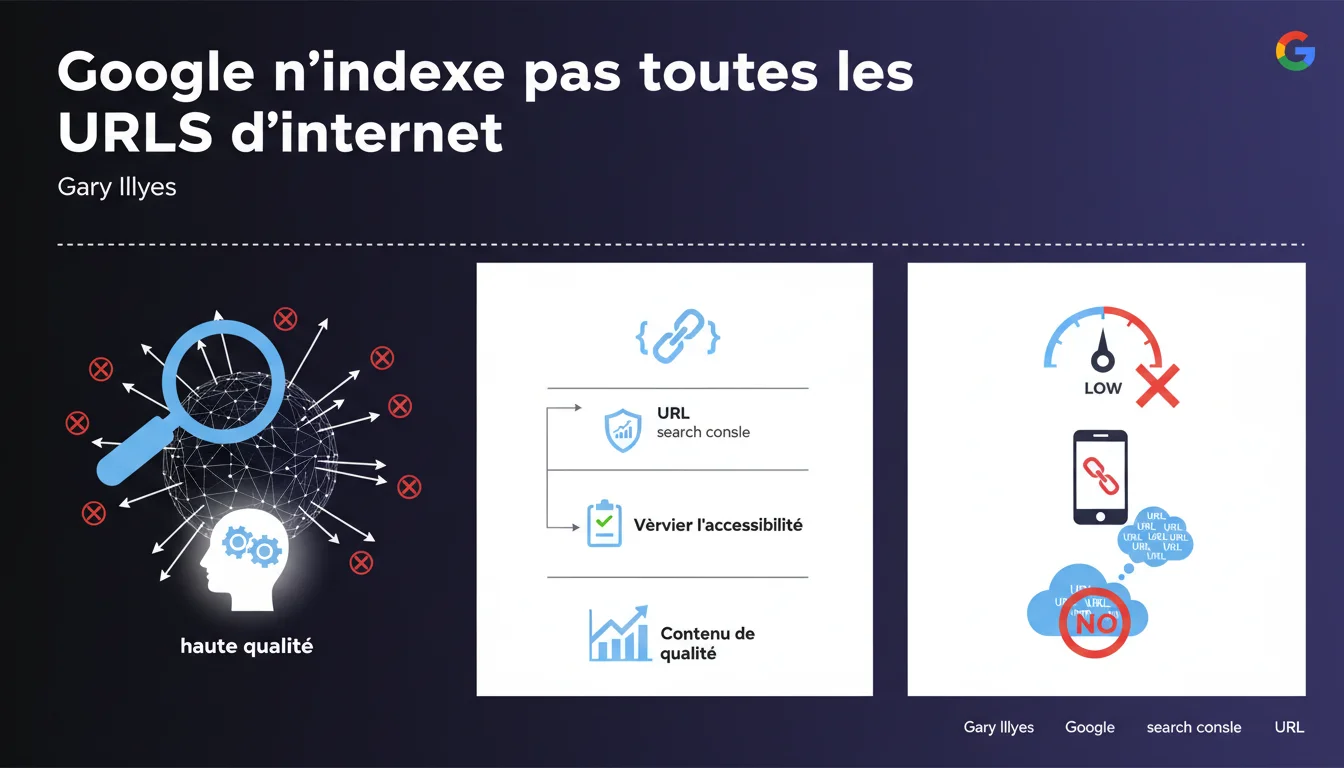

Google ne peut pas et ne veut pas indexer toutes les URLs du web. Seules les pages jugées de haute qualité passent le filtre. La vraie question n'est pas de savoir combien de pages vous avez, mais combien méritent vraiment d'être dans l'index.

Ce qu'il faut comprendre

Google a-t-il vraiment les moyens d'indexer tout le web ?

La réponse est non — et c'est autant une contrainte technique qu'un choix éditorial. Le web compte des milliards de pages, dont une part énorme est du contenu dupliqué, obsolète ou tout simplement inutile. Même avec l'infrastructure colossale de Google, indexer chaque URL serait un gaspillage de ressources.

Ce que Gary Illyes ne dit pas explicitement, c'est que cette sélection s'opère à plusieurs niveaux : crawl budget, filtres de qualité lors de l'indexation, puis classement. Une URL peut être crawlée sans être indexée. Elle peut être indexée sans jamais ressortir en résultats.

Qu'est-ce qu'une URL de « haute qualité » aux yeux de Google ?

Là, ça devient flou. Google ne fournit pas de grille de notation objective. On sait que des signaux comme la profondeur de contenu, l'autorité du domaine, l'engagement utilisateur et la fraîcheur comptent. Mais personne ne peut vous dire avec certitude pourquoi telle page est indexée et pas telle autre.

Ce qu'on observe sur le terrain : les sites avec une architecture propre, un maillage interne cohérent et du contenu original ont un taux d'indexation bien supérieur. Les pages orphelines, les contenus faibles ou les doublons sont souvent laissés de côté.

- Google opère une sélection active des URLs à indexer, ce n'est pas automatique

- Le crawl ne garantit pas l'indexation — deux étapes distinctes

- Les critères de « haute qualité » restent opaques et évolutifs

- Search Console est votre unique source fiable pour vérifier l'état d'indexation réel

Comment savoir si mes pages sont considérées comme « de qualité » ?

Concrètement ? Vous ne le saurez qu'a posteriori, en consultant la Search Console. L'outil Inspection d'URL vous dira si une page est indexée, et éventuellement pourquoi elle ne l'est pas — mais les raisons données sont souvent vagues (« Explorée, actuellement non indexée » étant la plus frustrante).

Il n'existe pas de score de qualité affiché. Vous devez croiser les données : taux d'indexation global, temps moyen avant indexation, présence ou non dans les résultats pour des requêtes de marque. Si vos pages mettent des semaines à être indexées ou disparaissent de l'index, c'est un signal d'alerte.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, largement. Depuis des années, on constate que Google désindexe massivement du contenu jugé faible ou redondant. Les mises à jour comme Helpful Content ont accentué ce tri. Des sites avec des milliers de pages voient parfois 70 % de leurs URLs sorties de l'index sans préavis.

Ce qui est moins évident, c'est que la notion de « haute qualité » varie selon les verticales. Une fiche produit e-commerce avec 50 mots peut être indexée si elle est unique et répond à une requête commerciale précise. Un article de blog avec 800 mots peut être ignoré s'il reformule mollement un sujet traité mille fois ailleurs.

Quelles nuances faut-il apporter ?

Gary Illyes reste évasif sur un point critique : la qualité perçue n'est pas binaire. Il existe une zone grise énorme entre « excellente page » et « spam pur ». Beaucoup de contenus moyens restent indexés sans jamais générer de trafic — ils occupent l'index sans réelle utilité.

Autre angle mort : les sites de niche ou très spécialisés. Ils peuvent proposer du contenu rare et pertinent pour un public restreint, mais si Google n'a pas assez de signaux de popularité (backlinks, trafic direct, mentions), ces pages risquent d'être sous-évaluées. [A vérifier] : est-ce que Google privilégie systématiquement les sites à forte autorité globale, même si le contenu est moins pertinent localement ?

Dans quels cas cette règle ne s'applique-t-elle pas ?

Les sites à très forte autorité — pensez Wikipédia, sites gouvernementaux, grands médias — bénéficient d'une tolérance beaucoup plus large. Leurs pages sont crawlées et indexées massivement, même si la qualité individuelle est moyenne. C'est l'effet de halo : la confiance accordée au domaine compense.

Inversement, un nouveau site ou un domaine pénalisé par le passé devra faire ses preuves. Même avec du contenu excellent, l'indexation sera plus lente et plus sélective. L'historique du domaine compte — et ça, Google ne le crie pas sur les toits.

Impact pratique et recommandations

Que faut-il faire concrètement pour maximiser vos chances d'indexation ?

D'abord, éliminez le bruit. Si vous avez des milliers de pages faibles, elles diluent votre crawl budget et envoient des signaux négatifs sur la qualité globale du site. Identifiez les pages orphelines, les doublons, les contenus obsolètes — et décidez : fusion, redirection 301, ou suppression pure.

Ensuite, renforcez le maillage interne. Une page liée depuis la page d'accueil ou depuis des hubs thématiques forts a bien plus de chances d'être crawlée et indexée qu'une page perdue à 6 clics de profondeur. Structurez vos contenus en silos cohérents, avec des liens contextuels pertinents.

Enfin, soumettez vos nouvelles URLs via la Search Console et surveillez leur statut. Ne comptez pas sur le crawl automatique pour tout découvrir — surtout si votre site a un faible crawl budget. Utilisez les sitemaps XML intelligemment : n'y mettez que les URLs prioritaires, pas toutes celles qui existent.

- Auditer régulièrement les pages indexées vs non indexées dans la Search Console

- Supprimer ou améliorer les contenus faibles identifiés comme « Explorée, non indexée »

- Renforcer le maillage interne vers les pages stratégiques

- Limiter le nombre de pages soumises dans le sitemap XML aux URLs à forte valeur ajoutée

- Suivre le temps moyen d'indexation : s'il dépasse plusieurs jours, votre crawl budget est probablement saturé

- Vérifier que les pages clés ne sont pas bloquées par le robots.txt ou une balise noindex accidentelle

Quelles erreurs éviter absolument ?

Ne multipliez pas les pages « parce que plus = mieux ». C'est faux. Un site de 500 pages excellentes sera mieux indexé et mieux classé qu'un site de 5 000 pages moyennes. Google pénalise la dilution de qualité.

Évitez aussi de forcer l'indexation par des techniques artificielles (spam de sitemaps, soumissions répétées). Ça ne marche plus, et ça peut même vous attirer des filtres manuels. Si une page n'est pas indexée malgré vos efforts, c'est souvent un signal qu'elle ne mérite pas de l'être — ou que votre domaine manque globalement d'autorité.

Comment vérifier que votre stratégie fonctionne ?

Suivez trois métriques dans la Search Console : le taux d'indexation (pages indexées / pages soumises), le délai moyen d'indexation pour les nouvelles URLs, et l'évolution du nombre de pages « Explorée, non indexée ». Si ce dernier chiffre explose, vous avez un problème de qualité perçue.

Croisez avec vos analytics : combien de pages indexées génèrent réellement du trafic organique ? Si 80 % de vos pages indexées sont à zéro visite, c'est un signal que Google les garde dans l'index par politesse, mais ne les juge pas utiles. Concentrez vos efforts sur les 20 % qui performent.

L'indexation sélective de Google impose une rationalisation brutale : moins de pages, mais meilleures. Plutôt que de viser la quantité, concentrez-vous sur la pertinence, la profondeur et l'unicité de vos contenus. Auditez régulièrement votre index, éliminez le bruit, et renforcez l'architecture interne pour guider le crawl vers vos pages stratégiques.

Ces optimisations touchent à des aspects techniques (crawl budget, architecture) et éditoriaux (qualité, pertinence) qui peuvent être complexes à orchestrer, surtout sur des sites de grande taille. Si vous constatez des problèmes d'indexation persistants ou que vous souhaitez structurer une refonte ambitieuse, faire appel à une agence SEO spécialisée peut vous faire gagner des mois d'itérations et éviter des erreurs coûteuses.

❓ Questions frequentes

Combien de temps faut-il pour qu'une nouvelle page soit indexée par Google ?

Pourquoi certaines de mes pages sont « Explorées, actuellement non indexées » ?

Faut-il supprimer les pages non indexées pour améliorer le crawl budget ?

Est-ce que soumettre une URL via la Search Console garantit son indexation ?

Un site avec beaucoup de pages a-t-il un avantage SEO ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 12/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.