Declaration officielle

Autres déclarations de cette vidéo 17 ▾

- □ Faut-il éviter de modifier fréquemment les balises title pour préserver son référencement ?

- □ Peut-on vraiment effacer le passé SEO d'un domaine racheté ?

- □ Faut-il désavouer les liens qui ne correspondent plus à votre thématique ?

- □ Faut-il vraiment supprimer les backlinks pointant vers l'ancien contenu de votre domaine ?

- □ Les erreurs serveur tuent-elles vraiment votre classement Google ?

- □ Faut-il inclure le nom de marque dans les titres des sites d'actualités ?

- □ Pourquoi modifier uniquement le titre d'un contenu copié ne trompe-t-il personne ?

- □ Faut-il vraiment inclure la date dans les titres de vos articles ?

- □ Les catégories dans les URL influencent-elles vraiment le référencement ?

- □ Comment faciliter l'indexation de vos contenus selon Google ?

- □ Les liens vers vos pages non indexées sont-ils vraiment perdus pour votre SEO ?

- □ Pourquoi Google réduit-il drastiquement son crawl après une migration CDN ?

- □ Le temps de réponse serveur influence-t-il vraiment le classement Google ?

- □ Faut-il vraiment mettre à jour les backlinks après une migration de domaine ?

- □ Faut-il vraiment bloquer des pages par robots.txt si elles peuvent être indexées sans contenu ?

- □ Le texte alternatif d'une image dans un lien a-t-il la même valeur SEO que le texte d'ancrage visible ?

- □ Les photos de produits retouchées nuisent-elles au classement des avis produits ?

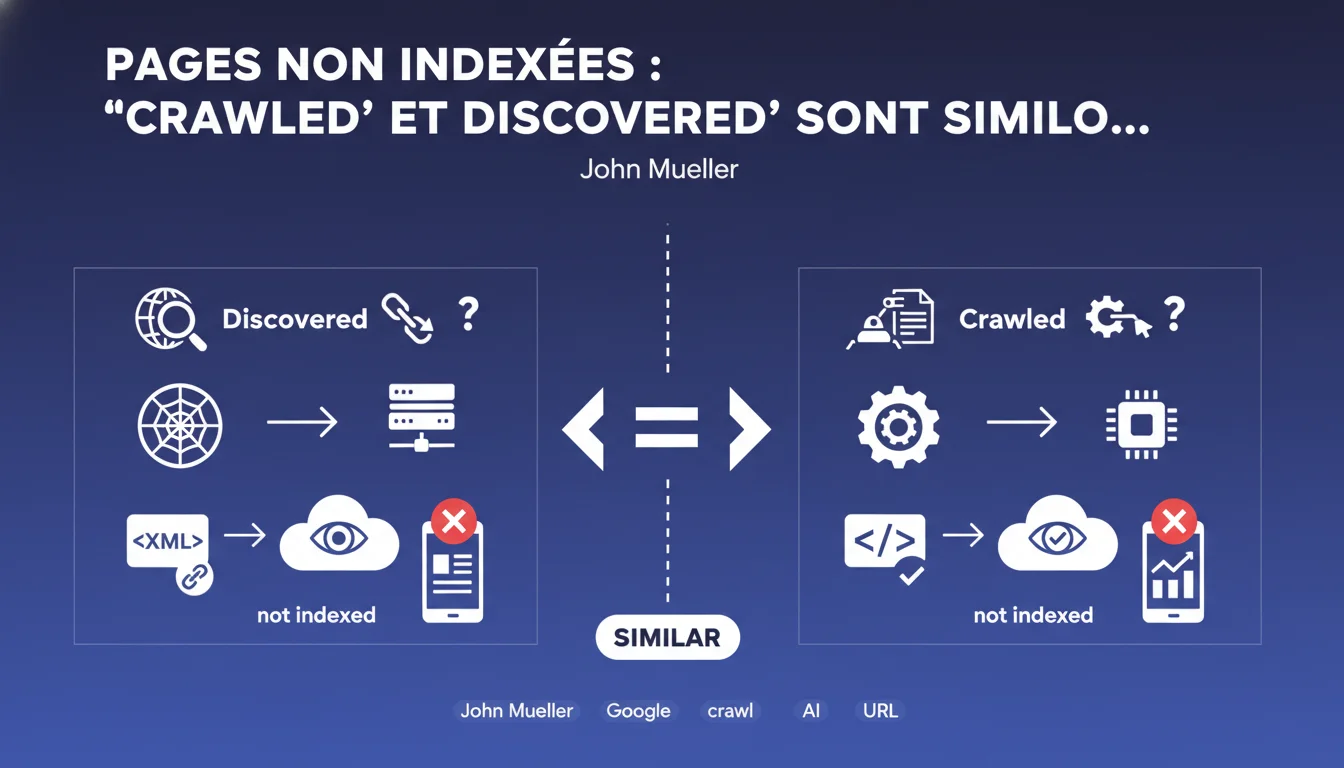

Google ne fait aucune différence entre 'URL crawlée mais non indexée' et 'URL découverte mais non indexée'. Le crawl ne garantit pas l'indexation — Google choisit activement ce qu'il indexe, et ce n'est pas négociable. Si vos pages tombent dans ces catégories, c'est que Google estime qu'elles n'apportent rien.

Ce qu'il faut comprendre

Que signifie réellement ce statut 'crawlée mais non indexée' ?

Google explore votre page, lit son contenu, comprend de quoi elle parle… et décide de ne pas l'ajouter à son index. Le crawl n'est qu'une étape technique, pas une validation qualitative. Googlebot passe, prend des notes, et tire sa révérence sans rien promettre.

Ce que Mueller dit ici, c'est qu'il n'y a aucune hiérarchie entre 'crawlée' et 'découverte'. Dans les deux cas, Google connaît l'existence de votre page et a choisi de l'ignorer pour l'indexation. La nuance est purement opérationnelle — l'une a été visitée, l'autre juste repérée via des liens ou un sitemap.

Pourquoi Google refuse-t-il d'indexer certaines pages crawlées ?

Parce que Google n'indexe pas tout. C'est la phrase-clé de cette déclaration. L'index n'est pas un dépôt passif où tout ce qui est crawlé finit stocké. C'est une sélection active basée sur la qualité perçue, la pertinence, la duplication, et les ressources allouées à votre site.

Une page peut être techniquement accessible, sans erreur serveur, sans noindex… et quand même écartée. Google fait le tri selon ses propres critères — certains transparents (contenu faible, duplication), d'autres opaques (crawl budget, priorité algorithmique).

Quelle différence entre 'crawlée' et 'découverte' du point de vue indexation ?

Techniquement ? Presque aucune. Une URL découverte a été repérée (lien externe, sitemap, référence interne) mais pas encore visitée par Googlebot. Une URL crawlée a été effectivement explorée — le contenu a été téléchargé et analysé.

Mais Mueller insiste : les deux doivent être traitées pareil. Si une page reste 'découverte' pendant des mois, c'est que Google n'y voit pas d'intérêt suffisant pour allouer du crawl budget. Si elle passe en 'crawlée' sans jamais être indexée, c'est que l'analyse du contenu n'a rien changé à cette décision.

- Le crawl ne garantit rien — c'est une étape technique, pas une validation.

- Google indexe sélectivement selon des critères de qualité et de ressources.

- 'Crawlée' et 'découverte' non indexées signalent le même problème : votre page n'apporte pas assez de valeur aux yeux de Google.

- Aucune action miracle ne forcera l'indexation — il faut comprendre pourquoi Google rejette ces pages.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Oui, complètement. Les SEO qui surveillent la Search Console voient régulièrement des pages crawlées pendant des mois sans jamais être indexées. Ce n'est pas un bug, c'est un choix de Google. Le mythe « si Googlebot visite ta page, elle finira indexée » est mort depuis longtemps — mais Mueller le tue une nouvelle fois officiellement.

Ce qui frappe, c'est que cette déclaration confirme ce que beaucoup soupçonnaient : Google ne publie pas tous ses critères de sélection. On sait que la duplication, le thin content, le crawl budget jouent un rôle… mais il reste une zone grise sur les seuils exacts. [A vérifier] : jusqu'où Google tolère-t-il le contenu moyen avant de blacklister une page de l'index ?

Quelles nuances faut-il apporter à cette affirmation ?

Mueller dit « traiter de manière similaire », mais l'ordre des étapes compte quand même. Une page 'découverte' peut simplement manquer de crawl budget — augmenter le linking interne ou la fréquence de mise à jour peut suffire à la faire passer en 'crawlée'. Une page déjà crawlée mais non indexée a déjà échoué à l'évaluation qualitative — là, il faut retravailler le contenu lui-même.

Autre point : Google ne précise jamais combien de temps il laisse une page en statut 'crawlée non indexée' avant de la considérer définitivement hors-jeu. On observe des fluctuations — une page peut rester 6 mois en limbes, puis soudainement être indexée après une mise à jour de contenu ou un gain de backlinks.

Dans quels cas ces statuts peuvent-ils être ignorés sans risque ?

Si vos pages 'crawlées non indexées' sont des pages de tri, de pagination ancienne, des templates vides ou des variantes d'URL inutiles… c'est normal et même souhaitable. Google fait le ménage à votre place. Le problème survient quand des pages stratégiques — fiches produit, articles de blog importants — tombent dans cette catégorie.

Soyons honnêtes : tout le monde a des pages non indexées. L'enjeu n'est pas d'atteindre 100% d'indexation, mais de s'assurer que les pages qui comptent passent la barre. Si 80% de vos pages non indexées sont du bruit (filtres, anciennes versions, pages techniques), vous pouvez dormir tranquille.

Impact pratique et recommandations

Que faut-il faire concrètement avec ces pages non indexées ?

D'abord, auditer. Exportez la liste des URLs 'crawlées' et 'découvertes' non indexées depuis la Search Console. Triez-les par catégorie : pages stratégiques, pages secondaires, pages techniques. Si 90% sont du bruit, supprimez-les ou bloquez-les en robots.txt — inutile de gaspiller du crawl budget.

Pour les pages qui devraient être indexées : analysez la qualité du contenu. Est-ce du thin content ? Y a-t-il duplication avec d'autres pages ? Le texte apporte-t-il une valeur unique ? Google n'indexe pas les pages médiocres par charité — si le contenu est faible, retravaillez-le ou fusionnez-le avec une page plus solide.

Quelles erreurs éviter face à ces statuts Search Console ?

Ne pas demander une indexation manuelle en boucle via l'outil 'Demander une indexation'. Si Google a crawlé votre page et choisi de ne pas l'indexer, relancer la demande 10 fois ne changera rien — vous perdez juste du temps. L'outil ne force pas l'indexation, il accélère le crawl.

Autre piège classique : croire qu'ajouter des backlinks externes va mécaniquement résoudre le problème. Oui, les backlinks aident… si le contenu le mérite. Si la page reste crawlée non indexée malgré des liens entrants, c'est que Google estime qu'elle n'apporte rien, même avec des signaux de popularité.

Comment prioriser les actions sur ces pages ?

Commencez par les pages qui génèrent déjà du trafic organique ou des conversions via d'autres canaux. Si une page convertit bien via Google Ads ou les réseaux sociaux mais n'est pas indexée en SEO, c'est un levier évident. Retravaillez le contenu, ajoutez des éléments différenciants, renforcez le maillage interne.

Ensuite, attaquez les pages avec un potentiel de requêtes à forte intention. Une fiche produit non indexée sur une niche peu concurrentielle a plus de valeur qu'un article de blog générique déjà saturé. Priorisez selon l'impact business, pas selon le volume de pages à traiter.

- Exporter les URLs 'crawlées' et 'découvertes' non indexées depuis la Search Console

- Catégoriser ces pages : stratégiques, secondaires, techniques/inutiles

- Supprimer ou bloquer les pages sans valeur pour libérer du crawl budget

- Auditer la qualité du contenu des pages stratégiques non indexées

- Éliminer la duplication interne et enrichir le contenu unique

- Renforcer le maillage interne vers ces pages depuis des pages indexées à forte autorité

- Éviter de spammer l'outil 'Demander une indexation' — privilégier l'amélioration du contenu

- Monitorer l'évolution des statuts sur 3-6 mois après optimisations

❓ Questions frequentes

Combien de temps Google laisse-t-il une page en 'crawlée non indexée' avant de l'abandonner définitivement ?

Si j'améliore le contenu d'une page 'crawlée non indexée', Google la recrawlera-t-il automatiquement ?

Une page peut-elle passer de 'découverte' à 'crawlée' sans jamais être indexée ?

Faut-il supprimer toutes les pages 'crawlées non indexées' de mon site ?

Le statut 'découverte non indexée' signifie-t-il que mes pages ont un problème technique ?

🎥 De la même vidéo 17

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.