Declaration officielle

Autres déclarations de cette vidéo 17 ▾

- □ Faut-il éviter de modifier fréquemment les balises title pour préserver son référencement ?

- □ Peut-on vraiment effacer le passé SEO d'un domaine racheté ?

- □ Faut-il désavouer les liens qui ne correspondent plus à votre thématique ?

- □ Faut-il vraiment supprimer les backlinks pointant vers l'ancien contenu de votre domaine ?

- □ Faut-il inclure le nom de marque dans les titres des sites d'actualités ?

- □ Pourquoi modifier uniquement le titre d'un contenu copié ne trompe-t-il personne ?

- □ Faut-il vraiment inclure la date dans les titres de vos articles ?

- □ Les catégories dans les URL influencent-elles vraiment le référencement ?

- □ Pourquoi Google crawle-t-il des pages sans jamais les indexer ?

- □ Comment faciliter l'indexation de vos contenus selon Google ?

- □ Les liens vers vos pages non indexées sont-ils vraiment perdus pour votre SEO ?

- □ Pourquoi Google réduit-il drastiquement son crawl après une migration CDN ?

- □ Le temps de réponse serveur influence-t-il vraiment le classement Google ?

- □ Faut-il vraiment mettre à jour les backlinks après une migration de domaine ?

- □ Faut-il vraiment bloquer des pages par robots.txt si elles peuvent être indexées sans contenu ?

- □ Le texte alternatif d'une image dans un lien a-t-il la même valeur SEO que le texte d'ancrage visible ?

- □ Les photos de produits retouchées nuisent-elles au classement des avis produits ?

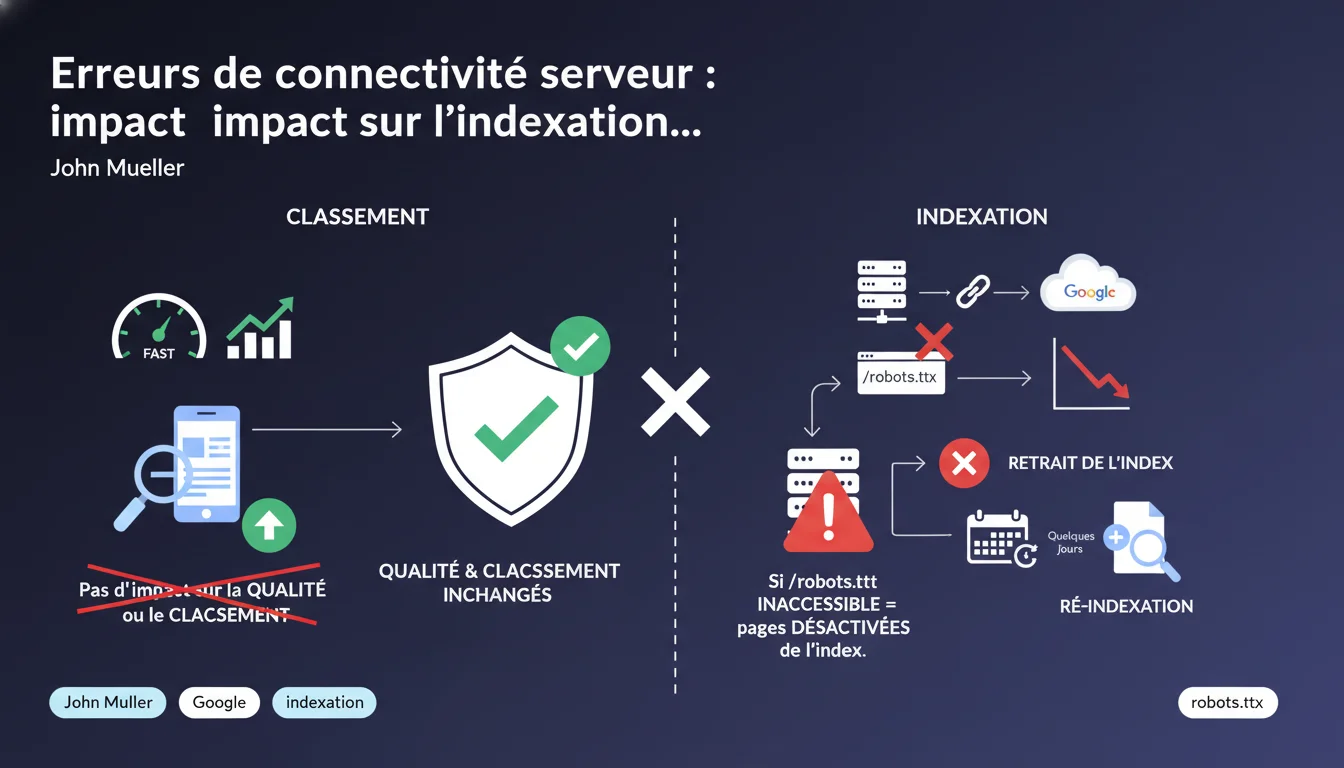

Les problèmes de connectivité serveur n'impactent pas directement votre classement, mais peuvent faire disparaître vos pages de l'index si Google ne peut pas accéder au robots.txt pendant une période prolongée. La réindexation prend généralement quelques jours après résolution du problème — ce qui signifie quand même une perte de visibilité temporaire.

Ce qu'il faut comprendre

Quelle est la différence entre indexation et classement dans ce contexte ?

Google distingue clairement deux mécanismes : l'indexation (la présence de vos pages dans la base de données) et le classement (la position de ces pages dans les résultats). Un problème serveur ne dégrade pas la qualité perçue de votre contenu — vos pages ne perdent pas de points qualité.

En revanche, si Googlebot ne peut pas récupérer votre robots.txt pendant un certain temps, il applique un principe de précaution et retire certaines pages de l'index. C'est un mécanisme défensif, pas une sanction.

Combien de temps Google tolère-t-il une indisponibilité du robots.txt ?

Mueller reste évasif sur la durée précise — il parle de « pendant un certain temps » sans donner de seuil. Les observations terrain suggèrent qu'il faut plusieurs jours d'indisponibilité consécutifs pour déclencher une désindexation, mais [A vérifier] car Google ne communique pas de délai officiel.

Ce flou pose problème pour dimensionner correctement votre monitoring. Quelques heures d'interruption ? Probablement sans conséquence. Plusieurs jours ? Risque réel de perte d'indexation.

Pourquoi le robots.txt est-il si critique dans ce scénario ?

Le fichier robots.txt sert de point d'entrée à Googlebot. S'il n'y a pas accès, le crawler ne sait pas quelles règles appliquer — il pourrait indexer des sections que vous souhaitez bloquer, ou au contraire éviter d'explorer certaines zones par prudence.

Face à cette incertitude, Google choisit la solution conservatrice : il retire les pages de l'index plutôt que de risquer de violer vos directives. C'est une logique de conformité, pas de pénalité.

- Les erreurs serveur ne dégradent pas la qualité de vos pages aux yeux de Google

- L'impossibilité d'accéder au robots.txt pendant une période prolongée peut entraîner une désindexation

- La réindexation prend généralement quelques jours après résolution du problème

- Google ne communique pas de seuil temporel précis déclenchant la désindexation

- Le mécanisme est défensif, pas punitif — Google protège vos directives d'exploration

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Globalement, oui. On observe effectivement que des sites avec des problèmes serveur ponctuels ne voient pas leur classement s'effondrer — les positions restent stables. En revanche, la désindexation progressive lors d'indisponibilités prolongées du robots.txt est documentée dans plusieurs cas.

Le vrai problème, c'est le délai de réindexation. Mueller parle de « quelques jours », mais dans la pratique, on voit des variations importantes — certains sites récupèrent en 48h, d'autres en 10-15 jours. Ça dépend probablement du crawl budget alloué au site et de son autorité.

Quelles nuances faut-il apporter à cette affirmation ?

Dire qu'il n'y a « pas d'impact sur le classement » est techniquement vrai, mais en pratique trompeur. Si vos pages disparaissent de l'index pendant plusieurs jours, elles ne se classent plus du tout — c'est pire qu'une dégradation de positions.

De plus, Mueller ne précise pas si une désindexation prolongée peut affecter la fraîcheur perçue du site. Un site régulièrement inaccessible pourrait théoriquement voir sa fréquence de crawl réduite à terme — mais [A vérifier] car Google ne l'a jamais confirmé explicitement.

Dans quels cas ce mécanisme peut-il devenir problématique ?

Les sites à forte saisonnalité ou ceux qui dépendent de pics de trafic ponctuels (actualité, événements) sont les plus vulnérables. Une désindexation de 5 jours pendant un pic prévu peut annuler des mois de préparation SEO.

Les sites avec un crawl budget limité sont aussi à surveiller de près. Si Google met déjà plusieurs semaines à explorer vos nouvelles pages en temps normal, une désindexation suivie d'une réindexation lente peut créer un retard cumulatif difficile à rattraper.

Impact pratique et recommandations

Comment détecter rapidement un problème d'accessibilité du robots.txt ?

Configurez un monitoring actif qui vérifie la disponibilité de votre robots.txt toutes les 5-10 minutes. Ne vous contentez pas de surveiller l'accessibilité générale du site — ce fichier spécifique doit avoir son propre système d'alerte.

Dans la Search Console, surveillez la section Paramètres > Fichier robots.txt. Google y signale les problèmes d'accès, mais avec un délai — votre monitoring interne doit être plus réactif.

Que faire si le robots.txt devient inaccessible ?

Priorité absolue : rétablir l'accès en moins de 24h. Même si Google tolère probablement quelques jours, chaque heure compte pour minimiser le risque. Identifiez si c'est un problème de serveur, de CDN, de configuration DNS ou de règles firewall.

Une fois le problème résolu, utilisez l'outil Inspection d'URL de la Search Console pour demander une réindexation manuelle des pages stratégiques. Ne saturez pas l'outil — concentrez-vous sur les 20-30 URLs critiques pour accélérer le retour à la normale.

Quelles mesures préventives mettre en place ?

- Configurez un monitoring HTTP dédié pour /robots.txt avec alertes SMS/email

- Documentez la procédure de rétablissement rapide du robots.txt dans votre runbook technique

- Vérifiez que votre infrastructure redondante (CDN, load balancer) sert correctement le robots.txt même en cas de défaillance partielle

- Testez régulièrement l'accessibilité du robots.txt depuis différentes localisations géographiques

- Ne bloquez jamais le robots.txt via firewall ou règles de sécurité trop restrictives

- Si vous utilisez un CDN, assurez-vous que le TTL du robots.txt est raisonnable (1h max) pour permettre des corrections rapides

- Gardez un historique des versions du robots.txt pour rollback rapide si besoin

❓ Questions frequentes

Combien de temps exactement Google tolère-t-il une indisponibilité du robots.txt avant de désindexer ?

Si mon serveur renvoie des erreurs 503 pendant quelques heures, est-ce que je perds mes positions ?

La réindexation après résolution du problème est-elle automatique ?

Est-ce que tous les types d'erreurs serveur ont le même impact ?

Dois-je surveiller autre chose que le robots.txt pour éviter la désindexation ?

🎥 De la même vidéo 17

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.