Declaration officielle

Autres déclarations de cette vidéo 17 ▾

- □ Faut-il éviter de modifier fréquemment les balises title pour préserver son référencement ?

- □ Peut-on vraiment effacer le passé SEO d'un domaine racheté ?

- □ Faut-il désavouer les liens qui ne correspondent plus à votre thématique ?

- □ Faut-il vraiment supprimer les backlinks pointant vers l'ancien contenu de votre domaine ?

- □ Les erreurs serveur tuent-elles vraiment votre classement Google ?

- □ Faut-il inclure le nom de marque dans les titres des sites d'actualités ?

- □ Pourquoi modifier uniquement le titre d'un contenu copié ne trompe-t-il personne ?

- □ Faut-il vraiment inclure la date dans les titres de vos articles ?

- □ Les catégories dans les URL influencent-elles vraiment le référencement ?

- □ Pourquoi Google crawle-t-il des pages sans jamais les indexer ?

- □ Comment faciliter l'indexation de vos contenus selon Google ?

- □ Les liens vers vos pages non indexées sont-ils vraiment perdus pour votre SEO ?

- □ Pourquoi Google réduit-il drastiquement son crawl après une migration CDN ?

- □ Faut-il vraiment mettre à jour les backlinks après une migration de domaine ?

- □ Faut-il vraiment bloquer des pages par robots.txt si elles peuvent être indexées sans contenu ?

- □ Le texte alternatif d'une image dans un lien a-t-il la même valeur SEO que le texte d'ancrage visible ?

- □ Les photos de produits retouchées nuisent-elles au classement des avis produits ?

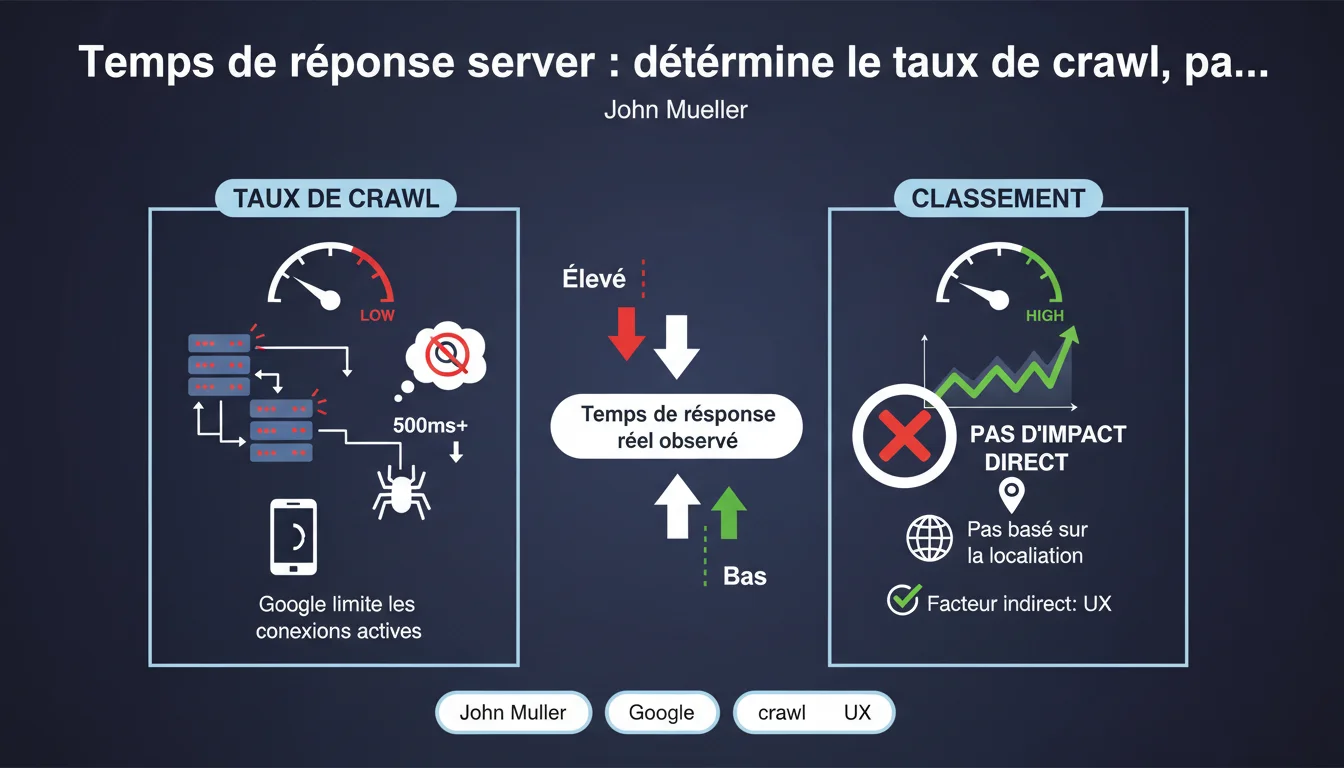

Google confirme que le temps de réponse serveur affecte le taux de crawl — pas le classement. Un serveur lent ralentit l'exploration de vos pages, mais ne pénalise pas directement votre positionnement. Google mesure le temps réel observé depuis ses serveurs, pas une estimation géographique.

Ce qu'il faut comprendre

Pourquoi Google distingue-t-il taux de crawl et classement ?

La confusion vient du fait que performance serveur et vitesse perçue sont deux choses différentes. Le temps de réponse serveur (TTFB) mesure combien de temps votre infrastructure met à envoyer le premier octet de données. C'est une métrique back-end, invisible pour l'utilisateur final.

Google crawle des millions de pages par jour. Pour éviter de surcharger les serveurs, il limite le nombre de connexions actives simultanées. Si votre serveur répond lentement, Googlebot réduit la pression pour ne pas le faire planter — d'où un taux de crawl plus bas. Mais cette lenteur ne signale pas que votre contenu est de mauvaise qualité.

Comment Google mesure-t-il réellement ce temps de réponse ?

Mueller précise que Google utilise le temps observé en conditions réelles, pas une estimation basée sur la localisation du serveur. Concrètement : Googlebot envoie une requête, mesure le délai avant réception du premier octet, et enregistre cette donnée.

Si votre serveur est physiquement loin des datacenters Google ou si votre infrastructure a des latences réseau, ces facteurs sont capturés dans la mesure réelle. Aucun « bonus géographique » n'est appliqué — seule compte la vitesse effective.

- Le taux de crawl dépend de la capacité de votre serveur à répondre rapidement aux bots.

- Le classement repose sur des signaux de qualité, pertinence, autorité — pas sur la performance back-end brute.

- Google ajuste automatiquement la fréquence de crawl pour ne pas impacter la disponibilité de votre site.

- Un temps de réponse élevé peut retarder l'indexation de nouvelles pages, surtout sur des sites volumineux.

Quel lien existe-t-il entre temps de réponse et Core Web Vitals ?

Les Core Web Vitals mesurent l'expérience utilisateur réelle (LCP, INP, CLS). Le temps de réponse serveur influence le LCP — un TTFB élevé retarde le chargement du contenu visible. Mais attention : un bon TTFB ne garantit pas un bon LCP si le front-end est mal optimisé.

Google classe les pages selon l'expérience utilisateur finale, pas selon la vitesse interne de votre stack technique. Un serveur ultra-rapide qui sert une page mal codée ne sera pas mieux classé qu'un serveur moyen avec une page légère et optimisée.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui. Les audits montrent régulièrement que des sites avec un TTFB médiocre (300-500 ms) peuvent très bien se positionner — tant que l'expérience utilisateur finale reste bonne. En revanche, un TTFB catastrophique (>1 seconde) corrèle souvent avec des problèmes d'indexation sur les gros sites : nouvelles pages crawlées avec retard, URL importantes revisitées moins souvent.

Le piège : confondre cause et conséquence. Un site lent côté serveur est souvent lent côté client aussi — d'où une mauvaise expérience utilisateur qui, elle, impacte le classement. Mais c'est le symptôme visible (LCP, INP) qui compte pour le ranking, pas la métrique back-end.

Quelles nuances faut-il apporter à cette règle ?

Mueller parle du temps de réponse « moyen ». Soyons honnêtes : Google ne précise jamais sur quelle période cette moyenne est calculée, ni si des pics ponctuels sont lissés ou pénalisés. [À vérifier] : comment Google gère-t-il un serveur stable à 150 ms 90 % du temps, mais qui décroche à 3 secondes lors de pics de trafic ?

Autre point flou : la relation entre taux de crawl et indexation. Un taux de crawl bas ne signifie pas automatiquement une indexation retardée — Google peut prioriser les pages stratégiques. Mais sur un site e-commerce avec des milliers de fiches produits, un crawl ralenti = certaines pages mettent des semaines à être découvertes.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si votre site fait 50 pages et se met à jour une fois par mois, le taux de crawl n'a aucune importance — Google passera de toute façon. Le problème concerne les sites volumineux ou dynamiques : actualités, e-commerce, agrégateurs, SaaS multi-tenant.

Et c'est là que ça coince : un taux de crawl bridé sur un site publiant 200 nouveaux articles par jour signifie que Google rate une partie du contenu frais. Résultat : des pages orphelines d'indexation pendant des jours, voire des semaines.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le temps de réponse ?

Première étape : mesurer le TTFB réel depuis différents points du globe (pas juste depuis votre bureau). Utilisez des outils comme WebPageTest, GTmetrix, ou les données Search Console si Google signale des problèmes de crawl.

Côté infrastructure, plusieurs leviers existent : passage à un CDN pour rapprocher le contenu des bots Google, optimisation des requêtes base de données (index manquants, requêtes N+1), mise en cache serveur (Redis, Varnish), compression gzip/brotli activée. Si vous êtes sur un hébergement mutualisé saturé, migrer vers un VPS ou un cloud dédié change radicalement la donne.

- Auditer le TTFB moyen sur un échantillon représentatif de pages (home, catégories, produits, articles).

- Vérifier les logs serveur : identifier les pics de latence et leurs causes (requêtes lourdes, saturation CPU/RAM).

- Analyser les rapports Search Console : taux de crawl, erreurs serveur, pages découvertes vs indexées.

- Implémenter un CDN si vous ciblez plusieurs zones géographiques ou si votre serveur est éloigné des datacenters Google.

- Optimiser la stack technique : mise en cache applicative, lazy loading côté serveur, minimisation des appels API externes.

- Surveiller la charge en temps réel et ajuster les ressources serveur avant les pics de trafic (soldes, campagnes marketing).

Quelles erreurs éviter pour ne pas dégrader le crawl ?

Erreur classique : bloquer Googlebot avec des règles rate-limiting trop agressives. Si vous limitez à 1 requête par seconde, Google mettra des jours à crawler un site de 10 000 pages. Préférez ajuster le crawl rate depuis Search Console plutôt que de brider Googlebot manuellement.

Autre piège : négliger les erreurs 5xx répétées. Un serveur qui crashe régulièrement sous la pression du crawl envoie un signal négatif — Google réduit la fréquence, voire désindexe temporairement des pages. Surveillez les logs et alertez-vous sur les pics d'erreurs serveur.

Comment vérifier que mon site est conforme aux attentes de Google ?

Dans Search Console, consultez le rapport Statistiques d'exploration. Regardez l'évolution du nombre de pages crawlées par jour, le temps de réponse moyen, et les erreurs d'hôte. Si le temps de réponse grimpe durablement au-dessus de 500 ms, c'est un signal d'alerte.

Comparez le taux de crawl avec le volume de contenu publié. Si vous ajoutez 100 pages par semaine mais que Google en crawle 50, vous accumulez une dette d'indexation. Priorisez alors les pages stratégiques via un sitemap XML bien structuré et un maillage interne efficace.

En résumé : Le temps de réponse serveur détermine la vitesse à laquelle Google explore votre site, pas la qualité de votre positionnement. Un serveur lent ralentit l'indexation de nouvelles pages, ce qui peut impacter indirectement votre visibilité — surtout sur des sites volumineux ou dynamiques. Optimiser le TTFB reste une bonne pratique, mais ne vous attendez pas à grimper dans les SERP juste en accélérant votre serveur.

Ces optimisations techniques touchent souvent plusieurs couches (hébergement, base de données, cache, CDN) et nécessitent une expertise pointue pour être menées efficacement. Si votre infrastructure actuelle bride votre crawl budget ou si vous hésitez sur les priorités, un accompagnement par une agence SEO spécialisée peut vous faire gagner un temps précieux — et éviter des erreurs coûteuses.

❓ Questions frequentes

Un serveur lent peut-il vraiment empêcher l'indexation de mes pages ?

Faut-il prioritairement optimiser le TTFB ou le LCP pour le SEO ?

Google pénalise-t-il un site hébergé loin de ses datacenters ?

Comment savoir si mon taux de crawl est trop bas ?

Un pic de latence ponctuel peut-il impacter durablement le crawl ?

🎥 De la même vidéo 17

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.