Declaration officielle

Autres déclarations de cette vidéo 17 ▾

- □ Faut-il éviter de modifier fréquemment les balises title pour préserver son référencement ?

- □ Peut-on vraiment effacer le passé SEO d'un domaine racheté ?

- □ Faut-il désavouer les liens qui ne correspondent plus à votre thématique ?

- □ Faut-il vraiment supprimer les backlinks pointant vers l'ancien contenu de votre domaine ?

- □ Les erreurs serveur tuent-elles vraiment votre classement Google ?

- □ Faut-il inclure le nom de marque dans les titres des sites d'actualités ?

- □ Pourquoi modifier uniquement le titre d'un contenu copié ne trompe-t-il personne ?

- □ Faut-il vraiment inclure la date dans les titres de vos articles ?

- □ Les catégories dans les URL influencent-elles vraiment le référencement ?

- □ Pourquoi Google crawle-t-il des pages sans jamais les indexer ?

- □ Comment faciliter l'indexation de vos contenus selon Google ?

- □ Les liens vers vos pages non indexées sont-ils vraiment perdus pour votre SEO ?

- □ Pourquoi Google réduit-il drastiquement son crawl après une migration CDN ?

- □ Le temps de réponse serveur influence-t-il vraiment le classement Google ?

- □ Faut-il vraiment mettre à jour les backlinks après une migration de domaine ?

- □ Le texte alternatif d'une image dans un lien a-t-il la même valeur SEO que le texte d'ancrage visible ?

- □ Les photos de produits retouchées nuisent-elles au classement des avis produits ?

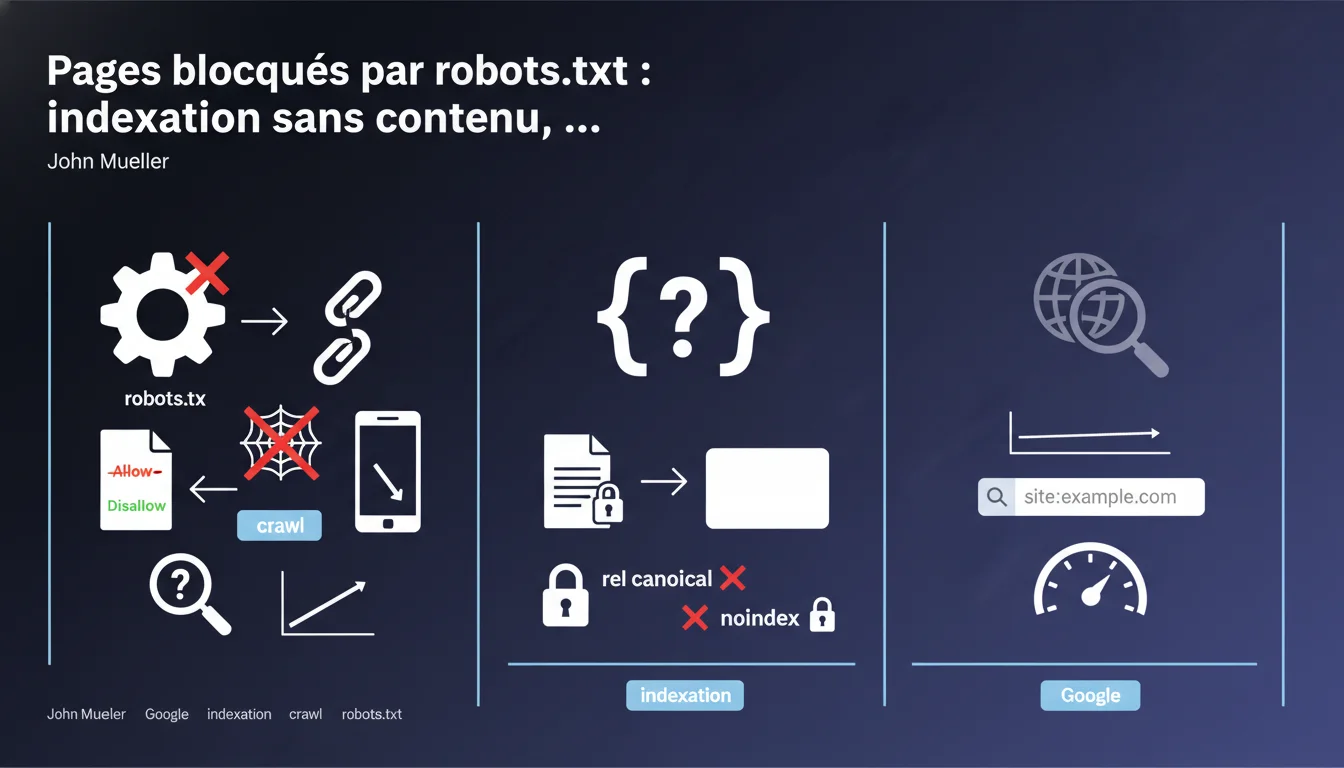

Les pages bloquées par robots.txt peuvent être indexées par Google, mais sans contenu exploitable. Le rel canonical et le noindex ne fonctionnent pas sur ces URLs puisque Google ne peut pas les crawler. Ces pages fantômes n'apparaissent généralement que dans les recherches site: et rarement dans les résultats organiques normaux.

Ce qu'il faut comprendre

Pourquoi Google indexe-t-il des pages qu'il ne peut pas crawler ?

Google peut découvrir une URL de multiples façons : liens externes, backlinks, sitemap XML, ou mentions sur d'autres sites. Même si le robots.txt bloque l'accès au contenu, Google sait que la page existe.

L'indexation sans crawl crée ce qu'on appelle une page fantôme : Google enregistre l'URL dans son index mais sans aucune donnée sur son contenu, ses balises meta, ou sa structure. C'est une coquille vide.

Pourquoi le noindex et le rel canonical sont-ils ignorés sur ces pages ?

Soyons honnêtes : Google ne peut pas lire ce qu'il n'a pas le droit de crawler. Si votre robots.txt bloque l'accès, Googlebot ne télécharge jamais le HTML de la page.

Résultat ? Les directives noindex (dans les meta tags ou en-têtes HTTP) et rel canonical ne sont jamais vues par le moteur. C'est comme envoyer une lettre de refus dans une enveloppe que personne ne peut ouvrir.

Ces pages apparaissent-elles vraiment dans les résultats de recherche normaux ?

Mueller affirme qu'elles n'apparaissent généralement pas dans les résultats organiques classiques. Le mot-clé ici : généralement. Pas jamais.

Concrètement, ces URLs sans contenu ont peu de valeur pour Google. Elles peuvent surgir dans des recherches site: spécifiques, mais leur présence dans les SERP normales reste marginale selon cette déclaration.

- Une page bloquée par robots.txt peut être indexée si Google découvre son URL par des liens externes

- L'indexation se fait sans contenu exploitable — une URL vide dans l'index

- Les directives noindex et rel canonical ne fonctionnent pas puisque non crawlables

- Ces pages apparaissent rarement dans les résultats organiques, surtout dans les recherches site:

- Le blocage robots.txt n'est donc pas une méthode de désindexation fiable

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui et non. On observe effectivement des URLs bloquées par robots.txt qui apparaissent dans l'index Google — c'est un classique en audit SEO. Par contre, l'affirmation qu'elles n'apparaissent généralement pas dans les résultats organiques mérite nuance.

En pratique, j'ai vu des pages bloquées par robots.txt se classer pour des requêtes de marque ou des URLs exactes. Certes, elles affichent un snippet vide ou générique, mais elles sont là. Le "généralement" de Mueller laisse une marge d'interprétation confortable pour Google.

Quels risques cette approche représente-t-elle pour un site ?

Le problème, c'est que bloquer par robots.txt n'est pas désindexer. Si vous avez des pages sensibles, dupliquées ou de mauvaise qualité que vous voulez absolument sortir de l'index, le robots.txt seul ne suffit pas.

Pire encore : une fois bloquée par robots.txt, vous ne pouvez plus utiliser noindex pour nettoyer proprement. Vous vous retrouvez coincé avec des URLs zombies dans l'index que vous ne contrôlez plus directement.

Dans quels cas cette règle pose-t-elle de vrais problèmes ?

Les sites e-commerce avec des paramètres d'URL multiples (filtres, tris, sessions) se retrouvent souvent avec des centaines d'URLs bloquées par robots.txt mais indexées via des backlinks ou du maillage interne mal contrôlé.

Même constat pour les sites avec des espaces membres ou des PDF téléchargeables bloqués par robots.txt mais linkés depuis des forums externes. Google indexe l'URL, vous perdez le contrôle sur sa présentation dans les SERP. [À vérifier] : l'impact réel de ces pages fantômes sur le budget crawl et la qualité perçue du site reste un sujet de débat entre experts.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter ce piège ?

D'abord, auditez votre index. Lancez une recherche site:votredomaine.com et regardez si des URLs bloquées par robots.txt apparaissent. Google Search Console vous montrera aussi les pages indexées mais bloquées — c'est un signal d'alarme.

Ensuite, décidez de la stratégie appropriée selon le cas de figure. Pour les pages à désindexer : autorisez temporairement le crawl, ajoutez noindex, puis rebloquez une fois la désindexation confirmée. Pour les pages à ne jamais indexer : évitez les liens entrants et utilisez noindex + robots.txt en combinaison maîtrisée.

Quelles erreurs éviter absolument dans cette gestion ?

Ne bloquez jamais par robots.txt une page déjà indexée que vous voulez désindexer proprement. C'est la recette pour créer des URLs zombies incontrôlables.

Autre erreur fréquente : bloquer des ressources critiques (CSS, JS) par robots.txt en pensant économiser du crawl budget. Google a besoin de ces ressources pour le rendering — vous sabotez votre propre indexation.

Comment vérifier que votre site est bien configuré ?

- Lancez une recherche site: complète et identifiez les URLs bloquées mais indexées

- Consultez le rapport Couverture dans Search Console, section "Exclue" pour repérer les conflits robots.txt/indexation

- Vérifiez que vos pages sensibles utilisent noindex ET sont crawlables (pas de blocage robots.txt)

- Contrôlez vos backlinks externes vers des pages que vous pensiez protégées par robots.txt

- Mettez en place un monitoring régulier de votre index pour détecter de nouvelles URLs fantômes

- Documentez clairement votre stratégie robots.txt/noindex pour éviter les contradictions

❓ Questions frequentes

Peut-on utiliser robots.txt pour désindexer une page déjà présente dans Google ?

Si une page est bloquée par robots.txt et indexée, peut-elle recevoir du PageRank ?

Comment supprimer proprement des URLs bloquées par robots.txt de l'index Google ?

Les pages bloquées par robots.txt mais indexées nuisent-elles au SEO du site ?

Le rel canonical fonctionne-t-il sur une page accessible mais dont la canonique est bloquée par robots.txt ?

🎥 De la même vidéo 17

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 04/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.