Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Pourquoi Google préfère-t-il les données structurées au machine learning pour comprendre vos pages ?

- □ Faut-il encore se fatiguer avec les données structurées si le machine learning fait le boulot ?

- □ Les données structurées donnent-elles vraiment du contrôle aux webmasters sur l'affichage Google ?

- □ Google vérifie-t-il réellement l'exactitude de vos données structurées ?

- □ Pourquoi Google recommande-t-il de commencer par les données structurées génériques ?

- □ Pourquoi votre Schema.org valide peut être rejeté par Google ?

- □ Faut-il implémenter des données structurées même si Google ne les utilise pas encore ?

- □ Les données structurées influencent-elles vraiment la compréhension du sujet d'une page par Google ?

- □ Les données structurées sont-elles vraiment utiles si Google comprend déjà votre page ?

- □ Faut-il vraiment bourrer vos pages de données structurées pour mieux ranker ?

- □ Le JSON-LD externe pose-t-il vraiment des problèmes de synchronisation pour Google ?

- □ Les outils de test Google sont-ils vraiment fiables pour détecter vos données structurées manquantes ?

- □ Les données structurées doivent-elles systématiquement refléter le contenu visible de la page ?

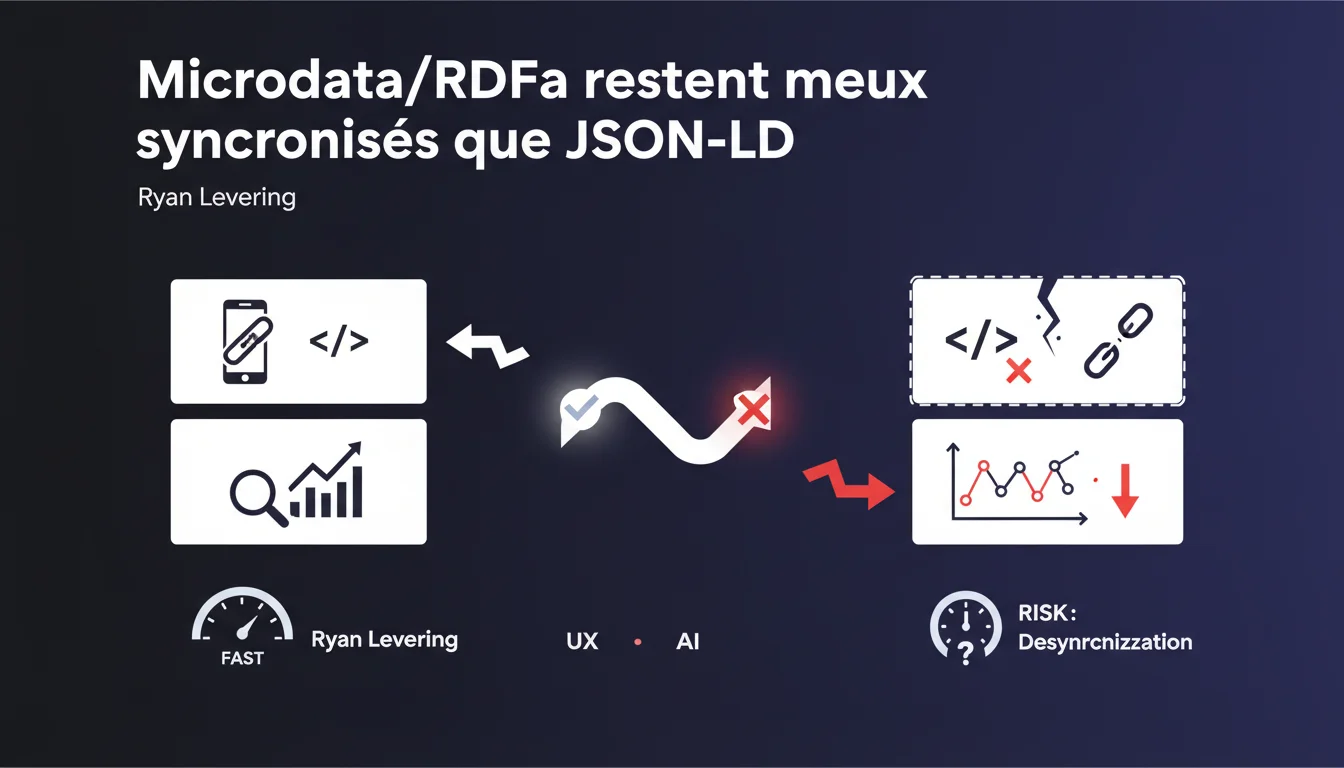

Google reconnait que Microdata et RDFa restent mieux synchronisés avec le contenu visible que JSON-LD. Le JSON-LD, plus simple à implémenter, présente un risque accru de désynchronisation entre les données structurées et le contenu réellement affiché. Un aveu qui remet en perspective les recommandations officielles favorisant pourtant JSON-LD depuis des années.

Ce qu'il faut comprendre

Pourquoi Google évoque-t-il cette question de synchronisation ?

La désynchronisation entre données structurées et contenu visible pose un problème de fiabilité pour les moteurs de recherche. Quand les informations encodées en JSON-LD ne correspondent plus au contenu affiché, Google indexe potentiellement des données obsolètes ou incorrectes.

Microdata et RDFa enveloppent directement les éléments HTML visibles. Impossible de modifier le prix d'un produit sans toucher au markup structuré — la cohérence est mécanique. JSON-LD, lui, vit dans un bloc <script> séparé. Rien n'oblige le développeur à mettre à jour les deux en même temps.

Cette déclaration contredit-elle les recommandations officielles ?

Pas exactement. Google continue de recommander JSON-LD pour sa facilité d'implémentation. La documentation officielle le positionne comme format privilégié depuis 2016.

Ce que révèle Ryan Levering, c'est que cette facilité a un prix : un risque structurel de désynchronisation. Google assume ce compromis mais le verbalise rarement aussi clairement. Pour des sites avec contenus dynamiques fréquemment mis à jour, cette faille peut générer des incohérences critiques.

Concrètement, quels types de désynchronisation observe-t-on ?

Les cas les plus fréquents concernent les sites e-commerce : prix modifiés en base de données mais pas dans le JSON-LD, disponibilités produits obsolètes, notations clients non actualisées. Résultat : les rich snippets affichent des informations erronées.

Les sites d'actualité et blogs rencontrent le même problème avec les dates de publication, auteurs, ou contenus modifiés après publication. Le JSON-LD reste figé sur la version initiale si personne ne pense à le régénérer.

- Microdata/RDFa : synchronisation mécanique car intégré au HTML visible

- JSON-LD : plus simple à implémenter mais nécessite une maintenance rigoureuse

- Le risque augmente avec la fréquence de mise à jour du contenu

- Google privilégie toujours JSON-LD malgré cette faiblesse reconnue

- La désynchronisation peut entraîner des rich snippets incorrects

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. En audit, on détecte régulièrement des écarts entre JSON-LD et contenu visible — rarement avec Microdata. Les CMS et frameworks génèrent souvent le JSON-LD au build ou en cache, sans régénération à chaque modification de contenu.

Ce qui frappe, c'est que Google verbalise enfin un problème connu mais jamais documenté officiellement. Les guidelines insistent sur la cohérence des données structurées sans jamais pointer cette fragilité architecturale du JSON-LD. [À vérifier] : Google dispose-t-il de métriques internes mesurant ce taux de désynchronisation par format ?

Pourquoi Google continue-t-il de recommander JSON-LD malgré ce défaut ?

Parce que le taux d'adoption prime sur la perfection technique. JSON-LD a démocratisé les données structurées auprès de développeurs peu familiers du SEO. Un bloc <script> copié-collé reste plus accessible qu'un refactoring HTML complet en Microdata.

Google arbitre entre volume de markup (favorisé par JSON-LD) et fiabilité du markup (favorisée par Microdata). Dans cet arbitrage, le volume l'emporte. Soyons honnêtes : la majorité des sites n'ont pas les ressources pour implémenter proprement Microdata sur des milliers de pages.

Dans quels cas cette recommandation change-t-elle la donne ?

Pour les sites avec contenus ultra-dynamiques — marketplaces, agrégateurs de prix, sites d'offres d'emploi — la désynchronisation devient critique. Un prix affiché à 99€ dans le snippet mais à 149€ sur la page détruit la confiance et le taux de conversion.

Si votre workflow éditorial sépare clairement rédaction contenu et maintenance technique, le JSON-LD deviendra rapidement obsolète. Microdata force la mise à jour simultanée — c'est contraignant mais sécurisé.

Impact pratique et recommandations

Que faut-il faire concrètement sur un site existant en JSON-LD ?

Pas de panique — inutile de tout réécrire en Microdata demain. Commencez par auditer la cohérence entre vos JSON-LD et le contenu visible. Concentrez-vous sur les pages stratégiques : fiches produits, articles phares, pages de services.

Mettez en place un processus de validation automatisé. À chaque modification de prix, stock, auteur ou date, le JSON-LD doit se régénérer. Si votre CMS ne le gère pas nativement, créez un hook ou trigger côté serveur.

Quelles erreurs éviter absolument ?

Ne jamais maintenir le JSON-LD manuellement dans le code source. Dès que le volume dépasse quelques dizaines de pages, c'est ingérable. La désynchronisation devient inévitable.

Évitez aussi de dupliquer les données structurées en mixant JSON-LD et Microdata sur les mêmes éléments — Google privilégiera l'un ou l'autre de manière imprévisible. Choisissez un format par type de contenu et tenez-vous-y.

Comment vérifier que mon implémentation reste synchronisée ?

Utilisez la Google Search Console pour détecter les incohérences signalées. Complétez avec des tests réguliers via le Rich Results Test sur un échantillon de pages mises à jour récemment.

Côté monitoring, comparez les valeurs extraites du JSON-LD avec le DOM visible via un script automatisé. Toute divergence supérieure à 24-48h signale un problème dans votre chaîne de génération.

- Auditer la cohérence JSON-LD vs contenu visible sur les pages stratégiques

- Automatiser la régénération du JSON-LD à chaque modification de contenu

- Ne jamais maintenir les données structurées manuellement

- Éviter les doublons JSON-LD + Microdata sur les mêmes données

- Monitorer les incohérences via Search Console et Rich Results Test

- Pour les contenus ultra-dynamiques, envisager Microdata plutôt que JSON-LD

- Mettre en place un script de validation automatisé comparant JSON-LD et DOM

❓ Questions frequentes

Google pénalise-t-il les sites dont le JSON-LD est désynchronisé ?

Peut-on mixer JSON-LD et Microdata sur un même site ?

Microdata est-il plus complexe à implémenter que JSON-LD ?

Comment automatiser la mise à jour du JSON-LD dans WordPress ?

RDFa présente-t-il les mêmes avantages que Microdata ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/04/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.