Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Pourquoi Google préfère-t-il les données structurées au machine learning pour comprendre vos pages ?

- □ Faut-il encore se fatiguer avec les données structurées si le machine learning fait le boulot ?

- □ Les données structurées donnent-elles vraiment du contrôle aux webmasters sur l'affichage Google ?

- □ Pourquoi Google recommande-t-il de commencer par les données structurées génériques ?

- □ Pourquoi votre Schema.org valide peut être rejeté par Google ?

- □ Faut-il implémenter des données structurées même si Google ne les utilise pas encore ?

- □ Les données structurées influencent-elles vraiment la compréhension du sujet d'une page par Google ?

- □ Les données structurées sont-elles vraiment utiles si Google comprend déjà votre page ?

- □ Faut-il vraiment bourrer vos pages de données structurées pour mieux ranker ?

- □ Faut-il abandonner JSON-LD au profit de Microdata pour les données structurées ?

- □ Le JSON-LD externe pose-t-il vraiment des problèmes de synchronisation pour Google ?

- □ Les outils de test Google sont-ils vraiment fiables pour détecter vos données structurées manquantes ?

- □ Les données structurées doivent-elles systématiquement refléter le contenu visible de la page ?

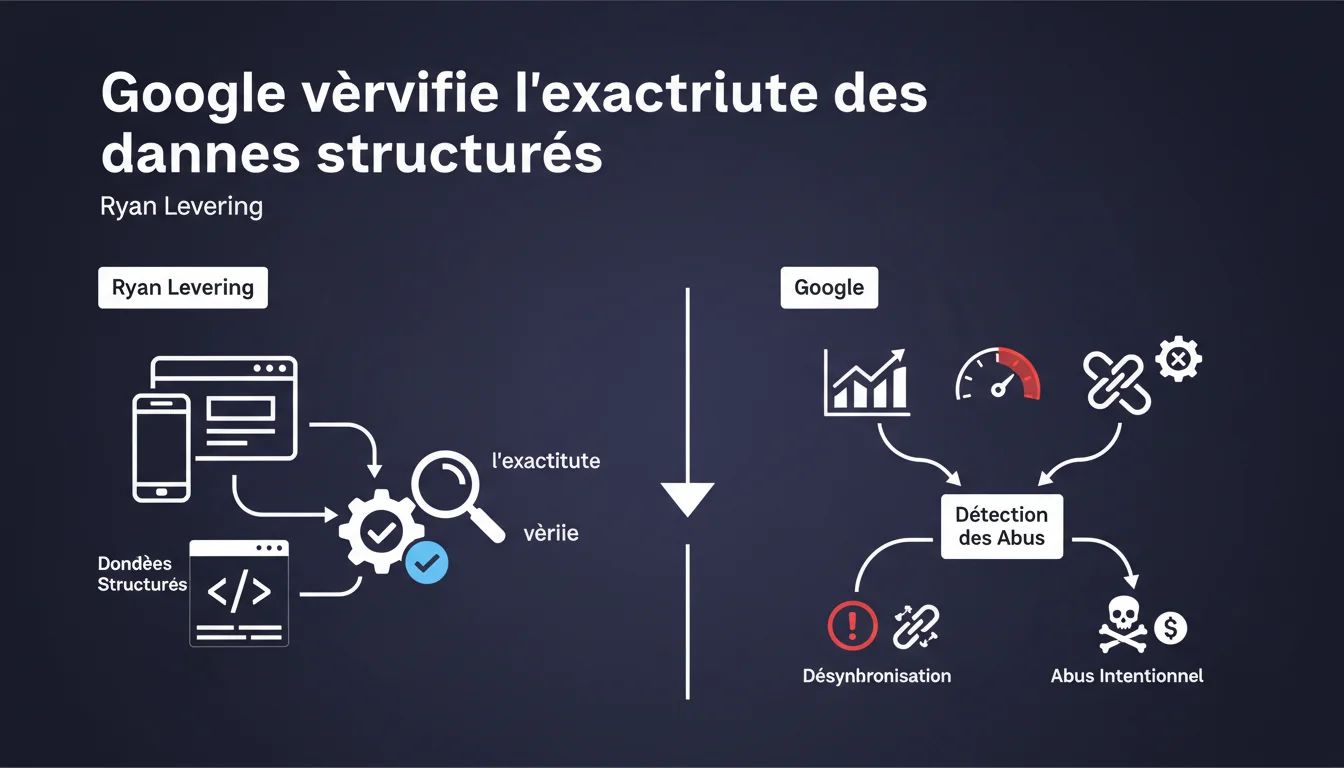

Google confirme qu'il valide l'exactitude des données structurées sur vos pages. Le vrai défi pour son algorithme : distinguer les abus intentionnels (markup trompeur) des désynchronisations accidentelles entre le balisage et le contenu visible. Cette déclaration soulève plus de questions qu'elle n'apporte de réponses sur les mécanismes de détection.

Ce qu'il faut comprendre

Ryan Levering, ingénieur chez Google, révèle un aspect peu documenté du traitement des données structurées. Au-delà de la simple validation syntaxique (que fait déjà le Rich Results Test), Google évalue si le markup correspond vraiment au contenu perçu par l'utilisateur.

Cette vérification vise deux problèmes distincts : le spam délibéré (baliser un prix inexistant pour obtenir des rich snippets) et les erreurs techniques (données structurées qui deviennent obsolètes quand le contenu change sans que le JSON-LD soit mis à jour).

Pourquoi Google parle-t-il de "problèmes de synchronisation" ?

Un site e-commerce met à jour un prix via son CMS. Le contenu HTML change, mais le JSON-LD reste figé avec l'ancien prix parce que le cache n'a pas été invalidé ou que le script de génération fonctionne de manière asynchrone.

Google crawle la page et détecte une incohérence entre ce qu'annonce le markup (25€) et ce qu'affiche la page (35€). Est-ce un bug ? Une tentative de manipulation ? Levering admet que c'est là que ça coince.

Comment Google distingue-t-il l'abus de l'erreur technique ?

La déclaration reste floue. Google dispose probablement d'heuristiques croisant plusieurs signaux : fréquence des incohérences, historique du site, ampleur de l'écart entre markup et contenu visible.

Un site avec 2% de désynchronisations ponctuelles ne sera pas traité comme un site qui systématiquement affiche des prix 30% plus bas dans ses rich snippets que sur la page réelle. Mais les seuils exacts ? Mystère.

Quelles données structurées sont scrutées en priorité ?

Logiquement, celles qui impactent directement les SERP : Product (prix, disponibilité), Recipe (temps de cuisson, notes), Review (étoiles), Event (dates). Moins critique : Organization, Breadcrumb.

Google a tout intérêt à vérifier ce qui génère des clics. Un rich snippet mensonger détériore l'expérience utilisateur et donc la confiance dans les résultats de recherche.

- Google valide l'exactitude des données structurées, pas seulement leur syntaxe

- Le moteur fait la différence entre abus intentionnel et désynchronisation accidentelle — du moins en théorie

- Les incohérences entre JSON-LD et contenu visible sont le signal d'alerte principal

- Aucune précision sur les méthodes de détection ni les seuils de tolérance

Avis d'un expert SEO

Cette déclaration est-elle cohénte avec ce qu'on observe terrain ?

Oui et non. On constate effectivement que des sites perdent leurs rich snippets après avoir affiché des données structurées incohérentes pendant plusieurs semaines. Inversement, des sites avec des bugs ponctuels (prix désynchronisés sur quelques produits) ne semblent pas systématiquement pénalisés.

Le problème : Google ne communique jamais pourquoi un rich snippet disparaît. "Problème détecté", point. Impossible de savoir si c'est une désynchronisation, un abus supposé ou un simple changement d'affichage côté Google. [À vérifier] : l'existence d'un système de scoring pour évaluer la "fiabilité" du markup d'un site dans le temps.

Quelles nuances faut-il apporter à cette annonce ?

Levering parle de "défi" — ce qui suggère que le système n'est pas infaillible. Google rate probablement des abus sophistiqués (markup conditionnel affiché uniquement au bot) et sanctionne peut-être à tort des sites avec des bugs transitoires.

La notion de "synchronisation" est trompeuse. Un site dynamique génère du contenu à la volée : le prix change selon la géolocalisation, le stock, la devise. Le JSON-LD doit-il refléter la version US ou FR ? Desktop ou mobile ? Google crawle avec un user-agent US desktop par défaut. Si votre markup se base sur des données FR mobile, vous créez une désynchronisation artificielle.

Dans quels cas cette règle devient-elle problématique ?

Sites avec tarification dynamique (yield management, A/B testing sur les prix). Le markup peut être techniquement exact au moment de la génération mais obsolète 10 minutes plus tard.

Sites multilingues où le JSON-LD est traduit avec un délai par rapport au contenu HTML. Sites utilisant du client-side rendering où le contenu visible se charge après le JSON-LD initial.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter les désynchronisations ?

Auditez la cohérence entre vos données structurées et le contenu visible. Crawlez votre site avec un outil qui extrait à la fois le DOM et le JSON-LD, puis comparez programmatiquement les valeurs clés (prix, notes, dates).

Mettez en place une validation automatique : à chaque déploiement, vérifiez qu'un échantillon de pages génère bien un markup cohérent avec le HTML rendu. Idéalement, intégrez ce test dans votre CI/CD.

Pour les sites avec contenu dynamique, privilégiez la génération du JSON-LD côté serveur avec les mêmes données que celles affichées à l'utilisateur. Si vous devez passer par du client-side, assurez-vous que le script s'exécute avec la même logique que le rendu HTML.

Quelles erreurs éviter absolument ?

Ne jamais baliser un prix, une note ou une disponibilité qui n'apparaît nulle part sur la page visible. Même si techniquement le produit existe à ce prix dans votre base, si l'utilisateur ne peut pas le voir ni l'acheter à ce tarif, c'est du spam aux yeux de Google.

Évitez les systèmes de cache qui mettent à jour le HTML mais pas le JSON-LD (ou inversement). C'est la source #1 de désynchronisations accidentelles sur les gros sites.

Ne tentez pas de "sur-optimiser" en affichant des données structurées plus flatteuses que la réalité. Google croise de plus en plus de signaux — un écart sera détecté tôt ou tard.

Comment vérifier que mon site est conforme ?

- Crawlez un échantillon de pages et extrayez le JSON-LD + le contenu HTML rendu

- Comparez automatiquement les champs critiques (price, ratingValue, availability, datePublished)

- Identifiez les pages avec écarts > 5% (prix) ou différences qualitatives (disponibilité, notes)

- Vérifiez que le markup se génère avec les mêmes données que le rendu utilisateur

- Testez le rendu Googlebot via la Search Console (inspection d'URL) pour détecter les problèmes de JS

- Mettez en place une alerte si vos rich snippets disparaissent soudainement dans les SERP

- Documentez vos choix : quelle version (US/FR, desktop/mobile) sert de référence pour le JSON-LD ?

❓ Questions frequentes

Google pénalise-t-il un site si les données structurées sont désynchronisées par erreur ?

Quels types de données structurées sont les plus scrutés par Google ?

Comment Google détecte-t-il une désynchronisation entre JSON-LD et contenu visible ?

Faut-il privilégier le JSON-LD côté serveur ou client-side pour éviter les problèmes ?

Un site avec du contenu dynamique (prix variables) peut-il utiliser des données structurées sans risque ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/04/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.