Declaration officielle

Autres déclarations de cette vidéo 13 ▾

- □ Pourquoi Google préfère-t-il les données structurées au machine learning pour comprendre vos pages ?

- □ Faut-il encore se fatiguer avec les données structurées si le machine learning fait le boulot ?

- □ Les données structurées donnent-elles vraiment du contrôle aux webmasters sur l'affichage Google ?

- □ Google vérifie-t-il réellement l'exactitude de vos données structurées ?

- □ Pourquoi Google recommande-t-il de commencer par les données structurées génériques ?

- □ Pourquoi votre Schema.org valide peut être rejeté par Google ?

- □ Faut-il implémenter des données structurées même si Google ne les utilise pas encore ?

- □ Les données structurées influencent-elles vraiment la compréhension du sujet d'une page par Google ?

- □ Les données structurées sont-elles vraiment utiles si Google comprend déjà votre page ?

- □ Faut-il vraiment bourrer vos pages de données structurées pour mieux ranker ?

- □ Faut-il abandonner JSON-LD au profit de Microdata pour les données structurées ?

- □ Le JSON-LD externe pose-t-il vraiment des problèmes de synchronisation pour Google ?

- □ Les données structurées doivent-elles systématiquement refléter le contenu visible de la page ?

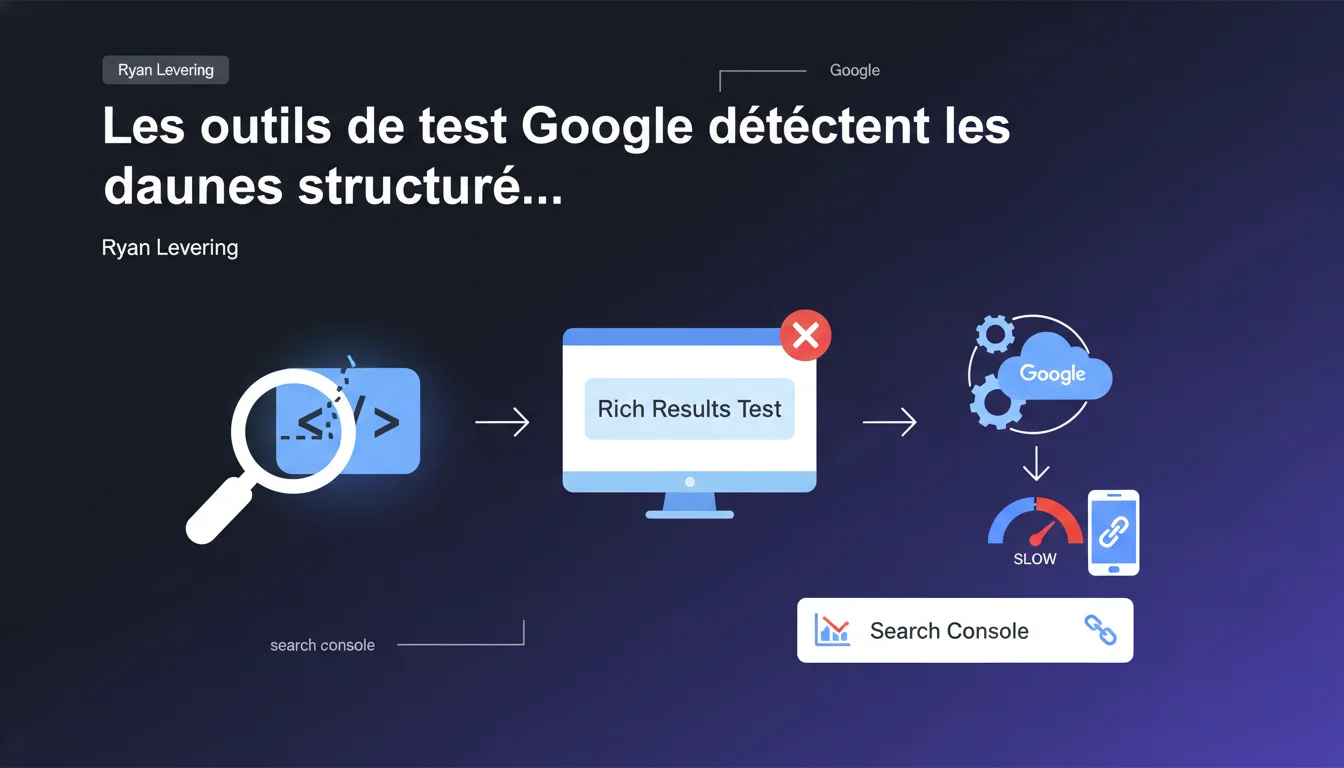

Google confirme que le Rich Results Test et les autres outils de diagnostic détectent avec précision la présence ou l'absence de données structurées. Les problèmes de synchronisation entre les outils et l'index réel apparaîtront dans Search Console. Autrement dit : si l'outil ne voit pas votre schema, Google ne le voit probablement pas non plus.

Ce qu'il faut comprendre

Pourquoi Google communique-t-il sur la fiabilité de ses outils de test ?

Cette déclaration répond à une question récurrente chez les praticiens : peut-on réellement se fier au Rich Results Test pour valider l'implémentation de nos données structurées ? La réponse de Ryan Levering est sans ambiguïté — ces outils sont précis.

Le message sous-jacent est simple : si votre schema n'apparaît pas dans le Rich Results Test, il y a un problème technique réel. Ce n'est pas un bug de l'outil, c'est votre implémentation qui cloche.

Qu'est-ce que cette « synchronisation » dont parle Google ?

Google évoque des problèmes de synchronisation qui apparaîtraient à la fois dans Search Console et dans les outils de test. Concrètement, il s'agit du délai entre le moment où vous déployez vos données structurées et celui où Google les crawle, les indexe, puis les exploite pour générer des rich snippets.

Ce point est crucial : même si votre markup est techniquement valide, des décalages temporels peuvent exister. Les outils de test fonctionnent en temps réel sur votre HTML actuel, tandis que Search Console reflète l'état de l'index — parfois avec plusieurs jours de décalage.

Les outils de test sont-ils le dernier mot sur mes rich snippets ?

Non, et c'est là que ça se complique. Un test positif dans le Rich Results Test ne garantit pas l'affichage d'un rich snippet dans les SERP. Google peut choisir de ne pas afficher vos extraits enrichis pour des raisons de pertinence, de qualité du contenu, ou simplement parce que l'algorithme estime qu'un autre format est plus adapté à la requête.

En revanche, un test négatif est un signal d'alarme : si l'outil ne détecte rien, vous ne verrez jamais de rich snippet. C'est une condition nécessaire, pas suffisante.

- Le Rich Results Test détecte avec précision la présence ou l'absence de données structurées dans votre HTML

- Les décalages entre outils et index réel apparaissent dans Search Console sous forme d'erreurs ou d'avertissements

- Un test positif ne garantit pas l'affichage en SERP, mais un test négatif garantit l'absence d'affichage

- Les problèmes de synchronisation sont normaux et transitoires — donnez à Google le temps de crawler vos modifications

- Si Search Console rapporte des erreurs de schema après plusieurs jours, c'est un problème d'implémentation, pas un bug d'outil

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, dans l'ensemble. Depuis des années, le Rich Results Test s'est montré relativement fiable pour détecter les erreurs de syntaxe, les propriétés manquantes, ou les types de schema mal implémentés. Quand l'outil détecte un problème, il y a effectivement un souci technique à corriger.

Mais — et c'est un « mais » de taille — la formulation de Google reste vague sur un point crucial : quel délai considère-t-on comme « normal » pour la synchronisation ? J'ai vu des cas où Search Console mettait deux semaines à mettre à jour ses rapports après un déploiement de schema. D'autres fois, c'est quasi instantané. [A vérifier] Google ne donne aucune métrique claire sur ces délais.

Quelles nuances faut-il apporter à cette affirmation ?

Premier point : Google ne parle que de détection, pas d'éligibilité. Vos données structurées peuvent être parfaitement détectées et techniquement valides, mais Google peut décider de ne pas les exploiter. Les critères de qualité pour l'affichage des rich snippets ne sont pas publics, et ils varient selon le type de schema.

Deuxième point : les outils de test fonctionnent en mode « fetch as Googlebot », mais ils ne simulent pas les conditions réelles de crawl — notamment le budget crawl, le rendu JavaScript complexe sur des sites lourds, ou les problèmes de timeout. Un test positif en labo ne garantit pas que Googlebot arrivera au même résultat sur un site sous charge.

Dans quels cas cette règle ne s'applique-t-elle pas pleinement ?

Sur les sites à contenu dynamique fort — e-commerce avec des milliers de fiches produits mises à jour en temps réel, sites d'actualité avec rotation rapide — les délais de synchronisation peuvent créer des faux négatifs temporaires. Search Console peut signaler des erreurs sur des pages qui n'existent déjà plus ou dont le markup a changé entre le crawl et le moment où vous consultez le rapport.

Autre cas limite : les implémentations hybrides (mix de JSON-LD et microdata). Les outils de test détectent généralement les deux, mais des incohérences entre les deux formats peuvent créer des comportements imprévisibles — et Google ne documente pas clairement comment il arbitre en cas de conflit.

Impact pratique et recommandations

Que faut-il faire concrètement pour vérifier vos données structurées ?

D'abord, utilisez systématiquement le Rich Results Test avant tout déploiement. Testez sur un échantillon représentatif de pages : page d'accueil, fiche produit, article de blog, page catégorie. Ne vous contentez pas d'une seule URL.

Ensuite, après déploiement, suivez l'évolution dans Search Console via le rapport « Améliorations ». Les erreurs et avertissements qui persistent au-delà de 7-10 jours signalent un vrai problème — pas un simple délai de synchronisation.

Quelles erreurs éviter dans le diagnostic de vos schemas ?

Ne paniquez pas si Search Console affiche des erreurs 24h après votre déploiement. Google a besoin de recrawler vos pages, et ce processus n'est jamais instantané. Vérifiez d'abord que l'outil d'inspection d'URL (qui force un fetch en temps réel) détecte correctement vos schemas.

Autre erreur classique : se fier uniquement aux validateurs tiers. Des outils comme Schema.org Validator ou d'autres validateurs JSON-LD vérifient la syntaxe, mais ne testent pas l'éligibilité Google. Seuls les outils Google font foi pour savoir si vos données déclencheront des rich snippets.

Comment construire un workflow de monitoring efficace ?

Mettez en place une surveillance automatisée de vos rapports Search Console via l'API. Alertez-vous dès qu'un pic d'erreurs apparaît sur vos types de schema critiques (Product, Article, FAQ, etc.). Un monitoring réactif vous permet de corriger avant que l'impact SEO ne se fasse sentir.

Complétez avec des tests réguliers post-déploiement : après chaque mise à jour majeure de template, après chaque refonte, après chaque migration. Les données structurées cassent facilement — un div déplacé, un attribut itemscope supprimé par mégarde, et tout s'effondre.

- Tester systématiquement avec le Rich Results Test avant déploiement sur un échantillon représentatif de pages

- Utiliser l'outil d'inspection d'URL dans Search Console pour vérifier le rendu réel côté Googlebot après déploiement

- Patienter 7-10 jours avant de considérer une erreur Search Console comme définitive (délai de synchronisation normal)

- Monitorer le rapport « Améliorations » dans Search Console via API pour détecter les pics d'erreurs rapidement

- Tester spécifiquement le rendu JavaScript si vos schemas sont injectés côté client

- Ne jamais se fier uniquement aux validateurs tiers — seuls les outils Google font foi pour l'éligibilité

- Documenter vos implémentations de schema pour faciliter les diagnostics futurs lors de refontes ou migrations

❓ Questions frequentes

Si le Rich Results Test valide mes schemas, pourquoi mes rich snippets n'apparaissent-ils pas en SERP ?

Combien de temps faut-il attendre pour que Search Console reflète mes modifications de schema ?

Mes schemas JSON-LD injectés en JavaScript sont-ils détectés par Google ?

Dois-je corriger les avertissements (warnings) ou seulement les erreurs (errors) dans Search Console ?

Peut-on mélanger JSON-LD et microdata sur une même page sans risque ?

🎥 De la même vidéo 13

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 07/04/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.