Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Faut-il supprimer la balise 'priority' de vos sitemaps ?

- □ Faut-il vraiment supprimer la balise 'changefreq' de vos sitemaps ?

- □ Pourquoi Google ignore-t-il la balise 'lastmod' dans vos sitemaps ?

- □ Faut-il encore remplir la balise lastmod dans vos sitemaps XML ?

- □ Faut-il remplacer les extensions de sitemap par des données structurées ?

- □ Faut-il abandonner les balises vidéo et image dans vos sitemaps XML ?

- □ Faut-il mettre à jour lastmod quand on ajoute des données structurées ?

- □ Pourquoi créer un sitemap révèle-t-il plus de problèmes techniques qu'il n'en résout ?

- □ Pourquoi les identifiants de session en paramètres URL menacent-ils encore le crawl de votre site ?

- □ Un site crawlable garantit-il vraiment une meilleure navigation utilisateur ?

- □ Faut-il vraiment attendre le crawl même après avoir soumis ses URLs via API ?

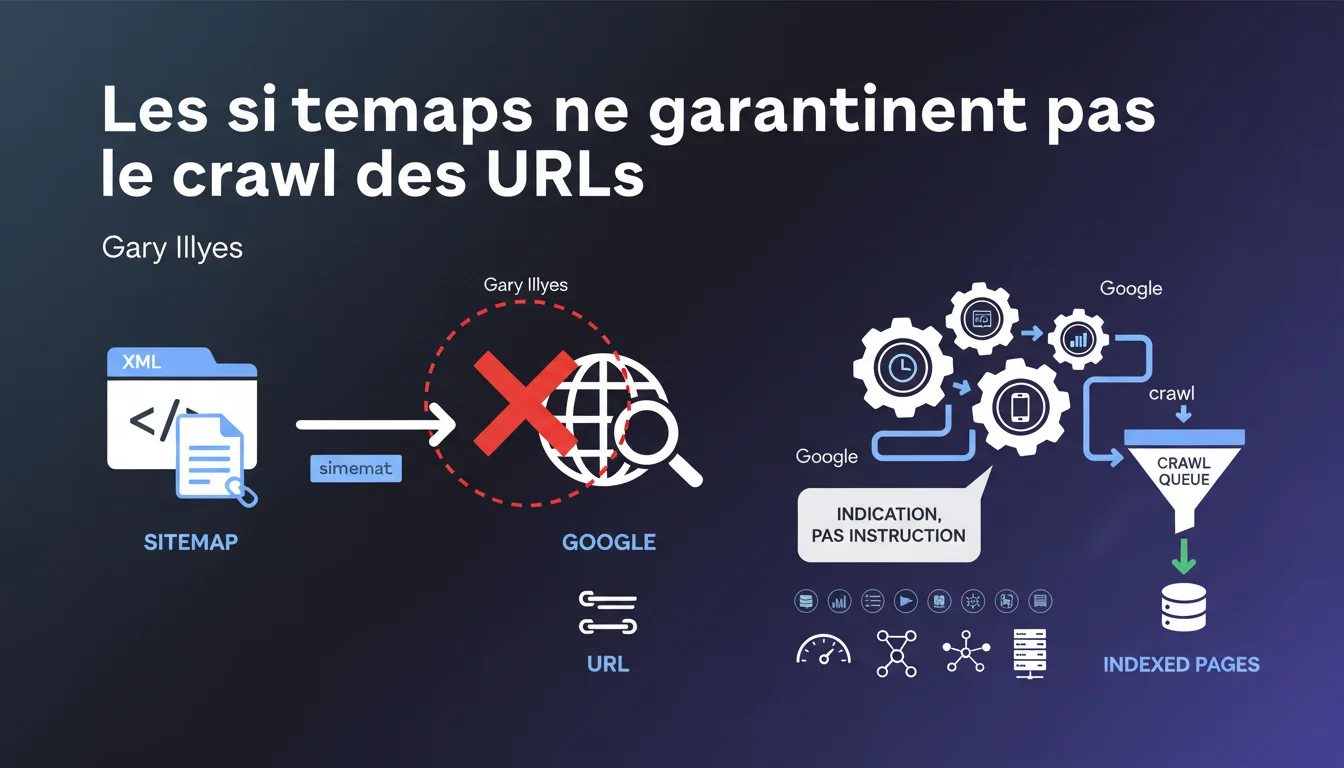

Soumettre un sitemap à Google ne garantit absolument pas que vos URLs seront crawlées. Le sitemap est une simple déclaration d'existence — pas une instruction de crawl. Le mécanisme qui détermine ce qui entre dans les files de crawl est infiniment plus complexe que la seule présence d'une URL dans un fichier XML.

Ce qu'il faut comprendre

Que signifie réellement cette déclaration pour le crawl ?

Beaucoup de praticiens SEO considèrent encore le sitemap comme un "ticket d'entrée" automatique dans l'index de Google. C'est une erreur de perception fondamentale. Le sitemap est un outil de découverte, rien de plus. Il signale des URLs potentiellement intéressantes, mais n'impose aucune priorité ni obligation à Googlebot.

Le processus qui décide ce qui sera crawlé repose sur des dizaines de signaux : la popularité du domaine, la fraîcheur perçue du contenu, la fréquence historique de mise à jour, le nombre de liens internes et externes pointant vers l'URL, le crawl budget alloué au site, et une multitude d'autres facteurs opaques. Le sitemap n'est qu'une donnée parmi d'autres.

Pourquoi Google insiste-t-il autant sur ce point ?

Parce que des millions de webmasters soumettent des sitemaps en pensant que c'est suffisant pour résoudre leurs problèmes d'indexation. Spoiler : ça ne l'est pas. Google veut éviter que les propriétaires de sites attribuent un pouvoir magique au sitemap, alors qu'il ne fait que suggérer des URLs — sans aucune garantie de traitement.

Cette déclaration reflète une volonté de tempérer les attentes. Trop de sites se plaignent que leurs pages ne sont pas indexées « alors qu'elles sont dans le sitemap ». Gary Illyes rappelle ici que la présence dans un sitemap n'est ni une condition suffisante, ni même toujours nécessaire, pour être crawlé.

Quels sont les facteurs qui priment vraiment sur le sitemap ?

Le sitemap est un signal faible comparé à d'autres leviers. Les liens internes, par exemple, ont un impact bien plus déterminant sur la probabilité de crawl. Une URL profondément enfouie dans l'arborescence, même présente dans le sitemap, risque d'être ignorée si aucun lien interne pertinent ne la renforce.

De même, le crawl budget est un filtre majeur. Un site avec une faible autorité ou des problèmes techniques (temps de réponse lent, erreurs serveur fréquentes) verra ses URLs traitées au compte-gouttes — sitemap ou pas. Google optimise son crawl en fonction de la valeur perçue du site et de ses ressources serveur disponibles.

- Le sitemap ne garantit pas le crawl, il signale seulement l'existence d'URLs

- Le crawl dépend de multiples facteurs : popularité, fraîcheur, liens, crawl budget

- Un sitemap mal conçu ou surdimensionné peut même diluer l'attention de Googlebot

- Les liens internes restent le levier prioritaire pour orienter le crawl

- La qualité prime toujours sur la quantité : un sitemap propre vaut mieux qu'un sitemap exhaustif

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Sur le terrain, on constate régulièrement que des URLs présentes dans le sitemap ne sont jamais crawlées — ou crawlées avec des mois de retard. À l'inverse, des URLs absentes du sitemap mais bien maillées en interne peuvent être découvertes et indexées en quelques jours. Le sitemap est un signal parmi d'autres, pas un levier décisif.

Ce qui dérange, c'est que Google entretient une certaine ambiguïté sur l'utilité réelle du sitemap. Dans sa documentation officielle, il recommande de soumettre un sitemap « pour aider à la découverte ». Mais en pratique, on observe que son impact est souvent marginal sur des sites bien structurés avec un bon maillage interne. [A vérifier] : Google pourrait clarifier dans quels contextes précis le sitemap apporte une valeur ajoutée mesurable.

Quelles nuances faut-il apporter à cette déclaration ?

Il y a des cas où le sitemap reste indispensable. Sur des sites très larges (e-commerce à millions de références, agrégateurs de contenus), le sitemap permet de signaler des URLs isolées qui ne bénéficient pas d'un maillage interne optimal. Dans ces configurations, le sitemap sert de filet de sécurité pour éviter que des pages stratégiques passent sous les radars.

De même, pour des contenus publiés très fréquemment (médias, blogs actifs), le sitemap permet à Google de détecter plus rapidement les nouvelles URLs — même si, encore une fois, cela ne garantit pas un crawl immédiat. Le sitemap accélère la découverte, mais ne force aucune priorité dans les files de crawl.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Pour les très petits sites (moins de 100 pages), le sitemap est souvent superflu. Si le maillage interne est clair et cohérent, Googlebot découvrira naturellement toutes les pages en suivant les liens. Le sitemap devient alors une formalité administrative sans impact réel sur le crawl.

À l'inverse, sur des sites techniques complexes (JavaScript lourd, pagination en AJAX, facettes dynamiques), le sitemap peut servir de balise de secours pour garantir que certaines URLs critiques sont au moins connues de Google — même si, là encore, rien ne garantit qu'elles seront crawlées en priorité.

Impact pratique et recommandations

Que faut-il faire concrètement avec son sitemap ?

Première règle : nettoyer impitoyablement. Ne gardez dans le sitemap que les URLs que vous voulez réellement voir indexées. Retirez toutes les pages en noindex, les redirections, les erreurs 404, les canoniques non self-referencing. Un sitemap épuré envoie un signal de qualité à Googlebot.

Ensuite, segmentez vos sitemaps par typologie de contenu ou par section du site. Plutôt qu'un fichier monolithique de 50 000 URLs, créez plusieurs sitemaps thématiques (produits, catégories, contenus éditoriaux, etc.). Cela permet de suivre plus finement le comportement de crawl de Google et d'identifier les zones sous-crawlées.

Quelles erreurs éviter absolument ?

Ne surchargez pas votre sitemap avec des URLs inutiles. Inclure toutes les variantes de filtres, toutes les pages de pagination, tous les paramètres d'URL dilue l'attention de Googlebot et peut même freiner le crawl des pages stratégiques. La sélectivité est cruciale.

Évitez également de modifier en permanence votre sitemap sans raison stratégique. Google crawle les sitemaps de manière asynchrone — les soumettre toutes les heures n'accélérera rien. Concentrez-vous sur la stabilité et la cohérence du fichier plutôt que sur la fréquence de mise à jour.

- Nettoyez votre sitemap : retirez toutes les URLs non indexables (noindex, 404, redirections)

- Segmentez vos sitemaps par typologie de contenu pour un suivi granulaire

- Limitez-vous aux URLs stratégiques — la qualité prime sur la quantité

- Vérifiez régulièrement les rapports de couverture dans la Search Console

- Renforcez le maillage interne des URLs prioritaires — le sitemap ne remplace pas les liens

- Surveillez le crawl budget : identifiez les pages crawlées inutilement et bloquez-les via robots.txt

- Ne comptez jamais sur le sitemap seul pour résoudre un problème d'indexation

Comment s'assurer que Google crawle efficacement vos pages stratégiques ?

Le sitemap est un outil parmi d'autres. Pour maximiser le crawl des pages prioritaires, misez sur un maillage interne solide, des temps de réponse serveur optimaux, et une architecture claire. Vérifiez dans la Search Console quelles URLs sont crawlées, à quelle fréquence, et ajustez votre stratégie en conséquence.

Si vous constatez que des pages critiques ne sont jamais crawlées malgré leur présence dans le sitemap, c'est le signe d'un problème plus profond : manque de liens internes, contenu perçu comme faible valeur, ou crawl budget insuffisant. Dans ce cas, revoir l'architecture globale du site et renforcer les signaux de pertinence devient prioritaire.

❓ Questions frequentes

Un sitemap est-il obligatoire pour que Google indexe mon site ?

Combien de temps après la soumission d'un sitemap Google crawle-t-il les URLs ?

Dois-je inclure toutes mes pages dans le sitemap ?

Le sitemap influence-t-il le classement dans les résultats de recherche ?

Que faire si Google ne crawle pas mes URLs malgré leur présence dans le sitemap ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.