Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Faut-il supprimer la balise 'priority' de vos sitemaps ?

- □ Faut-il vraiment supprimer la balise 'changefreq' de vos sitemaps ?

- □ Pourquoi Google ignore-t-il la balise 'lastmod' dans vos sitemaps ?

- □ Faut-il encore remplir la balise lastmod dans vos sitemaps XML ?

- □ Pourquoi soumettre un sitemap ne garantit-il pas le crawl de vos URLs ?

- □ Faut-il remplacer les extensions de sitemap par des données structurées ?

- □ Faut-il abandonner les balises vidéo et image dans vos sitemaps XML ?

- □ Faut-il mettre à jour lastmod quand on ajoute des données structurées ?

- □ Pourquoi créer un sitemap révèle-t-il plus de problèmes techniques qu'il n'en résout ?

- □ Pourquoi les identifiants de session en paramètres URL menacent-ils encore le crawl de votre site ?

- □ Un site crawlable garantit-il vraiment une meilleure navigation utilisateur ?

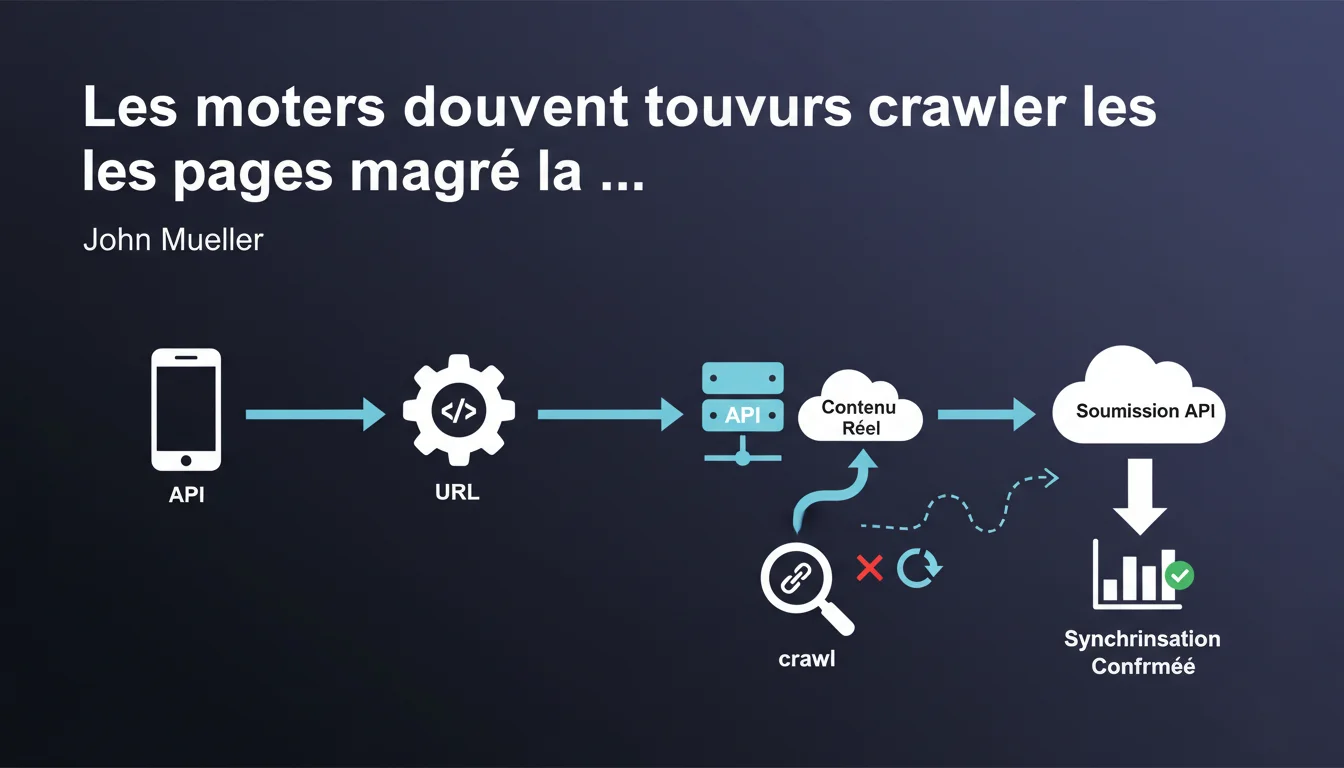

Google confirme que soumettre une URL via l'Indexing API ou IndexNow ne suffit pas : le moteur doit crawler la page pour vérifier que le contenu correspond réellement à ce qui est déclaré. Cette vérification systématique évite les désynchronisations entre les signaux envoyés et la réalité du terrain.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur le crawl après soumission ?

L'enjeu ici est simple : éviter la manipulation. Si Google indexait aveuglément toutes les URLs soumises sans vérifier leur contenu, n'importe quel site pourrait déclarer du contenu premium alors qu'il sert du spam.

Le crawl permet de valider la cohérence entre ce qui est annoncé (via API) et ce qui est réellement servi aux utilisateurs. C'est une couche de sécurité indispensable pour maintenir la qualité de l'index.

Que se passe-t-il concrètement quand on soumet une URL ?

La soumission via API agit comme un signal de priorité. Elle dit à Google « cette page mérite ton attention maintenant », mais ne garantit ni l'indexation immédiate ni le contournement du crawl.

Google inscrit l'URL dans sa file de crawl, potentiellement avec une priorité supérieure, puis envoie Googlebot vérifier. Ce n'est qu'après cette vérification que l'indexation peut se faire — ou non, selon ce que le bot trouve.

Cela change-t-il quelque chose pour les sites à forte vélocité ?

Oui et non. Pour les sites d'actualité ou e-commerce qui publient massivement, l'Indexing API accélère la découverte mais ne supprime pas l'étape de crawl. Le gain de temps se situe sur la priorisation, pas sur la validation.

Les sites avec un crawl budget limité peuvent optimiser leurs soumissions pour concentrer les ressources de Googlebot sur les contenus stratégiques — mais le robot passera quand même.

- La soumission API est un signal de priorité, pas un raccourci vers l'indexation

- Le crawl reste obligatoire pour valider la correspondance contenu/déclaration

- Cette double vérification protège l'index contre les manipulations

- L'avantage réel : accélérer la découverte, pas court-circuiter le processus

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. Les tests montrent depuis longtemps que soumettre une URL ne garantit rien. On observe régulièrement des pages soumises via API qui mettent plusieurs jours à être crawlées — voire jamais indexées si le contenu pose problème.

Ce que Mueller confirme ici, c'est que le crawl reste le passage obligé. Les APIs ne sont pas des leviers magiques mais des outils de priorisation. Ceux qui espéraient court-circuiter le processus classique peuvent ranger leurs espoirs.

Quelles nuances apporter à cette règle ?

Premier point : Google ne précise pas le délai entre soumission et crawl. Un site autoritaire avec un bon crawl budget verra probablement ses URLs soumises crawlées rapidement. Un site faible attendra. [A vérifier] : existe-t-il un SLA implicite selon le profil du site ?

Deuxième nuance — et elle est de taille : cette déclaration s'applique à l'indexation standard. Les JobPosting et autres contenus temps-réel bénéficient parfois d'un traitement différencié, où la soumission API a plus de poids immédiat.

Dans quels cas cette vérification peut-elle poser problème ?

Soyons honnêtes : si votre contenu change fréquemment entre la soumission et le crawl effectif, vous risquez une désynchronisation. Imaginez un prix qui évolue toutes les heures ou un stock qui fluctue. Le bot crawle avec du retard, indexe une info périmée.

Autre cas problématique : les sites qui servent du contenu différent selon le user-agent. Si ce qui est montré à Googlebot ne correspond pas à ce qui était promis dans la soumission, vous risquez une pénalité pour cloaking — même involontaire.

Impact pratique et recommandations

Que faut-il faire concrètement avec cette information ?

Arrêtez de croire que l'Indexing API est une baguette magique. Utilisez-la pour signaler les contenus prioritaires (nouveaux produits, articles d'actualité, pages stratégiques), mais continuez à optimiser votre crawl budget global.

Assurez-vous que votre site est techniquement crawlable : robots.txt propre, sitemap XML à jour, temps de réponse corrects, pas de chaînes de redirections inutiles. Si Googlebot ne peut pas crawler efficacement, la soumission API ne sert à rien.

Quelles erreurs éviter absolument ?

Ne submettez pas massivement des URLs de faible qualité en espérant forcer l'indexation. Vous gaspillez votre quota API et, pire, vous envoyez un signal négatif sur la qualité de votre site.

Évitez les désynchronisations entre ce que vous soumettez et ce qui est réellement servi. Si vous annoncez une page via API, elle doit être accessible et conforme au moment du crawl — pas en construction, pas en 404, pas en redirection.

Comment vérifier que tout fonctionne correctement ?

Suivez vos soumissions API dans la Search Console (rapport Indexing API). Croisez avec les logs serveur pour identifier le délai moyen entre soumission et crawl effectif. Si ce délai est anormalement long, cherchez des freins techniques.

Vérifiez également que les pages soumises sont bien celles qui génèrent du trafic ou des conversions. Une soumission API bien ciblée optimise votre crawl budget et concentre les ressources de Google là où ça compte.

- Réserver l'Indexing API aux contenus réellement prioritaires et temps-réel

- Maintenir une infrastructure technique permettant un crawl rapide et efficace

- Synchroniser les soumissions avec la disponibilité réelle du contenu

- Monitorer le délai soumission/crawl pour détecter les anomalies

- Éviter les soumissions massives de contenus faibles ou dupliqués

- Croiser les données API avec les logs serveur pour une vision complète

❓ Questions frequentes

L'Indexing API garantit-elle une indexation plus rapide ?

Peut-on utiliser IndexNow et Indexing API en parallèle ?

Que se passe-t-il si le contenu change entre la soumission et le crawl ?

Les pages soumises via API sont-elles toujours crawlées dans les 24h ?

Faut-il soumettre toutes les nouvelles pages via API ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.