Declaration officielle

Autres déclarations de cette vidéo 11 ▾

- □ Faut-il supprimer la balise 'priority' de vos sitemaps ?

- □ Faut-il vraiment supprimer la balise 'changefreq' de vos sitemaps ?

- □ Pourquoi Google ignore-t-il la balise 'lastmod' dans vos sitemaps ?

- □ Faut-il encore remplir la balise lastmod dans vos sitemaps XML ?

- □ Pourquoi soumettre un sitemap ne garantit-il pas le crawl de vos URLs ?

- □ Faut-il remplacer les extensions de sitemap par des données structurées ?

- □ Faut-il abandonner les balises vidéo et image dans vos sitemaps XML ?

- □ Faut-il mettre à jour lastmod quand on ajoute des données structurées ?

- □ Pourquoi les identifiants de session en paramètres URL menacent-ils encore le crawl de votre site ?

- □ Un site crawlable garantit-il vraiment une meilleure navigation utilisateur ?

- □ Faut-il vraiment attendre le crawl même après avoir soumis ses URLs via API ?

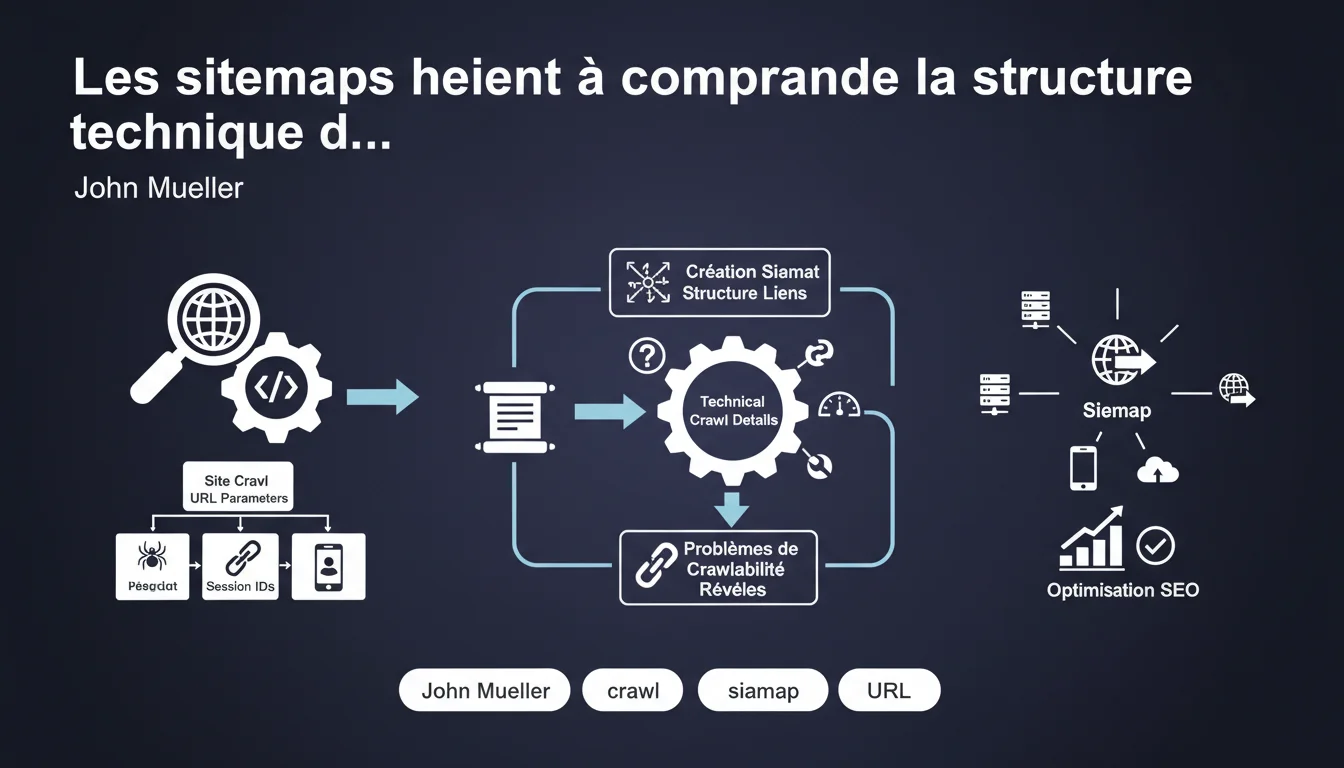

Google confirme que l'exercice de création d'un sitemap force à crawler son propre site et expose des failles techniques souvent ignorées : paramètres d'URL mal gérés, identifiants de session qui polluent l'index, structure de liens défaillante. Le sitemap n'est pas qu'un fichier XML — c'est un diagnostic brutal de votre architecture.

Ce qu'il faut comprendre

Le sitemap est-il vraiment un simple fichier de soumission à Google ?

Non. La déclaration de Mueller change la perspective : le sitemap est d'abord un outil d'audit pour le propriétaire du site. Quand vous générez un sitemap, vous êtes obligé de simuler le comportement d'un crawler — parcourir les URLs, détecter les redirections, identifier les paramètres dynamiques.

C'est là que ça coince. Beaucoup de sites découvrent à cette étape qu'ils ont des dizaines de milliers d'URLs parasites générées par des filtres, des sessions utilisateur ou des paramètres inutiles. Le sitemap révèle ce que l'œil humain ne voit jamais en navigation normale.

Quels problèmes de crawlabilité émergent concrètement ?

Les trois types d'alertes qui surgissent systématiquement : les paramètres d'URL qui créent du contenu dupliqué (tri, filtres, tracking), les identifiants de session qui génèrent des URLs uniques pour chaque visiteur, et la structure des liens internes qui révèle des pages orphelines ou des boucles infinies.

Exemple typique : un site e-commerce qui découvre que chaque combinaison de filtres produit une URL distincte. Sans sitemap, ces URLs restent dans l'ombre. Avec un sitemap mal configuré, elles sont toutes soumises à Google — catastrophe garantie.

- Paramètres d'URL : tri, pagination, filtres, tracking analytics

- Identifiants de session : PHPSESSID, JSESSIONID, tokens temporaires

- Structure défaillante : pages orphelines, profondeur excessive, redirections en chaîne

- Duplication : variantes HTTP/HTTPS, www/non-www, trailing slash

Google utilise-t-il le sitemap uniquement pour crawler ?

Non, et c'est le point crucial. Google analyse la cohérence entre votre sitemap et votre structure réelle de liens. Si votre sitemap contient 50 000 URLs mais que seules 5 000 sont accessibles via le maillage interne, c'est un signal d'incohérence.

Le sitemap devient alors un indicateur de qualité technique. Un sitemap propre, aligné avec la structure interne et exempt de paramètres parasites, rassure Google sur la maîtrise de votre architecture.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Les audits montrent systématiquement que 80% des sites soumettent des sitemaps pollués par des URLs techniques sans valeur SEO. E-commerce avec des milliers de combinaisons de filtres, sites multilingues avec des variantes de paramètres, CMS qui génèrent des pages de preview — la liste est infinie.

Soyons honnêtes : beaucoup de SEO considèrent le sitemap comme une formalité, une case à cocher. Cette déclaration remet les pendules à l'heure — le sitemap est un miroir technique brutal. Si vous n'aimez pas ce que vous voyez, c'est votre architecture qui est en cause, pas le fichier XML.

Où cette logique trouve-t-elle ses limites ?

Sur un point majeur : tous les outils de génération de sitemap ne sont pas égaux. Les générateurs automatiques de CMS produisent souvent des fichiers bourrés d'URLs inutiles parce qu'ils ne comprennent pas la différence entre une page indexable et une URL technique. [A vérifier] : Google ne précise pas si un sitemap trop volumineux (>50 000 URLs) est pénalisant ou simplement ignoré au-delà d'un certain seuil.

Deuxième limite : cette logique suppose que vous maîtrisez votre propre crawl. Or, beaucoup de sites n'ont jamais audité leur structure avec Screaming Frog ou un équivalent. Résultat : le sitemap révèle des problèmes, mais personne n'a les compétences pour les interpréter.

Quelles sont les erreurs d'interprétation fréquentes ?

Première erreur : croire qu'un sitemap garantit l'indexation. Non. Google crawle ce qu'il veut, quand il veut. Le sitemap est une suggestion, pas un ordre. Si vos URLs ont zéro autorité ou zéro contenu unique, elles ne seront jamais indexées, sitemap ou pas.

Deuxième erreur : inclure des URLs bloquées par robots.txt ou en noindex dans le sitemap. C'est contradictoire et ça envoie un signal de confusion technique. Google le tolère, mais ça ne joue pas en votre faveur. Concrètement ? Nettoyez votre sitemap avant de le soumettre — ce n'est pas un dépotoir.

Impact pratique et recommandations

Que faut-il faire concrètement avant de générer un sitemap ?

Crawlez votre propre site avec un outil professionnel (Screaming Frog, OnCrawl, Botify). Identifiez les URLs générées par des paramètres inutiles, les sessions, les filtres. Configurez votre outil pour exclure ces patterns avant même de générer le fichier XML.

Deuxième étape critique : comparez votre sitemap avec votre maillage interne réel. Si une URL est dans le sitemap mais inaccessible à plus de 3 clics de la home, c'est un problème structurel. Soit vous améliorez le maillage, soit vous retirez l'URL du sitemap.

- Crawler le site avec un outil professionnel pour cartographier toutes les URLs

- Identifier et exclure les paramètres dynamiques inutiles (tri, filtres, tracking)

- Supprimer les identifiants de session des URLs indexables

- Vérifier la cohérence entre sitemap et structure de liens internes

- Exclure les URLs bloquées par robots.txt ou en noindex

- Limiter le sitemap aux URLs réellement stratégiques (pages de conversion, contenu éditorial)

- Tester le sitemap sur un échantillon avant soumission globale

Quelles erreurs critiques éviter absolument ?

Ne jamais soumettre un sitemap auto-généré par votre CMS sans l'avoir audité. Les CMS généralistes (WordPress, Shopify, Magento) incluent par défaut des pages techniques sans valeur SEO : archives, tags, pages auteur vides, variantes de pagination mal gérées.

Erreur fatale : inclure des URLs avec des paramètres de session ou de tracking. Google les crawle, détecte du duplicate content, et vous explosez vos quotas de crawl budget pour rien. Résultat : vos vraies pages stratégiques sont sous-crawlées.

Comment vérifier que votre sitemap est réellement propre ?

Soumettez-le à Google Search Console et analysez les erreurs de couverture. Si vous avez plus de 10% d'erreurs (pages introuvables, redirections, bloquées par robots.txt), votre sitemap est pollué. Corrigez avant de relancer.

Deuxième indicateur : comparez le nombre d'URLs dans votre sitemap avec le nombre d'URLs réellement indexées. Un écart >30% signale un problème de qualité ou de crawlabilité. Google vous dit indirectement qu'une partie de votre sitemap ne mérite pas l'indexation.

Recommandation finale : Le sitemap n'est pas un fichier à générer une fois pour toutes. C'est un outil de diagnostic continu qui reflète la santé technique de votre site. Chaque modification structurelle (nouvelle catégorie, refonte, ajout de filtres) doit déclencher une revue du sitemap.

Ces optimisations demandent une expertise technique pointue et une connaissance fine des outils de crawl professionnels. Si votre équipe interne manque de ressources ou de compétences sur ces aspects, il peut être judicieux de faire appel à une agence SEO spécialisée pour un accompagnement personnalisé — notamment sur l'audit de crawlabilité et la configuration avancée de Search Console.

❓ Questions frequentes

Un sitemap volumineux (>100 000 URLs) est-il pénalisant pour le SEO ?

Faut-il inclure les pages en noindex dans le sitemap ?

Comment savoir si mon CMS génère des URLs parasites dans le sitemap ?

Le sitemap améliore-t-il directement le classement dans Google ?

À quelle fréquence faut-il mettre à jour son sitemap ?

🎥 De la même vidéo 11

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/05/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.