Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Pourquoi l'écart entre URLs découvertes et indexées révèle-t-il des problèmes critiques ?

- □ Pourquoi les problèmes d'indexation se concentrent-ils sur certains dossiers de votre site ?

- □ Le no-index libère-t-il vraiment du crawl budget pour les pages importantes ?

- □ Les chaînes de redirections tuent-elles vraiment l'expérience utilisateur ?

- □ Faut-il vraiment supprimer toutes les redirections internes de votre site ?

- □ Pourquoi Google ralentit-il son crawl quand votre serveur faiblit ?

- □ L'instabilité serveur peut-elle vraiment déclasser votre site dans Google ?

- □ Faut-il vraiment multiplier les outils de crawl pour diagnostiquer efficacement vos problèmes SEO ?

- □ Pourquoi faut-il détecter les erreurs techniques avant que Google ne les trouve ?

- □ Les Developer Tools du navigateur suffisent-ils vraiment pour auditer vos redirections SEO ?

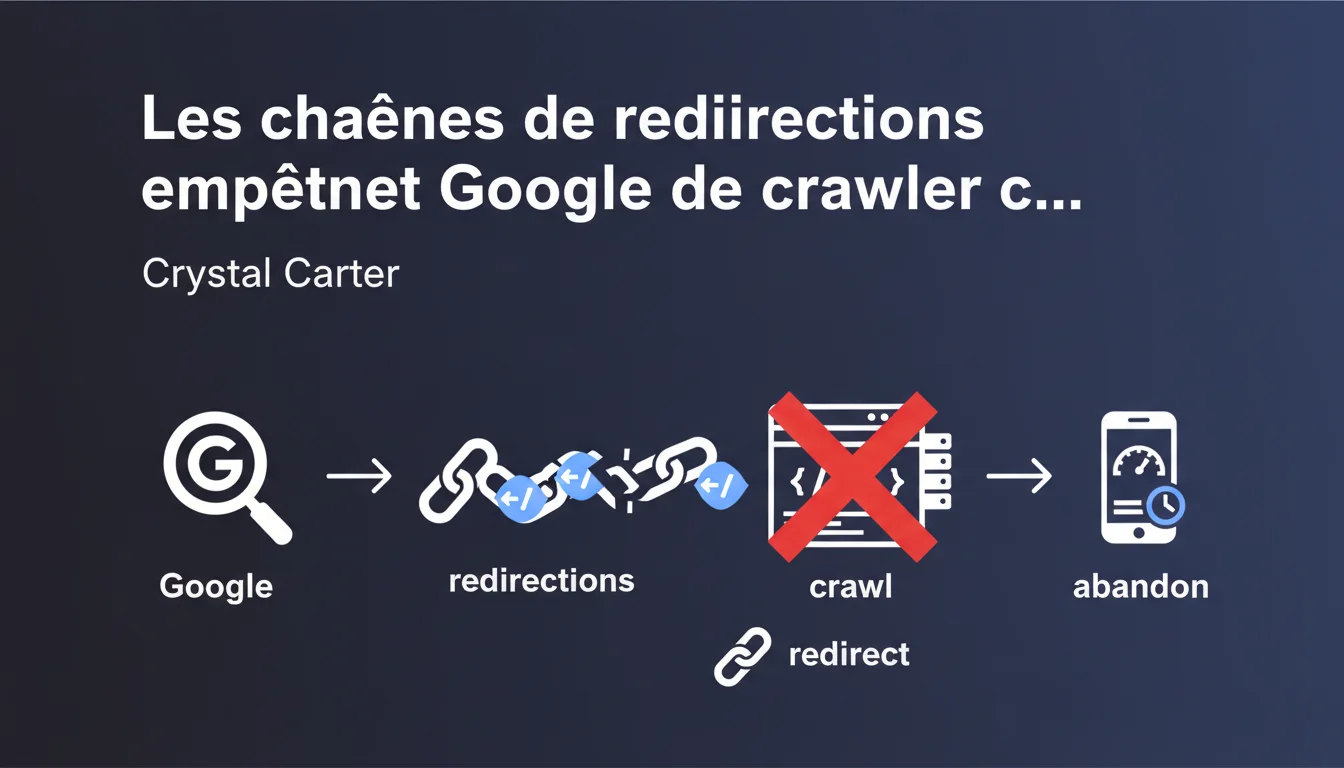

Google abandonne purement et simplement l'exploration d'un site si des chaînes de redirections ralentissent trop son crawl. Autrement dit : trop de 301 en cascade, et Googlebot passe son chemin. La conséquence directe ? Des pans entiers de votre site peuvent ne jamais être indexés.

Ce qu'il faut comprendre

Crystal Carter met les points sur les i : Google ne s'acharne pas sur un site présentant des chaînes de redirections complexes. Si le crawler rencontre trop de sauts successifs (A → B → C → D), il lâche l'affaire et répartit son budget de crawl ailleurs.

Cette déclaration confirme ce que beaucoup suspectaient déjà terrain : le temps de crawl n'est pas infini, et Googlebot optimise ses ressources. Un site qui multiplie les redirections en chaîne se tire une balle dans le pied.

Qu'est-ce qu'une chaîne de redirections exactement ?

On parle de chaîne quand une URL redirige vers une deuxième URL, qui elle-même redirige vers une troisième, voire une quatrième. Exemple classique : ancienne-url.com/page → nouvelle-url.com/page → nouvelle-url.com/fr/page → nouvelle-url.com/fr/page-finale.

Google tolère généralement 1 à 2 sauts, mais au-delà, le risque d'abandon augmente considérablement. Et ce n'est pas qu'une question théorique — les outils de crawl professionnels rencontrent exactement les mêmes limites.

Pourquoi Google abandonne-t-il plutôt que de persévérer ?

Le budget de crawl est une ressource limitée. Google ne peut pas passer des heures à suivre des redirections en boucle sur un seul site alors que des millions d'autres pages attendent d'être explorées.

Si votre site force Googlebot à consommer son temps sur des redirections inutiles, il considère simplement que vous ne facilitez pas son travail. Résultat : il reviendra moins souvent, explorera moins de pages, et votre indexation en pâtira directement.

Quels sont les impacts concrets sur l'indexation ?

Les conséquences sont multiples et mesurables. D'abord, des pages valides ne seront jamais indexées — même si elles sont techniquement accessibles, Googlebot aura abandonné avant de les atteindre.

Ensuite, le rafraîchissement de vos contenus sera ralenti. Une mise à jour importante risque de mettre des semaines à être prise en compte si elle se trouve au bout d'une chaîne de redirections. Enfin, votre crawl budget global diminue : Google répartit son temps différemment et vous pénalise indirectement.

- Google abandonne l'exploration quand les chaînes de redirections ralentissent trop le crawl

- Une chaîne se définit par des redirections successives (A → B → C → D...)

- Au-delà de 2 sauts, le risque d'abandon devient significatif

- L'impact direct : pages non indexées, rafraîchissement lent, budget de crawl gaspillé

- Les outils de crawl tiers rencontrent exactement les mêmes limitations que Googlebot

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment ce qu'on observe sur le terrain ?

Oui, et c'est même un euphémisme. Sur des audits de sites d'envergure, on constate régulièrement que des sections entières ne sont jamais crawlées à cause de redirections mal gérées. Les logs serveur le confirment : Googlebot suit 1, parfois 2 redirections, puis disparaît.

Ce qui manque dans la déclaration de Crystal Carter, c'est la limite précise : combien de sauts exactement ? 3 ? 5 ? Google reste volontairement flou. [À vérifier] avec vos propres tests, car cette tolérance varie probablement selon la « confiance » que Google accorde à votre site (PageRank interne, historique de crawl, etc.).

Tous les types de redirections sont-ils concernés de la même manière ?

Non, et c'est une nuance importante. Les redirections 301 (permanentes) et 302 (temporaires) ne sont pas traitées identiquement par Google. En théorie, une 301 devrait signaler « cette page a déménagé définitivement, mets à jour ton index », tandis qu'une 302 dit « reviens vérifier plus tard ».

En pratique, une chaîne de 302 est encore pire qu'une chaîne de 301 : Googlebot doit revenir régulièrement vérifier si la redirection temporaire a changé. Résultat : budget de crawl massacré. Et si vous mélangez 301, 302 et même des 307 dans la même chaîne ? Vous signez l'arrêt de mort de votre crawl.

Existe-t-il des cas où Google tolère davantage de sauts ?

Honnêtement ? Peu probable. Certains SEO avancent que les sites « autoritaires » bénéficieraient d'une marge de manœuvre plus large, mais [À vérifier] — aucune donnée officielle ne vient étayer cette hypothèse.

Ce qu'on sait avec certitude : même un site puissant gaspille du crawl budget avec des redirections en chaîne. Vous pouvez avoir 10 millions de backlinks, si Googlebot passe 80 % de son temps à suivre vos redirections, il explorera moins de pages utiles. La « tolérance » est un mythe dangereux.

Impact pratique et recommandations

Comment identifier les chaînes de redirections sur votre site ?

Première étape : crawler votre site avec un outil dédié (Screaming Frog, OnCrawl, Botify, etc.). Configurez-le pour suivre toutes les redirections et générez un rapport spécifique sur les chaînes détectées.

Analysez ensuite vos logs serveur. Vous verrez exactement où Googlebot abandonne. Si vous constatez que certaines sections reçoivent zéro visite de Googlebot alors qu'elles sont liées depuis votre navigation, cherchez les redirections en amont. Souvent, le problème vient d'une migration mal nettoyée ou d'un changement de CMS qui a empilé les couches.

Quelles actions correctives mettre en place immédiatement ?

Simplifiez vos redirections pour qu'elles pointent directement vers la destination finale. Si vous avez A → B → C, modifiez A pour qu'elle redirige directement vers C. Idem pour B si elle est encore référencée quelque part.

Passez en revue votre historique de migrations. Chaque refonte laisse des traces : anciennes URLs qui redirigent vers des URLs temporaires, elles-mêmes redirigées vers la version actuelle. Nettoyez tout ça. Et mettez à jour vos liens internes pour qu'ils pointent directement vers les URLs finales — ne comptez jamais sur une redirection pour « rattraper » un lien mal configuré.

Quelles erreurs éviter absolument ?

Ne laissez jamais une redirection 302 en place si le changement est permanent. Google finira par la traiter comme une 301, mais en attendant, vous perdez du temps et du crawl budget.

Évitez les redirections circulaires (A → B → A) ou les boucles (A → B → C → A). Elles font planter les crawlers et donnent une image catastrophique de votre site. Et surtout, ne créez pas de nouvelles chaînes lors de migrations : mappez toujours l'ancienne URL vers la nouvelle URL finale, pas vers une URL intermédiaire.

- Crawler votre site avec un outil professionnel pour cartographier toutes les redirections

- Analyser les logs serveur pour repérer où Googlebot abandonne

- Simplifier chaque chaîne pour qu'elle pointe directement vers la destination finale

- Mettre à jour les liens internes pour éviter de déclencher des redirections inutiles

- Remplacer toutes les 302 par des 301 si les changements sont permanents

- Vérifier qu'aucune boucle ou redirection circulaire n'existe

- Nettoyer l'historique des migrations pour supprimer les couches successives de redirections

❓ Questions frequentes

Combien de redirections en chaîne Google tolère-t-il avant d'abandonner ?

Les redirections 301 et 302 ont-elles le même impact sur le crawl ?

Un site avec beaucoup d'autorité peut-il se permettre plus de redirections en chaîne ?

Comment vérifier si Google abandonne le crawl de certaines pages à cause de redirections ?

Dois-je corriger en priorité les chaînes de redirections ou d'autres problèmes techniques ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 29/11/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.