Declaration officielle

Autres déclarations de cette vidéo 18 ▾

- □ Peut-on vraiment montrer du contenu payant structuré uniquement à Googlebot sans risque de pénalité ?

- □ Le DMCA s'applique-t-il vraiment page par page ou peut-on signaler un site entier ?

- □ Google indexe-t-il vraiment tout le contenu que vous publiez ?

- □ Une page AMP invalide peut-elle quand même être indexée par Google ?

- □ Safe Search peut-il empêcher votre site adulte de ranker sur votre propre marque ?

- □ Le Product Reviews Update peut-il impacter votre site même s'il n'est pas en anglais ?

- □ Géociblage ou hreflang : quelle méthode privilégier pour les contenus multilingues ?

- □ Google peut-il choisir arbitrairement quelle version linguistique indexer quand le contenu est identique ?

- □ Faut-il vraiment bloquer les URLs publicitaires dans robots.txt ?

- □ Faut-il abandonner l'injection dynamique de mots-clés pour éviter les pénalités Google ?

- □ Le client-side rendering React pose-t-il vraiment un problème de classement pour Google ?

- □ Faut-il vraiment bloquer toutes les URLs de recherche interne dans robots.txt ?

- □ Les sites SEO sont-ils vraiment exemptés des critères YMYL ?

- □ Google pénalise-t-il les breadcrumbs structurés invisibles ou trompeurs ?

- □ Peut-on vraiment lier plusieurs sites dans le footer sans risque SEO ?

- □ Faut-il vraiment traduire l'intégralité d'un site multilingue pour bien se positionner ?

- □ Faut-il vraiment s'inquiéter du crawl budget sur un site de moins de 10 000 URLs ?

- □ Robots.txt ou noindex : lequel choisir pour bloquer l'indexation ?

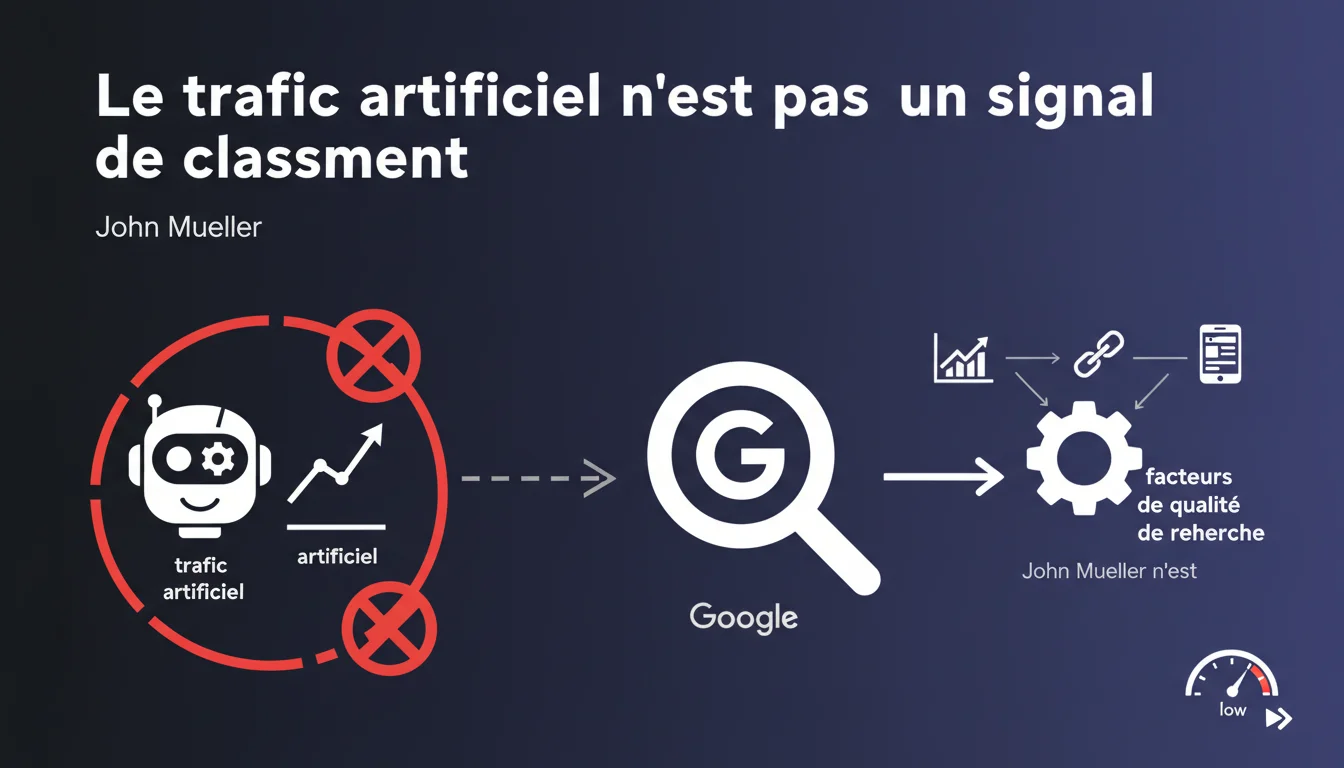

Google affirme que le trafic artificiel (bots) n'est pas un signal de classement. Si un site monte dans les SERPs après avoir utilisé des bots, c'est une coïncidence ou l'effet d'autres facteurs — pas une conséquence directe du trafic généré.

Ce qu'il faut comprendre

Pourquoi cette clarification de Google ?

Certains outils SEO et services promettent d'améliorer le classement en générant du trafic artificiel vers un site. L'idée ? Faire croire à Google qu'une page est populaire pour qu'il la remonte dans les résultats.

Mueller coupe court : le trafic bot n'est pas un signal de classement. Google n'analyse pas le volume de visiteurs d'un site pour décider s'il mérite d'être mieux positionné. Les algorithmes se concentrent sur d'autres critères — contenu, backlinks, expérience utilisateur, etc.

Que signifie exactement « trafic artificiel » ?

On parle ici de bots, de clics payants frauduleux, de scripts automatisés qui simulent des visites. Pas du trafic publicitaire légitime (Google Ads, Meta Ads), ni du trafic organique ou direct réel.

Le problème avec ces tactiques ? Elles peuvent fausser vos analytics, gaspiller vos ressources serveur et — dans le pire des cas — déclencher des pénalités si Google détecte une manipulation.

Si ce n'est pas un signal, pourquoi certains sites semblent monter ?

Mueller évoque une corrélation accidentelle. Un site qui achète du trafic bot peut aussi, au même moment, améliorer son contenu, obtenir de nouveaux backlinks ou optimiser ses Core Web Vitals.

C'est cette amélioration parallèle qui explique la montée — pas les bots. Confondre corrélation et causalité est un piège classique en SEO.

- Le trafic artificiel n'influence pas le classement selon Google

- Si un site monte après avoir utilisé des bots, chercher d'autres explications (backlinks, contenu, technique)

- Risque de pénalité si manipulation détectée

- Les analytics peuvent être faussées, compliquant l'analyse des vraies performances

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Honnêtement ? Oui. Aucune étude sérieuse n'a jamais prouvé que le trafic brut (volume de visites) soit un facteur de classement direct. Les corrélations observées s'expliquent toujours autrement.

Ce qui compte pour Google, c'est ce que les utilisateurs font sur votre site — pas combien ils sont. Un site avec 10 000 visiteurs bots et un taux de rebond de 100 % n'a aucun intérêt pour l'algorithme.

Quelles nuances faut-il apporter ?

Attention — le trafic réel influence indirectement le SEO. Si des milliers de personnes cherchent votre marque sur Google (recherches de navigation), c'est un signal de popularité et de qualité. Mais c'est du trafic organique, pas artificiel.

De même, un site très visité génère souvent plus de backlinks naturels, de partages sociaux, de mentions. Ces éléments, eux, impactent le classement. Le trafic est un effet, pas une cause. [A vérifier] : Google pourrait théoriquement utiliser des données Chrome ou Analytics pour affiner certains signaux comportementaux, mais aucune confirmation officielle.

Dans quels cas cette règle pourrait-elle être contournée ?

Elle ne l'est pas. Soyons clairs : aucun hack de trafic bot ne fera monter un site durablement. Même si Google utilisait le trafic comme signal (ce qu'il nie), ses systèmes détecteraient rapidement les anomalies.

Impact pratique et recommandations

Que faut-il faire concrètement si on utilise déjà du trafic bot ?

Arrêter immédiatement. Non seulement ça ne sert à rien pour le SEO, mais ça pollue vos données Analytics et peut déclencher des alertes chez Google.

Si vous avez investi dans ce type de service, réallouez ce budget vers des leviers efficaces : création de contenu, netlinking, optimisation technique.

Comment vérifier si mon site reçoit du trafic artificiel ?

Regardez vos analytics. Des signaux d'alerte : taux de rebond anormalement élevé, durée de session quasi nulle, pics de trafic inexpliqués depuis des géographies incohérentes.

Google Analytics 4 et Search Console ne montreront jamais ce trafic bot s'il ne génère aucune interaction réelle. Mais des outils tiers (logs serveur, Cloudflare Analytics) peuvent le révéler.

Quelles erreurs éviter pour ne pas être pénalisé ?

Ne jamais acheter de « services de trafic garanti », même s'ils promettent du trafic « réel ». Google détecte les patterns anormaux — clics répétés, IPs suspectes, comportements robotiques.

Évitez aussi les échanges de clics (« je visite ton site, tu visites le mien »). C'est inefficace et risqué.

- Arrêter tout service de génération de trafic artificiel

- Analyser les sources de trafic dans Analytics pour détecter des anomalies

- Réinvestir le budget dans du contenu de qualité et du netlinking naturel

- Configurer des filtres dans Analytics pour exclure le trafic bot connu

- Monitorer les logs serveur pour identifier des patterns suspects

- Se concentrer sur l'expérience utilisateur réelle (temps de chargement, engagement, conversions)

❓ Questions frequentes

Le trafic depuis Google Ads influence-t-il le classement organique ?

Si Google n'utilise pas le trafic, pourquoi mesure-t-on l'engagement utilisateur ?

Un concurrent peut-il nuire à mon site en envoyant du trafic bot ?

Les recherches de marque (branded search) sont-elles un signal de classement ?

Dois-je bloquer le trafic bot dans mon fichier robots.txt ?

🎥 De la même vidéo 18

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 24/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.