Declaration officielle

Autres déclarations de cette vidéo 18 ▾

- □ Peut-on vraiment montrer du contenu payant structuré uniquement à Googlebot sans risque de pénalité ?

- □ Le DMCA s'applique-t-il vraiment page par page ou peut-on signaler un site entier ?

- □ Google indexe-t-il vraiment tout le contenu que vous publiez ?

- □ Une page AMP invalide peut-elle quand même être indexée par Google ?

- □ Safe Search peut-il empêcher votre site adulte de ranker sur votre propre marque ?

- □ Le Product Reviews Update peut-il impacter votre site même s'il n'est pas en anglais ?

- □ Géociblage ou hreflang : quelle méthode privilégier pour les contenus multilingues ?

- □ Google peut-il choisir arbitrairement quelle version linguistique indexer quand le contenu est identique ?

- □ Faut-il vraiment bloquer les URLs publicitaires dans robots.txt ?

- □ Faut-il abandonner l'injection dynamique de mots-clés pour éviter les pénalités Google ?

- □ Le client-side rendering React pose-t-il vraiment un problème de classement pour Google ?

- □ Faut-il vraiment bloquer toutes les URLs de recherche interne dans robots.txt ?

- □ Les sites SEO sont-ils vraiment exemptés des critères YMYL ?

- □ Google pénalise-t-il les breadcrumbs structurés invisibles ou trompeurs ?

- □ Peut-on vraiment lier plusieurs sites dans le footer sans risque SEO ?

- □ Faut-il vraiment traduire l'intégralité d'un site multilingue pour bien se positionner ?

- □ Robots.txt ou noindex : lequel choisir pour bloquer l'indexation ?

- □ Le trafic artificiel influence-t-il vraiment le classement Google ?

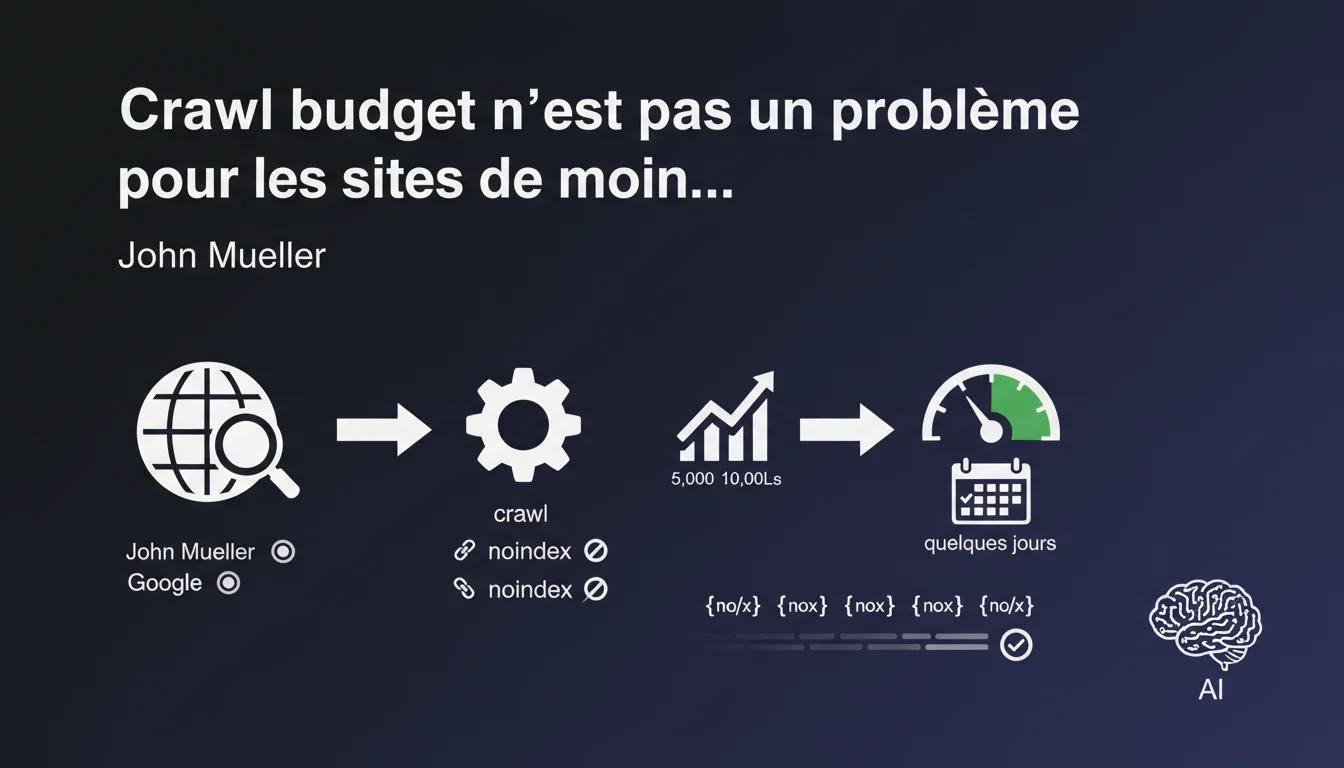

Google affirme que le crawl budget n'est pas un problème pour les sites de 5 000 à 10 000 URLs — ces volumes sont explorés en quelques jours. Les pages en noindex sont progressivement dépriorisées mais continuent d'être vérifiées périodiquement. Cette déclaration remet en perspective l'obsession de certains professionnels pour ce facteur.

Ce qu'il faut comprendre

Qu'est-ce que Google entend exactement par « quelques jours » ?

John Mueller reste volontairement flou sur cette notion de « quelques jours ». S'agit-il de 3 jours, 7 jours, 15 jours ? Cette imprécision laisse une marge d'interprétation importante.

Pour un site e-commerce qui ajoute régulièrement de nouveaux produits ou un média qui publie quotidiennement, cette temporalité peut faire toute la différence. Un délai d'indexation de 7 jours sur une promo flash est un problème commercial concret.

Pourquoi les pages en noindex continuent-elles d'être crawlées ?

Google doit vérifier périodiquement que la directive noindex est toujours en place. C'est un mécanisme de sécurité : si vous retirez un noindex d'une page importante, Google doit pouvoir le détecter.

Avec le temps, la fréquence de ces vérifications diminue. Une page en noindex depuis 6 mois sera visitée bien moins souvent qu'une page indexable mise à jour quotidiennement.

Cette limite de 10 000 URLs est-elle une règle absolue ?

Non, et c'est là que la déclaration devient dangereuse si on la prend au pied de la lettre. Mueller parle d'un volume global, pas de la qualité de ce volume.

Un site de 8 000 URLs dont 5 000 sont des pages de filtre dupliquées ou des URLs avec paramètres inutiles aura des problèmes de crawl, peu importe ce que dit Google. Le seuil est un indicateur, pas une garantie.

- Le crawl budget devient critique au-delà de 10 000 URLs selon Google

- Les pages noindex sont progressivement dépriorisées mais jamais totalement ignorées

- La qualité des URLs compte autant que leur nombre brut

- Un délai de « quelques jours » reste une notion subjective et non chiffrée

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment la réalité terrain ?

Partiellement. Sur des sites propres de 5 000 à 8 000 pages avec une architecture saine, on observe effectivement un crawl fluide. Mais Mueller omet les scénarios problématiques : sites avec pagination infinie, facettes multiples, paramètres URL mal gérés.

J'ai vu des sites de 6 000 URLs dont seulement 40% étaient crawlés mensuellement parce que Google perdait 60% de son budget sur des pages filtrées générées automatiquement. Le volume brut ne dit rien de la distribution du crawl. [À vérifier] : Google ne précise pas si ce seuil inclut les URLs découvertes mais non indexables.

Que signifie concrètement « explorées moins souvent » pour le noindex ?

Dans mes observations, une page en noindex depuis 3 mois passe d'un crawl hebdomadaire à un crawl mensuel, puis trimestriel. Mais ce rythme varie énormément selon l'autorité du domaine et la profondeur de la page.

Le problème ? Si vous gérez un site avec 2 000 pages en noindex (staging, anciennes versions, pages légales), Google va quand même y consacrer des ressources. Pas énorme, mais suffisamment pour impacter un site à 8 000 URLs déjà limite.

Dans quels cas cette règle des 10 000 URLs ne s'applique-t-elle pas ?

Premier cas : sites avec problèmes techniques massifs. Temps de réponse serveur supérieur à 500ms, erreurs 5xx récurrentes, redirections en chaîne — le volume devient secondaire.

Deuxième cas : sites multilingues ou multi-pays mal configurés. Vous pouvez avoir 6 000 URLs au total, mais si Google détecte 5 versions quasi-identiques de chaque page, le crawl va ralentir drastiquement.

Troisième cas : forte proportion de contenus dupliqués ou très similaires. Le seuil de 10 000 URLs suppose implicitement que chaque URL apporte une valeur différenciée.

Impact pratique et recommandations

Que faire si mon site approche les 10 000 URLs ?

Premier réflexe : auditer la qualité réelle de ces URLs. Combien sont indexables ? Combien génèrent du trafic organique ? Combien sont crawlées mensuellement selon la Search Console ?

Ensuite, identifier les URLs parasites : paramètres de tracking non bloqués, pages de pagination infinies, filtres cross-combinés sans valeur SEO. Un site de 9 000 URLs propres performe mieux qu'un site de 7 000 URLs polluées.

Enfin, segmenter par priorité stratégique. Les pages catégories et produits phares doivent être crawlées quotidiennement. Les anciennes actualités ou pages légales peuvent attendre une semaine.

Comment optimiser le crawl sans dépasser le seuil critique ?

- Bloquer via robots.txt les URLs sans valeur SEO : facettes inutiles, résultats de recherche interne, pages de compte utilisateur

- Utiliser le noindex avec parcimonie — privilégier le blocage robots.txt pour les sections entières sans intérêt

- Nettoyer régulièrement les pages orphelines qui consomment du budget sans apporter de valeur

- Optimiser les temps de réponse serveur : chaque milliseconde gagnée permet plus de crawl

- Structurer le maillage interne pour prioriser les pages stratégiques

- Surveiller la Search Console : section Statistiques d'exploration pour détecter les anomalies

Quelles erreurs éviter absolument ?

Erreur classique : mettre en noindex des sections entières « pour économiser du crawl budget ». Google va quand même les vérifier périodiquement. Mieux vaut un robots.txt propre.

Autre piège : croire qu'un site de 9 000 URLs est « safe » et négliger l'architecture. Si ces 9 000 pages sont à 5 clics de profondeur moyenne, le crawl sera inefficace même sous le seuil.

Enfin, ignorer la vélocité. Un site qui publie 200 nouvelles pages par semaine avec 8 000 URLs totales a un profil de crawl différent d'un site statique — la déclaration de Mueller ne fait pas cette distinction.

La gestion du crawl budget reste pertinente même sous 10 000 URLs si votre architecture est complexe ou votre rythme de publication élevé. L'optimisation fine de ces aspects — audit de qualité des URLs, hiérarchisation du maillage interne, surveillance des patterns de crawl — demande une expertise technique pointue.

Pour les sites approchant ce seuil ou présentant une architecture e-commerce complexe, l'accompagnement par une agence SEO spécialisée permet d'identifier rapidement les goulots d'étranglement et d'implémenter les bonnes pratiques sans perdre de temps en tâtonnements.

❓ Questions frequentes

Un site de 12 000 URLs doit-il forcément s'inquiéter du crawl budget ?

Vaut-il mieux bloquer en robots.txt ou mettre en noindex les pages inutiles ?

Comment savoir si Google crawle efficacement mon site de 8 000 pages ?

Les pages en noindex comptent-elles dans le seuil des 10 000 URLs ?

Cette règle s'applique-t-elle aussi aux sites JavaScript lourds ?

🎥 De la même vidéo 18

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 24/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.