Declaration officielle

Autres déclarations de cette vidéo 18 ▾

- □ Peut-on vraiment montrer du contenu payant structuré uniquement à Googlebot sans risque de pénalité ?

- □ Le DMCA s'applique-t-il vraiment page par page ou peut-on signaler un site entier ?

- □ Google indexe-t-il vraiment tout le contenu que vous publiez ?

- □ Une page AMP invalide peut-elle quand même être indexée par Google ?

- □ Safe Search peut-il empêcher votre site adulte de ranker sur votre propre marque ?

- □ Le Product Reviews Update peut-il impacter votre site même s'il n'est pas en anglais ?

- □ Géociblage ou hreflang : quelle méthode privilégier pour les contenus multilingues ?

- □ Google peut-il choisir arbitrairement quelle version linguistique indexer quand le contenu est identique ?

- □ Faut-il abandonner l'injection dynamique de mots-clés pour éviter les pénalités Google ?

- □ Le client-side rendering React pose-t-il vraiment un problème de classement pour Google ?

- □ Faut-il vraiment bloquer toutes les URLs de recherche interne dans robots.txt ?

- □ Les sites SEO sont-ils vraiment exemptés des critères YMYL ?

- □ Google pénalise-t-il les breadcrumbs structurés invisibles ou trompeurs ?

- □ Peut-on vraiment lier plusieurs sites dans le footer sans risque SEO ?

- □ Faut-il vraiment traduire l'intégralité d'un site multilingue pour bien se positionner ?

- □ Faut-il vraiment s'inquiéter du crawl budget sur un site de moins de 10 000 URLs ?

- □ Robots.txt ou noindex : lequel choisir pour bloquer l'indexation ?

- □ Le trafic artificiel influence-t-il vraiment le classement Google ?

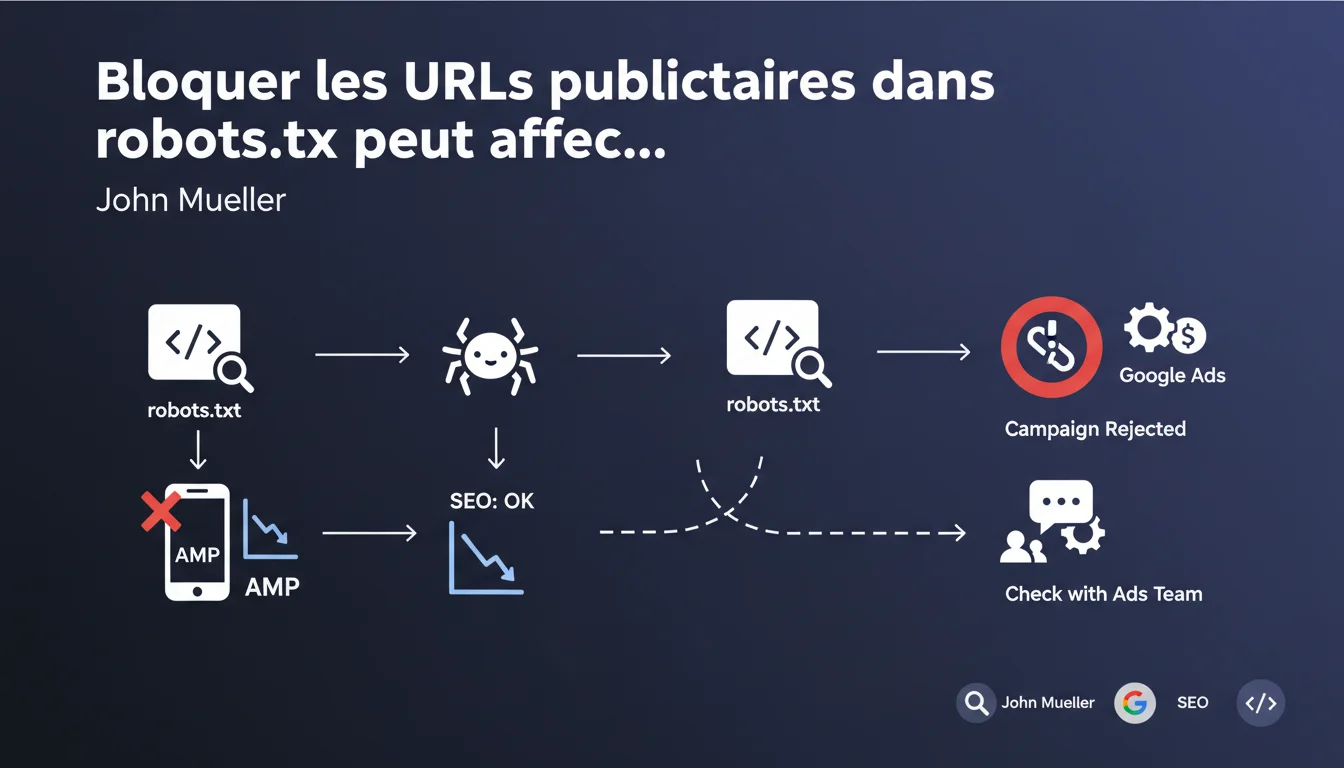

Bloquer les paramètres publicitaires dans robots.txt pour Googlebot est techniquement acceptable côté SEO, mais peut faire échouer vos campagnes Google Ads. Le problème : Ads a besoin d'accéder aux URLs de destination pour valider les annonces. Avant de bloquer quoi que ce soit, coordonnez-vous avec l'équipe qui gère la régie.

Ce qu'il faut comprendre

Pourquoi ce conflit entre SEO et Google Ads existe-t-il ?

La logique SEO classique pousse à bloquer les paramètres d'URL inutiles pour éviter le duplicate content et préserver le crawl budget. Les paramètres publicitaires (utm_source, gclid, etc.) créent des variations d'URL qui pointent vers le même contenu — exactement ce qu'on veut éviter.

Le hic ? Google Ads a besoin de crawler ces URLs avec paramètres pour vérifier que la landing page correspond bien à l'annonce. Si Googlebot est bloqué, le système Ads ne peut pas valider la campagne. Résultat : refus automatique.

Qu'est-ce que Google recommande concrètement ?

Mueller reste délibérément flou sur la marche à suivre. Il dit que c'est "techniquement acceptable" côté SEO, mais renvoie vers l'équipe Ads pour les implications. Traduction : débrouillez-vous entre services.

Aucune mention de méthode alternative (canonical, parameter handling dans Search Console). C'est précisément ce type d'évasion qui complique la vie des praticiens.

Quels sont les points essentiels à retenir ?

- Bloquer les paramètres publicitaires dans robots.txt n'est pas une erreur SEO en soi

- Cette pratique peut empêcher la validation des campagnes Ads

- Google ne propose pas de solution technique unifiée — c'est un arbitrage interne à faire

- La coordination entre SEO et équipes média devient indispensable

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment la réalité terrain ?

Oui, et c'est justement le problème. On observe régulièrement des campagnes Ads refusées sur des sites qui ont blindé leur robots.txt. Mais Mueller passe sous silence une évidence : la plupart des sites gèrent ça avec la balise canonical, pas avec robots.txt.

Bloquer dans robots.txt est la solution la plus brutale. Les alternatives existent : canonical vers la version propre, parameter handling, noindex sur les variations. Mueller n'en parle pas, ce qui rend sa déclaration étrangement incomplète [À vérifier].

Quelle nuance faut-il apporter à cette recommandation ?

La vraie question n'est pas "peut-on bloquer" mais "doit-on bloquer". Si votre site génère des milliers de variations d'URL via les paramètres publicitaires, oui, c'est un problème de crawl budget. Mais pour 90% des sites, l'impact est marginal.

Soyons honnêtes : cette histoire de coordination avec l'équipe Ads, c'est du wishful thinking. Dans les grandes structures, ces équipes ne se parlent pas. Dans les petites, c'est souvent la même personne qui gère les deux et qui doit arbitrer seule.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si vous utilisez exclusivement la balise canonical pour gérer les paramètres, vous laissez Googlebot crawler les variations tout en indiquant la version préférentielle. Ads peut valider, SEO reste propre. Le problème est résolu.

Impact pratique et recommandations

Que faut-il vérifier en priorité sur votre site ?

Listez tous les paramètres d'URL liés à la publicité : utm_*, gclid, fbclid, etc. Vérifiez s'ils sont bloqués dans robots.txt ou gérés via canonical. Testez une URL avec paramètres dans l'outil d'inspection de Search Console pour voir si Googlebot y accède.

Côté Ads, regardez les historiques de refus de campagne. Si des annonces ont été rejetées pour "destination non accessible", c'est probablement lié. Reproduisez le test en soumettant une URL avec paramètres à l'outil de validation Ads.

Quelle est la meilleure stratégie technique ?

Privilégiez la balise canonical plutôt que robots.txt. Elle laisse Googlebot crawler les variations (Ads est content) tout en consolidant le signal SEO sur la version propre (SEO est content). C'est l'arbitrage le plus propre.

Si vous avez vraiment besoin de bloquer dans robots.txt (crawl budget critique), créez une exception spécifique pour les URLs de campagnes Ads. Utilisez Allow: avant Disallow: pour autoriser les patterns précis dont Ads a besoin.

Comment éviter les erreurs fréquentes ?

- Ne bloquez jamais les paramètres publicitaires sans avoir testé l'impact sur les campagnes actives

- Documentez la gestion des paramètres dans un guide interne accessible aux équipes SEO et Ads

- Utilisez Search Console pour monitorer les URLs bloquées et vérifier qu'aucune landing page Ads n'est concernée

- Configurez des alertes sur les refus de campagnes Ads liés à l'accessibilité des URLs

- Privilégiez canonical + parameter handling plutôt que robots.txt quand c'est possible

❓ Questions frequentes

La balise canonical suffit-elle vraiment à résoudre le problème ?

Peut-on bloquer certains paramètres et pas d'autres dans robots.txt ?

Si je bloque les paramètres utm_* dans robots.txt, mes campagnes Ads sont-elles forcément refusées ?

Google Search Console permet-il de gérer les paramètres d'URL sans toucher à robots.txt ?

Faut-il vraiment coordonner avec l'équipe Ads avant chaque modification de robots.txt ?

🎥 De la même vidéo 18

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 24/12/2021

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.