Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google indexe-t-il vraiment le HTML rendu plutôt que le code source ?

- □ Comment l'outil d'inspection d'URL révèle-t-il la source de découverte de vos pages ?

- □ Google respecte-t-il vraiment votre balise canonical ou décide-t-il seul ?

- □ Comment vérifier efficacement les directives X-Robots dans vos en-têtes HTTP ?

- □ Les ressources JavaScript bloquées par robots.txt sabotent-elles vraiment votre indexation ?

- □ Faut-il vraiment s'inquiéter des erreurs de ressources dans la Search Console ?

- □ Les messages console JavaScript sont-ils devenus un signal SEO à surveiller ?

- □ Faut-il vraiment ignorer les captures d'écran dans les outils de test de Google ?

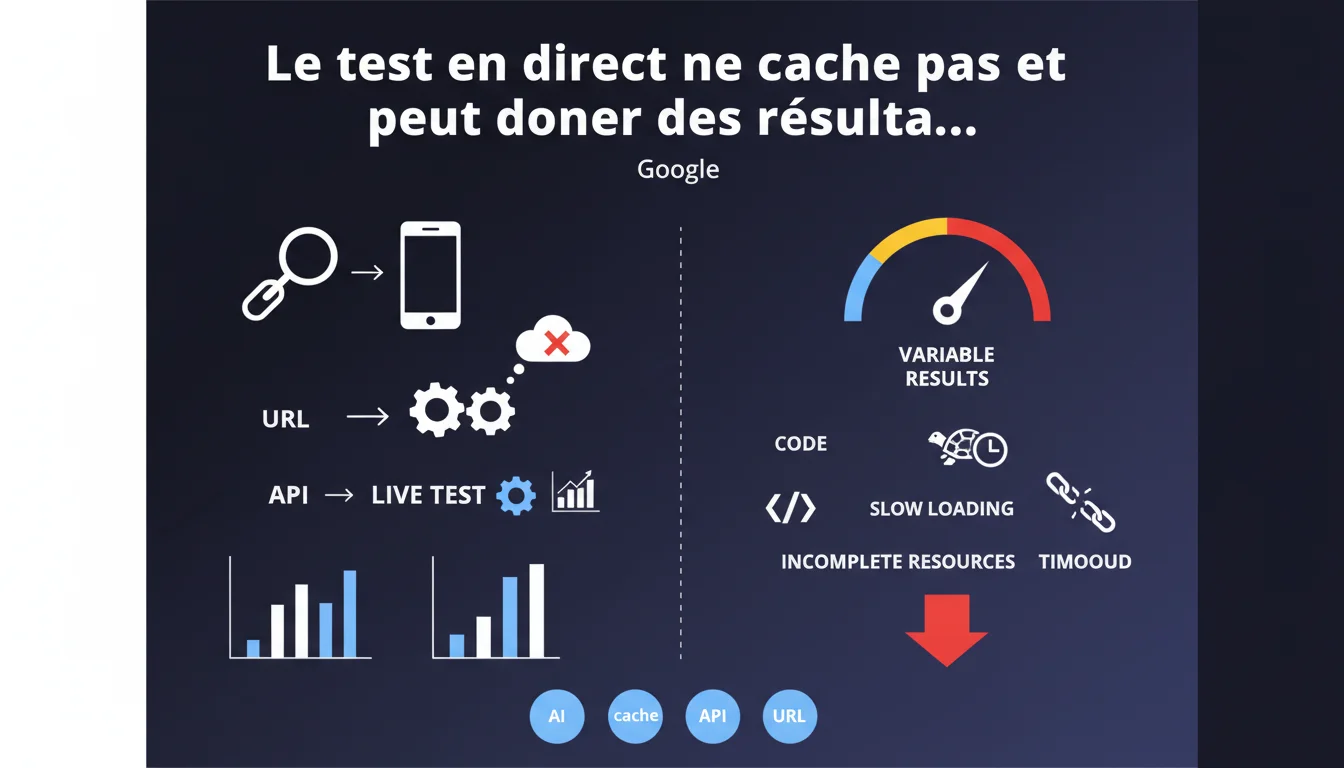

Le test d'URL en direct de Google Search Console ne s'appuie sur aucun cache et impose un délai maximal pour charger les ressources. Résultat : certaines ressources ne finissent pas de se charger à temps, ce qui entraîne des variations entre chaque exécution. C'est un outil de diagnostic, pas une réplique exacte de l'indexation réelle.

Ce qu'il faut comprendre

Le test en direct fonctionne-t-il exactement comme Googlebot lors du crawl ?

Non, et c'est crucial à comprendre. Le test d'URL en direct dans la Google Search Console ne simule pas totalement le comportement de Googlebot en production. Il effectue un fetch immédiat sans utiliser de cache, contrairement au processus d'indexation classique où Google peut s'appuyer sur des ressources déjà mises en cache.

Googlebot en conditions réelles dispose de plus de temps et de plusieurs tentatives pour charger les ressources — CSS, JavaScript, images, polices. Le test en direct, lui, impose une limite de temps stricte. Si une ressource met trop longtemps à répondre, elle est simplement ignorée dans les résultats du test.

Pourquoi les résultats varient-ils d'une exécution à l'autre ?

Chaque lancement du test déclenche un nouveau fetch sans antécédent. Les conditions réseau, la charge serveur, la latence des CDN — tout ça fluctue. Une ressource hébergée sur un serveur lent ou géolocalisé loin de Googlebot peut parfois répondre à temps, parfois non.

C'est particulièrement visible sur les sites qui font appel à de multiples domaines tiers : analytics, fonts, widgets sociaux, scripts publicitaires. Une variation de quelques millisecondes sur un seul domaine suffit à changer le rendu final perçu par le test.

Quelles sont les implications pratiques de cette limite temporelle ?

Si le test en direct indique qu'une page est non indexable ou présente un problème de rendu, ça ne signifie pas forcément que Googlebot rencontre systématiquement le même souci. L'indexation réelle bénéficie de plus de souplesse — plusieurs tentatives, cache des ressources, logique de retry.

Inversement, un test réussi ne garantit pas que tout sera parfait en production. La disponibilité serveur, la vitesse de réponse sous charge réelle, les variations géographiques — autant de facteurs que le test ne peut pas reproduire fidèlement.

- Le test en direct ne s'appuie sur aucun cache, contrairement au crawl réel de Googlebot.

- Les délais de chargement sont plus courts dans le test que lors d'un crawl classique en production.

- Des ressources tierces lentes (fonts, scripts analytics, CDN) peuvent ne pas finir de se charger à temps.

- Les variations d'un test à l'autre reflètent des fluctuations réseau normales, pas des bugs de l'outil.

- Un échec au test en direct n'implique pas forcément un problème d'indexation réelle — et vice-versa.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. On constate régulièrement des incohérences entre le test en direct et la réalité du rendu indexé visible dans le cache Google. Une page peut échouer au test mais s'indexer correctement — et l'inverse arrive aussi.

Le problème, c'est que beaucoup de SEO utilisent cet outil comme un oracle. Ils lancent le test une fois, voient un message d'erreur et paniquent. Google confirme ici ce qu'on soupçonnait : cet outil est un instantané sous contraintes, pas une vérité absolue.

Quelles nuances faut-il apporter à cette annonce ?

Google ne précise pas quelle est la tolérance temporelle exacte du test. Combien de secondes avant qu'une ressource soit abandonnée ? Aucune donnée officielle. [À vérifier] sur la base d'observations empiriques — certains parlent de 5 secondes, d'autres de 10, rien de confirmé.

Autre point flou : Google dit que « certaines ressources ne finissent pas de se charger assez rapidement ». Lesquelles précisément ? Les scripts tiers ? Les CSS critiques ? Les polices web ? Si une ressource critique pour le rendu above-the-fold échoue, l'impact n'est pas le même qu'un widget social en fin de page.

Soyons honnêtes — cette déclaration reste évasive sur les détails qui importent vraiment aux praticiens. On aurait aimé des seuils chiffrés, une liste de priorités de chargement, une hiérarchie des ressources. Rien de tout ça.

Dans quels cas cette variabilité devient-elle problématique ?

Quand vous auditez un site avec des dizaines de milliers de pages et que vous vous appuyez sur le test en direct pour diagnostiquer des problèmes d'indexation. Si l'outil donne des résultats aléatoires, votre audit perd en fiabilité.

C'est particulièrement vrai pour les sites e-commerce ou médias qui dépendent massivement de JavaScript côté client. Une variation de timing peut transformer une page parfaitement rendue en coquille vide. Le risque : prendre des décisions d'optimisation sur la base de faux positifs — ou négliger de vrais problèmes parce qu'un test ponctuel est passé.

cache:URL), croisez avec les logs serveur et les données de crawl. La convergence de plusieurs sources est la seule manière fiable de trancher.Impact pratique et recommandations

Que faut-il faire concrètement pour limiter ces variations ?

Optimisez la vitesse de réponse serveur. Plus votre TTFB (Time To First Byte) est rapide, plus vous laissez de marge au test pour charger les ressources secondaires. Visez un TTFB sous 200 ms si possible.

Réduisez le nombre de domaines tiers. Chaque domaine externe (analytics, fonts, CDN) introduit une latence DNS et un risque de timeout. Hébergez en local les ressources critiques — polices, CSS essentiels, scripts de rendu.

Activez un CDN performant avec une couverture géographique large. Si Googlebot fetch depuis un datacenter éloigné de votre serveur origine, la latence peut exploser. Un CDN réduit mécaniquement ce risque.

Comment interpréter correctement un résultat de test en direct ?

Lancez le test au moins trois fois avant de tirer une conclusion. Si les trois résultats convergent, vous avez probablement un diagnostic fiable. Si les résultats varient, c'est le signe d'un problème de performance ou de disponibilité réseau — pas forcément d'indexabilité.

Comparez systématiquement avec le cache Google officiel (cache:votreurl.com). Si la page est indexée et correctement rendue dans le cache, mais échoue au test en direct, le problème est probablement du côté de l'outil, pas de votre site.

Utilisez les logs serveur pour tracer les requêtes de Googlebot réel. Si Googlebot crawle et indexe sans erreur dans les logs, mais que le test en direct échoue, faites confiance aux logs.

Quelles erreurs éviter dans l'interprétation des résultats ?

Ne paniquez pas sur un seul échec de test. Google le dit clairement : les résultats peuvent varier. Un échec isolé ne justifie pas une refonte complète de votre architecture de rendu.

Ne confondez pas « ressource non chargée dans le test » et « ressource non chargée par Googlebot en production ». Le test est plus strict, plus rapide, moins tolérant. Googlebot en production dispose de mécanismes de retry et de cache que le test n'a pas.

Évitez de suroptimiser pour le test en direct au détriment de l'expérience utilisateur. Si vous éliminez toutes les ressources tierces juste pour satisfaire l'outil, vous risquez de dégrader la fonctionnalité réelle de vos pages.

- Lancer le test d'URL en direct au moins trois fois pour détecter des variations.

- Comparer systématiquement avec le cache Google officiel (

cache:URL). - Croiser les résultats du test avec les logs serveur Googlebot.

- Optimiser le TTFB serveur en-dessous de 200 ms si possible.

- Réduire le nombre de domaines tiers et héberger les ressources critiques localement.

- Utiliser un CDN performant avec couverture géographique large.

- Ne jamais diagnostiquer un problème d'indexation sur un seul résultat de test.

- Surveiller la disponibilité et la latence des ressources tierces critiques (fonts, CSS, JS de rendu).

❓ Questions frequentes

Le test en direct utilise-t-il le même cache que Googlebot en production ?

Combien de fois faut-il lancer le test pour avoir un résultat fiable ?

Une page peut-elle s'indexer correctement même si le test en direct échoue ?

Quelles ressources sont les plus susceptibles de ne pas finir de se charger à temps ?

Comment vérifier si une variation de résultat est grave ou anodine ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 02/08/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.