Declaration officielle

Autres déclarations de cette vidéo 19 ▾

- □ Google indexe-t-il vraiment toutes les langues de la même manière ?

- □ Les liens nofollow et balises noindex nuisent-ils à votre référencement ?

- □ Les erreurs 404 pénalisent-elles vraiment le classement de votre site ?

- □ Faut-il vraiment rediriger toutes les pages 404 pour améliorer son SEO ?

- □ La vitesse de votre CDN d'images pénalise-t-elle vraiment votre référencement dans Google Images ?

- □ Peut-on réinitialiser les données Search Console d'un site repris ?

- □ Les sous-domaines régionaux suffisent-ils à cibler un marché géographique ?

- □ Pourquoi vos rich results affichent-ils la mauvaise devise et comment y remédier ?

- □ La transcription vidéo est-elle considérée comme du contenu dupliqué par Google ?

- □ Pourquoi Google refuse-t-il les avis agrégés dans les données structurées produit ?

- □ Google crawle-t-il les variations d'URL sans liens internes ou backlinks ?

- □ Pourquoi Googlebot persiste-t-il à crawler des pages 404 après leur suppression ?

- □ Le ratio texte/code est-il vraiment un facteur de classement Google ?

- □ Les paramètres UTM avec medium=referral tuent-ils vraiment la valeur SEO d'un backlink ?

- □ Faut-il absolument répondre aux commentaires de blog pour le SEO ?

- □ Faut-il vraiment s'inquiéter de l'absence de balises X-Robots-Tag et meta robots ?

- □ Pourquoi les redirections Geo IP automatiques sabotent-elles votre SEO international ?

- □ Modifier ses balises title et meta description peut-il vraiment faire bouger son classement Google ?

- □ Les liens ou le trafic de mauvaise qualité peuvent-ils nuire à la réputation de votre site ?

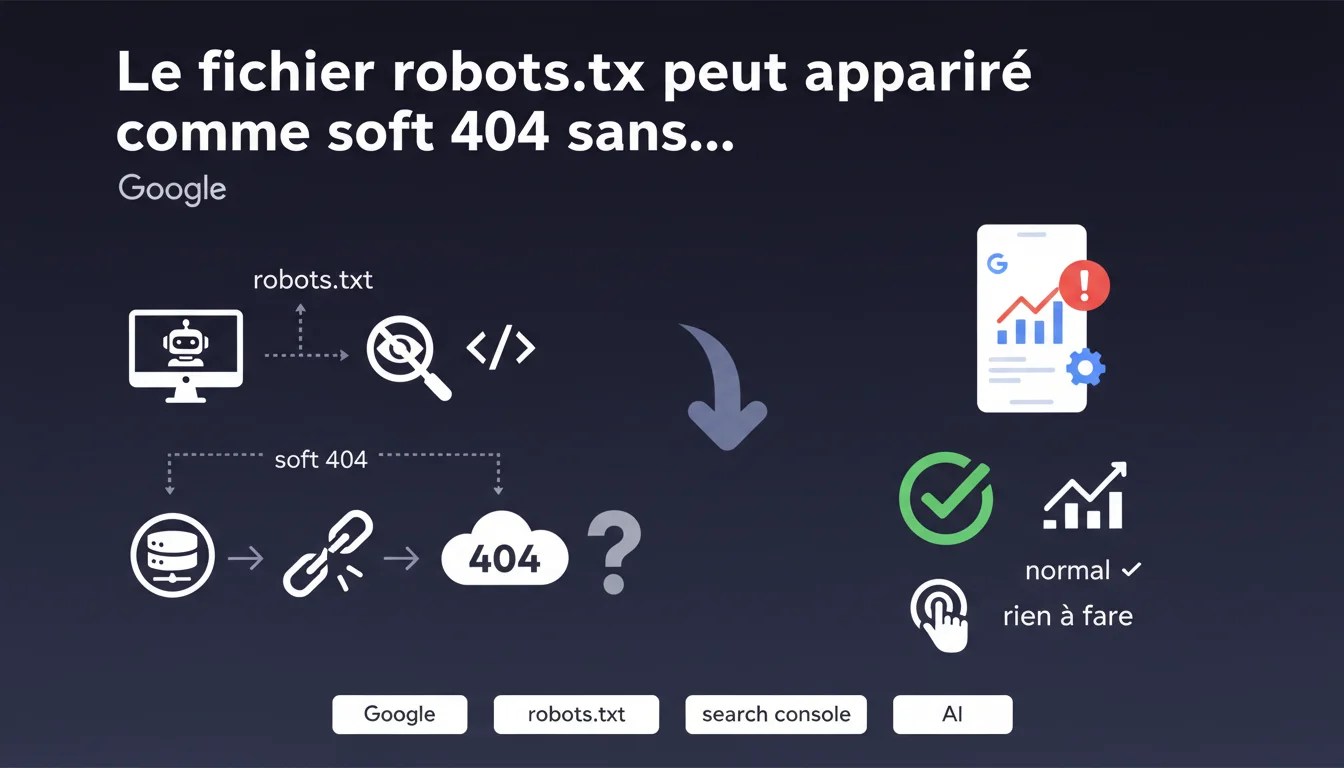

Google confirme qu'un fichier robots.txt signalé comme soft 404 dans Search Console n'est pas un problème. Ce fichier technique n'a généralement aucune raison d'être indexé, et cette alerte peut être ignorée sans conséquence sur votre référencement.

Ce qu'il faut comprendre

Pourquoi robots.txt est-il parfois signalé comme soft 404 ?

Le fichier robots.txt est un fichier texte placé à la racine d'un site pour donner des instructions aux robots d'indexation. Google l'explore systématiquement avant de crawler un site, mais n'a aucune raison de l'indexer dans ses résultats de recherche.

Quand Google tente d'indexer robots.txt et ne trouve aucun contenu pertinent pour les utilisateurs, il peut le classer comme soft 404 — c'est-à-dire une page qui renvoie un code 200 mais qui ne contient aucune information utile. Cette situation crée souvent une alerte dans Search Console qui inquiète les propriétaires de sites.

Un soft 404 sur robots.txt impacte-t-il le référencement ?

Non. Absolument aucun impact négatif sur votre crawl budget, votre indexation ou votre positionnement.

Le fichier robots.txt est un fichier de configuration, pas une page de contenu. Son rôle se limite à orienter les robots — il n'est jamais destiné aux internautes. Google le comprend parfaitement et cette alerte relève davantage d'un effet de bord technique qu'un véritable problème à résoudre.

Que faire concrètement quand cette alerte apparaît ?

Rien. C'est la réponse officielle de Google et elle est cohérente avec la fonction même du fichier.

Vous pouvez vérifier que votre robots.txt contient bien des directives valides et qu'il est accessible, mais il n'y a aucune action corrective à entreprendre pour cette alerte spécifique. Chercher à « corriger » ce soft 404 serait une perte de temps.

- Le fichier robots.txt n'a pas vocation à être indexé dans les résultats de recherche

- Un signalement soft 404 sur ce fichier est normal et sans conséquence

- Google crawle robots.txt avant chaque session de crawl, indépendamment de son statut d'indexation

- Aucune action corrective n'est nécessaire pour cette alerte dans Search Console

- Le comportement de Google reste identique que robots.txt soit signalé soft 404 ou non

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Totalement. On observe depuis longtemps que les fichiers robots.txt génèrent ces alertes sans aucune répercussion mesurable sur les performances SEO. Les sites concernés continuent d'être crawlés et indexés normalement.

Ce qui est intéressant — et Google ne le dit pas — c'est que cette alerte révèle un petit angle mort dans la logique de Search Console. L'outil traite robots.txt comme n'importe quelle URL explorée, alors qu'il mériterait une catégorie à part. Mais corriger ce détail technique n'apporterait aucune valeur pratique.

Dans quels cas faut-il quand même vérifier son robots.txt ?

Si vous recevez cette alerte, profitez-en pour faire un contrôle de routine — pas pour corriger le soft 404, mais pour vous assurer que vos directives sont toujours pertinentes.

Vérifiez notamment que vous ne bloquez pas accidentellement des sections importantes de votre site, que vos sitemaps sont bien déclarés, et que la syntaxe est propre. L'alerte elle-même est inoffensive, mais elle peut servir de rappel pour un audit basique.

Google pourrait-il changer de position sur ce point ?

Peu probable. La nature même du fichier robots.txt ne changera pas, et son rôle non plus. [À vérifier] dans le cas où Google déciderait un jour de filtrer complètement ces alertes de Search Console pour éviter toute confusion — mais cela relève plus de l'amélioration UX de l'outil que d'un changement de politique SEO.

En pratique, cette déclaration formalise simplement ce que tout professionnel expérimenté savait déjà : robots.txt n'est pas une page de contenu, son indexation est hors sujet, et l'alerte peut être ignorée en toute sérénité.

Impact pratique et recommandations

Que faire concrètement quand cette alerte apparaît dans Search Console ?

Première étape : ignorez l'alerte. Ne perdez pas de temps à chercher une solution technique pour « corriger » ce soft 404. Google vous dit explicitement qu'il n'y a rien à corriger.

Deuxième étape : vérifiez malgré tout que votre fichier robots.txt est accessible et contient des directives valides. Tapez votredomaine.com/robots.txt dans un navigateur et assurez-vous qu'il se charge sans erreur 404 réelle.

Quelles erreurs éviter dans la gestion de robots.txt ?

Ne tentez pas de forcer l'indexation de robots.txt avec une balise meta robots ou un sitemap. Ce serait contre-productif et inutile.

N'ajoutez pas de contenu HTML ou de texte marketing dans votre robots.txt pour « enrichir » la page — cela ne résoudra rien et pourrait perturber les crawlers. Le fichier doit rester un fichier technique pur.

Évitez également de désactiver complètement robots.txt pensant que cela supprimera l'alerte. Sans ce fichier, Google assume que tout est crawlable — ce qui peut poser problème si vous avez besoin de bloquer certaines sections.

Comment auditer correctement son fichier robots.txt ?

Utilisez l'outil de test robots.txt dans Search Console pour vérifier que vos directives fonctionnent comme prévu. Testez quelques URLs critiques pour confirmer qu'elles ne sont pas bloquées accidentellement.

Vérifiez que vos sitemaps XML sont bien déclarés dans le fichier avec la directive Sitemap:. C'est une bonne pratique qui facilite la découverte de vos contenus par Google.

- Vérifier que robots.txt est accessible à l'URL racine de votre domaine

- Confirmer que les directives Disallow ne bloquent pas de sections importantes

- S'assurer que les sitemaps XML sont déclarés dans le fichier

- Tester quelques URLs stratégiques avec l'outil Search Console

- Ignorer l'alerte soft 404 spécifique à robots.txt sans action corrective

- Profiter de l'occasion pour faire un audit général des règles de crawl

❓ Questions frequentes

Dois-je corriger le soft 404 sur mon fichier robots.txt ?

Le soft 404 sur robots.txt affecte-t-il mon crawl budget ?

Pourquoi Google génère-t-il cette alerte si ce n'est pas un problème ?

Mon robots.txt doit-il renvoyer un code 200 ou 404 ?

Peut-on bloquer l'accès à robots.txt dans robots.txt lui-même ?

🎥 De la même vidéo 19

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.