Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Google vérifie-t-il réellement l'expérience utilisateur au-delà des codes HTTP ?

- □ Pourquoi Google veut-il détecter les incidents avant que vous ne les signaliez ?

- □ Comment Google gère-t-il les pics de trafic sans pénaliser le référencement ?

- □ Pourquoi Google traite-t-il certaines requêtes à moindre coût que d'autres ?

- □ Comment Google provisionne-t-il ses ressources serveur pour les pics de trafic prévisibles ?

- □ Google peut-il réellement voler des ressources à l'indexation pour stabiliser son moteur de recherche ?

- □ Comment Google gère-t-il les incidents de ranking avec des mitigations rapides ?

- □ Pourquoi Google coupe-t-il brutalement certains data centers en cas d'incident ?

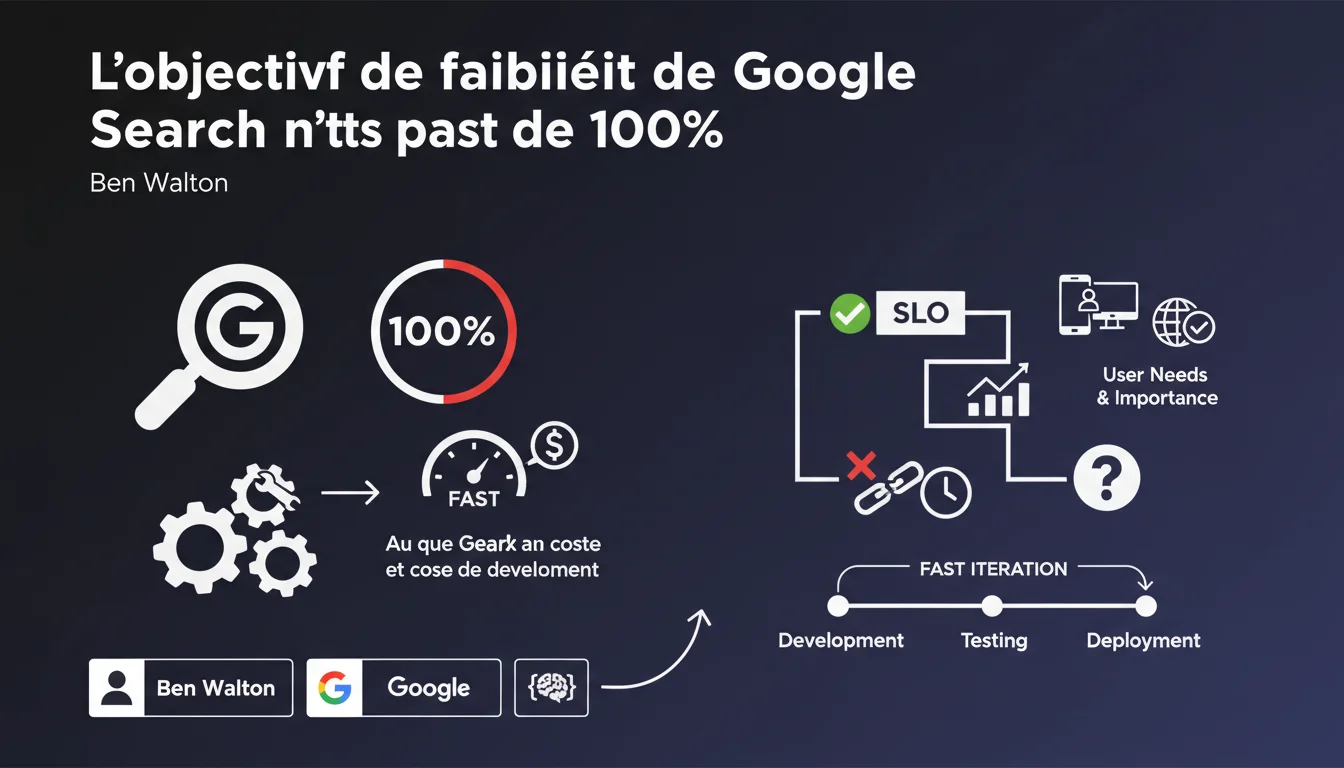

Google assume délibérément un niveau de fiabilité inférieur à 100% pour Search. L'équipe SRE fixe des objectifs de fiabilité (SLO) basés sur un arbitrage coût/bénéfice, considérant qu'une fiabilité maximale ralentirait trop le développement et coûterait trop cher par rapport aux besoins réels des utilisateurs.

Ce qu'il faut comprendre

Que signifie concrètement « ne pas viser 100% de fiabilité » ?

Google utilise des Service Level Objectives (SLO), des seuils de performance que l'équipe SRE (Site Reliability Engineering) définit pour chaque produit. Pour Search, cela signifie qu'un certain pourcentage de pannes, de bugs ou d'incidents est toléré par design.

Viser une fiabilité absolue impliquerait des investissements massifs en infrastructure redondante, des cycles de tests rallongés et une vélocité de déploiement drastiquement réduite. Google préfère itérer rapidement, même si cela implique des micro-incidents occasionnels.

Comment Google détermine-t-il le niveau de fiabilité acceptable ?

L'arbitrage repose sur trois critères : les besoins utilisateurs réels, l'importance stratégique du service, et le coût marginal d'amélioration de chaque point de pourcentage supplémentaire.

Un SLO à 99,9% signifie environ 8h40 de downtime par an — acceptable pour Search. Passer à 99,99% réduirait ce downtime à 52 minutes, mais demanderait peut-être 10 fois plus de ressources pour un gain minime sur l'expérience utilisateur globale.

Quelles implications pour le référencement au quotidien ?

Cette politique explique pourquoi vous observez des fluctuations sans explication, des bugs temporaires d'indexation ou des écarts entre Search Console et la réalité. Ce ne sont pas nécessairement des dysfonctionnements critiques — c'est le fonctionnement normal dans la marge d'erreur tolérée.

- Google accepte un taux d'erreur planifié sur Search plutôt que de garantir une fiabilité absolue

- Les SLO varient selon l'importance stratégique de chaque fonctionnalité du moteur

- Cette approche privilégie la rapidité d'évolution du produit au détriment de la perfection technique

- Les incidents mineurs font partie du fonctionnement normal, pas d'exceptions critiques

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Totalement. Les professionnels SEO constatent régulièrement des anomalies inexpliquées : positions qui fluctuent sans raison apparente, pages indexées puis désindexées en 24h, données Search Console incohérentes avec les logs serveur.

Ce que Google officialise ici, c'est que ces bugs font partie du contrat implicite. Sauf que — et c'est là que ça coince — aucune transparence sur les SLO de Search n'est fournie. On ne sait pas quel taux d'erreur est « acceptable » selon Google, ni quelles fonctionnalités ont des SLO plus stricts.

Quelles sont les zones d'ombre de cette déclaration ?

[À vérifier] La notion de « besoins des utilisateurs » reste floue. Google détermine-t-il ces besoins via des études qualitatives, des métriques quantitatives, ou simplement des hypothèses internes ? Aucune donnée publique là-dessus.

Autre point opaque : comment les SLO sont-ils répartis entre les différentes briques de Search ? L'indexation a-t-elle le même objectif de fiabilité que le ranking ? Que les featured snippets ? [À vérifier] probablement non, mais Google ne donne aucun chiffre.

Dans quels cas cette logique ne s'applique-t-elle pas ?

Les pénalités manuelles et les actions critiques (désindexation pour spam, copyright, etc.) ont probablement des SLO beaucoup plus stricts. Google ne peut pas se permettre de bannir des sites légitimes par erreur dans « 0,1% des cas ».

De même, les fonctionnalités sensibles — résultats médicaux, financiers, YMYL en général — devraient théoriquement avoir des exigences de fiabilité supérieures. Mais là encore, aucune donnée publique.

Impact pratique et recommandations

Que faut-il faire concrètement face à cette réalité ?

Acceptez que votre site subira des micro-incidents sans explication. Une page qui disparaît de l'index pendant 48h puis revient ? C'est peut-être juste un bug dans la marge tolérée par Google, pas forcément une pénalité.

Côté monitoring, multiplier les sources de vérité devient indispensable. Ne vous fiez pas uniquement à Search Console : croisez avec vos logs serveur, des outils tiers (Screaming Frog, OnCrawl, Botify), et vos analytics. Si Search Console dit « 0 pages indexées » mais que vos logs montrent Googlebot qui crawle normalement, c'est probablement un bug d'affichage GSC.

Quelles erreurs éviter dans ce contexte ?

Ne paniquez pas au premier bug. Avant de refondre votre site parce qu'une anomalie apparaît dans GSC, attendez 72h minimum pour voir si ça se corrige tout seul — souvent, c'est le cas.

Évitez aussi de sur-optimiser pour compenser des bugs perçus. Si vos positions fluctuent de ±3 places chaque jour sans raison, ce n'est probablement pas un signal que votre contenu est insuffisant — c'est juste du bruit dans le système.

- Mettez en place un monitoring multi-sources pour détecter les vrais problèmes versus les bugs temporaires

- Documentez systématiquement les anomalies avec timestamps et captures d'écran

- Définissez des seuils d'alerte raisonnables (ex : alerter seulement si une anomalie persiste 72h+)

- Ne modifiez jamais votre site en réaction immédiate à un bug Search Console sans confirmation externe

- Archivez vos logs serveur sur au moins 6 mois pour pouvoir remonter en cas de litige

❓ Questions frequentes

Quel est le SLO exact de Google Search ?

Les bugs d'indexation que je constate sont-ils normaux ou critiques ?

Google peut-il invoquer ce SLO pour ignorer mes signalements de bugs ?

Les pénalités manuelles sont-elles aussi soumises à ce taux d'erreur ?

Comment savoir si une fluctuation de ranking est un bug ou un vrai changement algorithmique ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/10/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.