Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Pourquoi Google refuse-t-il de viser 100% de fiabilité pour son moteur de recherche ?

- □ Pourquoi Google veut-il détecter les incidents avant que vous ne les signaliez ?

- □ Comment Google gère-t-il les pics de trafic sans pénaliser le référencement ?

- □ Pourquoi Google traite-t-il certaines requêtes à moindre coût que d'autres ?

- □ Comment Google provisionne-t-il ses ressources serveur pour les pics de trafic prévisibles ?

- □ Google peut-il réellement voler des ressources à l'indexation pour stabiliser son moteur de recherche ?

- □ Comment Google gère-t-il les incidents de ranking avec des mitigations rapides ?

- □ Pourquoi Google coupe-t-il brutalement certains data centers en cas d'incident ?

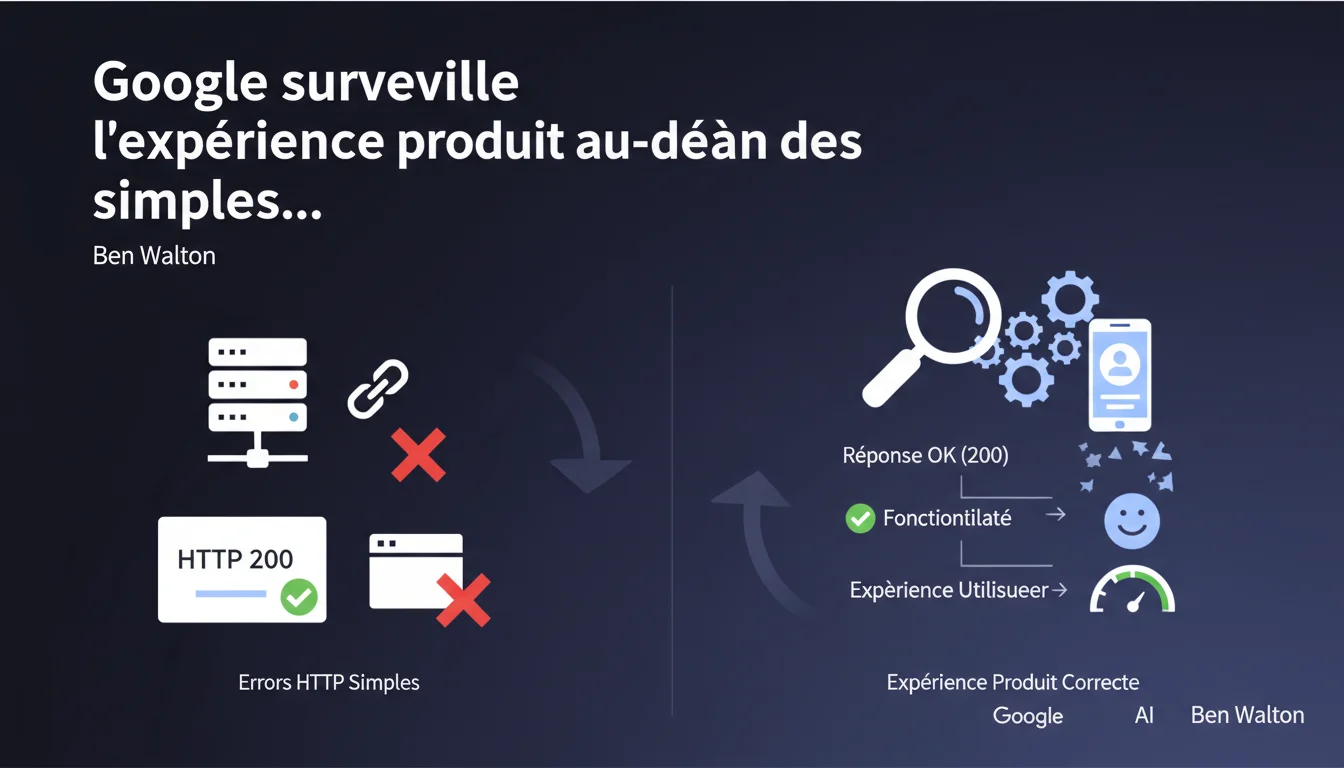

Google ne se contente plus de vérifier que votre serveur renvoie un code 200. L'équipe SRE surveille désormais si ce qui est effectivement livré à l'utilisateur fonctionne correctement — une évolution majeure qui remet en question les pratiques de monitoring classiques en SEO. Concrètement, un statut HTTP propre ne suffit plus.

Ce qu'il faut comprendre

Qu'est-ce que cela change par rapport aux pratiques de monitoring traditionnelles ?

Historiquement, les SEO surveillaient avant tout les codes de statut HTTP : un 200 signifiait que la page était accessible, un 404 qu'elle était introuvable, un 503 qu'il y avait un problème serveur. Google communiquait d'ailleurs principalement sur ces métriques dans la Search Console.

Mais la réalité terrain a toujours été plus complexe. Une page peut renvoyer un 200 parfait tout en affichant du contenu cassé, un JavaScript qui plante, des ressources critiques bloquées ou un visuel complètement décalé. L'utilisateur voit une page inutilisable — et c'est précisément ce que Google surveille maintenant de manière systématique.

Comment Google peut-il techniquement vérifier que l'expérience fonctionne ?

La déclaration mentionne l'équipe SRE (Site Reliability Engineering), ce qui indique une approche d'ingénierie système avancée. Concrètement, cela signifie que Google ne se limite pas à un simple crawl HTTP.

L'algorithme évalue probablement le rendu complet de la page, l'exécution JavaScript, la disponibilité des ressources critiques, et potentiellement des signaux comme les Core Web Vitals collectés via Chrome. C'est une surveillance multi-niveaux qui dépasse largement le simple ping serveur.

Cette approche est-elle nouvelle ou juste officialisée ?

La déclaration précise que cette évolution s'est développée ces 5 dernières années — donc depuis environ 2019-2020. Ce n'est pas une annonce de rupture mais la formalisation d'une pratique déjà en place.

Beaucoup de SEO observent depuis longtemps que des pages avec un statut HTTP propre peuvent sous-performer si l'expérience réelle est dégradée. Ce que Google fait ici, c'est confirmer officiellement ce que le terrain suggérait déjà : le moteur va bien au-delà des signaux serveur basiques.

- Google ne se limite plus aux codes HTTP traditionnels pour évaluer la disponibilité d'une page

- L'équipe SRE surveille l'expérience produit complète : rendu, JavaScript, ressources critiques

- Cette approche s'est développée progressivement sur 5 ans, ce n'est pas une nouveauté soudaine

- Un code 200 propre ne garantit plus que Google considère votre page comme réellement fonctionnelle

- Le monitoring SEO classique basé uniquement sur les statuts HTTP est désormais insuffisant

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Soyons honnêtes : oui, complètement. Depuis des années, on observe des situations où des pages techniquement « accessibles » selon les outils classiques ne performent pas dans Google. Des sites avec des temps de chargement catastrophiques, des erreurs JavaScript bloquant le contenu principal, ou des ressources critiques en 404 — tout en renvoyant un joli 200 au crawl.

Ce qui change, c'est que Google formalise publiquement ce que ses algorithmes faisaient déjà de manière implicite. L'équipe SRE mentionnée dans la déclaration suggère une approche ingénierie poussée — mais reste floue sur les critères précis utilisés pour qualifier une expérience de « correcte ».

Quelles zones d'ombre subsistent dans cette déclaration ?

La déclaration est volontairement vague sur les détails techniques. Google dit surveiller « si ce qui est livré à l'utilisateur fonctionne correctement », mais ne définit pas précisément ce que « fonctionne correctement » signifie. [A verifier] Quels seuils ? Quels signaux précis ? Quelle tolérance aux erreurs partielles ?

On peut supposer que les Core Web Vitals, les erreurs JavaScript critiques, les ressources bloquantes et le rendu complet sont dans le scope — mais Google ne le dit pas explicitement ici. Le manque de transparence sur les métriques exactes complique la mise en conformité.

Autre point : Google parle de son équipe interne SRE, mais applique-t-il exactement la même logique au crawl des sites externes ? [A verifier] Il est probable que oui, mais rien dans cette déclaration ne le confirme formellement.

Dans quels cas cette surveillance avancée pourrait-elle poser problème ?

Pour les sites avec des expériences conditionnelles (contenu qui varie selon la géolocalisation, l'authentification, ou le device), cette surveillance pose des questions. Si Google crawle depuis certains points du réseau ou avec certaines configurations, il peut percevoir une expérience dégradée qui n'affecte pas tous les utilisateurs réels.

Les sites avec des progressive enhancements complexes — où une partie de l'expérience dépend de JavaScript non critique — doivent s'assurer que Google ne considère pas ces enrichissements optionnels comme des « dysfonctionnements ». Le risque : qu'une page soit pénalisée pour une erreur JS qui n'affecte qu'un module secondaire.

Impact pratique et recommandations

Que faut-il auditer en priorité sur votre site ?

Premier réflexe : ne vous contentez plus des outils qui vérifient uniquement les codes HTTP. Vous devez désormais auditer l'expérience réelle telle que Google la perçoit — c'est-à-dire le rendu complet avec JavaScript exécuté.

Utilisez des outils comme Google Search Console (section « Expérience sur la page »), PageSpeed Insights, et des solutions de monitoring qui testent le rendu complet — pas juste le temps de réponse serveur. Regardez les Core Web Vitals, les erreurs JavaScript critiques, les ressources bloquées par robots.txt ou en erreur 404.

Vérifiez aussi que votre contenu principal est bien visible au crawl avec JavaScript activé. L'outil « Inspection d'URL » de la Search Console montre la version rendue par Google — comparez-la à ce que vos utilisateurs voient réellement. Si des écarts existent, corrigez-les.

Quelles erreurs éviter absolument ?

Ne présumez jamais qu'un code 200 signifie que Google considère votre page comme fonctionnelle. Une page peut renvoyer un statut propre mais afficher un message d'erreur côté client, un contenu vide suite à une erreur JS, ou un layout complètement cassé.

Évitez aussi de bloquer des ressources critiques via robots.txt — CSS, JavaScript, images essentielles au rendu. Google a besoin de ces éléments pour évaluer si l'expérience fonctionne. Si une ressource critique échoue, même avec un 200 sur le HTML, la page peut être considérée comme dysfonctionnelle.

Attention aux redirections et chargements conditionnels complexes. Si Google perçoit une expérience incohérente ou incomplète lors du crawl, cela peut affecter l'indexation — même si techniquement votre serveur répond correctement.

Comment vérifier que votre site est conforme à cette nouvelle logique ?

Mettez en place un monitoring régulier qui simule le comportement de Googlebot avec JavaScript activé. Des outils comme Screaming Frog (mode rendu JavaScript), Sitebulb, ou des solutions SaaS comme OnCrawl ou Botify permettent d'auditer le rendu complet.

Vérifiez systématiquement les erreurs JavaScript dans la console navigateur — particulièrement celles qui bloquent l'affichage du contenu principal. Une erreur JS qui empêche le rendu d'une section critique peut désormais être perçue par Google comme un dysfonctionnement de la page.

Comparez régulièrement la version HTML brute et la version rendue après JavaScript. Si des éléments essentiels (titres, contenu principal, liens internes) n'apparaissent qu'après exécution JS, assurez-vous que Google les voit bien. Utilisez l'outil « Inspection d'URL » de la Search Console pour valider.

- Auditer le rendu complet de vos pages avec JavaScript activé, pas seulement les codes HTTP

- Vérifier les Core Web Vitals et corriger les pages avec des métriques dégradées

- Identifier et corriger les erreurs JavaScript critiques qui bloquent l'affichage du contenu

- S'assurer que les ressources essentielles (CSS, JS, images) ne sont pas bloquées ni en erreur

- Comparer la version HTML brute avec la version rendue par Google via la Search Console

- Mettre en place un monitoring continu simulant le crawl Googlebot avec JS activé

- Tester les expériences conditionnelles pour vérifier qu'elles ne créent pas d'incohérences au crawl

Cette évolution de Google impose un changement de paradigme dans le monitoring SEO. Les outils traditionnels basés sur les statuts HTTP ne suffisent plus — il faut désormais auditer l'expérience utilisateur complète telle que Google la perçoit.

Cela implique de maîtriser le rendu JavaScript, les Core Web Vitals, la gestion des ressources critiques et le comportement du contenu conditionnel. Pour beaucoup de sites, cette complexité technique nécessite un accompagnement spécialisé — les agences SEO qui maîtrisent ces enjeux de rendu et d'expérience peuvent vous aider à mettre en place une stratégie de monitoring et d'optimisation adaptée à ces nouvelles exigences.

❓ Questions frequentes

Les codes HTTP 200 ne garantissent-ils donc plus l'indexation correcte d'une page ?

Quels outils permettent de voir ce que Google perçoit réellement lors du crawl ?

Les Core Web Vitals font-ils partie de cette surveillance avancée ?

Faut-il arrêter de surveiller les codes HTTP classiques ?

Cette surveillance s'applique-t-elle uniquement aux nouveaux sites ou à tous les sites existants ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/10/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.