Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Pourquoi Google refuse-t-il de viser 100% de fiabilité pour son moteur de recherche ?

- □ Google vérifie-t-il réellement l'expérience utilisateur au-delà des codes HTTP ?

- □ Pourquoi Google veut-il détecter les incidents avant que vous ne les signaliez ?

- □ Comment Google gère-t-il les pics de trafic sans pénaliser le référencement ?

- □ Pourquoi Google traite-t-il certaines requêtes à moindre coût que d'autres ?

- □ Comment Google provisionne-t-il ses ressources serveur pour les pics de trafic prévisibles ?

- □ Comment Google gère-t-il les incidents de ranking avec des mitigations rapides ?

- □ Pourquoi Google coupe-t-il brutalement certains data centers en cas d'incident ?

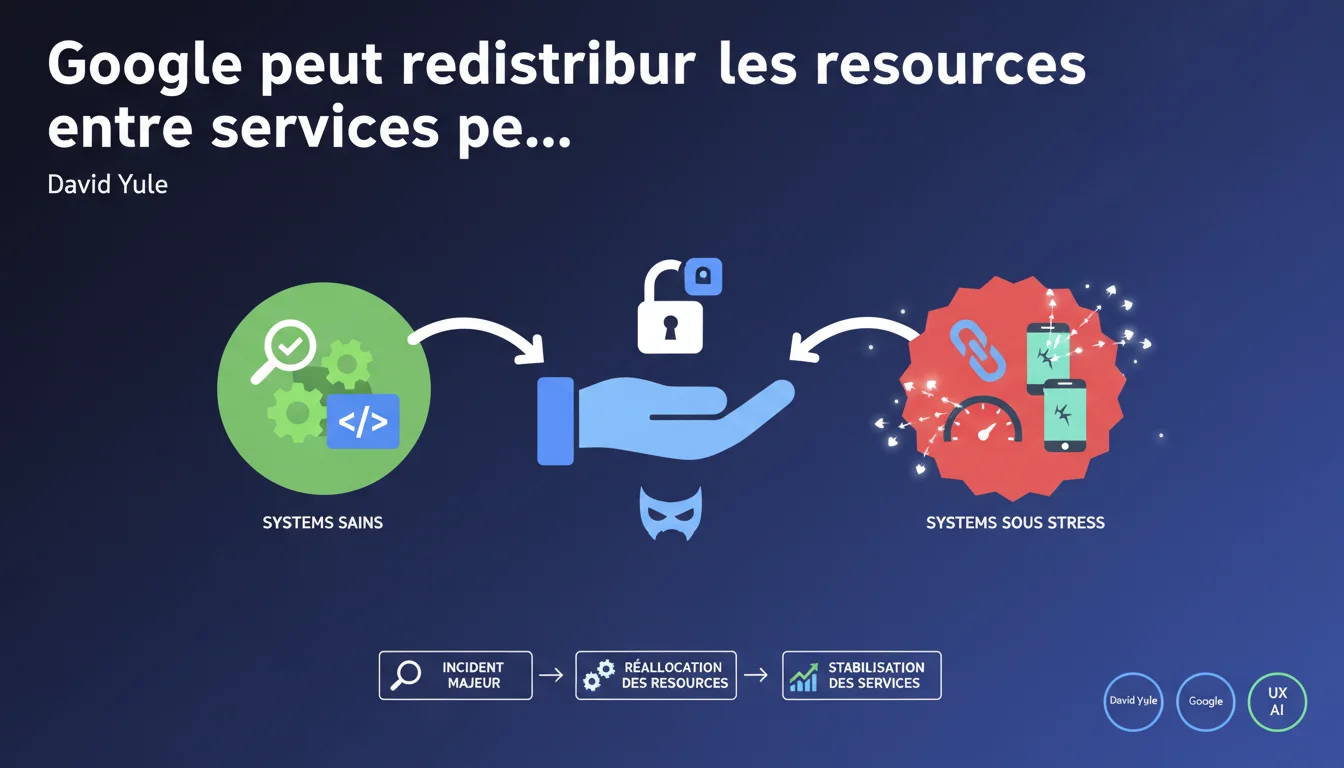

Google confirme que lors d'incidents majeurs, son équipe SRE peut déplacer des ressources entre différents composants de Search. Concrètement, si l'indexation fonctionne normalement mais que le ranking est sous stress, Google peut sacrifier temporairement des ressources d'indexation pour stabiliser les résultats. Cette révélation explique certaines anomalies de crawl observées lors de périodes d'instabilité.

Ce qu'il faut comprendre

Que signifie cette « redistribution de ressources » entre services ?

Google Search n'est pas un système monolithique. C'est un écosystème de services interdépendants : indexation, crawl, ranking, serving, freshness, Knowledge Graph, etc. Chacun consomme des ressources de calcul (CPU, mémoire, bande passante).

Lors d'un incident majeur — une panne partielle, une surcharge imprévue, un bug critique — certains composants peuvent être mis sous stress pendant que d'autres tournent normalement. L'équipe SRE (Site Reliability Engineering) de Google peut alors décider de ponctionner des ressources des systèmes sains pour renforcer ceux en difficulté.

Pourquoi cette pratique est-elle importante pour les praticiens SEO ?

Cette déclaration apporte une explication officielle à des anomalies observées depuis des années. Vous avez déjà constaté des phases où votre crawl budget s'effondrait sans raison apparente ? Où des pages fraîchement publiées mettaient 3 jours au lieu de 3 heures à être indexées ? Où des fluctuations de positions semblaient déconnectées de vos actions ?

Ces incidents peuvent être causés par des arbitrages internes chez Google. Si le système de ranking est surchargé (par exemple lors d'une mise à jour d'algorithme déployée progressivement), Google peut réduire le crawl pour libérer de la puissance de calcul. Vous n'avez rien fait de mal — c'est Google qui jongle avec ses ressources.

Quels composants peuvent être affectés par ces redistributions ?

Tous les systèmes de Search sont potentiellement concernés. Le crawl est souvent le premier sacrifié : il n'est pas critique pour l'expérience utilisateur immédiate. L'indexation différée (pages découvertes mais non traitées immédiatement) peut être ralentie. Le retraitement des signaux (recalcul de PageRank, mise à jour des embeddings sémantiques) peut être suspendu.

En revanche, le serving des résultats (réponse aux requêtes utilisateur) est prioritaire absolu. Google préférera toujours sacrifier le crawl plutôt que de dégrader la vitesse d'affichage des SERP.

- Le crawl et l'indexation peuvent être temporairement ralentis lors d'incidents majeurs pour stabiliser d'autres composants

- Ces arbitrages sont invisibles côté webmaster — aucune alerte n'est envoyée via Search Console

- Les variations de crawl budget inexpliquées peuvent résulter de ces redistributions plutôt que d'un problème sur votre site

- Le serving des SERP reste toujours prioritaire — Google ne sacrifiera jamais l'expérience utilisateur pour crawler plus de pages

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Depuis des années, les praticiens SEO constatent des phases inexplicables de ralentissement du crawl, souvent synchrones entre plusieurs sites sans lien apparent. Les logs montrent que Googlebot devient soudainement moins actif, puis reprend son rythme normal quelques heures ou jours plus tard — sans qu'aucun changement n'ait été fait côté site.

Cette révélation de David Yule valide enfin une hypothèse largement partagée dans la communauté SEO : ces variations ne sont pas toujours liées à votre crawl budget individuel, mais à des décisions d'infrastructure prises par Google pour maintenir la stabilité globale de Search. Soyons honnêtes — c'est frustrant quand on attend l'indexation d'un contenu critique, mais c'est compréhensible d'un point de vue ingénierie.

Quelles limites faut-il poser à cette déclaration ?

Google parle d'« incidents majeurs », pas d'opérations de routine. Il ne faut pas en conclure que chaque fluctuation mineure de crawl est due à une redistribution de ressources. La plupart du temps, si votre crawl chute brutalement, c'est d'abord votre infrastructure qu'il faut suspecter : temps de réponse dégradé, erreurs 5xx, blocages robots.txt mal configurés.

Autre nuance importante : Google ne précise pas quels critères déclenchent ces arbitrages. Quand exactement considère-t-il qu'un incident est « majeur » ? Combien de temps durent ces redistributions ? Quels services sont prioritaires dans quelle situation ? [À vérifier] — la déclaration reste floue sur les seuils et la gouvernance de ces décisions.

Cette pratique peut-elle impacter négativement le référencement d'un site ?

Oui, mais temporairement. Si Google réduit le crawl pendant 24-48h pour stabiliser un système critique, vos nouvelles pages ou vos mises à jour importantes seront indexées avec retard. Pour un site d'actualité ou un e-commerce avec des opérations flash, cela peut représenter une perte de trafic réelle.

Mais — et c'est crucial — cette pénalité n'est ni ciblée ni punitive. Votre site n'est pas spécifiquement visé. Tous les sites subissent le même ralentissement proportionnel. Une fois l'incident résolu, le crawl reprend son rythme normal et les pages en attente sont traitées. Aucun impact durable sur le ranking.

Impact pratique et recommandations

Comment distinguer un incident Google d'un problème sur mon site ?

Première réflexe : vérifier si la baisse de crawl est isolée ou généralisée. Consultez des communautés SEO (forums, Twitter, groupes Slack) pour savoir si d'autres professionnels constatent la même chose au même moment. Si oui, c'est probablement un arbitrage Google. Si non, c'est votre infrastructure.

Deuxième vérification : analysez vos logs serveur. Une baisse de crawl liée à un incident Google se traduit par moins de hits de Googlebot, mais les requêtes restantes ont des codes 200 normaux et des temps de réponse standards. Si vous voyez des 5xx, des timeouts ou des pics de latence, le problème est chez vous.

Que faut-il faire concrètement pendant ces incidents ?

Soyons pragmatiques : vous ne pouvez rien faire pour influencer les décisions d'infrastructure de Google. Vous ne recevrez aucune alerte, aucun message dans Search Console. Ces redistributions sont invisibles pour les webmasters et résolues en interne par les équipes SRE.

La seule action sensée consiste à maintenir votre infrastructure irréprochable en permanence. Comme ça, si Google réduit temporairement le crawl, au moins vous êtes certain que ce n'est pas votre faute — et dès que les ressources sont rétablies, votre site sera crawlé efficacement sans friction.

Comment minimiser l'impact de ces redistributions sur mon activité ?

Anticipez. Si vous publiez du contenu critique ou time-sensitive, ne comptez jamais sur une indexation immédiate. Prévoyez une marge de sécurité de 24-48h entre la publication et le moment où vous avez absolument besoin que la page soit indexée.

Utilisez les outils d'indexation prioritaire quand c'est vraiment nécessaire : soumission manuelle via Search Console pour les pages stratégiques, sitemaps XML bien structurés, internal linking fort depuis vos pages les plus crawlées. Ces signaux ne garantissent rien pendant un incident, mais ils augmentent vos chances.

- Surveillez vos logs serveur pour distinguer un ralentissement Googlebot d'un problème technique sur votre infrastructure

- Consultez des communautés SEO pendant les anomalies pour confirmer si d'autres sites sont impactés

- Maintenez des temps de réponse serveur optimaux (< 200ms) pour maximiser votre crawl quand les ressources Google reviennent

- Planifiez vos publications critiques avec 48h de marge plutôt que de compter sur une indexation immédiate

- Utilisez les soumissions manuelles Search Console uniquement pour les pages vraiment stratégiques

- Structurez votre sitemap XML par ordre de priorité pour que les pages importantes soient crawlées en premier

❓ Questions frequentes

Combien de temps durent ces redistributions de ressources ?

Est-ce que tous les sites sont impactés de la même manière ?

Puis-je demander à Google de ne pas réduire le crawl sur mon site pendant ces incidents ?

Ces redistributions affectent-elles le ranking de mes pages déjà indexées ?

Comment Google décide-t-il quels services sacrifier en priorité ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/10/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.