Declaration officielle

Autres déclarations de cette vidéo 8 ▾

- □ Pourquoi Google refuse-t-il de viser 100% de fiabilité pour son moteur de recherche ?

- □ Google vérifie-t-il réellement l'expérience utilisateur au-delà des codes HTTP ?

- □ Pourquoi Google veut-il détecter les incidents avant que vous ne les signaliez ?

- □ Comment Google gère-t-il les pics de trafic sans pénaliser le référencement ?

- □ Pourquoi Google traite-t-il certaines requêtes à moindre coût que d'autres ?

- □ Comment Google provisionne-t-il ses ressources serveur pour les pics de trafic prévisibles ?

- □ Google peut-il réellement voler des ressources à l'indexation pour stabiliser son moteur de recherche ?

- □ Comment Google gère-t-il les incidents de ranking avec des mitigations rapides ?

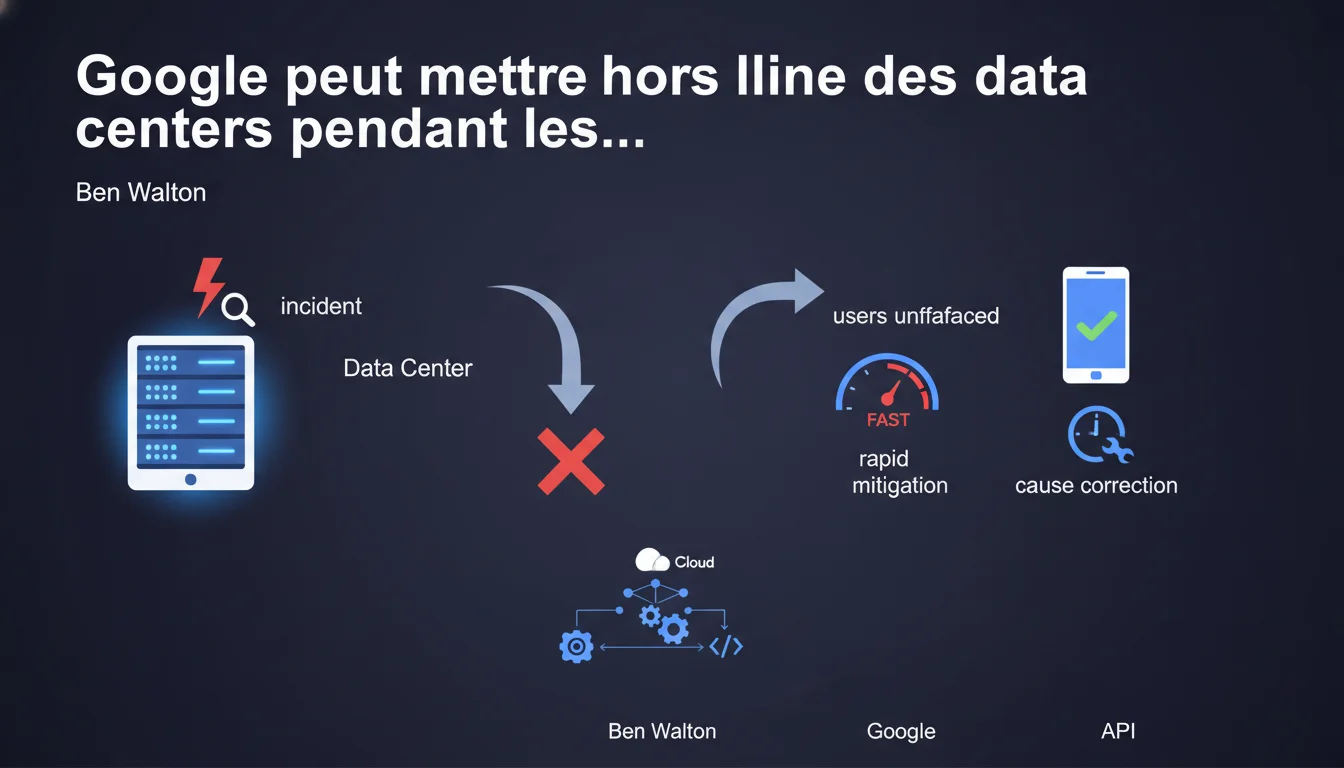

Google privilégie la coupure immédiate d'un data center défaillant plutôt que de risquer une dégradation de l'expérience utilisateur. Cette stratégie de mitigation rapide évite que des serveurs instables continuent à servir des résultats ou à indexer du contenu. Pour les praticiens SEO, cela signifie qu'un incident technique peut entraîner des fluctuations temporaires de crawl, d'indexation ou de ranking — sans forcément refléter un problème de site.

Ce qu'il faut comprendre

Quelle est la logique derrière cette décision radicale ?

Google gère une infrastructure distribuée sur plusieurs dizaines de data centers répartis mondialement. Lorsqu'un seul centre présente une anomalie — latence anormale, corruption de données, problème réseau — la réponse standard consiste à l'isoler instantanément du trafic de production.

Cette approche « fail-fast » repose sur un principe simple : mieux vaut perdre temporairement une fraction de capacité que laisser un composant défaillant polluer les résultats ou ralentir l'ensemble du système. Les autres data centers absorbent automatiquement la charge manquante via des mécanismes de load balancing et de réplication.

Concrètement, qu'est-ce qui se passe pour l'indexation pendant cette période ?

Pendant la mise hors ligne, le data center concerné cesse de crawler, d'indexer et de servir des résultats de recherche. Les Googlebots rattachés à ce centre ne visitent plus les sites. Les requêtes utilisateurs sont redirigées vers d'autres infrastructures.

La durée de l'incident varie : quelques minutes pour un problème réseau isolé, plusieurs heures si une investigation approfondie est nécessaire. Une fois la cause identifiée et corrigée, le data center est progressivement réintégré au cluster global.

Quelles sont les conséquences observables côté webmaster ?

- Chute temporaire du crawl : certains sites peuvent voir leur nombre de pages crawlées diminuer brutalement si le data center isolé était leur source principale de bot.

- Fluctuations de ranking : pendant la bascule, des variations mineures peuvent apparaître, le temps que les autres centres recalculent les index et les scores.

- Latences ou timeouts : si votre serveur d'origine est géographiquement proche du data center mis offline, vous pourriez observer des temps de réponse allongés le temps que le trafic soit rerouté.

- Aucun impact durable : une fois l'incident résolu, l'activité reprend normalement sans pénalité ni dette technique pour les sites crawlés.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées ?

Oui, totalement. Sur le terrain, on observe régulièrement des micro-fluctuations inexpliquées dans les logs : baisse soudaine du crawl pendant 2-3 heures, puis retour à la normale sans changement côté site. Ces anomalies coïncident souvent avec des incidents infra que Google ne communique pas publiquement.

La stratégie du « shutdown immédiat » est d'ailleurs une best practice SRE (Site Reliability Engineering) standard : isoler le maillon faible pour protéger le système global. Rien de surprenant ici — c'est du Chaos Engineering appliqué à l'échelle de Google.

Quelles nuances faut-il apporter ?

Google ne précise pas combien de data centers crawlent simultanément un même site. Un site de niche peut dépendre d'un seul centre pour son crawl quotidien, tandis qu'un site d'envergure internationale sera crawlé depuis plusieurs zones géographiques en parallèle.

Résultat : l'impact d'une mise offline varie énormément selon votre profil de site et votre répartition géographique. [A vérifier] : Google n'a jamais communiqué de métriques précises sur la distribution du crawl par data center ni sur la durée moyenne des incidents. On navigue donc en partie à l'aveugle.

Autre point — cette déclaration concerne les « utilisateurs », mais elle s'applique aussi au crawl et à l'indexation. Un data center hors ligne ne sert ni requêtes humaines ni opérations de bot. C'est cohérent, mais ça mérite d'être explicité : un incident infra peut ralentir la détection de nouvelles pages ou retarder la prise en compte de modifications récentes.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Si l'incident touche plusieurs data centers simultanément, Google ne peut pas tous les mettre offline — sinon, c'est le service entier qui s'effondre. Dans ce cas, la mitigation devient plus complexe : déploiement de patchs en urgence, rerouting partiel, dégradation contrôlée.

Soyons honnêtes : ces incidents massifs sont rares, mais ils existent. En général, Google communique alors via son Search Status Dashboard ou via @searchliaison sur X. Si vous observez un comportement anormal prolongé (> 24h) sans annonce officielle, c'est probablement un problème côté site, pas côté Google.

Impact pratique et recommandations

Que faut-il faire concrètement face à ce type d'incident ?

D'abord, ne pas paniquer. Une chute brutale du crawl ou des impressions pendant quelques heures n'est pas forcément un problème de votre côté. Avant de tout casser et de refaire vos sitemaps, vérifiez les sources officielles : Search Status Dashboard, @searchliaison, forums communautaires.

Ensuite, documentez l'incident dans vos logs : notez la date, l'heure, la durée, les pages impactées. Si le pattern se répète régulièrement aux mêmes horaires ou jours, c'est peut-être un indice que votre site est crawlé principalement depuis un data center spécifique — information utile pour anticiper de futurs incidents.

Quelles erreurs éviter absolument ?

- Ne pas modifier votre fichier robots.txt ou votre configuration serveur en pleine période d'instabilité — vous risquez d'aggraver la situation.

- Ne pas augmenter artificiellement votre crawl budget (via des sitemaps massifs ou des pings répétés) pour « compenser » une baisse temporaire — ça ne sert à rien et ça surcharge inutilement vos serveurs.

- Ne pas interpréter une fluctuation de ranking de quelques heures comme une pénalité ou un problème algorithmique — attendez au moins 48h avant de tirer des conclusions.

- Ne pas négliger la surveillance proactive : si vous n'avez pas de monitoring en temps réel de votre crawl et de vos performances SERP, vous naviguez à l'aveugle.

Comment vérifier que votre infrastructure est résiliente ?

Assurez-vous que votre hébergement dispose également d'une redondance géographique. Si Google bascule le crawl d'un data center européen vers un data center américain, votre serveur doit pouvoir absorber cette latence supplémentaire sans timeouts.

Testez régulièrement votre capacité de réponse sous charge : un crawl Google peut représenter des centaines de requêtes simultanées. Si votre serveur flanche à la moindre variation de trafic, un reroutage infra côté Google peut provoquer des erreurs 5xx — et ça, Google le pénalise.

En résumé : surveillez vos métriques en temps réel, restez informé des incidents officiels, et ne sur-réagissez pas aux anomalies temporaires. Ces optimisations d'infrastructure et de monitoring peuvent rapidement devenir complexes à orchestrer seul, surtout si vous gérez plusieurs sites ou des environnements techniques hétérogènes. Faire appel à une agence SEO spécialisée pour un audit technique approfondi et un accompagnement sur-mesure peut vous faire gagner un temps précieux — et éviter des erreurs coûteuses en période critique.

❓ Questions frequentes

Combien de temps dure en moyenne une mise hors ligne de data center Google ?

Est-ce que Google prévient les webmasters avant de couper un data center ?

Mon site peut-il être pénalisé si un data center Google tombe pendant que je pousse une mise à jour importante ?

Comment savoir quel data center Google crawle principalement mon site ?

Dois-je configurer mon CDN ou mon firewall différemment pour anticiper ces bascules ?

🎥 De la même vidéo 8

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/10/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.