Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il baliser les programmes de fidélité pour améliorer ses résultats enrichis ?

- □ Pourquoi Google abandonne-t-il 7 types de données structurées et que faut-il faire maintenant ?

- □ Faut-il maintenir les données structurées si Google arrête d'en afficher certaines ?

- 4:56 Pourquoi Google refuse-t-il de s'engager sur l'avenir des AI Overviews ?

- 8:48 Peut-on empêcher Google de nous positionner sur certains mots-clés ?

- 9:56 La qualité d'une page suffit-elle pour garantir son indexation ?

- 9:56 Combien de temps Google met-il vraiment à reconnaître les changements SEO ?

- 12:00 Comment Google découvre-t-il vraiment les URLs de votre site ?

- 12:00 Faut-il vraiment compter le nombre exact d'URLs de son site ?

- 15:15 Faut-il vraiment soumettre son sitemap tous les jours ?

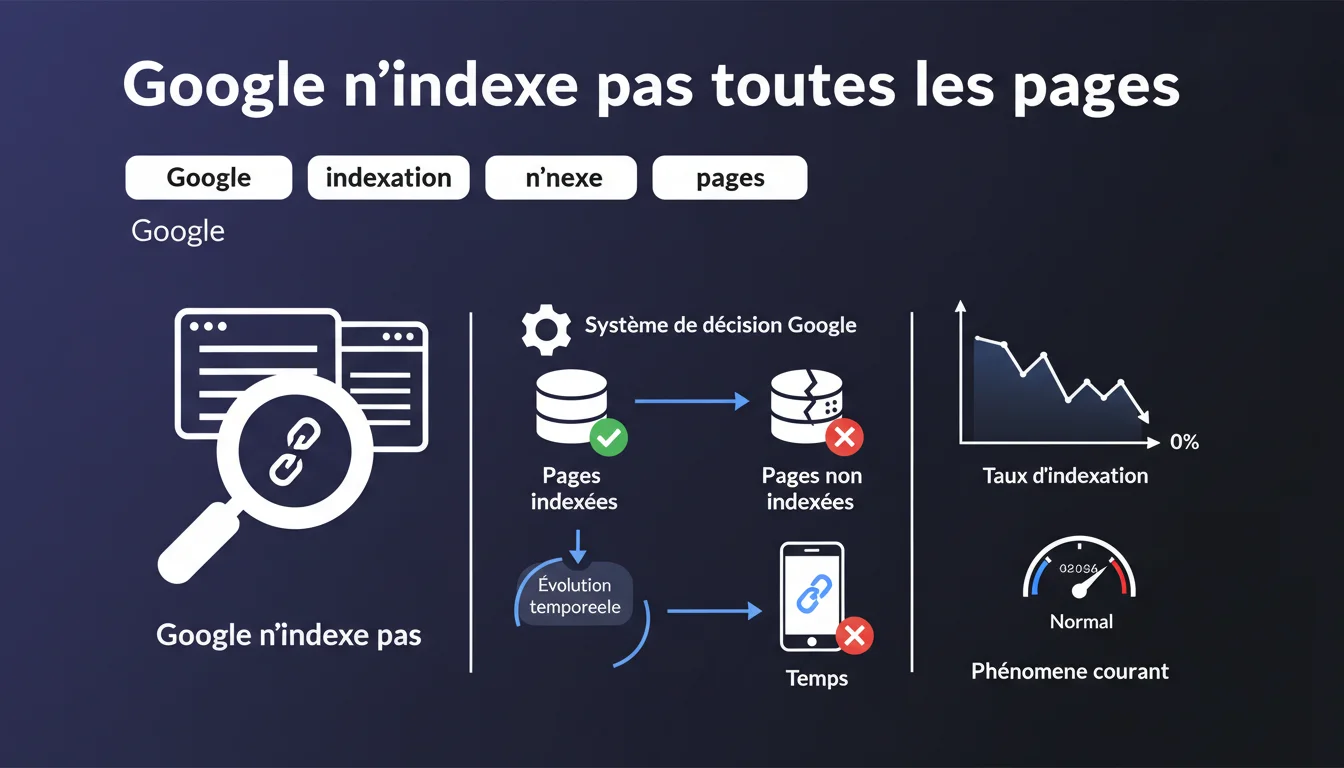

Google affirme qu'il ne garantit l'indexation d'aucune page, même celles précédemment indexées. Cette décision relève de ses algorithmes et peut évoluer à tout moment. La désindexation progressive de certaines URLs doit être considérée comme normale, pas comme une anomalie.

Ce qu'il faut comprendre

Que signifie vraiment cette déclaration de Google ?

Google ne s'engage pas à indexer l'intégralité de votre site. Chaque page est évaluée selon des critères internes — qualité du contenu, pertinence, expérience utilisateur, signaux techniques — et peut être refusée ou retirée de l'index à tout moment.

Cette position officialise ce que beaucoup observaient déjà : l'indexation n'est pas un droit acquis. Une page indexée aujourd'hui peut disparaître demain si Google estime qu'elle n'apporte plus de valeur à son index.

Pourquoi certaines pages perdent-elles leur indexation ?

Les raisons sont multiples et rarement explicites. Google évoque des décisions système sans détailler les paramètres exacts. Cela peut inclure la détection de contenu dupliqué, un faible engagement utilisateur, une qualité jugée insuffisante ou simplement une réévaluation algorithmique.

Le flou volontaire de cette communication laisse peu de prise pour diagnostiquer précisément pourquoi telle page disparaît. C'est frustrant, mais c'est assumé par Google.

Est-ce vraiment un phénomène courant ou exceptionnel ?

Google insiste sur le caractère normal de la désindexation. Ce n'est pas un bug, c'est une fonctionnalité. Autrement dit : si vous constatez une érosion progressive de vos pages indexées, ce n'est pas forcément le signe d'une pénalité.

Cela relativise aussi l'importance obsessionnelle du nombre total de pages indexées. Ce qui compte, c'est la qualité et la performance des pages qui restent dans l'index.

- Indexation sélective : Google choisit ce qu'il indexe selon ses propres critères de valeur ajoutée

- Volatilité assumée : une page indexée aujourd'hui peut disparaître sans préavis ni justification détaillée

- Normalisation de la perte : la désindexation partielle est présentée comme une évolution naturelle, pas un dysfonctionnement

- Absence de garantie : aucune promesse d'indexation, même pour des contenus de qualité

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. Depuis des années, on constate des fluctuations d'indexation inexpliquées. Des sites perdent 20 à 40 % de leurs URLs indexées sans raison apparente, sans corrélation avec une mise à jour algorithmique ou un problème technique identifiable.

Ce qui change, c'est que Google l'officialise. Avant, on cherchait désespérément une cause — robots.txt mal configuré, canonicals défaillantes, crawl budget épuisé. Aujourd'hui, Google nous dit : parfois, c'est juste une décision algorithmique. [A vérifier] : reste à savoir si cette « normalisation » ne sert pas aussi à couvrir des dysfonctionnements réels de l'index.

Quelles nuances faut-il apporter à cette position ?

Soyons honnêtes : cette communication arrange Google. Elle déresponsabilise le moteur en cas de problème d'indexation massif. « C'est normal » devient une réponse facile quand des milliers de pages disparaissent sans explication.

Mais attention — ce n'est pas parce que Google normalise la désindexation qu'il faut baisser les bras. Une chute brutale d'indexation reste un signal d'alerte à investiguer. Ne pas tout mettre sur le dos de « l'algorithme capricieux ». Vérifiez d'abord vos fondamentaux techniques.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Les pages stratégiques — homepage, catégories principales, fiches produits phares — devraient logiquement rester indexées si elles sont techniquement saines et alignées avec les critères E-E-A-T. Si ce n'est pas le cas, c'est qu'il y a un vrai problème.

La « normalité » invoquée par Google concerne surtout les pages à faible valeur ajoutée : pagination profonde, facettes de filtres, variantes mineures de contenu. Là, oui, la désindexation est compréhensible. Mais si vos contenus piliers disparaissent, ne vous réfugiez pas derrière cette excuse.

Impact pratique et recommandations

Que faut-il faire concrètement face à cette réalité ?

Première étape : identifier vos pages critiques. Toutes vos URLs ne se valent pas. Concentrez-vous sur celles qui génèrent du trafic, des conversions, ou structurent votre architecture sémantique. Ces pages-là doivent impérativement rester indexées.

Ensuite, renforcez leurs signaux de qualité. Maillage interne solide, contenu à jour, performance technique irréprochable, signaux d'engagement positifs. Plus une page est jugée utile et performante, moins elle risque de disparaître de l'index.

Quelles erreurs éviter absolument ?

Ne gonflez pas artificiellement votre index avec des pages à faible valeur ajoutée. Google le dit clairement : tout ne mérite pas d'être indexé. Créer 10 000 pages médiocres ne vous aidera pas — au contraire, cela risque de diluer la perception de qualité globale de votre site.

Évitez aussi de paniquer à chaque fluctuation mineure. Si vous perdez 5 % de pages indexées sur un site de 50 000 URLs, c'est probablement du nettoyage algorithmique naturel. Focalisez-vous sur les variations significatives et sur les pages à fort enjeu business.

Comment surveiller et anticiper ces variations d'indexation ?

Mettez en place un monitoring régulier via la Search Console. Surveillez l'évolution du nombre de pages indexées, mais surtout identifiez quelles pages disparaissent. Un outil comme Screaming Frog couplé à des exports Search Console vous permet de croiser les données.

Documentez vos observations. Si une catégorie entière de pages est systématiquement désindexée, c'est peut-être un signal que cette typologie de contenu ne répond pas aux standards de Google. Ajustez votre stratégie éditoriale en conséquence.

- Cartographier vos pages stratégiques et vérifier leur indexation mensuelle

- Optimiser en priorité les contenus à fort ROI pour maximiser leurs signaux de qualité

- Nettoyer proactivement les pages à faible valeur (noindex, suppression, amélioration)

- Suivre l'évolution de l'index dans la Search Console avec des exports réguliers

- Ne pas confondre fluctuation normale et problème technique structurel

- Investiguer toute chute brutale (>20 %) avant de l'attribuer à l'algorithme

❓ Questions frequentes

Google peut-il désindexer des pages sans raison apparente ?

Faut-il s'inquiéter si le nombre de pages indexées diminue progressivement ?

Comment savoir quelles pages Google a choisi de ne pas indexer ?

Peut-on forcer Google à indexer une page spécifique ?

Cette politique s'applique-t-elle à tous les types de sites ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 26/06/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.