Declaration officielle

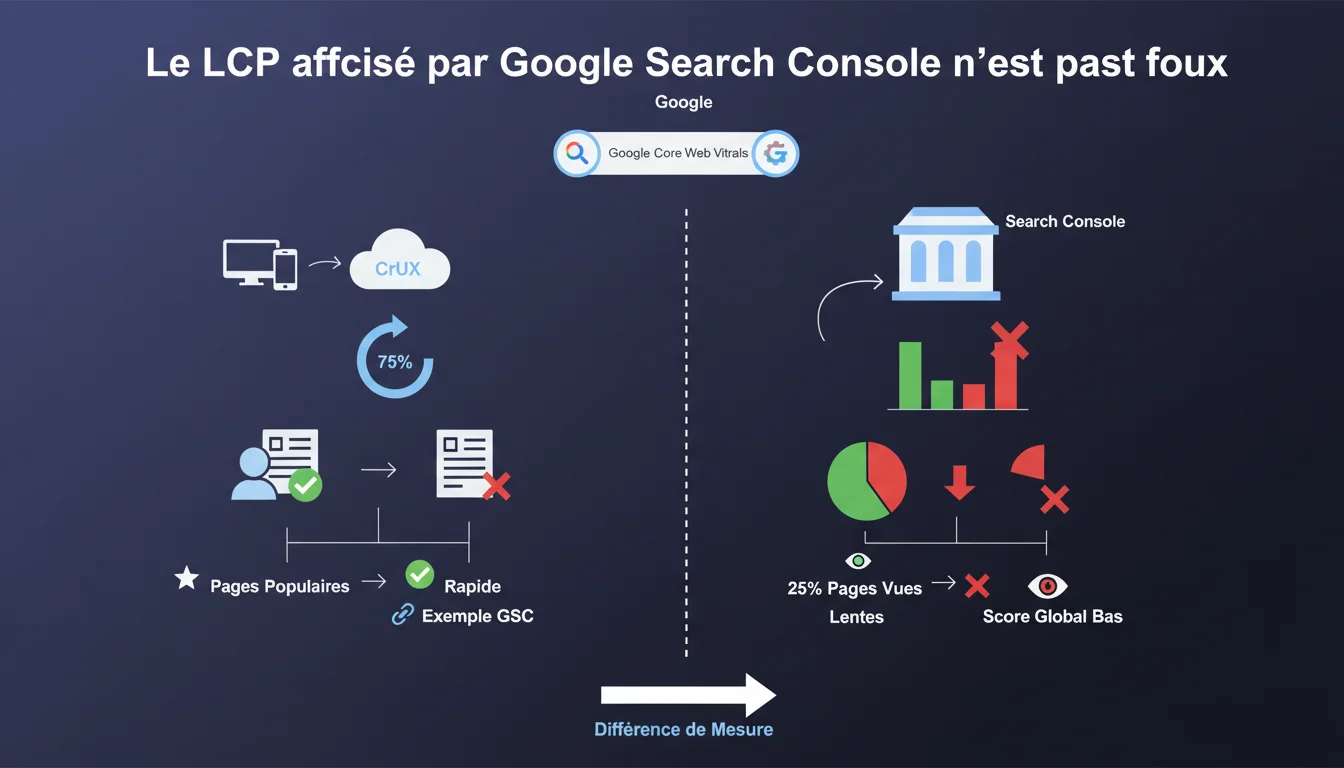

CrUX calcule la performance au 75ᵉ percentile des chargements de page, ce qui signifie que si plus de 25 % des pages vues sont plus lentes, le score global baisse. Les pages populaires, souvent présentées comme exemples dans GSC, bénéficient de données suffisantes et sont généralement plus rapides, car elles profitent de caches (base de données, Varnish, CDN). Les pages de la longue traîne (moins fréquentées), qui peuvent représenter plus de 25 % du trafic total, sont souvent non mises en cache et donc plus lentes, même si elles sont techniquement identiques. De plus, les pages peu demandées déclenchent des “cache misses” et doivent être générées depuis zéro, augmentant le LCP.

Voici les conseils de Philip Walton pour améliorer la situation : Mesurer la performance sans cache : tester avec un paramètre aléatoire dans l’URL (ex. ?test=1234) pour forcer un chargement non mis en cache dans Lighthouse.

Comparer avec un test sur la version cachée et réduire l’écart ; viser moins de 2,5 s même sans cache.

Optimiser le temps de chargement hors cache afin que le cache soit un bonus, pas la seule optimisation.

Configurer le CDN pour ignorer les paramètres d’URL non pertinents (ex. UTM, gclid) et ainsi conserver l’usage du cache.

Anticiper le futur standard No Vary Search, qui permettra de définir les paramètres à ignorer pour le caching.

Ce qu'il faut comprendre

De nombreux praticiens SEO constatent un paradoxe frustrant : Google Search Console signale des problèmes de LCP (Largest Contentful Paint) sur leur site, alors que les tests sur les pages principales montrent d'excellentes performances. Cette situation n'est pas une erreur de GSC, mais révèle un écart entre pages populaires et longue traîne.

La clé réside dans la méthodologie de mesure des Core Web Vitals par CrUX. Le score global est calculé au 75ᵉ percentile de tous les chargements, ce qui signifie que si plus de 25% des pages vues sont lentes, le score global bascule en rouge. Les pages que vous testez habituellement sont les plus visitées, donc les mieux optimisées par les systèmes de cache (CDN, Varnish, cache base de données).

Le problème provient des pages de longue traîne, moins fréquentées mais représentant collectivement une part significative du trafic. Ces pages déclenchent des "cache miss" et doivent être générées depuis zéro à chaque fois, augmentant drastiquement le LCP. Techniquement identiques aux pages populaires, elles subissent simplement l'absence de mise en cache.

- CrUX mesure au 75ᵉ percentile : plus de 25% de pages lentes font chuter le score global

- Les pages populaires bénéficient du cache et sont naturellement plus rapides

- La longue traîne non cachée dégrade les performances globales

- Les "cache miss" génèrent des délais importants sur les pages peu visitées

- Le LCP de GSC reflète l'expérience réelle des utilisateurs, pas uniquement celle des pages stars

Avis d'un expert SEO

Cette explication de Google est parfaitement cohérente avec les observations terrain. En audit, je constate régulièrement que les sites e-commerce avec des milliers de fiches produits ou les sites éditoriaux avec des archives profondes souffrent précisément de ce phénomène. Les propriétaires testent leur homepage et quelques catégories phares, trouvent tout parfait, mais GSC reste au rouge.

La nuance importante à apporter concerne les sites avec forte personnalisation ou contenu dynamique. Pour eux, le cache est intrinsèquement moins efficace puisque chaque utilisateur reçoit une version différente. Dans ces cas, l'optimisation du "cold start" devient encore plus critique. Les sites SaaS et applications web sont particulièrement concernés.

L'annonce du futur standard No Vary Search est une excellente nouvelle pour gérer les paramètres d'URL. Actuellement, chaque variation d'URL avec des paramètres UTM ou tracking génère une entrée cache distincte, multipliant inutilement les "cache miss". Cette standardisation simplifiera considérablement la gestion du cache pour les sites avec beaucoup de tracking marketing.

Impact pratique et recommandations

- Tester systématiquement sans cache : utilisez un paramètre aléatoire (?test=12345) dans Lighthouse pour simuler un "cache miss" et mesurer la performance réelle

- Viser moins de 2,5 secondes de LCP même sans cache : c'est votre référence d'optimisation, le cache viendra ensuite améliorer ce score de base

- Identifier vos pages de longue traîne problématiques : analysez dans GSC quelles URLs spécifiques tirent le score vers le bas, pas uniquement les agrégats

- Optimiser la génération côté serveur : réduire les requêtes base de données, optimiser les templates, utiliser du lazy loading pour les éléments non-LCP

- Configurer intelligemment votre CDN : paramétrez-le pour ignorer les paramètres non pertinents (UTM, gclid, fbclid) afin de maximiser le hit ratio du cache

- Implémenter une stratégie de cache multicouche : combiner cache CDN, cache applicatif (Varnish, Redis) et cache base de données pour différents niveaux de contenu

- Surveiller le taux de hit cache : un taux inférieur à 80% indique probablement une mauvaise configuration ou trop de variations d'URL

- Précharger le cache des pages stratégiques : script de warm-up après déploiement pour que les premières visites bénéficient déjà du cache

- Se préparer au standard No Vary Search : documenter dès maintenant quels paramètres d'URL peuvent être ignorés pour le caching

Ces optimisations touchent à la fois l'infrastructure serveur, la configuration CDN et le code applicatif. Elles nécessitent une compréhension approfondie de l'architecture technique et des Core Web Vitals. Pour les sites complexes ou les équipes sans expertise DevOps dédiée, s'entourer de spécialistes maîtrisant à la fois le SEO technique et l'optimisation de performance permet d'identifier rapidement les goulots d'étranglement et de mettre en place les solutions les plus efficaces, adaptées à votre infrastructure spécifique.

💬 Commentaires (0)

Soyez le premier à commenter.