Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il encore optimiser ses meta descriptions si Google les ignore ?

- □ Faut-il encore optimiser les meta descriptions pour le SEO ?

- □ Un seul lien suffit-il vraiment pour que Google découvre et indexe votre site ?

- □ Faut-il encore utiliser rel=prev/next pour la pagination ?

- □ Le boilerplate est-il vraiment un danger pour votre référencement naturel ?

- □ Les redirections IP géolocalisées tuent-elles votre crawl Google ?

- □ Comment Google détermine-t-il vraiment la localisation d'un utilisateur pour le SEO local ?

- □ Les bases de données IP pour la géolocalisation sont-elles vraiment fiables pour le SEO international ?

- □ Google peut-il vraiment afficher des rich results sans schema markup ?

- □ Faut-il configurer le header Content-Language pour les PDF et fichiers non-HTML ?

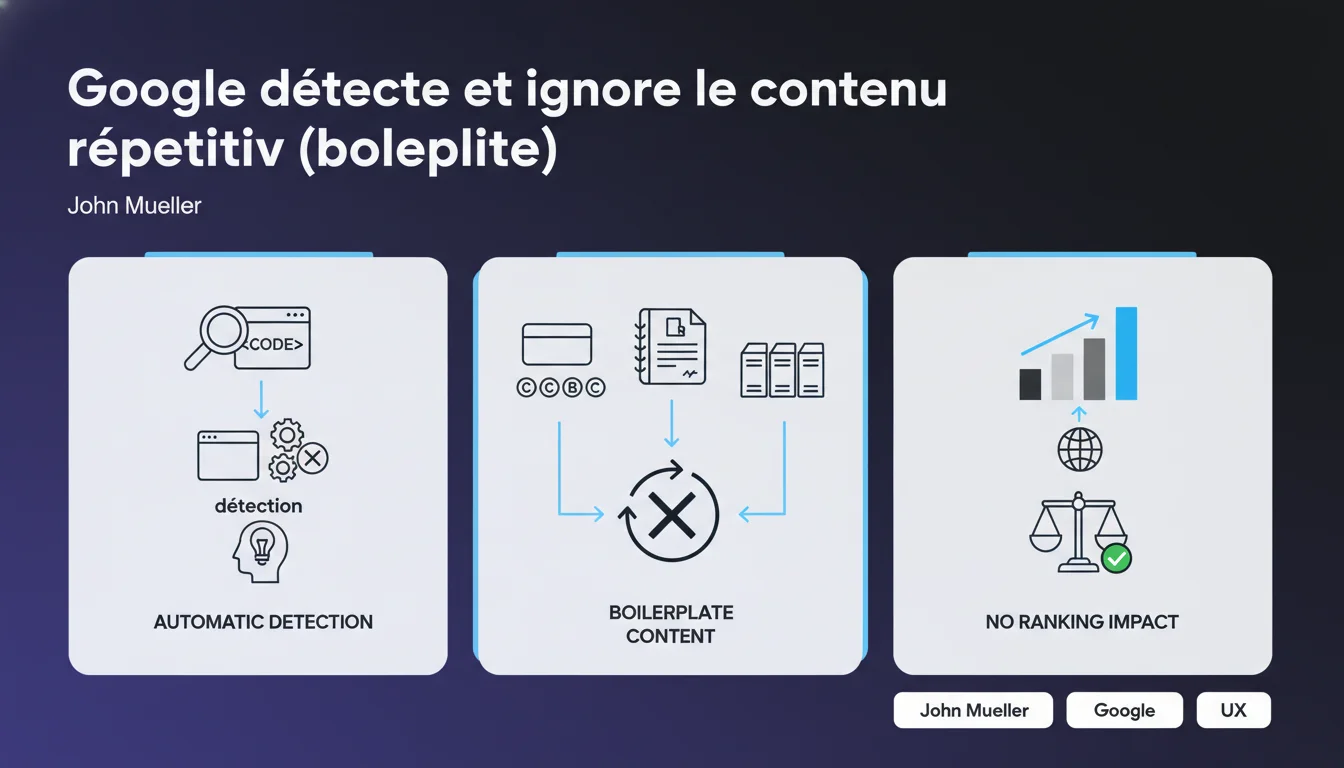

Google détecte automatiquement le contenu répétitif (footers, mentions légales, descriptions produits standardisées) et l'ignore pour le classement. Ce contenu boilerplate n'a aucun impact négatif sur les performances SEO du reste de la page. L'algorithme fait la différence entre contenu éditorial unique et éléments structurels récurrents.

Ce qu'il faut comprendre

Comment Google distingue-t-il le contenu boilerplate du contenu éditorial ?

L'algorithme de Google analyse la récurrence des blocs de texte à travers vos pages et identifie les patterns qui se répètent systématiquement. Un footer présent sur 500 pages, des CGV affichées partout, un disclaimer répété — le moteur repère ces redondances.

Techniquement, Google segmente chaque page en zones fonctionnelles : navigation, contenu principal, sidebar, footer. Cette segmentation permet d'isoler ce qui relève de la structure du site (boilerplate) et ce qui constitue le contenu unique destiné à l'utilisateur.

Pourquoi cette tolérance pour le contenu répétitif ?

Google a compris depuis longtemps qu'un site web moderne nécessite des éléments structurels récurrents. Pénaliser systématiquement cette répétition reviendrait à sanctionner l'architecture normale d'un site.

La logique est simple : si votre footer apparaît sur 1000 pages, ce n'est pas une tentative de manipulation mais une contrainte technique et légale. L'algorithme fait la part des choses entre duplication intentionnelle (spam) et nécessité fonctionnelle.

Quels types de contenu sont concernés par cette détection ?

Les footers et headers contenant informations de contact, liens légaux, menus de navigation. Les sidebars répétitives avec widgets sociaux, bannières publicitaires, appels à l'action identiques. Les disclaimers et mentions légales dupliqués sur chaque fiche produit ou article.

- Google ignore le boilerplate dans son calcul de pertinence mais indexe toujours le contenu (pour la recherche de marque, navigation site, etc.)

- Cette tolérance ne signifie pas que vous pouvez bourrer vos footers de mots-clés — le keyword stuffing reste détecté et sanctionné

- Le contenu éditorial dupliqué (descriptions produits copiées du fabricant, articles republiés) n'entre pas dans cette catégorie et reste problématique

- La détection fonctionne au niveau intra-site : Google compare vos pages entre elles, pas avec d'autres sites

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même l'un des rares points sur lesquels la théorie Google colle parfaitement à la pratique. On voit régulièrement des sites avec des footers massifs (200-300 mots de texte légal) se classer sans problème, tant que le contenu principal reste unique et qualitatif.

Les tests que j'ai menés sur des sites e-commerce montrent que dupliquer un bloc de texte "Pourquoi acheter chez nous" sur 500 fiches produits n'impacte pas le ranking — à condition que la description produit elle-même soit différenciée. Google isole bien ces blocs.

Quelles sont les limites de cette tolérance ?

La nuance critique : Google tolère le boilerplate tant qu'il ne représente pas la majorité du contenu visible. Si votre page contient 50 mots de contenu unique et 400 mots de footer répétitif, le ratio devient problématique.

J'ai observé des cas où des sites avec un ratio boilerplate/contenu unique supérieur à 70% voyaient leurs pages considérées comme "thin content". Google ne pénalise pas le boilerplate en soi, mais si votre page n'offre quasi rien d'autre, elle n'a aucune raison de se classer. [À vérifier] : Google n'a jamais communiqué de seuil précis, mais l'expérience terrain suggère qu'un ratio 30/70 (boilerplate/unique) est un maximum prudent.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Attention aux descriptions produits standardisées fournies par le fabricant. Google les considère comme du contenu éditorial, pas du boilerplate structurel — même si elles se répètent sur 10 000 sites concurrents.

Les templates d'articles avec des intro/conclusions génériques répétées sur des centaines de pages ne bénéficient pas non plus de cette tolérance. Google les voit comme du contenu pauvre répliqué, pas comme des éléments structurels.

Impact pratique et recommandations

Faut-il supprimer ou réduire le contenu boilerplate existant ?

Non, sauf si ce contenu représente l'essentiel de vos pages. Gardez vos footers, vos menus, vos disclaimers — ils ont une fonction utilisateur et légale. L'énergie que vous dépenseriez à les raccourcir serait mieux investie dans l'enrichissement du contenu unique.

Par contre, si vous constatez que certaines pages affichent 80% de contenu répétitif et 20% de contenu unique, inversez la proportion. Ajoutez du contenu éditorial substantiel plutôt que de rogner sur les éléments structurels.

Comment optimiser la détection du boilerplate par Google ?

Utilisez le balisage sémantique HTML5 : <header>, <nav>, <aside>, <footer>, <main>. Ces balises aident Google à segmenter correctement vos pages et identifier les zones de contenu principal versus structure.

Isolez le contenu éditorial dans une balise <main> ou <article>. Plus la délimitation est claire, plus Google peut efficacement ignorer ce qui doit l'être et valoriser ce qui compte.

Quelles erreurs éviter absolument ?

Ne tentez pas de "cacher" du boilerplate en CSS (display:none, text-indent) en pensant que Google l'ignorera mieux. C'est l'inverse : cela ressemble à du cloaking et peut déclencher une action manuelle.

Évitez de bourrer vos footers de listes de mots-clés géolocalisés en pensant que "Google les ignore de toute façon". L'algorithme détecte le keyword stuffing même dans le boilerplate, et ce comportement peut impacter la confiance globale accordée au site.

- Auditez le ratio contenu unique / boilerplate sur vos principales templates (accueil, fiches produits, articles)

- Vérifiez que vos pages contiennent au minimum 200-300 mots de contenu éditorial unique hors éléments répétitifs

- Implémentez le balisage sémantique HTML5 si ce n'est pas déjà fait

- Placez le contenu principal en haut du DOM, avant les sidebars et footers (même si CSS les repositionne visuellement)

- Testez vos templates avec l'outil "Inspection d'URL" de la Search Console pour voir ce que Google indexe réellement

- Évitez les variations pseudo-uniques de boilerplate (spinning, insertion dynamique de ville/date) — assumez la répétition

❓ Questions frequentes

Le contenu boilerplate compte-t-il dans la longueur de page que Google évalue ?

Puis-je inclure des liens SEO dans mon footer sans risque ?

Les descriptions produits fournies par les fabricants sont-elles considérées comme du boilerplate ?

Faut-il utiliser des balises spécifiques pour signaler le boilerplate à Google ?

Le boilerplate affecte-t-il le temps de chargement et donc indirectement le SEO ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/04/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.