Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Faut-il encore optimiser ses meta descriptions si Google les ignore ?

- □ Faut-il encore optimiser les meta descriptions pour le SEO ?

- □ Un seul lien suffit-il vraiment pour que Google découvre et indexe votre site ?

- □ Faut-il encore utiliser rel=prev/next pour la pagination ?

- □ Le contenu boilerplate nuit-il vraiment au référencement de vos pages ?

- □ Les redirections IP géolocalisées tuent-elles votre crawl Google ?

- □ Comment Google détermine-t-il vraiment la localisation d'un utilisateur pour le SEO local ?

- □ Les bases de données IP pour la géolocalisation sont-elles vraiment fiables pour le SEO international ?

- □ Google peut-il vraiment afficher des rich results sans schema markup ?

- □ Faut-il configurer le header Content-Language pour les PDF et fichiers non-HTML ?

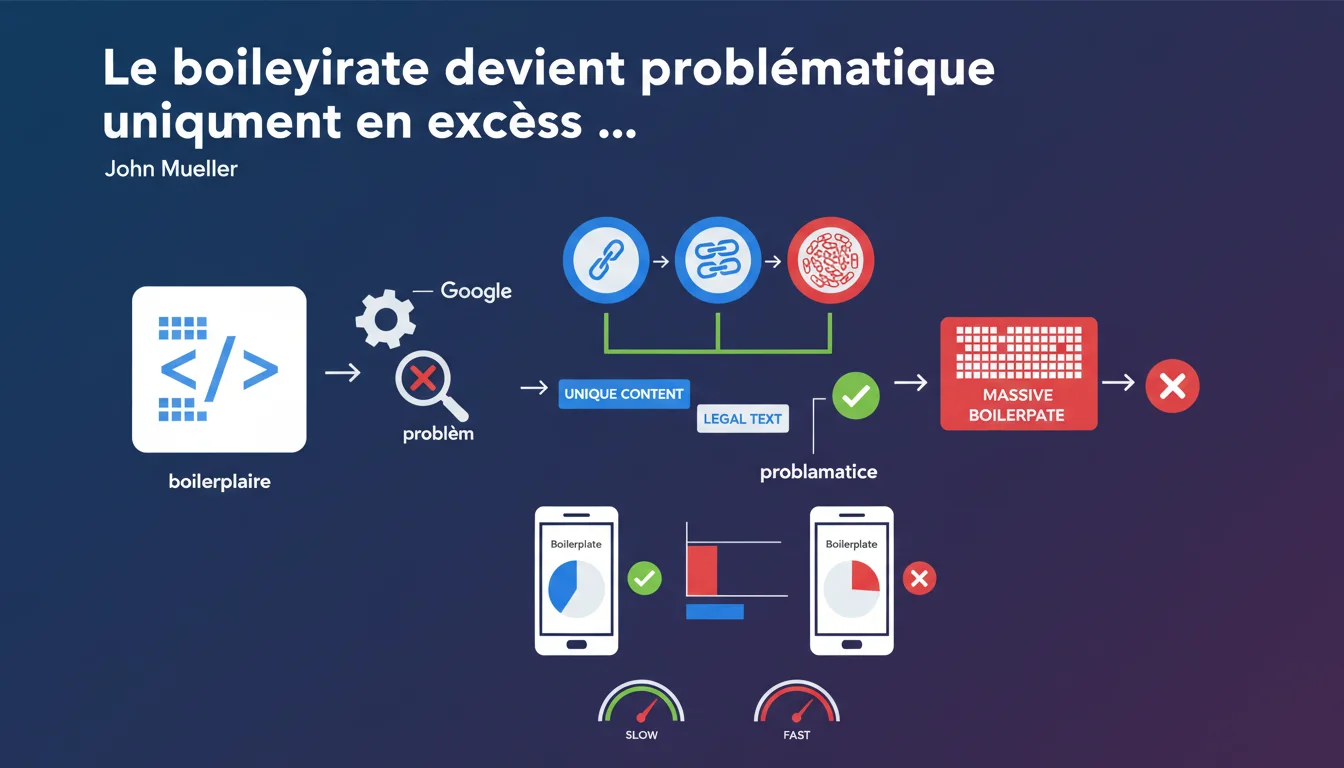

Google tolère parfaitement le contenu répétitif (boilerplate) tant qu'il ne représente pas la majorité du contenu de vos pages. Ajouter des mentions légales, des disclaimers ou des textes standards sur des pages ayant déjà du contenu unique ne crée aucun problème de duplication. Le seuil critique se situe lorsque le boilerplate devient la composante principale du site.

Ce qu'il faut comprendre

Qu'est-ce que Google considère exactement comme du boilerplate problématique ?

Le boilerplate désigne tous ces éléments répétitifs qui apparaissent sur plusieurs pages : mentions légales, footers standard, barres latérales identiques, disclaimers, formulaires de contact dupliqués. Google fait ici une distinction capitale entre présence et proportion.

La déclaration de Mueller établit que le problème survient uniquement quand ce contenu répétitif constitue la majorité du contenu de vos pages. En clair : si votre page contient 200 mots de contenu unique et 50 mots de boilerplate, vous êtes largement dans les clous.

Pourquoi cette tolérance de Google sur le contenu répétitif ?

L'algorithme a suffisamment évolué pour distinguer le contenu éditorial principal du contenu structurel. Google sait identifier ce qui est navigation, footer, sidebar — et ne pénalise pas leur présence récurrente.

Le moteur cherche à évaluer la valeur ajoutée unique de chaque page. Tant qu'une portion substantielle du contenu est spécifique et apporte quelque chose de distinct, le reste est considéré comme du bruit technique normal.

Quel est le seuil qui fait basculer dans le problème ?

Mueller parle de « majorité des pages » composées de boilerplate. C'est volontairement flou — pas de pourcentage précis annoncé. Le signal d'alarme se déclenche quand votre site devient une coquille vide avec du contenu unique anecdotique.

Concrètement, si 80% de vos pages affichent 30 mots uniques noyés dans 200 mots de texte répétitif, vous entrez dans la zone rouge. Google considère alors que votre site n'apporte pas suffisamment de contenu différencié par URL.

- Le boilerplate n'est pas un problème en soi — c'est sa proportion qui compte

- Google distingue le contenu éditorial du contenu structurel répétitif

- Le risque apparaît quand le contenu unique devient minoritaire sur la majorité des pages

- Ajouter des mentions légales sur des pages riches en contenu ne crée aucun problème

- Pas de seuil chiffré officiel — la logique est qualitative, pas mathématique

Avis d'un expert SEO

Cette déclaration correspond-elle aux observations terrain ?

Totalement. On observe depuis des années que les sites avec des footers costauds, des sidebars récurrentes ou des disclaimers systématiques ne sont pas pénalisés tant que le contenu principal reste solide. Les sites e-commerce avec leurs CGV, politiques de retour et autres blocs répétitifs rankent parfaitement.

Par contre, les fermes de contenu qui génèrent 5000 pages avec 95% de template identique et 5% de variation cosmétique — celles-là disparaissent effectivement des index ou stagnent en profondeur. Le pattern est clair : Google tolère la répétition structurelle, mais sanctionne la dilution de valeur.

Quelles nuances faut-il apporter à cette position officielle ?

Mueller parle de « majorité des pages » sans préciser si c'est en volume de pages ou en volume de contenu par page. C'est crucial. Un site peut avoir 20% de ses URLs avec trop de boilerplate — si ces pages représentent 80% du crawl budget ou des impressions, le problème existe quand même.

Autre angle mort : il ne mentionne pas le near-duplicate content. Des pages avec 80% de contenu unique mais structurellement identiques (même plan, mêmes H2, variations minimales) peuvent créer des problèmes de cannibalisation même sans boilerplate excessif. [A vérifier] : Google traite-t-il le near-duplicate de la même façon que le boilerplate ?

Dernier point — la définition de « contenu unique » n'est pas précisée. S'agit-il de contenu textuellement unique ou de contenu informationnellement unique ? Une reformulation automatisée de 200 mots reste du contenu pauvre même sans duplication stricto sensu.

Dans quels cas cette règle devient-elle insuffisante ?

Les sites multilingues ou multi-régions se retrouvent souvent avec des structures quasi-identiques par langue. Techniquement, ce n'est pas du boilerplate au sens strict — mais l'effet est similaire si la traduction est médiocre ou automatisée. Google peut alors considérer l'ensemble comme du contenu faible.

Les sites avec pagination extensive créent un autre cas limite. Vos pages 2, 3, 4… d'une catégorie partagent 95% de leur structure. Si le contenu éditorial unique (intros de catégorie, descriptions) est absent ou minimal, vous tombez dans le schéma « majorité de boilerplate » sans l'avoir cherché.

Impact pratique et recommandations

Comment auditer le ratio boilerplate/contenu unique sur votre site ?

Prenez un échantillon représentatif de vos templates de pages (homepage, catégorie, fiche produit, article de blog). Pour chacun, identifiez visuellement ce qui est répétitif (header, footer, sidebar, disclaimers) versus ce qui est spécifique à la page.

Mesurez en nombre de mots. Si votre contenu unique descend sous 60-70% du total visible, vous entrez dans une zone de risque. Sous 50%, c'est problématique. Un outil comme Screaming Frog peut extraire le texte par blocs pour automatiser cette analyse sur des milliers d'URLs.

Quelles actions correctives mettre en place si vous êtes en excès de boilerplate ?

Première solution : enrichir le contenu unique. Ajoutez des descriptions de catégories, des intros contextuelles, des blocs éditoriaux spécifiques. L'objectif est de renverser le ratio en faveur du contenu différencié.

Deuxième levier : nettoyer le boilerplate superflu. Ces trois paragraphes de mentions légales répétés sur chaque page produit ? Condensez-les ou déplacez-les vers un lien footer. Cette sidebar avec 15 liens récurrents ? Allégez ou rendez-la contextuelle.

Troisième option pour les cas extrêmes : désindexer ou consolider. Si certaines pages n'apportent aucune valeur unique et sont essentiellement du template, mettez-les en noindex ou fusionnez-les. Mieux vaut 100 pages solides que 1000 coquilles vides.

Comment prévenir ce problème sur les nouveaux contenus et architectures ?

Établissez une charte éditoriale avec des minimums de contenu unique par type de page. Exemple : 300 mots uniques minimum pour une catégorie, 150 pour une fiche produit. Ces seuils garantissent que le boilerplate reste minoritaire.

Lors de la conception de vos templates, pensez modularité. Plutôt qu'un footer de 500 mots identique partout, créez des versions light pour certaines pages ou rendez certains blocs conditionnels selon le contexte.

- Auditer le ratio boilerplate/unique sur un échantillon de chaque type de page

- Viser au minimum 60-70% de contenu unique par page

- Enrichir systématiquement les pages pauvres en contenu spécifique

- Nettoyer les éléments répétitifs superflus ou les condenser

- Désindexer les pages sans valeur unique réelle

- Établir des minimums de contenu unique dans vos guidelines éditoriales

- Concevoir des templates modulables plutôt que rigides

- Monitorer régulièrement les nouvelles sections pour éviter la dérive

❓ Questions frequentes

Faut-il supprimer les mentions légales de mes pages pour éviter le boilerplate ?

Mon site e-commerce a des fiches produits courtes avec beaucoup de footer — est-ce risqué ?

Le boilerplate dans les sidebars compte-t-il dans le calcul de Google ?

Existe-t-il un pourcentage précis de boilerplate à ne pas dépasser ?

Les pages de pagination avec peu de contenu éditorial sont-elles concernées ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 25/04/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.