Declaration officielle

Autres déclarations de cette vidéo 7 ▾

- □ Les liens internes sont-ils vraiment traités comme des signaux UX par Googlebot ?

- □ Googlebot découvre-t-il vraiment vos pages grâce aux liens internes ?

- □ Pourquoi Google insiste-t-il pour que les liens restent de vrais liens HTML ?

- □ Le texte d'ancrage significatif est-il encore un levier SEO décisif ?

- □ Pourquoi trop de liens internes peuvent-ils nuire à votre SEO ?

- □ Comment trouver le bon équilibre dans la quantité de liens internes ?

- □ Pourquoi Google insiste-t-il encore sur l'importance des liens internes pour la navigation et la découverte de contenu ?

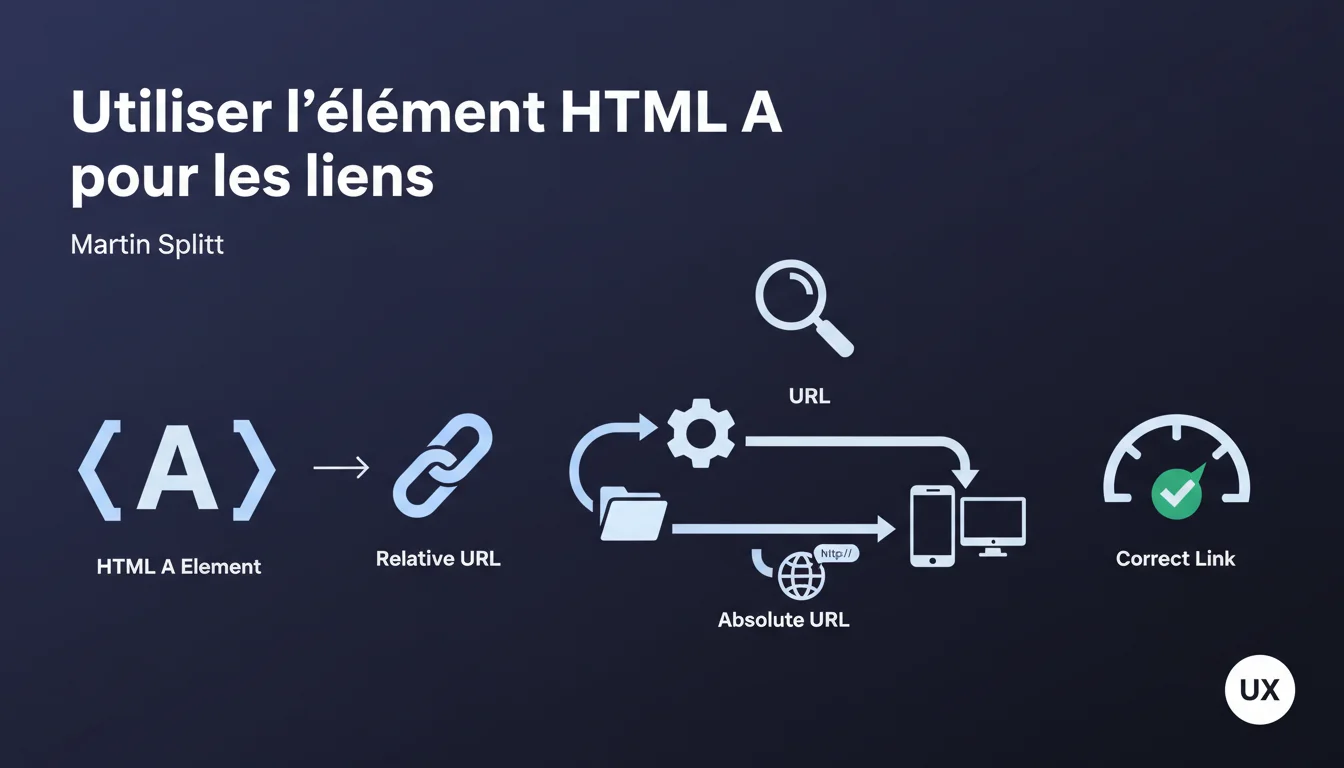

Google exige l'utilisation de l'élément HTML <a> avec un attribut href valide pour qu'un lien soit reconnu et suivi par ses robots. URL relative ou absolue, peu importe — mais sans <a> et href, votre lien n'existe tout simplement pas pour Googlebot. Une évidence technique souvent négligée dans les sites modernes en JavaScript.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur l'élément alors que d'autres solutions existent ?

Googlebot se base sur les standards HTML pour identifier les liens. L'élément avec href est le seul moyen natif et universel de signaler un lien dans le DOM. Les frameworks JavaScript modernes (React, Vue, Angular) créent parfois des pseudo-liens via onclick, div cliquables ou routing côté client — invisibles pour le crawler.

La déclaration de Martin Splitt rappelle un fondamental : si vous voulez que Google découvre et indexe vos pages, utilisez des vraies balises . Pas de détournement, pas de bidouille. Le moteur peut interpréter du JavaScript, certes, mais ne garantit aucune découverte fiable si vous cassez la structure HTML de base.

Quelle différence entre URL relative et absolue dans l'attribut href ?

Google accepte les deux syntaxes sans préférence. Une URL relative (ex: /page-exemple) est résolue par le navigateur et Googlebot à partir du domaine en cours. Une URL absolue (ex: https://example.com/page-exemple) est explicite.

En pratique ? Les URLs relatives simplifient la migration entre environnements (dev, staging, prod) et réduisent le poids HTML. Les URLs absolues éliminent tout risque d'ambiguïté — notamment dans les contenus syndiqués ou les flux RSS. Tant que l'attribut href contient une valeur exploitable, Google suit le lien.

Que se passe-t-il si un lien n'a pas d'attribut href ?

Simple : Google l'ignore. Un sans href n'est pas un lien au sens HTML — c'est une ancre vide, techniquement invalide. Les navigateurs n'affichent aucun comportement de lien (pas de hover, pas de clic droit "Ouvrir dans un nouvel onglet"). Googlebot, lui, ne voit rien à crawler.

Certains développeurs utilisent <a onclick="..."> sans href pour déclencher du JavaScript. Erreur classique : le lien n'existe que côté client, après exécution. Si le JS plante ou tarde, le lien disparaît. Google peut tenter de l'interpréter, mais aucune garantie — et surtout, aucune transmission de PageRank.

- L'élément avec href est le seul lien valide reconnu nativement par Googlebot

- URL relative ou absolue : les deux fonctionnent, choisissez selon votre contexte technique

- Pas de href = pas de lien pour le crawler, même si le clic fonctionne en JavaScript

- Les pseudo-liens (div onclick, boutons sans href) ne transmettent ni découverte ni PageRank

- Frameworks modernes : vérifiez que le routing génère bien des dans le HTML final

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les pratiques observées sur le terrain ?

Oui — et c'est même l'un des rares points où Google ne bouge pas d'un pouce depuis 20 ans. Pas de , pas de lien. Les audits SEO révèlent régulièrement des sites entiers construits avec des div onclick ou des boutons Material Design sans href. Résultat : des pages orphelines, un maillage interne inexistant côté crawler, un PageRank qui ne circule pas.

Le problème s'aggrave avec les Single Page Applications (SPA). Certains frameworks génèrent des liens uniquement après hydratation JavaScript — trop tard pour un crawler pressé ou un budget crawl limité. Google peut interpréter le JS, mais Martin Splitt rappelle ici la base : ne comptez pas sur le JavaScript pour structurer votre crawl. Servez du HTML propre dès le départ.

Dans quels cas cette règle ne s'applique-t-elle pas strictement ?

Soyons honnêtes : Google tente d'interpréter certains patterns JavaScript courants. Si un framework populaire (Next.js, Nuxt) génère des liens via <Link> qui se transforment en valides après rendu, Googlebot suivra. Mais attention : ce n'est pas garanti à 100% dans tous les contextes (timeout JS, ressources bloquées, budget crawl épuisé).

Autre nuance : les liens découverts via sitemaps XML ou redirections internes n'ont pas besoin d'être cliquables dans le HTML pour être crawlés. Mais ils ne bénéficient d'aucun signal de PageRank interne si aucun lien HTML classique ne les pointe. [À vérifier] L'impact réel sur le ranking d'une page découverte uniquement par sitemap, sans lien HTML entrant, reste flou — Google ne quantifie jamais cette différence publiquement.

Quelles erreurs critiques voit-on encore régulièrement ?

Première place : les menus de navigation en JavaScript pur, sans fallback HTML. Le menu s'affiche pour l'utilisateur, mais Googlebot voit une page vide ou un simple <div id="nav"></div>. Résultat : les catégories principales du site ne sont jamais crawlées depuis la homepage.

Deuxième erreur fréquente : les liens paginés générés dynamiquement ("Charger plus", infinite scroll). Si le bouton déclenche un fetch() sans générer de vrais liens vers /page-2, /page-3, etc., Google ne découvre jamais les pages suivantes. Le contenu existe, mais reste invisible.

<a href>. Toujours vérifier le HTML final rendu, pas seulement l'aperçu visuel dans l'éditeur.Impact pratique et recommandations

Que faut-il vérifier concrètement sur votre site ?

Inspectez le HTML source brut (Ctrl+U dans Chrome, pas l'inspecteur). Cherchez tous vos liens de navigation, catégories, produits. Si vous ne voyez pas <a href="..."> directement dans le source, c'est que le lien est généré en JavaScript — risque de non-découverte.

Testez avec l'outil d'inspection d'URL dans Google Search Console. Regardez la section "HTML rendu" : les liens sont-ils présents ? Comparez avec le HTML source. Si un décalage important existe, votre JavaScript retarde ou bloque la découverte.

Quelles erreurs éviter absolument ?

Ne jamais utiliser <div onclick="..."> ou <button onclick="..."> pour simuler un lien. Même si vous ajoutez du CSS pour l'effet hover, Google n'y voit pas un lien. Pas de transmission de PageRank, pas de crawl, pas d'indexation des pages cibles.

Évitez les frameworks qui ne génèrent les liens qu'après hydratation client-side. Si vous utilisez React, Next.js, Nuxt ou Gatsby, vérifiez que le SSR (Server-Side Rendering) ou SSG (Static Site Generation) produit bien des dans le HTML initial. Un CSR pur (Client-Side Rendering) est un cauchemar pour le SEO.

Ne comptez jamais sur le sitemap XML comme unique moyen de découverte. Un sitemap guide Googlebot, mais ne remplace pas le maillage interne. Une page sans aucun lien HTML entrant reste fragile, même si elle figure dans le sitemap.

Comment auditer rapidement l'ensemble de votre site ?

Lancez un crawl avec Screaming Frog ou Oncrawl en mode "JavaScript Rendering" désactivé. Comparez le nombre de pages découvertes avec un crawl JavaScript activé. Si l'écart est massif (>20%), votre architecture dépend trop du JS pour la découverte.

Vérifiez également la profondeur de crawl : si vos pages importantes sont à 5+ clics de la homepage via des liens HTML, c'est un signal de maillage défaillant. Googlebot privilégie les pages proches de la racine — et le PageRank aussi.

- Inspecter le HTML source (Ctrl+U) pour vérifier la présence de

<a href>natifs - Tester l'URL dans Google Search Console, comparer HTML source et HTML rendu

- Éliminer tous les pseudo-liens (div, button) sans attribut href

- Vérifier que le framework génère des valides dès le SSR/SSG, pas après hydratation

- Crawler le site avec et sans JavaScript pour mesurer l'écart de découverte

- Contrôler la profondeur de crawl : pages stratégiques à ≤3 clics de la homepage

- Ne jamais compter uniquement sur le sitemap XML pour la découverte

❓ Questions frequentes

Google suit-il les liens générés dynamiquement en JavaScript ?

Peut-on utiliser des URLs relatives dans l'attribut href sans risque SEO ?

Un lien <a> sans href transmet-il du PageRank ?

Les frameworks modernes (React, Vue) génèrent-ils automatiquement des liens valides ?

Le sitemap XML compense-t-il l'absence de liens HTML internes ?

🎥 De la même vidéo 7

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 23/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.