Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Le crawl budget est-il vraiment négligeable pour votre site ?

- □ Faut-il publier plus souvent pour être crawlé plus régulièrement par Google ?

- □ Faut-il vraiment s'inquiéter de la duplication de contenu interne ?

- □ Le contenu récent bénéficie-t-il vraiment d'un boost de ranking automatique ?

- □ Le hreflang fonctionne-t-il vraiment page par page et non pour tout un site ?

- □ Comment Google mesure-t-il réellement la Page Experience dans son algorithme ?

- □ Chrome et Analytics influencent-ils vraiment le classement Google ?

- □ Le hreflang modifie-t-il vraiment le ranking ou se contente-t-il de permuter les URLs ?

- □ Faut-il vraiment choisir entre redirection 301 et canonical pour une migration ?

- □ Top Stories sans AMP : faut-il encore optimiser la vitesse de vos pages ?

- □ Search Console compte-t-elle vraiment toutes vos impressions SEO ?

- □ Le nofollow empêche-t-il vraiment l'indexation d'une page ?

- □ Pourquoi Google refuse-t-il d'indexer certaines pages de votre site ?

- □ Faut-il supprimer les pages à faible trafic pour améliorer son SEO ?

- □ Les erreurs de balisage breadcrumb entraînent-elles une pénalité Google ?

- □ Le contenu unique booste-t-il vraiment le ranking global d'un site ?

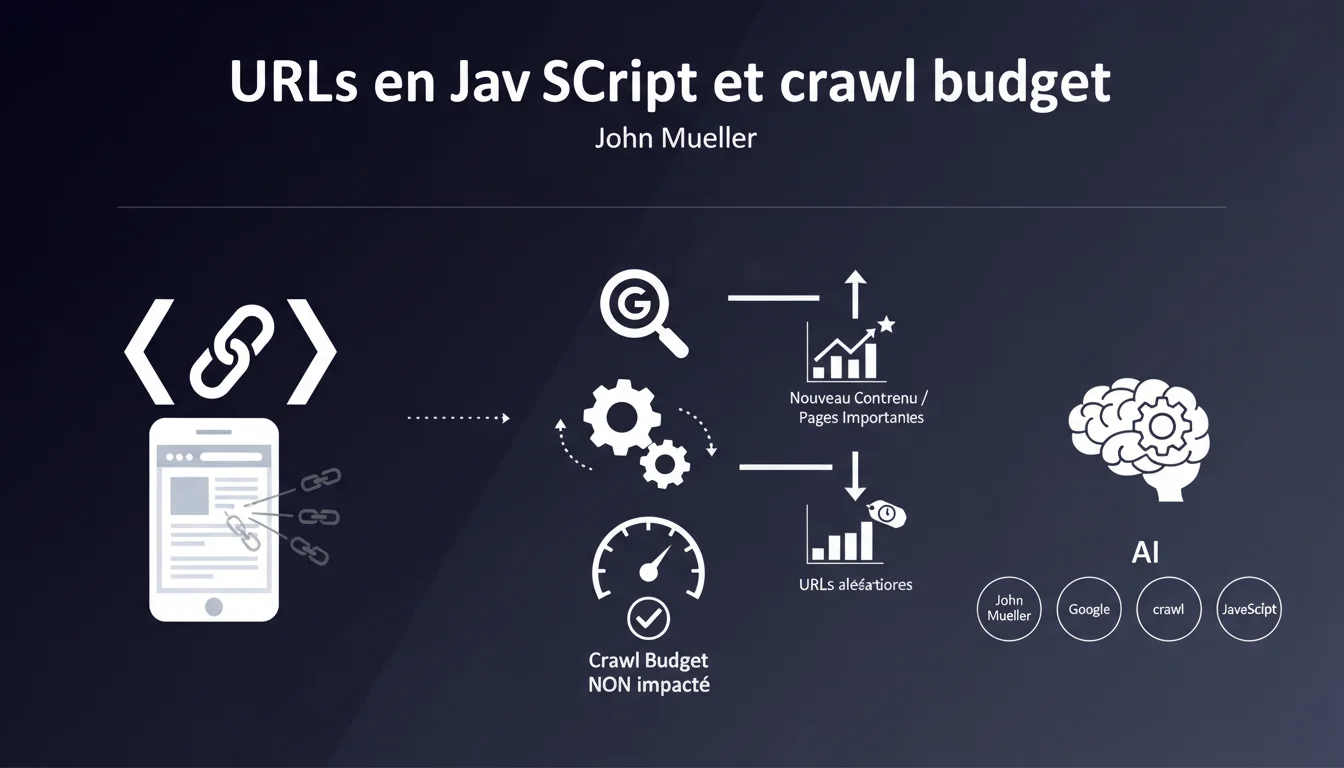

Google affirme que les URLs découvertes via JavaScript ou mentionnées de manière aléatoire n'impactent pas négativement le crawl budget. Ces URLs reçoivent une priorité faible, le moteur privilégiant systématiquement le contenu neuf et les pages importantes. Concrètement, pas de panique si votre JavaScript génère des URLs secondaires.

Ce qu'il faut comprendre

Pourquoi Google fait-il cette distinction entre URLs JavaScript et URLs classiques ?

Google opère une hiérarchisation stricte dans son processus de crawl. Les URLs découvertes dans du code JavaScript — souvent issues de composants dynamiques, de scripts tiers ou de frameworks — sont systématiquement placées en bas de la file d'attente.

Cette priorisation repose sur un constat simple : ces URLs sont rarement des pages stratégiques. Elles peuvent être des artefacts techniques, des liens générés automatiquement ou des références sans valeur SEO directe. Google préfère donc investir son temps de crawl sur des signaux plus fiables.

Qu'entend Mueller par "URLs mentionnées aléatoirement" ?

Il s'agit d'URLs qui apparaissent sans structure logique dans votre code — par exemple dans des commentaires JavaScript, des logs de debug, ou des attributs data-* mal configurés. Ces mentions créent du bruit dans le graphe de liens sans apporter de valeur éditoriale.

Google a appris à filtrer ce bruit. Le moteur distingue désormais les liens intentionnels (navigation, maillage interne structuré) des références techniques fortuites. Résultat : ces dernières ne drainent pas les ressources de crawl allouées à votre site.

Le crawl budget est-il vraiment protégé dans tous les cas ?

La déclaration de Mueller sous-entend une protection automatique, mais elle reste floue sur les volumes. Si votre JavaScript génère des dizaines de milliers d'URLs parasites, l'impact reste à mesurer concrètement selon votre contexte.

- Priorisation active : Google classe les URLs par importance avant de crawler

- Filtrage du bruit : Les URLs aléatoires ou sans valeur éditoriale sont déprioritisées

- Pas d'impact négatif direct : Ces découvertes ne consomment pas le budget alloué aux pages stratégiques

- JavaScript = file d'attente longue : Les URLs JS passent après le contenu HTML standard et les pages à forte valeur

Avis d'un expert SEO

Cette affirmation correspond-elle aux observations terrain ?

Dans la majorité des cas, oui. Les sites que j'audite ne montrent pas de corrélation directe entre volume d'URLs JavaScript découvertes et ralentissement du crawl sur les pages stratégiques. Les logs serveur confirment que Googlebot maintient un rythme stable sur les URLs prioritaires même quand le JS génère du bruit.

Mais — et c'est là que ça coince — cette déclaration cache une nuance importante : tout dépend de votre crawl budget de départ. Sur un petit site avec un budget limité, même une priorisation intelligente peut créer des délais d'indexation si vous multipliez les URLs parasites. [A verifier] sur votre propre site avec une analyse de logs précise.

Quelles situations échappent à cette règle ?

Mueller parle d'URLs "aléatoires", mais tous les liens JavaScript ne sont pas égaux. Si votre framework génère des URLs canoniques valides pointant vers du contenu réel — par exemple une SPA avec du routing côté client — Google les traite différemment.

Le vrai problème surgit avec les sites hybrides : une partie en HTML classique, une partie en JavaScript lourd, sans séparation claire. Dans ce cas, Google doit arbitrer entre deux architectures, et les signaux se brouillent. La "priorité faible" devient alors un purgatoire d'indexation où certaines pages attendent des semaines.

Faut-il pour autant ignorer le problème ?

Non. Même si Google gère la priorisation, chaque URL découverte consomme des ressources de traitement — parsing, analyse de duplication, tentative de classement. Sur un site à faible autorité, cette friction peut retarder l'indexation de nouveaux contenus stratégiques.

Et soyons honnêtes : compter sur l'intelligence de Google pour compenser une architecture bancale, c'est une stratégie risquée. Mieux vaut concevoir proprement dès le départ que de croiser les doigts en espérant que l'algorithme fera le tri correctement.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser cette situation ?

Commencez par auditer vos logs serveur pour identifier quelles URLs JavaScript Google découvre réellement. Utilisez un outil comme Screaming Frog en mode JavaScript activé, puis croisez avec les données de crawl réelles. Vous verrez rapidement si des patterns parasites émergent.

Ensuite, nettoyez à la source. Si votre framework génère des URLs inutiles, ajustez la configuration ou utilisez le robots.txt pour bloquer les patterns évidents. Pour les URLs découvertes mais sans valeur, le noindex via JavaScript fonctionne — à condition que Google exécute bien le script.

Quelles erreurs éviter absolument ?

Ne confondez pas "priorité faible" avec "ignoré". Google crawlera ces URLs — juste plus tard. Si elles renvoient des 404 ou des erreurs serveur, vous accumulerez quand même des signaux négatifs dans la Search Console.

Autre piège : croire que parce que Google filtre le bruit, vous pouvez laisser traîner n'importe quoi. Un site technique propre reste un signal de qualité globale. Les URLs parasites, même déprioritisées, diluent ce signal.

- Analyser les logs serveur pour identifier les URLs JavaScript crawlées par Googlebot

- Croiser ces données avec un crawl JavaScript de votre site pour repérer les patterns parasites

- Bloquer via robots.txt les répertoires ou patterns d'URLs sans valeur SEO

- Ajouter des balises noindex sur les pages JavaScript non stratégiques si nécessaire

- Surveiller la Search Console pour détecter l'apparition massive d'URLs découvertes non indexées

- Optimiser le maillage interne HTML pour renforcer les signaux sur les pages prioritaires

- Tester le rendering JavaScript avec l'outil d'inspection d'URL pour vérifier que Google voit bien ce que vous attendez

Comment vérifier que votre architecture respecte les bonnes pratiques ?

Utilisez l'outil d'inspection d'URL de la Search Console sur quelques pages JavaScript typiques. Comparez la version crawlée par Google avec ce que voient vos utilisateurs. Si des URLs parasites apparaissent dans la version crawlée, vous avez un problème d'architecture à corriger.

Suivez aussi l'évolution du ratio "découvertes / indexées" dans la Search Console. Un écart qui se creuse brutalement peut signaler que Google découvre massivement des URLs sans valeur via JavaScript. C'est un indicateur à surveiller mensuellement.

❓ Questions frequentes

Les liens en JavaScript sont-ils pris en compte pour le PageRank interne ?

Dois-je bloquer systématiquement les URLs JavaScript inutiles dans le robots.txt ?

Mon site SPA en React est-il pénalisé par cette logique de priorisation ?

Comment savoir si mes URLs JavaScript consomment trop de crawl budget ?

Les frameworks JavaScript modernes (Next.js, Nuxt) échappent-ils à ce problème ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.