Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Le crawl budget est-il vraiment négligeable pour votre site ?

- □ Faut-il vraiment s'inquiéter de la duplication de contenu interne ?

- □ Le contenu récent bénéficie-t-il vraiment d'un boost de ranking automatique ?

- □ Le hreflang fonctionne-t-il vraiment page par page et non pour tout un site ?

- □ Comment Google mesure-t-il réellement la Page Experience dans son algorithme ?

- □ Chrome et Analytics influencent-ils vraiment le classement Google ?

- □ Le hreflang modifie-t-il vraiment le ranking ou se contente-t-il de permuter les URLs ?

- □ Faut-il vraiment choisir entre redirection 301 et canonical pour une migration ?

- □ Top Stories sans AMP : faut-il encore optimiser la vitesse de vos pages ?

- □ Search Console compte-t-elle vraiment toutes vos impressions SEO ?

- □ Les URLs découvertes en JavaScript gaspillent-elles vraiment votre crawl budget ?

- □ Le nofollow empêche-t-il vraiment l'indexation d'une page ?

- □ Pourquoi Google refuse-t-il d'indexer certaines pages de votre site ?

- □ Faut-il supprimer les pages à faible trafic pour améliorer son SEO ?

- □ Les erreurs de balisage breadcrumb entraînent-elles une pénalité Google ?

- □ Le contenu unique booste-t-il vraiment le ranking global d'un site ?

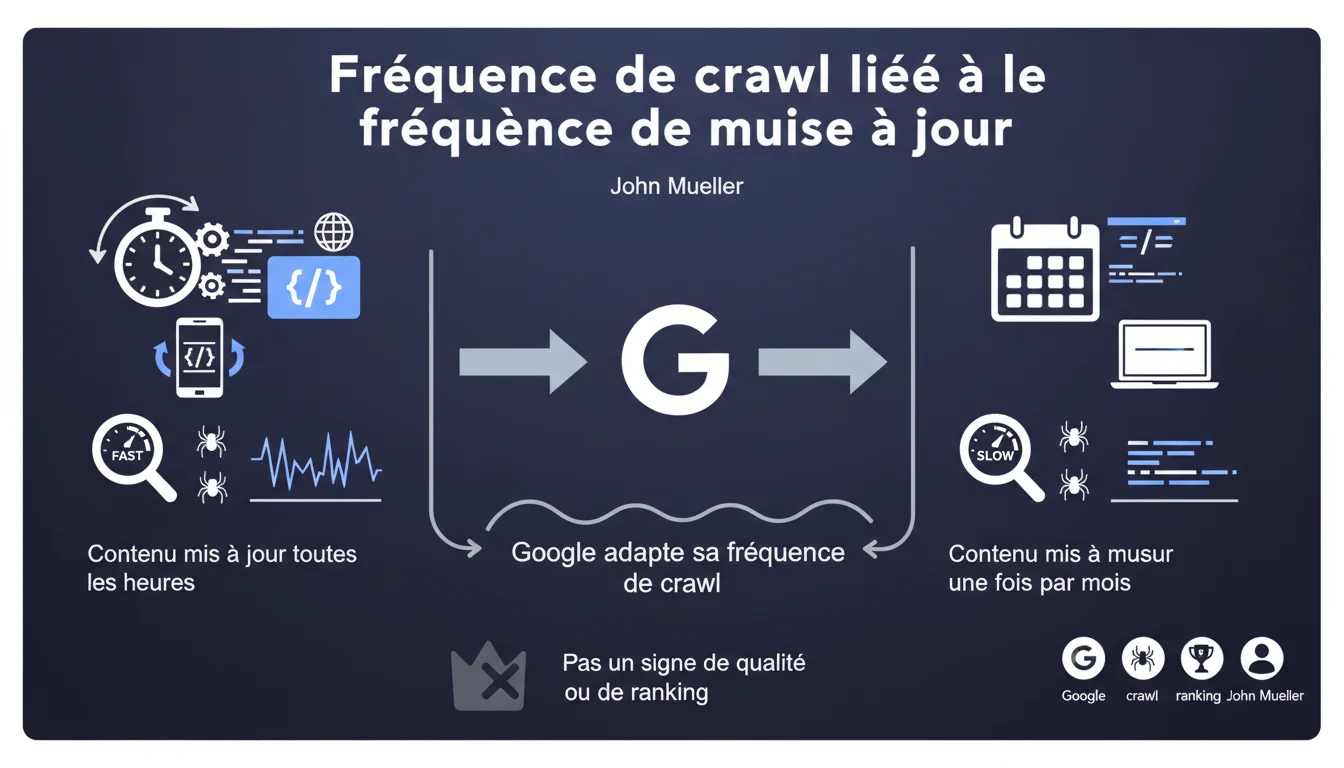

Google adapte automatiquement sa fréquence de crawl en fonction du rythme de mise à jour d'un site. Plus vous publiez régulièrement, plus Googlebot passe souvent. Mais attention : ce n'est pas un levier de ranking direct, juste un ajustement logistique.

Ce qu'il faut comprendre

Pourquoi Google ajuste-t-il sa fréquence de crawl selon le rythme de publication ?

Googlebot n'a pas de temps à perdre. Ses ressources sont limitées et il doit scanner des milliards de pages chaque jour. L'algorithme de crawl apprend donc à optimiser ses passages : un site qui publie toutes les heures mérite qu'on y passe souvent, tandis qu'un site qui dort pendant des mois peut attendre.

C'est une question d'efficacité opérationnelle. Si Googlebot détecte que votre contenu change rarement, il espacera ses visites pour allouer du crawl budget là où c'est vraiment utile. L'inverse est vrai : une fréquence de mise à jour élevée signale au bot qu'il doit revenir régulièrement pour capturer les nouveautés.

Est-ce que ça veut dire qu'un site crawlé souvent ranke mieux ?

Non. Et c'est crucial de bien saisir la nuance.

Mueller est clair : ce n'est pas un signal de qualité. Être crawlé fréquemment ne signifie pas que Google vous apprécie davantage ou que vos pages vont grimper dans les SERPs. C'est juste que le bot adapte sa logistique à vos habitudes éditoriales. Un site d'actualités crawlé toutes les heures n'a pas forcément plus d'autorité qu'un blog technique mis à jour une fois par trimestre.

Quelle est la logique derrière cet ajustement automatique ?

Google cherche à maximiser la fraîcheur de son index tout en minimisant le gaspillage de ressources. Si un site publie quotidiennement mais que Googlebot ne passe qu'une fois par semaine, l'index sera obsolète. À l'inverse, si le bot visite trois fois par jour un site qui ne change jamais, c'est du crawl budget gaspillé.

L'algorithme apprend donc par observation. Il détecte vos patterns de publication, ajuste sa fréquence de visite en conséquence, et réalloue les ressources économisées vers d'autres sites. C'est un système auto-apprenant qui s'adapte en continu.

- Fréquence de crawl ≠ qualité ou ranking

- L'ajustement est automatique et basé sur l'observation des patterns de mise à jour

- Un site mis à jour toutes les heures sera crawlé bien plus souvent qu'un site actualisé mensuellement

- C'est une question d'efficacité opérationnelle, pas de favoritisme algorithmique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec ce qu'on observe sur le terrain ?

Absolument. Les logs serveur ne mentent pas : les sites d'actu avec plusieurs publications par heure voient Googlebot débarquer en continu, tandis que les sites vitrines statiques reçoivent quelques visites par semaine. Rien de surprenant.

Mais — et c'est là que ça devient intéressant — certains SEO en déduisent qu'il faut publier à tout prix pour "rester dans le radar" de Google. C'est une interprétation dangereuse. Mueller enfonce le clou : fréquence de crawl ≠ ranking. Publier du contenu médiocre quotidiennement ne vous sauvera pas si votre qualité est nulle.

Quelles nuances faut-il apporter à cette règle ?

Premier point : la fréquence de crawl dépend aussi de l'autorité du site. Un domaine de confiance avec peu de publications sera crawlé plus souvent qu'un nouveau site qui publie frénétiquement. Le rythme de mise à jour est un facteur parmi d'autres.

Deuxième point : attention au piège de la sur-publication. Si vous actualisez vos pages toutes les heures avec des changements cosmétiques (modification de la date, ajout d'un mot), Googlebot va s'en rendre compte. Et il pourrait réduire sa fréquence de visite s'il détecte que les mises à jour sont insignifiantes. [À vérifier] mais des cas observés suggèrent que Google apprend à distinguer les vraies mises à jour des faux signaux.

Dans quels cas cette règle ne s'applique-t-elle pas vraiment ?

Sur les très gros sites — je parle de millions de pages — la fréquence de crawl est aussi dictée par des contraintes techniques. Même si vous publiez toutes les heures, Googlebot ne crawlera pas l'intégralité de votre site en continu. Il priorisera certaines sections (homepage, rubriques principales) et délaissera les profondeurs.

Autre cas : les sites avec des problèmes techniques récurrents (temps de réponse lents, erreurs 5xx fréquentes) verront leur crawl budget réduit, peu importe leur fréquence de publication. Google protège ses bots des sites instables.

Impact pratique et recommandations

Que faut-il faire concrètement si on veut optimiser sa fréquence de crawl ?

Soyons honnêtes : si votre objectif est d'être crawlé plus souvent, la seule vraie solution est de publier régulièrement du contenu substantiel. Pas des micro-ajustements, pas des dates modifiées artificiellement. Du vrai contenu.

Mais — et c'est crucial — posez-vous d'abord la question : avez-vous vraiment besoin d'une fréquence de crawl élevée ? Si vous gérez un site e-commerce avec des milliers de produits en stock fluctuant, oui. Si vous tenez un blog corporate avec deux articles par mois, non. Pas besoin de forcer.

Quelles erreurs éviter absolument ?

Erreur n°1 : croire qu'en publiant quotidiennement du contenu médiocre, vous allez grimper dans les SERPs. La fréquence de crawl ne fait pas le ranking. Vous serez peut-être crawlé plus souvent, mais si votre contenu est mauvais, ça ne changera rien.

Erreur n°2 : modifier artificiellement vos pages (changer la date, ajouter un mot) pour simuler une mise à jour. Google détecte ces patterns et pourrait réduire votre crawl budget s'il estime que vos mises à jour sont cosmétiques.

Erreur n°3 : négliger les aspects techniques (vitesse serveur, erreurs 5xx, robots.txt mal configuré) en pensant que la fréquence de publication suffit. Un site lent ou instable sera crawlé moins souvent, peu importe son rythme éditorial.

Comment vérifier que mon site est crawlé efficacement ?

Consultez vos logs serveur. C'est la seule source de vérité. Regardez la fréquence des passages de Googlebot, les sections crawlées, les erreurs remontées. La Search Console donne des indications, mais rien ne vaut l'analyse brute des logs.

Si vous détectez un décalage entre votre fréquence de publication et la fréquence de crawl, cherchez d'abord un problème technique. Temps de réponse ? Erreurs serveur ? Budget crawl gaspillé sur des pages inutiles (pagination infinie, facettes non bloquées) ?

- Publiez du contenu substantiel à un rythme régulier — sans forcer si ce n'est pas cohérent avec votre stratégie

- Ne truquez pas les mises à jour : Google apprend à distinguer les vraies nouveautés des faux signaux

- Analysez vos logs serveur pour comprendre les patterns de crawl réels

- Optimisez les aspects techniques : vitesse serveur, erreurs, robots.txt, budget crawl

- Ne confondez pas fréquence de crawl et ranking : l'un n'implique pas l'autre

❓ Questions frequentes

Est-ce qu'augmenter ma fréquence de publication va améliorer mon ranking ?

Comment savoir à quelle fréquence Googlebot visite mon site ?

Si je modifie artificiellement mes pages pour simuler une mise à jour, Google va-t-il crawler plus souvent ?

Un site d'actualités est-il favorisé par rapport à un site statique en termes de ranking ?

Dois-je publier quotidiennement pour maximiser mes chances d'être bien référencé ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.