Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Faut-il publier plus souvent pour être crawlé plus régulièrement par Google ?

- □ Faut-il vraiment s'inquiéter de la duplication de contenu interne ?

- □ Le contenu récent bénéficie-t-il vraiment d'un boost de ranking automatique ?

- □ Le hreflang fonctionne-t-il vraiment page par page et non pour tout un site ?

- □ Comment Google mesure-t-il réellement la Page Experience dans son algorithme ?

- □ Chrome et Analytics influencent-ils vraiment le classement Google ?

- □ Le hreflang modifie-t-il vraiment le ranking ou se contente-t-il de permuter les URLs ?

- □ Faut-il vraiment choisir entre redirection 301 et canonical pour une migration ?

- □ Top Stories sans AMP : faut-il encore optimiser la vitesse de vos pages ?

- □ Search Console compte-t-elle vraiment toutes vos impressions SEO ?

- □ Les URLs découvertes en JavaScript gaspillent-elles vraiment votre crawl budget ?

- □ Le nofollow empêche-t-il vraiment l'indexation d'une page ?

- □ Pourquoi Google refuse-t-il d'indexer certaines pages de votre site ?

- □ Faut-il supprimer les pages à faible trafic pour améliorer son SEO ?

- □ Les erreurs de balisage breadcrumb entraînent-elles une pénalité Google ?

- □ Le contenu unique booste-t-il vraiment le ranking global d'un site ?

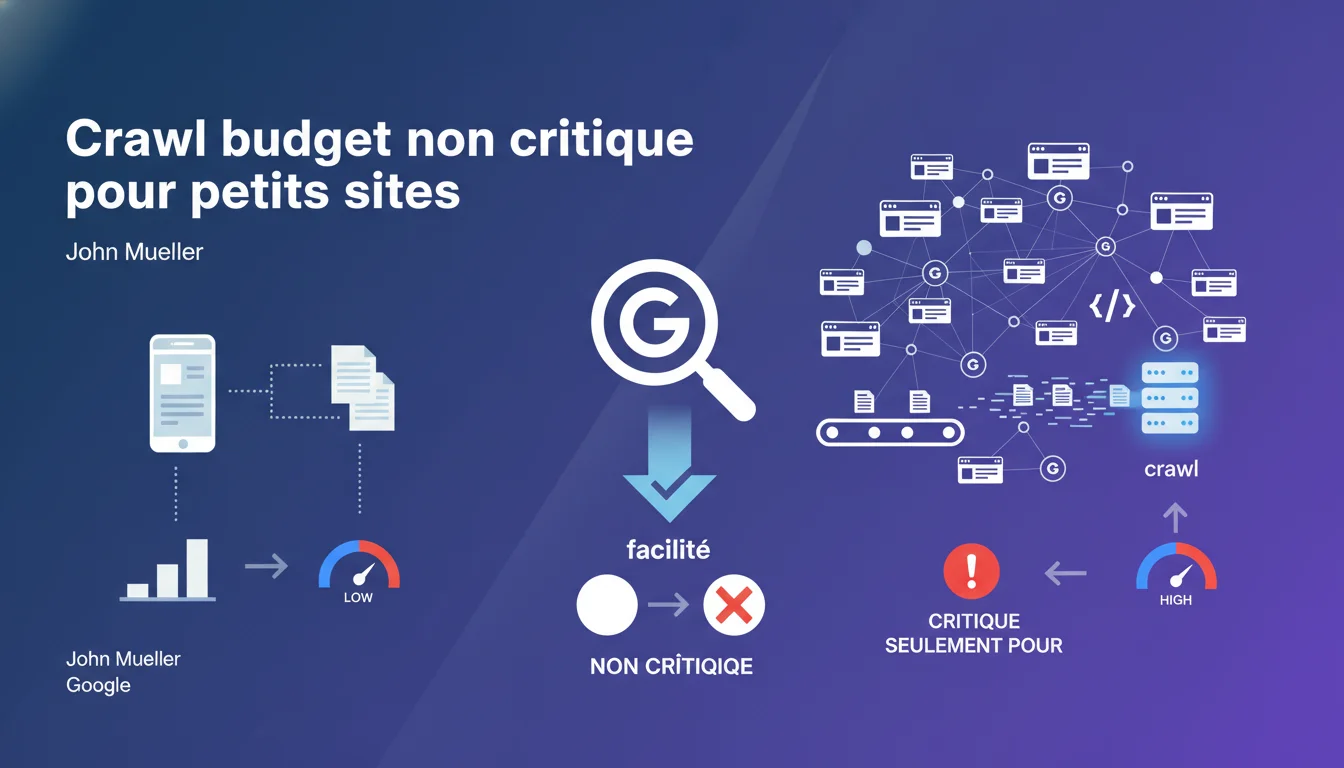

Google affirme que le crawl budget n'est pas un facteur limitant pour les sites publiant jusqu'à 10 000 pages par jour. Ce concept ne devient pertinent qu'à partir de plusieurs millions de pages quotidiennes. La majorité des sites peuvent donc ignorer cette problématique.

Ce qu'il faut comprendre

Qu'est-ce que Google entend par "crawl budget" ?

Le crawl budget représente la quantité de ressources que Googlebot alloue au crawl d'un site sur une période donnée. C'est un équilibre entre la capacité du serveur à répondre et l'intérêt de Google pour le contenu.

Mueller fixe ici un seuil clair : 10 000 pages par jour. En dessous, Google considère que son infrastructure peut absorber le volume sans problème. La limite ne vient donc pas du moteur, mais potentiellement de la qualité du contenu ou de l'architecture du site.

Pourquoi ce seuil de 10 000 pages quotidiennes ?

Ce chiffre n'est pas anodin. Il reflète la puissance de crawl actuelle de Google, capable de traiter massivement des contenus. Pour la plupart des sites e-commerce, médias ou corporate, même avec variations de fiches produits ou articles, ce volume reste inaccessible.

Seuls les agrégateurs massifs, places de marché géantes ou sites à génération automatique atteignent ces ordres de grandeur. Pour eux, la problématique devient réelle : prioriser les URLs à forte valeur, éviter le gaspillage sur du contenu dupliqué ou obsolète.

Qu'est-ce qui change concrètement pour les sites standards ?

Cette déclaration libère les SEO de l'obsession du crawl budget pour 99% des projets. Inutile de sur-optimiser les fichiers robots.txt ou de bloquer agressivement des sections entières par peur de "gaspiller" le budget.

L'énergie doit se concentrer ailleurs : qualité du maillage interne, pertinence du contenu, expérience utilisateur. Le crawl suivra naturellement si l'architecture est saine et le contenu valable.

- Le crawl budget n'est pas un problème pour les sites sous 10 000 pages/jour

- Google peut crawler facilement ces volumes avec son infrastructure actuelle

- La limite devient réelle seulement pour des millions de pages quotidiennes

- Pour la majorité des sites, les problèmes de crawl viennent de l'architecture ou de la qualité, pas du budget

- Pas besoin de bloquer agressivement des sections dans robots.txt par peur du budget

Avis d'un expert SEO

Cette affirmation correspond-elle aux observations terrain ?

Dans ma pratique, cette déclaration se vérifie largement. Les sites qui rencontrent des problèmes de crawl réels souffrent rarement d'un manque de budget pur. Les causes sont presque toujours structurelles : pagination infinie mal gérée, paramètres d'URL explosifs, contenus dupliqués en masse.

Cependant — et c'est là que Mueller simplifie — le crawl budget n'est pas un concept binaire. Un site peut techniquement être crawlé entièrement sur un mois, mais si Google ne passe que tous les 15 jours sur certaines sections, l'indexation de contenu frais ralentit mécaniquement. Le budget existe, mais il ne se manifeste pas comme un mur strict.

Quelles nuances faut-il apporter à cette règle des 10 000 pages ?

Le chiffre de 10 000 pages quotidiennes est une moyenne indicative, pas une loi absolue. Un site avec une autorité faible, des temps de réponse serveur lamentables ou un historique de contenus médiocres verra son crawl limité bien avant ce seuil. [À vérifier] : Google n'a jamais publié de corrélation précise entre autorité de domaine et allocation de crawl.

À l'inverse, un site respecté avec une infrastructure solide peut dépasser largement ces volumes sans friction. Le contexte compte autant que le chiffre brut. Ne prenez pas cette déclaration comme un passe-droit pour négliger votre architecture sous prétexte que "Google peut tout crawler".

Dans quels cas cette règle ne s'applique-t-elle pas ?

Les sites à génération dynamique massive — facettes de recherche infinies, contenus UGC non modérés, archives historiques gigantesques — peuvent rencontrer des limites même sous 10 000 pages/jour si la qualité moyenne est médiocre. Google ajuste son crawl en fonction du ratio signal/bruit.

Impact pratique et recommandations

Que faut-il faire concrètement si vous publiez moins de 10 000 pages par jour ?

Arrêtez de sur-optimiser le crawl budget. Cette obsession détourne l'attention des vrais leviers : architecture logique, temps de chargement, qualité du contenu. Si votre site publie 50, 500 ou même 5 000 pages quotidiennes, Google les crawlera sans problème — à condition qu'elles méritent d'être crawlées.

Concentrez-vous sur le maillage interne. Les pages importantes doivent être accessibles en quelques clics depuis la home. Les sections orphelines ou enfouies à 10 niveaux de profondeur ne seront pas crawlées régulièrement, non par manque de budget, mais parce que Google ne les trouve pas facilement.

Quelles erreurs éviter malgré cette déclaration rassurante ?

Ne confondez pas "Google peut crawler" avec "Google va indexer". Le crawl est une condition nécessaire, pas suffisante. Des pages crawlées mais jugées dupliquées, thin ou sans valeur resteront hors index. L'enjeu n'est pas le volume de crawl, mais la qualité de ce qui est crawlé.

Évitez aussi de bloquer par réflexe dans robots.txt des sections entières sous prétexte d'économiser du budget. Vous risquez de priver Google de contexte utile pour comprendre votre site. Laissez le moteur décider, sauf éléments vraiment inutiles (admin, duplicate techniques, paramètres de session).

Comment vérifier que votre crawl se passe bien ?

Analysez vos logs serveur sur 30 jours. Si Googlebot visite régulièrement vos nouvelles pages et revisite les sections mises à jour, tout va bien. Si certaines URLs stratégiques ne sont jamais crawlées, cherchez le problème dans l'architecture ou le maillage, pas dans une hypothétique limite de budget.

Dans la Search Console, surveillez le rapport de couverture d'index. Les pages "Détectées, actuellement non indexées" signalent souvent un problème de qualité perçue, pas de crawl. Google les a vues, il a juste décidé qu'elles n'apportaient rien.

- Priorisez l'architecture et le maillage interne plutôt que l'optimisation du crawl budget

- Assurez-vous que les pages stratégiques sont accessibles en 3-4 clics maximum depuis la home

- Analysez vos logs serveur pour identifier les patterns de crawl réels

- Ne bloquez pas par défaut dans robots.txt — laissez Google décider sauf cas manifestes

- Surveillez la Search Console pour détecter des pages crawlées mais non indexées (signal qualité)

- Optimisez les temps de réponse serveur pour faciliter le crawl, même si le budget n'est pas limitant

- Évitez les pièges à crawl : pagination infinie, paramètres d'URL explosifs, contenus dupliqués

❓ Questions frequentes

Mon site publie 200 pages par mois, dois-je m'inquiéter du crawl budget ?

Si Google peut crawler 10 000 pages par jour, pourquoi certaines de mes pages ne sont-elles pas indexées ?

Faut-il quand même optimiser mon fichier robots.txt ?

Les sites e-commerce avec variations produits sont-ils concernés par ce seuil de 10 000 pages ?

Comment savoir si mon site a un problème de crawl réel ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 09/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.