Declaration officielle

Autres déclarations de cette vidéo 19 ▾

- □ Faut-il paniquer si votre hreflang disparaît temporairement pendant une migration ?

- □ Faut-il bloquer GoogleOther ou risquer d'impacter ses services Google ?

- □ Les domaines locaux (ccTLD) offrent-ils vraiment un avantage SEO pour le référencement local ?

- □ Pourquoi Google traite-t-il un site après expansion massive comme un tout nouveau site web ?

- □ Pourquoi Google continue-t-il d'afficher l'ancien nom de votre site après un rebranding ?

- □ Faut-il vraiment corriger toutes les erreurs d'indexation signalées dans la Search Console ?

- □ Comment exploiter l'API du tableau de bord de statut Google Search pour vos outils SEO ?

- □ Pourquoi vos données structurées produits n'apparaissent-elles pas dans les résultats enrichis ?

- □ Marque confondue avec un mot courant : faut-il vraiment attendre des mois sans rien faire ?

- □ Comment masquer du texte à Google en bloquant le JavaScript qui le contient ?

- □ Peut-on vraiment utiliser le Schema Recipe pour n'importe quel type de recette ?

- □ Google peut-il transférer vos rankings SEO lors d'une migration de domaine ?

- □ Comment la balise noindex fonctionne-t-elle réellement page par page ?

- □ Faut-il vraiment remplir tous les champs des données structurées pour que Google les prenne en compte ?

- □ Les flux RSS sont-ils vraiment exploités par Google pour l'exploration et l'indexation ?

- □ Pourquoi votre nouveau favicon met-il autant de temps à apparaître dans les résultats Google ?

- □ L'ordre des balises H1, H2, H3 influence-t-il vraiment le classement Google ?

- □ Les liens sur pages bloquées au crawl perdent-ils vraiment toute leur valeur SEO ?

- □ Faut-il vraiment structurer ses sitemaps selon des règles précises ou peut-on faire n'importe quoi ?

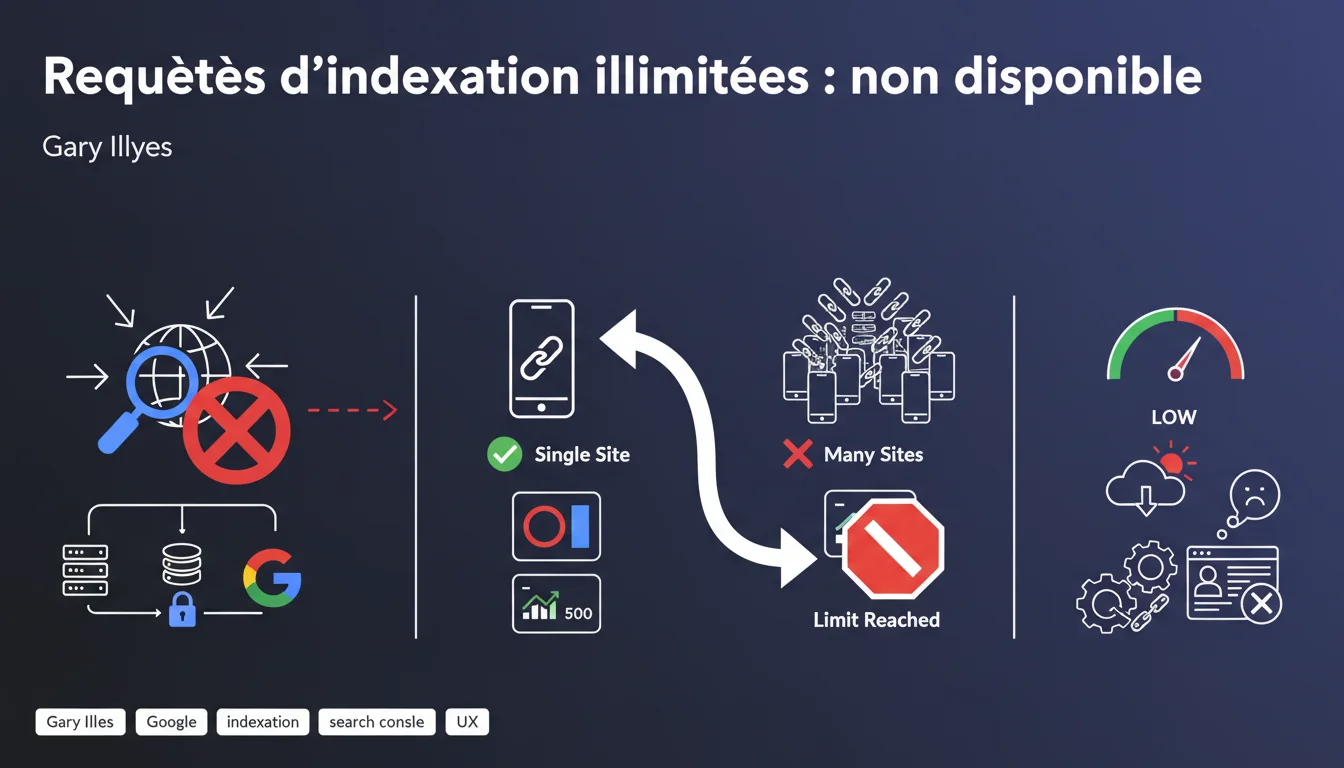

Gary Illyes confirme qu'il n'existe aucun moyen d'obtenir un quota illimité de requêtes d'indexation dans Search Console, même pour les propriétaires de nombreux sites. Cette limite s'applique à tous, sans exception ni négociation possible. Les gestionnaires de gros volumes doivent composer avec les quotas standards imposés par Google.

Ce qu'il faut comprendre

Quelle est la limite actuelle des requêtes d'indexation ?

Google Search Console impose un quota quotidien de requêtes d'indexation qui varie selon plusieurs facteurs : l'ancienneté du site, sa fréquence de crawl, son autorité globale. Concrètement, la plupart des sites tournent autour de 10 à 20 requêtes par jour, parfois moins pour les nouveaux domaines.

Ce quota se réinitialise toutes les 24 heures. Si vous gérez un site avec des centaines de pages nouvelles quotidiennement — e-commerce avec rotations produits, agrégateur de contenu, portail d'annonces — vous atteignez rapidement le plafond.

Pourquoi Google maintient-il ces quotas stricts ?

La réponse officielle tourne autour de la protection des ressources de crawl. Google veut éviter que son infrastructure soit sollicitée massivement par des demandes d'indexation qui court-circuitent son algorithme de priorisation naturelle.

Entre nous ? C'est aussi une façon de forcer les webmasters à optimiser leur architecture plutôt que de compenser les faiblesses structurelles par des requêtes manuelles. Si vous devez soumettre 200 URLs par jour, c'est que votre crawl budget ou votre maillage interne ont un problème.

Les gestionnaires de nombreux sites sont-ils traités différemment ?

Non. Gary Illyes est explicite : même si vous gérez 50 sites via une agence ou une plateforme SaaS, chaque propriété garde son quota individuel standard. Pas de passe-droit, pas de compte « premium » avec indexation prioritaire.

Certains éditeurs espéraient obtenir un statut privilégié en passant par des canaux commerciaux ou des partenariats. Cette déclaration coupe court à toute négociation : les limites sont techniques et uniformes.

- Quota quotidien limité : généralement 10-20 requêtes/jour selon l'autorité du site

- Aucune exception : même pour les gestionnaires multi-sites ou les grandes plateformes

- Réinitialisation 24h : le compteur repart à zéro chaque jour

- Pas de négociation : aucun canal commercial ne permet d'obtenir plus de requêtes

- Signal d'alerte : si vous saturez le quota régulièrement, votre architecture a besoin d'un audit

Avis d'un expert SEO

Cette limitation est-elle justifiée d'un point de vue technique ?

Oui et non. Techniquement, Google a raison de vouloir préserver ses ressources de crawl et éviter que l'outil de requête d'indexation devienne un bouton magique utilisé à outrance. Soyons honnêtes : si ce quota n'existait pas, certains webmasters en abuseraient massivement.

Mais — et c'est là que ça coince — Google reste extrêmement flou sur les critères exacts qui déterminent le quota d'un site. Aucune métrique publique, aucun tableau de bord indiquant où vous en êtes. Vous découvrez la limite en la heurtant. [À vérifier] : Gary ne précise pas si ce quota évolue automatiquement avec l'autorité du site ou s'il reste figé.

Quelles sont les alternatives concrètes pour contourner cette limite ?

Parlons franchement : vous ne « contournez » pas cette limite, vous l'optimisez. La vraie question, c'est de réduire votre dépendance aux requêtes manuelles en améliorant votre découvrabilité naturelle.

Priorité numéro un : le maillage interne. Si Google découvre vos nouvelles pages via des liens internes depuis des sections crawlées quotidiennement, vous n'avez pas besoin de soumettre manuellement. Deuxième levier : le sitemap XML dynamique, mis à jour en temps réel avec lastmod précis. Troisième option pour les gros volumes : privilégier les pages stratégiques dans vos requêtes manuelles et laisser les autres suivre le flux naturel.

Et c'est là que beaucoup se plantent : ils utilisent les requêtes d'indexation pour compenser un problème structurel au lieu de le résoudre. Si votre site produit 100 URLs/jour et que Googlebot n'en découvre que 10 naturellement, ce n'est pas un problème de quota — c'est un problème d'architecture.

Dans quels cas cette règle pose-t-elle un vrai problème métier ?

Les sites d'actualité avec breaking news, les plateformes d'annonces à rotation rapide (emploi, immobilier), les e-commerces avec lancements produits ponctuels limités dans le temps. Dans ces contextes, chaque heure compte et attendre que Googlebot passe naturellement peut faire perdre du trafic.

Google répond généralement que ces sites devraient être crawlés fréquemment s'ils ont suffisamment d'autorité. Vrai en théorie. En pratique ? Même des médias établis constatent des délais d'indexation de plusieurs heures sur des contenus chauds. [À vérifier] : aucune donnée publique ne corrèle clairement « fréquence de crawl » et « quota de requêtes » — on suppose un lien, mais Gary ne le confirme pas ici.

Impact pratique et recommandations

Comment prioriser vos requêtes d'indexation limitées ?

Premier réflexe : abandonnez l'idée de tout soumettre. Concentrez vos requêtes manuelles sur les URLs à forte valeur ajoutée : lancements produits stratégiques, contenus éditoriaux majeurs, pages transactionnelles nouvellement créées. Le reste doit être découvert naturellement.

Concrètement ? Mettez en place un système de scoring interne : priorité 1 pour les pages génératrices de revenus directs, priorité 2 pour les contenus éditoriaux à fort potentiel SEO, priorité 3 pour le reste. Utilisez vos 10-20 requêtes quotidiennes sur les priorités 1, laissez le sitemap et le maillage gérer le reste.

Quelles optimisations structurelles réduisent la dépendance aux requêtes manuelles ?

Votre sitemap XML doit être irréprochable : mis à jour en temps réel, avec balises lastmod précises, segmenté par type de contenu si vous dépassez 10 000 URLs. Google doit pouvoir identifier les nouveautés sans ambiguïté.

Côté maillage interne : chaque nouvelle page doit recevoir au moins 3 liens internes depuis des pages crawlées quotidiennement. Idéalement, intégrez vos nouveautés dans des sections « Derniers articles », « Nouveaux produits », « Mises à jour récentes » présentes sur votre home ou vos catégories principales.

Et — point souvent négligé — vérifiez que votre robots.txt et vos directives crawl ne bloquent pas accidentellement Googlebot sur des sections que vous essayez ensuite de faire indexer manuellement. Ça paraît évident, mais on voit encore ce genre d'incohérence sur des sites de taille moyenne.

Que faire si votre volume de production dépasse structurellement le quota ?

Soyons réalistes : si vous publiez 200 URLs/jour et que Google n'en indexe naturellement que 50, vous avez trois options. Un, réduire le volume et privilégier la qualité. Deux, améliorer radicalement votre architecture pour que Googlebot découvre tout seul. Trois, accepter qu'une partie de votre contenu ne sera pas indexée immédiatement.

Beaucoup de sites sur-produisent par peur du vide, sans analyser le taux de pages indexées générant effectivement du trafic. Si 70% de vos URLs ne reçoivent jamais de visite organique, pourquoi forcer leur indexation ? Concentrez vos efforts et votre quota sur les 30% performants.

- Scorer vos nouvelles URLs par valeur stratégique avant de soumettre

- Auditer votre sitemap XML : structure, lastmod, fréquence de mise à jour

- Cartographier le maillage interne vers vos nouvelles pages (minimum 3 liens)

- Vérifier la cohérence robots.txt / directives crawl / pages soumises

- Analyser le taux de pages indexées générant réellement du trafic

- Mettre en place des sections « nouveautés » sur vos pages à fort crawl

- Tester la vitesse de découverte naturelle avant de soumettre manuellement

- Documenter votre utilisation quotidienne du quota pour identifier des patterns

❓ Questions frequentes

Peut-on augmenter son quota de requêtes d'indexation en contactant Google ?

Le quota de requêtes évolue-t-il avec l'autorité du site ?

Combien de requêtes d'indexation puis-je faire par jour ?

Si je gère plusieurs sites, ai-je un quota global ou par site ?

L'API Indexing de Google est-elle une alternative viable ?

🎥 De la même vidéo 19

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/07/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.