Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Google attribue-t-il vraiment le même poids à tous vos backlinks ?

- □ L'emplacement des liens internes a-t-il vraiment un impact sur le SEO ?

- □ Google classe-t-il vraiment les sites dans des catégories fixes ?

- □ La cohérence NAP impacte-t-elle vraiment le référencement local ou seulement le Knowledge Graph ?

- □ Comment éviter que Google se trompe à cause d'informations conflictuelles entre votre site et votre profil d'établissement ?

- □ Les liens réciproques sont-ils vraiment sans risque pour votre SEO ?

- □ La fréquence des mots-clés influence-t-elle vraiment le classement Google ?

- □ Pourquoi Google refuse-t-il d'indexer une partie de votre site même s'il est techniquement parfait ?

- □ Les emojis dans les balises title et meta description apportent-ils un avantage SEO ?

- □ L'API Search Console et l'interface affichent-elles vraiment les mêmes données ?

- □ Pourquoi vos FAQ n'apparaissent-elles pas en rich results malgré un balisage correct ?

- □ Faut-il vraiment réutiliser la même URL pour les pages saisonnières chaque année ?

- □ Les Core Web Vitals n'affectent-ils vraiment ni le crawl ni l'indexation ?

- □ Pourquoi Google réinitialise-t-il l'évaluation d'un site lors d'une migration de sous-domaine vers domaine principal ?

- □ Le TLD .edu booste-t-il vraiment votre référencement ?

- □ Les géo-redirects peuvent-ils réellement bloquer l'indexation de votre contenu ?

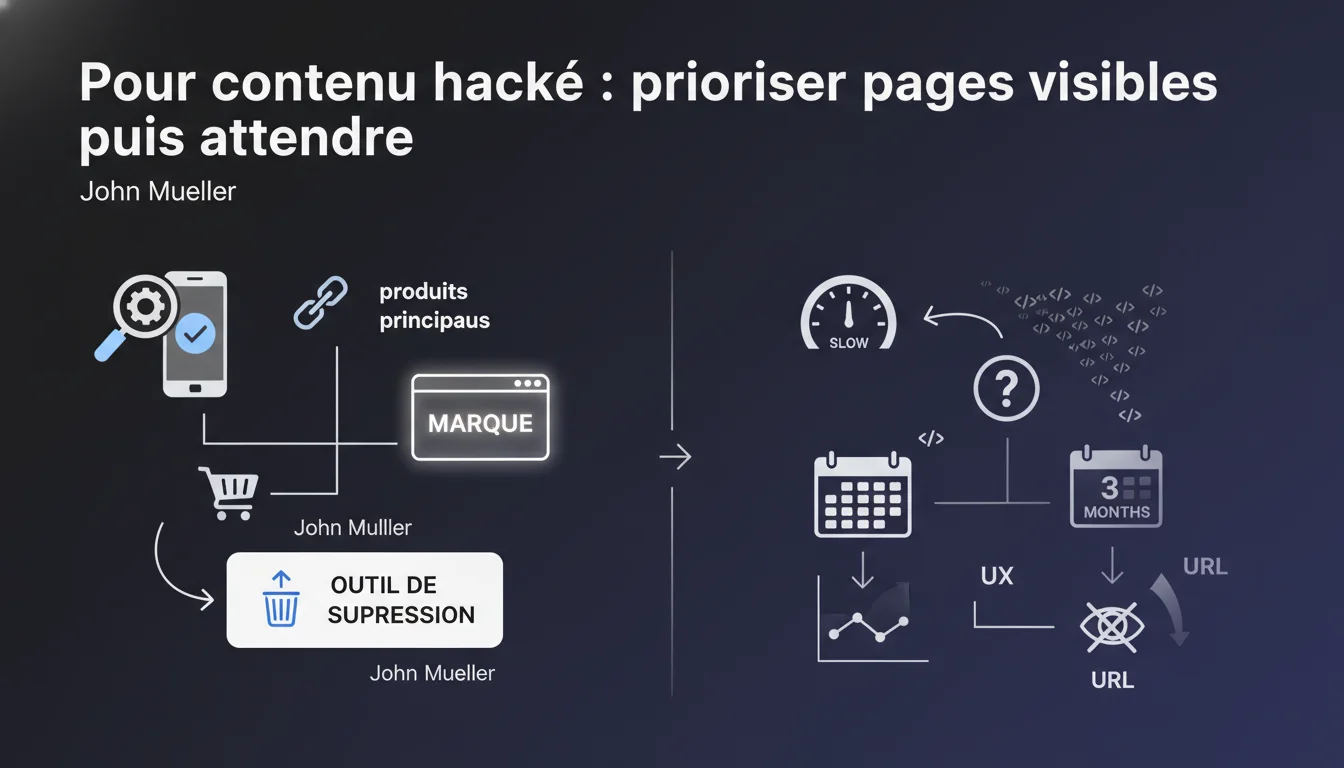

Google recommande de ne nettoyer activement que les pages visibles affectées par du malware (recherches de marque, produits principaux) et d'utiliser l'outil de suppression. Les milliers d'URLs hackées invisibles disparaîtront naturellement sous quelques mois sans intervention. Inutile de perdre du temps sur du contenu que personne ne voit.

Ce qu'il faut comprendre

Pourquoi Google fait-il cette distinction entre pages visibles et invisibles ?

La logique de Google repose sur un principe d'économie de ressources. Quand un site subit un hack massif générant des milliers de pages parasites, nettoyer manuellement chaque URL peut prendre des semaines voire des mois. Or, la majorité de ces pages ne reçoivent aucun trafic et ne nuisent qu'à l'indexation globale.

En priorisant les pages stratégiques — celles qui apparaissent sur les requêtes de marque, les produits phares ou les points d'entrée principaux — on protège immédiatement la visibilité et la réputation du site. Le reste n'est qu'une question de nettoyage de l'index, que Google peut gérer progressivement par lui-même.

Comment Google fait-il disparaître ces pages hackées sans intervention manuelle ?

Une fois le malware éliminé et les pages nettoyées renvoyant des 404 ou 410, Googlebot va progressivement les recrawler. Constatant qu'elles n'existent plus, il les retirera de l'index. Ce processus prend généralement quelques mois, selon la fréquence de crawl du site et le volume d'URLs concernées.

L'outil de suppression d'URLs accélère le retrait des pages les plus visibles, mais il n'est pas conçu pour traiter des milliers d'entrées à la fois — d'où cette recommandation de ciblage sélectif.

Que signifie exactement « invisible aux utilisateurs » dans ce contexte ?

Il s'agit de pages qui ne génèrent aucun trafic organique, n'apparaissent sur aucune requête stratégique, et ne sont pas liées depuis des sections importantes du site. En général, ce sont des URLs créées en masse par des scripts malveillants, indexées par Google mais totalement hors du parcours utilisateur normal.

Si ces pages n'ont jamais reçu de visite, ne sont pas positionnées sur des mots-clés pertinents, et disparaissent dès qu'on nettoie le code malveillant, leur impact réel est quasi nul — hormis l'encombrement de l'index.

- Prioriser les pages visibles : marque, produits phares, points d'entrée principaux

- Utiliser l'outil de suppression d'URLs pour accélérer le retrait des pages stratégiques

- Laisser Google désindexer naturellement les milliers d'URLs invisibles en quelques mois

- Ne pas perdre de temps à nettoyer manuellement ce qui n'a aucun impact utilisateur

- S'assurer que le malware est bien éliminé et que les pages renvoient des codes 404/410

Avis d'un expert SEO

Cette approche pragmatique est-elle vraiment sans risque pour le site ?

Sur le principe, oui — à condition que le nettoyage du malware soit complet. Si des traces de code malveillant subsistent, même sur des pages invisibles, Google peut maintenir une pénalité ou un signal de méfiance. Le vrai danger, c'est de croire qu'on peut ignorer totalement le problème sous prétexte que certaines pages ne sont pas visitées.

L'autre nuance : les pages « invisibles » aujourd'hui peuvent devenir visibles demain si Google décide de les remonter dans l'index pour des requêtes inattendues. J'ai vu des cas où des pages hackées généraient du trafic sur des requêtes périphériques, certes faibles, mais suffisantes pour nuire à la réputation du site. [A vérifier] selon la nature du hack et le secteur d'activité.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Si le hack a généré des backlinks toxiques ou si les pages hackées ont été partagées sur des forums, réseaux sociaux ou sites tiers, leur présence dans l'index peut persister plus longtemps que prévu. Dans ce cas, un nettoyage actif via Search Console et un désaveu ciblé peuvent être nécessaires.

De même, certains sites à forte autorité ou à historique sensible ne peuvent pas se permettre de laisser traîner des milliers d'URLs hackées, même invisibles. La réputation de marque et la confiance des utilisateurs passent avant l'économie de temps.

Quelle est la limite pratique de cette recommandation ?

Google ne précise pas ce qu'il entend par « quelques mois ». Dans mon expérience, cela peut varier de 2 à 6 mois selon la fréquence de crawl du site et le volume d'URLs concernées. Pour un site e-commerce avec un crawl budget limité, ce délai peut s'étendre encore plus — et pendant ce temps, l'index reste pollué.

Autre point : l'outil de suppression d'URLs a des limites de volume. Si vous avez des dizaines de milliers de pages hackées, même cibler les plus visibles peut devenir fastidieux. Dans ces cas, un fichier robots.txt temporaire ou un blocage serveur peut accélérer le processus — mais attention à ne pas bloquer des sections légitimes du site.

Impact pratique et recommandations

Que faut-il faire concrètement après un nettoyage de malware ?

D'abord, identifier les pages à fort trafic affectées par le hack : recherches de marque, produits phares, landing pages principales. Utilisez Search Console pour repérer les URLs hackées qui génèrent encore des impressions ou des clics. Ce sont vos priorités absolues.

Ensuite, soumettez ces URLs via l'outil de suppression d'URLs dans Search Console. N'essayez pas de traiter des milliers d'entrées d'un coup — concentrez-vous sur les 50 à 100 pages les plus critiques. Pour le reste, assurez-vous qu'elles renvoient bien des 404 ou 410 et laissez Google les désindexer naturellement.

Comment vérifier que le nettoyage est vraiment terminé ?

Scrutez vos logs serveur pour détecter d'éventuelles requêtes suspectes ou des tentatives de crawl sur des URLs hackées. Si Googlebot continue de visiter massivement ces pages, c'est qu'elles sont encore dans l'index ou que des backlinks pointent vers elles.

Utilisez des commandes site:votredomaine.com avec des mots-clés typiques du hack (viagra, casino, pharma, etc.) pour identifier les pages encore indexées. Si des résultats apparaissent, accélérez leur suppression via l'outil dédié ou renforcez le nettoyage serveur.

Quelles erreurs éviter dans la gestion post-hack ?

Ne pas bloquer toutes les URLs hackées via robots.txt avant qu'elles ne soient désindexées. Cela empêche Googlebot de constater qu'elles renvoient un 404 et peut ralentir leur retrait de l'index. Laissez-les accessibles jusqu'à ce qu'elles disparaissent, puis bloquez éventuellement les patterns récurrents.

Évitez aussi de rediriger massivement les pages hackées vers la homepage ou d'autres sections du site. Google peut interpréter cela comme une tentative de soft 404 ou de manipulation. Un 404 propre vaut mieux qu'une redirection douteuse.

- Identifier les pages à fort trafic affectées (marque, produits phares)

- Soumettre ces URLs prioritaires via l'outil de suppression dans Search Console

- Vérifier que toutes les pages hackées renvoient des 404 ou 410

- Surveiller les logs serveur pour détecter des requêtes suspectes persistantes

- Utiliser des commandes site: avec des mots-clés du hack pour traquer les URLs encore indexées

- Ne pas bloquer les URLs hackées via robots.txt avant leur désindexation

- Éviter les redirections massives vers la homepage

- Patienter quelques mois pour que Google nettoie naturellement les URLs invisibles

❓ Questions frequentes

Combien de temps faut-il à Google pour désindexer les pages hackées invisibles ?

L'outil de suppression d'URLs a-t-il des limites de volume ?

Dois-je bloquer les URLs hackées via robots.txt après le nettoyage ?

Que faire si mon site a reçu une pénalité manuelle suite au hack ?

Comment identifier les pages hackées encore indexées ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.