Declaration officielle

Autres déclarations de cette vidéo 16 ▾

- □ Google attribue-t-il vraiment le même poids à tous vos backlinks ?

- □ L'emplacement des liens internes a-t-il vraiment un impact sur le SEO ?

- □ Google classe-t-il vraiment les sites dans des catégories fixes ?

- □ La cohérence NAP impacte-t-elle vraiment le référencement local ou seulement le Knowledge Graph ?

- □ Comment éviter que Google se trompe à cause d'informations conflictuelles entre votre site et votre profil d'établissement ?

- □ Les liens réciproques sont-ils vraiment sans risque pour votre SEO ?

- □ La fréquence des mots-clés influence-t-elle vraiment le classement Google ?

- □ Faut-il vraiment nettoyer TOUTES les pages hackées ou peut-on laisser Google faire le tri ?

- □ Pourquoi Google refuse-t-il d'indexer une partie de votre site même s'il est techniquement parfait ?

- □ Les emojis dans les balises title et meta description apportent-ils un avantage SEO ?

- □ L'API Search Console et l'interface affichent-elles vraiment les mêmes données ?

- □ Pourquoi vos FAQ n'apparaissent-elles pas en rich results malgré un balisage correct ?

- □ Faut-il vraiment réutiliser la même URL pour les pages saisonnières chaque année ?

- □ Les Core Web Vitals n'affectent-ils vraiment ni le crawl ni l'indexation ?

- □ Pourquoi Google réinitialise-t-il l'évaluation d'un site lors d'une migration de sous-domaine vers domaine principal ?

- □ Le TLD .edu booste-t-il vraiment votre référencement ?

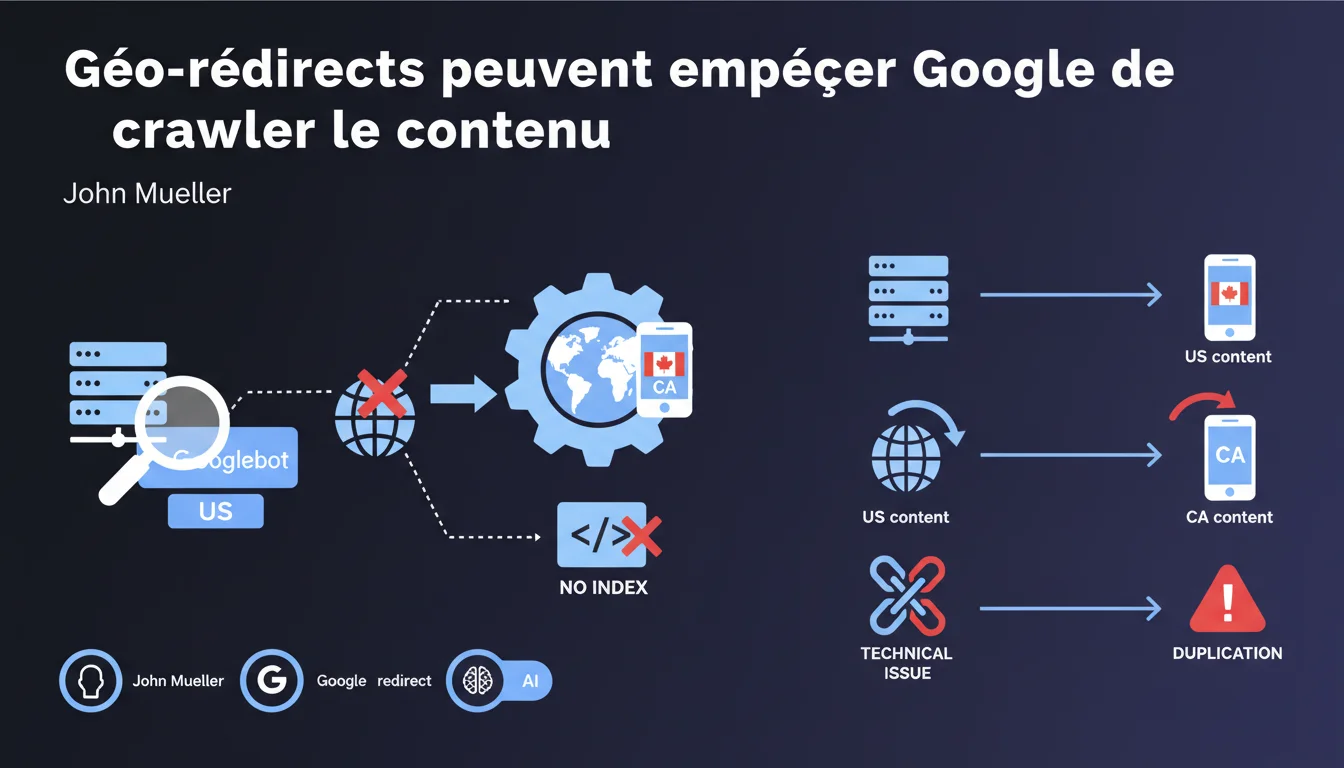

Googlebot crawle depuis un seul lieu géographique. Si votre site redirige automatiquement les visiteurs US et que Googlebot suit cette redirection, le contenu original devient invisible pour Google. Ce n'est pas du cloaking selon Mueller, mais ça reste un piège technique redoutable qui créé de la duplication et fragmenter votre indexation.

Ce qu'il faut comprendre

Pourquoi Googlebot ne peut-il pas voir tous vos contenus géolocalisés ?

Googlebot crawle principalement depuis des datacenters américains. Quand un site détecte cette origine US et applique une géo-redirection automatique, le bot se retrouve coincé sur une seule version du site.

Concrètement ? Si votre site français redirige automatiquement les visiteurs US vers example.com/us/, Googlebot ne verra jamais le contenu français original. Il découvrira uniquement la version américaine, créant un trou béant dans votre indexation.

Est-ce que Google considère ça comme du cloaking ?

Non, selon Mueller. Le cloaking implique une intention de tromper en servant du contenu différent au bot. Ici, c'est un comportement technique non intentionnel — la redirection s'applique uniformément selon la géolocalisation IP détectée.

Le problème n'est donc pas une pénalité, mais un échec pur et simple d'indexation. Votre contenu existe, mais Google ne peut pas le voir. C'est encore pire qu'une pénalité : vous êtes invisible sans même le savoir.

Quels sont les risques de duplication mentionnés ?

Si certaines versions géographiques ne sont pas redirigées mais restent accessibles via des URLs différentes (/fr/, /de/, /uk/), Google peut indexer plusieurs versions similaires. Vous créez alors de la duplication de contenu entre régions.

Le pire scénario : certaines pages redirigent, d'autres non. Google indexe un patchwork incohérent de versions régionales, sans comprendre votre architecture. Résultat — dilution de signaux, cannibalisation entre versions.

- Googlebot crawle depuis un lieu unique, principalement des IPs américaines

- Les géo-redirects bloquent l'accès au contenu original pour le bot

- Ce n'est pas du cloaking, mais un problème technique d'accessibilité

- La duplication apparaît si les redirections sont incohérentes entre versions

- L'indexation devient fragmentée et imprévisible

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment ce qu'on observe sur le terrain ?

Oui, et c'est même pire que ce que Mueller décrit. On voit régulièrement des sites internationaux perdre 40-60% de leurs pages indexées à cause de géo-redirects mal configurés. Le diagnostic est complexe parce que Search Console montre des erreurs d'exploration cryptiques, sans indiquer clairement que la géo-redirection est en cause.

Le vrai piège ? Ces redirections sont souvent implémentées au niveau CDN (Cloudflare, Akamai) ou via des scripts JavaScript. Googlebot peut suivre certaines redirections JS, mais pas toutes — [A vérifier] selon la complexité de l'implémentation et le timing d'exécution.

Quelles nuances faut-il apporter à cette position officielle ?

Mueller ne mentionne pas que Googlebot peut parfois crawler depuis d'autres localisations pour les sites avec hreflang bien configuré. Google utilise sporadiquement des IPs européennes ou asiatiques pour valider les versions locales — mais c'est rare, imprévisible, et ne devrait jamais servir de stratégie principale.

Autre point : il dit que ce n'est "pas du cloaking", mais attention. Si vous servez du contenu différent intentionnellement au bot (en détectant son user-agent plutôt que son IP), ça devient du cloaking pur. La distinction est fine mais critique.

Dans quels cas cette règle ne s'applique-t-elle pas complètement ?

Si vous utilisez des hreflang annotations correctement et que vos URLs régionales restent accessibles sans redirection forcée, Google peut indexer toutes les versions. La clé : laisser Googlebot accéder librement à chaque version linguistique/régionale via son URL canonique.

Les géo-redirects basés sur l'acceptation utilisateur (pop-up "Voulez-vous voir la version US?") ne posent généralement pas problème — Googlebot ne clique pas sur les pop-ups et accède au contenu par défaut. Mais franchement, c'est une UX désastreuse pour les humains.

Impact pratique et recommandations

Que faut-il faire concrètement pour éviter ce piège ?

Première urgence : auditer toutes vos redirections géo-localisées. Utilisez un VPN ou des proxies pour tester l'accès depuis différents pays. Vérifiez que Googlebot peut atteindre chaque version sans être redirigé de force.

Configurez votre serveur ou CDN pour ne jamais rediriger le user-agent Googlebot — identifiez-le et laissez-le accéder au contenu original. C'est techniquement différent du cloaking puisque vous ne changez pas le contenu, juste l'absence de redirection automatique.

Comment structurer correctement un site multilingue/multi-régional ?

Privilégiez une sélection manuelle de langue/région via un menu persistant plutôt que des redirections automatiques. Servez une version par défaut accessible à tous (souvent l'anglais ou la langue principale de votre marché).

Implémentez des balises hreflang sur toutes les pages pour indiquer à Google les variantes linguistiques/régionales. Assurez-vous que chaque URL reste accessible directement sans redirection — les hreflang indiquent à Google quelle version afficher à quel utilisateur, sans bloquer l'accès au bot.

Quels outils utiliser pour vérifier que votre configuration fonctionne ?

Search Console reste votre premier indicateur. Regardez l'onglet Couverture : si des URLs internationales apparaissent en "Détectée, actuellement non indexée", vous avez probablement un problème de géo-redirect.

Utilisez l'outil Inspection d'URL pour tester l'accès Googlebot à chaque version régionale. Si Google affiche une redirection ou ne peut pas accéder au contenu, vous avez identifié le coupable.

- Auditer toutes les règles de géo-redirection (serveur, CDN, scripts JS)

- Exclure Googlebot des redirections automatiques basées sur l'IP

- Implémenter des balises hreflang sur toutes les variantes linguistiques

- Maintenir chaque URL régionale accessible sans redirection forcée

- Privilégier un sélecteur de langue/région manuel plutôt qu'automatique

- Tester l'accès depuis différentes localisations avec VPN/proxies

- Vérifier la couverture d'indexation dans Search Console par version linguistique

- Utiliser l'Inspection d'URL pour valider l'accès Googlebot à chaque variante

❓ Questions frequentes

Est-ce que je risque une pénalité Google si j'utilise des géo-redirects ?

Comment savoir si mes géo-redirects bloquent Googlebot ?

Les hreflang suffisent-ils à remplacer les géo-redirects ?

Puis-je exclure uniquement Googlebot des géo-redirects sans risque ?

Que faire si j'ai déjà perdu des pages indexées à cause de géo-redirects ?

🎥 De la même vidéo 16

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.