Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Les liens internes dans le header ou le footer ont-ils moins de valeur SEO ?

- □ Google pénalise-t-il vraiment un site qui achète des liens en masse ?

- □ Faut-il vraiment viser la perfection technique pour bien ranker sur Google ?

- □ Pourquoi Google crawle-t-il moins votre site s'il le trouve de mauvaise qualité ?

- □ Le statut « Crawlée, actuellement non indexée » est-il vraiment un signal de qualité insuffisante ?

- □ Les données structurées invalides peuvent-elles pénaliser votre référencement ?

- □ Crawlée non indexée vs Découverte non indexée : vraiment équivalent ?

- □ Peut-on vraiment contrôler les images affichées dans les snippets Google ?

- □ Pourquoi Google pénalise-t-il le contenu dupliqué entre sites de franchises ?

- □ CCTLD, sous-domaine ou sous-répertoire : quelle structure pour le géociblage international ?

- □ Le code 503 protège-t-il vraiment vos pages de la désindexation en cas de panne ?

- □ Les liens dofollow accidentels dans vos RP vont-ils vous pénaliser ?

- □ Peut-on vraiment utiliser l'outil de changement d'adresse pour fusionner ou diviser des sites ?

- □ Pourquoi vos données structurées disparaissent-elles sur vos pages localisées ?

- □ Les données structurées améliorent-elles vraiment le référencement ou juste l'affichage ?

- □ Google va-t-il un jour afficher les Core Web Vitals directement dans les résultats de recherche ?

- □ Restructuration d'URL : pourquoi Google provoque-t-il des fluctuations pendant deux mois ?

- □ Le linking interne surpasse-t-il vraiment la structure d'URL pour le SEO ?

- □ Faut-il vraiment calculer le PageRank interne pour optimiser son site ?

- □ Google peut-il vraiment identifier la langue principale d'une page multilingue sans pénaliser votre SEO ?

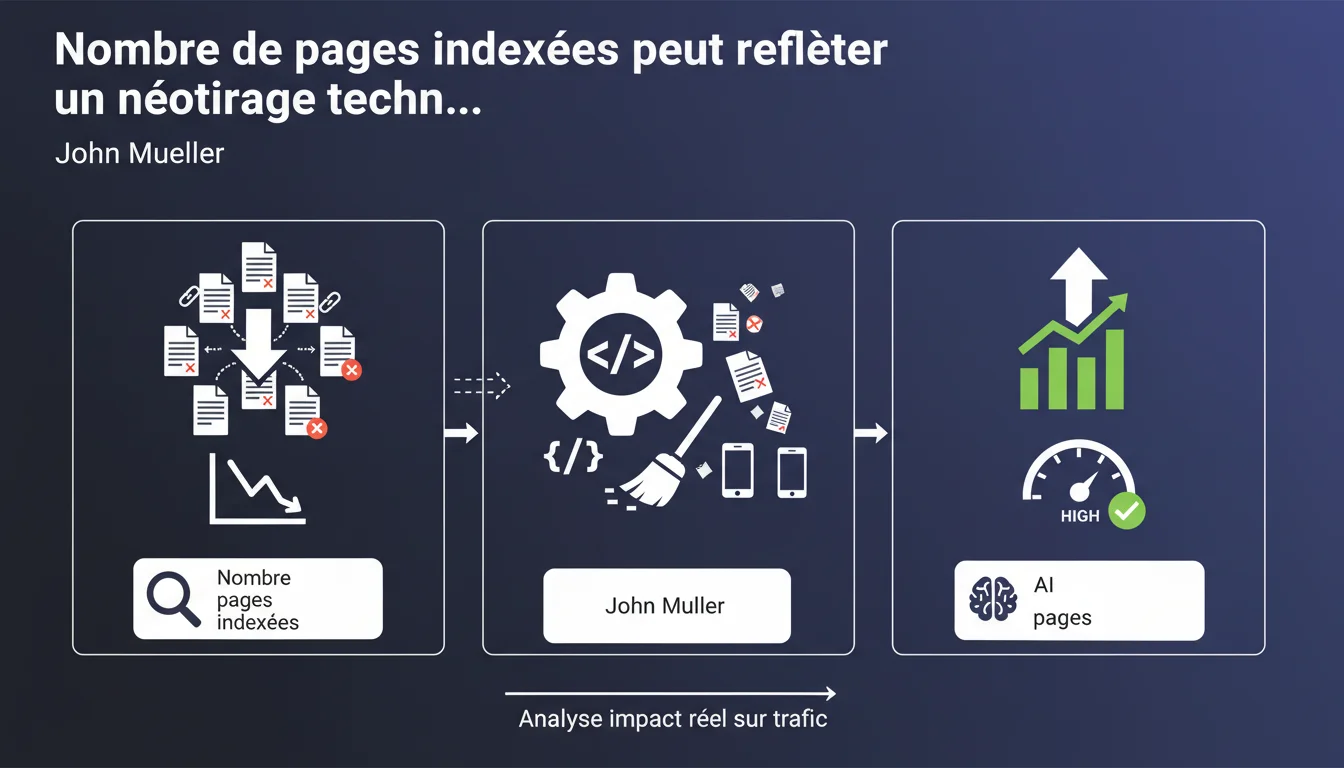

Une chute du nombre de pages indexées n'est pas forcément un signal d'alarme. Google confirme que cela peut simplement refléter un nettoyage technique — suppression de pages dupliquées, paramètres d'URL mal configurés, ou contenus de faible qualité retirés de l'index. L'indicateur clé reste le trafic organique, pas le compteur de pages indexées.

Ce qu'il faut comprendre

Cette déclaration de John Mueller rappelle un principe souvent mal compris par les praticiens SEO : le nombre de pages indexées est un indicateur secondaire, pas une métrique de performance en soi.

Beaucoup de consultants paniquent dès qu'ils constatent une baisse dans la Google Search Console, sans vérifier si cela a réellement un impact business.

Pourquoi le nombre de pages indexées fluctue-t-il ?

Google ajuste constamment son index. Une baisse peut résulter de corrections techniques positives : suppression de pages avec paramètres UTM mal gérés, élimination de facettes e-commerce accidentellement crawlées, ou nettoyage de contenus thin.

Dans certains cas, c'est Google lui-même qui décide de désindexer des pages jugées non pertinentes ou redondantes. Cela ne signifie pas forcément une pénalité — simplement que l'algorithme a réévalué la qualité de ces URLs.

Quelle est la vraie métrique à surveiller ?

Mueller insiste : regardez le trafic organique réel. Si vos pages stratégiques continuent de performer, une baisse du total indexé n'est qu'un détail technique.

Le crawl budget étant limité, avoir 10 000 pages indexées de faible qualité est bien pire qu'en avoir 2 000 performantes. Google n'a jamais promis d'indexer tout votre site — uniquement ce qui mérite de l'être.

- Une baisse d'indexation n'est pas synonyme de problème si le trafic reste stable ou progresse

- Les fluctuations peuvent refléter un nettoyage technique bénéfique

- Google peut désindexer des pages jugées redondantes ou de faible qualité sans action manuelle de votre part

- Le nombre de pages indexées est un indicateur, pas un objectif en soi

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, et c'est même un des rares points où le discours officiel colle parfaitement à la réalité. On observe régulièrement des sites qui gagnent en trafic après une baisse d'indexation — souvent parce qu'ils ont nettoyé des pages parasites.

Le problème, c'est que Google ne fournit aucun outil pour distinguer clairement une désindexation volontaire (nettoyage sain) d'une désindexation subie (pénalité qualité). La Search Console affiche un compteur global, point final.

Quelles nuances faut-il apporter ?

Soyons honnêtes : toutes les baisses d'indexation ne sont pas anodines. Si votre site e-commerce passe de 5 000 à 500 pages indexées du jour au lendemain, il y a probablement un vrai problème technique — robots.txt cassé, balises noindex accidentelles, ou pire, une pénalité algorithmique.

Mueller a raison sur le principe, mais sa formulation laisse une zone grise énorme. [A vérifier] : comment différencier un « nettoyage technique bénéfique » d'une dégradation qualité perçue par l'algorithme ? Google ne donne aucun critère objectif.

Autre point : les pages « avec paramètres accidentellement indexées » sont souvent le symptôme d'une architecture technique bancale. Si Google les a crawlées, c'est que votre maillage interne ou votre gestion des facettes laisse à désirer.

Dans quels cas faut-il quand même s'inquiéter ?

Si la baisse d'indexation s'accompagne d'une chute de trafic sur des requêtes stratégiques, c'est un signal clair de problème. Idem si des catégories entières disparaissent de l'index sans raison apparente.

Le conseil de Mueller est valable pour des fluctuations normales — pas pour des effondrements brutaux. Dans ce cas, il faut auditer rapidement : crawl Screaming Frog, vérification logs serveur, analyse Search Console segment par segment.

Impact pratique et recommandations

Que faut-il faire concrètement si le nombre de pages indexées baisse ?

Première étape : ne pas paniquer. Ouvrez Google Analytics (ou votre outil de tracking) et vérifiez si le trafic organique global et celui des pages clés sont impactés. Si tout est stable, la baisse est probablement technique et non qualitative.

Ensuite, segmentez l'analyse dans la Search Console : quelles catégories de pages ont disparu ? Des URLs de pagination ? Des facettes ? Des paramètres de tracking ? Si ce sont des pages sans valeur SEO, c'est même une bonne nouvelle.

Quelles erreurs éviter ?

Ne forcez pas la réindexation de pages qui n'ont aucune raison d'être indexées. Soumettre manuellement 3 000 URLs de faible qualité via l'API Indexing ne fera qu'irriter l'algorithme.

Autre piège : ajouter du contenu générique sur des pages thin pour « sauver l'indexation ». Si Google a jugé ces pages non pertinentes, un paragraphe de remplissage ne changera rien — il faut revoir la structure informationnelle ou accepter de les désindexer proprement.

Comment vérifier que mon site est sain ?

Auditez votre fichier robots.txt et vos balises meta robots. Vérifiez que vous n'avez pas accidentellement bloqué des sections stratégiques. Crawlez le site avec Screaming Frog en simulant Googlebot — comparez le nombre d'URLs découvertes avec le nombre indexé.

Analysez vos logs serveur : Google crawle-t-il toujours les pages disparues de l'index ? Si oui, c'est un problème de qualité perçue. Si non, c'est un problème d'accessibilité technique.

- Vérifier le trafic organique global avant de paniquer

- Segmenter l'analyse Search Console par type de page

- Identifier les pages désindexées : ont-elles une valeur SEO réelle ?

- Auditer robots.txt, meta robots et canonicals

- Crawler le site en simulant Googlebot

- Analyser les logs serveur pour voir si Google crawle encore les URLs disparues

- Si problème confirmé : corriger les blocages techniques ou améliorer la qualité de contenu

❓ Questions frequentes

Une baisse de 30% du nombre de pages indexées est-elle normale ?

Comment savoir si Google a désindexé des pages pour des raisons de qualité ?

Faut-il forcer la réindexation via l'API Indexing ?

Combien de pages un site e-commerce devrait-il avoir indexées ?

Les pages désindexées peuvent-elles être récupérées automatiquement ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.