Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Les liens internes dans le header ou le footer ont-ils moins de valeur SEO ?

- □ Google pénalise-t-il vraiment un site qui achète des liens en masse ?

- □ Faut-il vraiment viser la perfection technique pour bien ranker sur Google ?

- □ Le statut « Crawlée, actuellement non indexée » est-il vraiment un signal de qualité insuffisante ?

- □ Les données structurées invalides peuvent-elles pénaliser votre référencement ?

- □ Faut-il s'inquiéter d'une baisse du nombre de pages indexées ?

- □ Crawlée non indexée vs Découverte non indexée : vraiment équivalent ?

- □ Peut-on vraiment contrôler les images affichées dans les snippets Google ?

- □ Pourquoi Google pénalise-t-il le contenu dupliqué entre sites de franchises ?

- □ CCTLD, sous-domaine ou sous-répertoire : quelle structure pour le géociblage international ?

- □ Le code 503 protège-t-il vraiment vos pages de la désindexation en cas de panne ?

- □ Les liens dofollow accidentels dans vos RP vont-ils vous pénaliser ?

- □ Peut-on vraiment utiliser l'outil de changement d'adresse pour fusionner ou diviser des sites ?

- □ Pourquoi vos données structurées disparaissent-elles sur vos pages localisées ?

- □ Les données structurées améliorent-elles vraiment le référencement ou juste l'affichage ?

- □ Google va-t-il un jour afficher les Core Web Vitals directement dans les résultats de recherche ?

- □ Restructuration d'URL : pourquoi Google provoque-t-il des fluctuations pendant deux mois ?

- □ Le linking interne surpasse-t-il vraiment la structure d'URL pour le SEO ?

- □ Faut-il vraiment calculer le PageRank interne pour optimiser son site ?

- □ Google peut-il vraiment identifier la langue principale d'une page multilingue sans pénaliser votre SEO ?

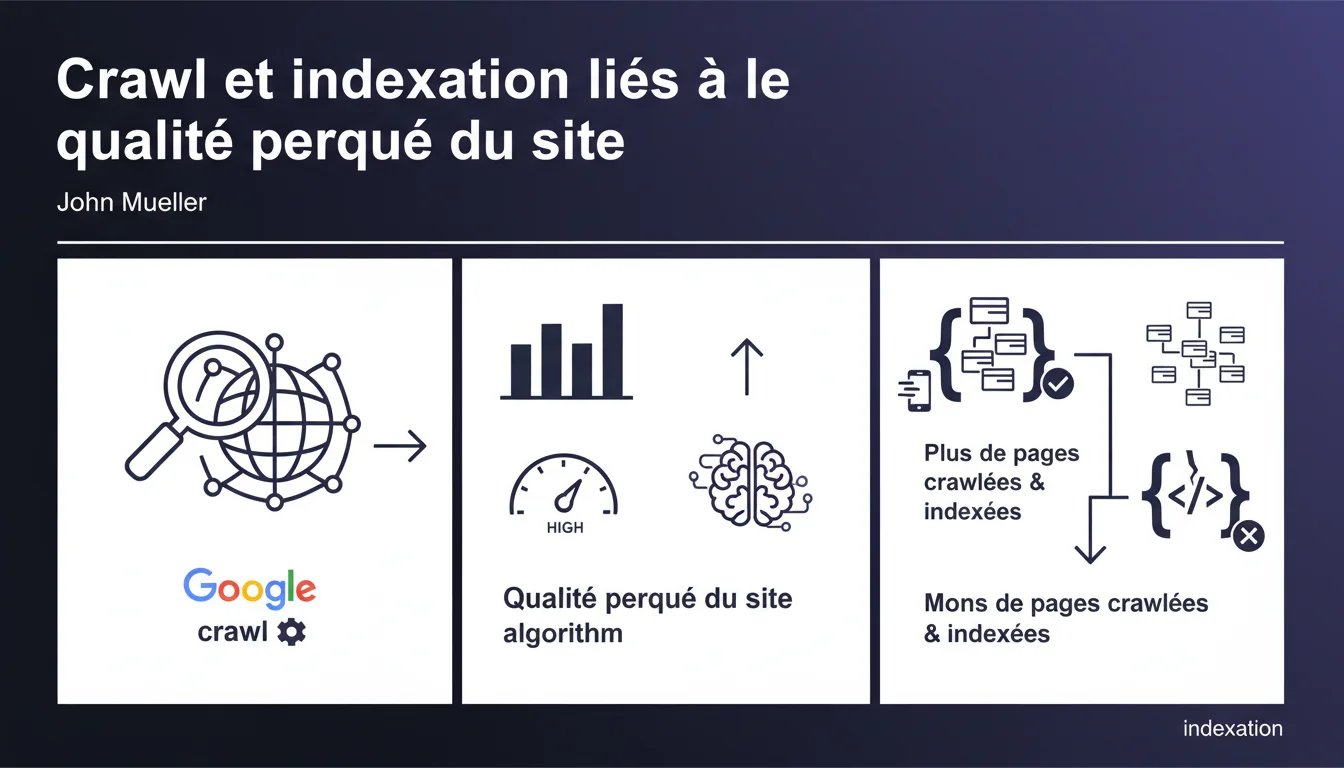

Google priorise son budget de crawl en fonction de la qualité perçue des sites. Si les algorithmes jugent votre contenu médiocre, moins de pages seront explorées et indexées, même si techniquement elles sont accessibles. La qualité globale du site conditionne directement l'attention que Google lui accorde.

Ce qu'il faut comprendre

Qu'est-ce que cela signifie concrètement pour mon site ?

Google dispose de ressources limitées — serveurs, bande passante, temps de calcul. Crawler l'intégralité du web quotidiennement est physiquement impossible. Les robots doivent donc prioriser.

Cette priorisation ne se fait pas au hasard. Elle repose sur une évaluation algorithmique de la qualité d'ensemble du site : fraîcheur du contenu, taux de bounce, signaux d'engagement, expertise perçue, autorité thématique. Si Google considère qu'un site produit majoritairement du contenu faible ou dupliqué, il réduit la fréquence et la profondeur de crawl.

Comment Google évalue-t-il cette qualité perçue ?

Les critères exacts restent opaques — c'est une boîte noire. On sait qu'interviennent des signaux comportementaux (temps passé, taux de clic organique), la cohérence thématique, la fréquence de publication, le nombre de pages indexées versus crawlées.

Un site qui multiplie les contenus générés automatiquement, les pages orphelines ou les variations quasi-identiques envoie un signal négatif. Google ajuste alors son crawl budget à la baisse, créant un cercle vicieux : moins de crawl → moins de pages découvertes → moins de visibilité → signal qualité dégradé.

Cette limitation touche-t-elle tous les types de sites ?

Non. Les sites d'actualité, les plateformes e-commerce dynamiques avec de forts volumes de trafic, les sites d'autorité établie bénéficient d'un crawl quasi permanent. Google sait qu'ils publient du contenu frais et pertinent.

À l'inverse, les petits sites récents, les blogs peu actifs, les sites avec un historique de thin content ou de pénalités algorithmiques subissent des limitations sévères. Même après correction, le rétablissement d'un crawl normal peut prendre des mois.

- Le crawl budget n'est pas fixe — il évolue en fonction de la perception algorithmique du site

- Qualité globale > qualité d'une page isolée — une poignée de bonnes pages ne compense pas une masse de contenu médiocre

- La fréquence de crawl reflète la confiance de Google — un site rarement crawlé est un site peu valorisé

- Réduire le volume de pages indexées peut paradoxalement améliorer le crawl — moins de bruit = meilleur signal

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, totalement. Depuis des années, on observe que les sites avec du contenu de faible valeur ajoutée voient leur fréquence de crawl chuter. Les logs serveur le montrent sans ambiguïté : certains sites ne reçoivent Googlebot que quelques fois par semaine, quand d'autres sont crawlés plusieurs fois par heure.

Ce qui est intéressant, c'est que Mueller formule explicitement ce lien entre qualité perçue et crawl. Avant, Google niait souvent l'existence d'un « crawl budget » pour les petits sites. Ici, on admet que même l'indexation elle-même est conditionnée à cette perception.

Quelles nuances faut-il apporter ?

Attention — « qualité perçue » ne veut pas dire « qualité objective ». Un site peut être techniquement irréprochable, avec du contenu expert et unique, mais si ses métriques d'engagement sont médiocres (temps de visite faible, taux de rebond élevé), Google peut le juger de faible qualité.

Inversement, un site au design moyen mais avec une audience engagée et des backlinks naturels sera crawlé intensivement. Les signaux comportementaux pèsent très lourd dans cette équation — plus peut-être que le contenu lui-même.

[À vérifier] Google ne donne aucune métrique précise pour évaluer cette « qualité perçue ». On navigue à vue avec des corrélations (taux de clic CTR organique, dwell time, backlinks...), mais aucune donnée officielle ne confirme leur poids exact.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Les sites d'actualité majeurs, les plateformes comme YouTube, les sites gouvernementaux — bref, les sources d'autorité établie — échappent largement à cette logique. Google les crawle en quasi temps réel, indépendamment de la « qualité » de chaque page prise isolément.

Pour un site lambda, cette règle est implacable. Mais pour un site avec des dizaines de millions de pages et un historique de confiance, Google accepte un certain niveau de bruit dans l'index. C'est une asymétrie fondamentale du web.

Impact pratique et recommandations

Que faut-il faire concrètement pour améliorer le crawl ?

Première priorité : élaguer impitoyablement le contenu de faible valeur. Pages orphelines, duplications internes, contenus générés automatiquement sans valeur ajoutée, catégories vides — tout ce qui dilue le signal doit disparaître (noindex, suppression, redirection 301).

Ensuite, concentrez-vous sur la qualité éditoriale des nouvelles publications. Mieux vaut publier 2 articles par mois avec 3000 mots chacun, sourcés, structurés, utiles, que 20 articles de 400 mots sans profondeur. Google priorise les sites qui produisent de la valeur, pas du volume.

Enfin, optimisez l'architecture du site pour faciliter le crawl : maillage interne cohérent, sitemap XML à jour, temps de réponse serveur rapide, éviter les chaînes de redirection. Un site techniquement performant encourage Google à explorer davantage.

Quelles erreurs éviter absolument ?

Ne pas indexer massivement du contenu « juste pour être indexé ». Beaucoup de sites gonflent leur nombre de pages indexées en pensant que c'est un KPI positif. C'est l'inverse : un index pollué envoie un signal négatif.

Évitez également de modifier massivement le site pour « plaire aux algorithmes » sans travailler l'engagement utilisateur. Si votre contenu est techniquement parfait mais que personne ne le lit, Google finira par réduire le crawl.

- Auditer les logs serveur pour identifier les pages crawlées vs. celles ignorées

- Supprimer ou désindexer les contenus de faible valeur (thin content, duplications)

- Concentrer la production éditoriale sur la qualité, pas la quantité

- Optimiser le maillage interne pour guider Googlebot vers les pages prioritaires

- Surveiller l'évolution du crawl budget dans Google Search Console (statistiques d'exploration)

- Améliorer les métriques d'engagement (CTR, temps de visite) pour renforcer la perception de qualité

Comment vérifier que mon site est conforme ?

Consultez les statistiques d'exploration dans Google Search Console. Si le nombre de pages crawlées par jour chute sans raison technique apparente, c'est un signal d'alerte. Comparez avec le nombre de pages indexées : un écart important peut indiquer que Google juge une partie du site non prioritaire.

Analysez vos logs serveur avec un outil comme Screaming Frog Log File Analyser ou OnCrawl. Identifiez les sections du site ignorées par Googlebot, les pages crawlées mais non indexées, les ressources consommant du crawl sans valeur (paramètres URL, facettes inutiles).

❓ Questions frequentes

Combien de pages par jour Google doit-il crawler pour considérer un site comme « bien traité » ?

Si je supprime 80% de mes pages pour améliorer la qualité, vais-je perdre du trafic ?

Le crawl budget affecte-t-il directement le ranking ?

Peut-on forcer Google à crawler davantage en soumettant manuellement les URLs ?

Un site pénalisé peut-il récupérer un crawl normal après correction ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/01/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.