Declaration officielle

Autres déclarations de cette vidéo 20 ▾

- □ Pourquoi Google ne peut-il jamais garantir que vos utilisateurs atterriront sur la bonne version linguistique de votre site ?

- □ Faut-il bannir les redirections automatiques pour les sites multilingues ?

- □ Faut-il bloquer l'exécution JavaScript pour les SPA avec SSR ?

- □ Faut-il baliser les mots étrangers avec l'attribut lang pour le SEO ?

- □ Le contenu dupliqué entraîne-t-il vraiment une pénalité Google ?

- □ Le rel=canonical est-il vraiment pris en compte par Google ou juste une suggestion ignorée ?

- □ Les FAQ dans les articles de blog sont-elles vraiment utiles pour le SEO ?

- □ Hreflang est-il vraiment obligatoire pour gérer un site international ?

- □ Le cache Google a-t-il un impact sur votre référencement ?

- □ Les résultats de recherche localisés : comment Google adapte-t-il vraiment son algorithme selon les pays et les langues ?

- □ Faut-il vraiment se limiter à une seule thématique sur son site pour bien ranker ?

- □ Combien de liens peut-on vraiment mettre sur une page sans pénalité Google ?

- □ L'URL référente dans Search Console impacte-t-elle vraiment votre classement ?

- □ Le nombre de mots est-il vraiment inutile pour le référencement ?

- □ Faut-il s'inquiéter de réutiliser les mêmes blocs de texte sur plusieurs pages ?

- □ Google valide-t-il vraiment la traduction automatique sur les sites multilingues ?

- □ Les URLs bloquées par robots.txt mais indexées posent-elles vraiment problème ?

- □ Faut-il vraiment dupliquer le schema Organisation sur toutes les pages du site ?

- □ Les avis auto-hébergés peuvent-ils afficher des étoiles dans les résultats de recherche Google ?

- □ Pourquoi les fusions de sites Web génèrent-elles des résultats imprévisibles aux yeux de Google ?

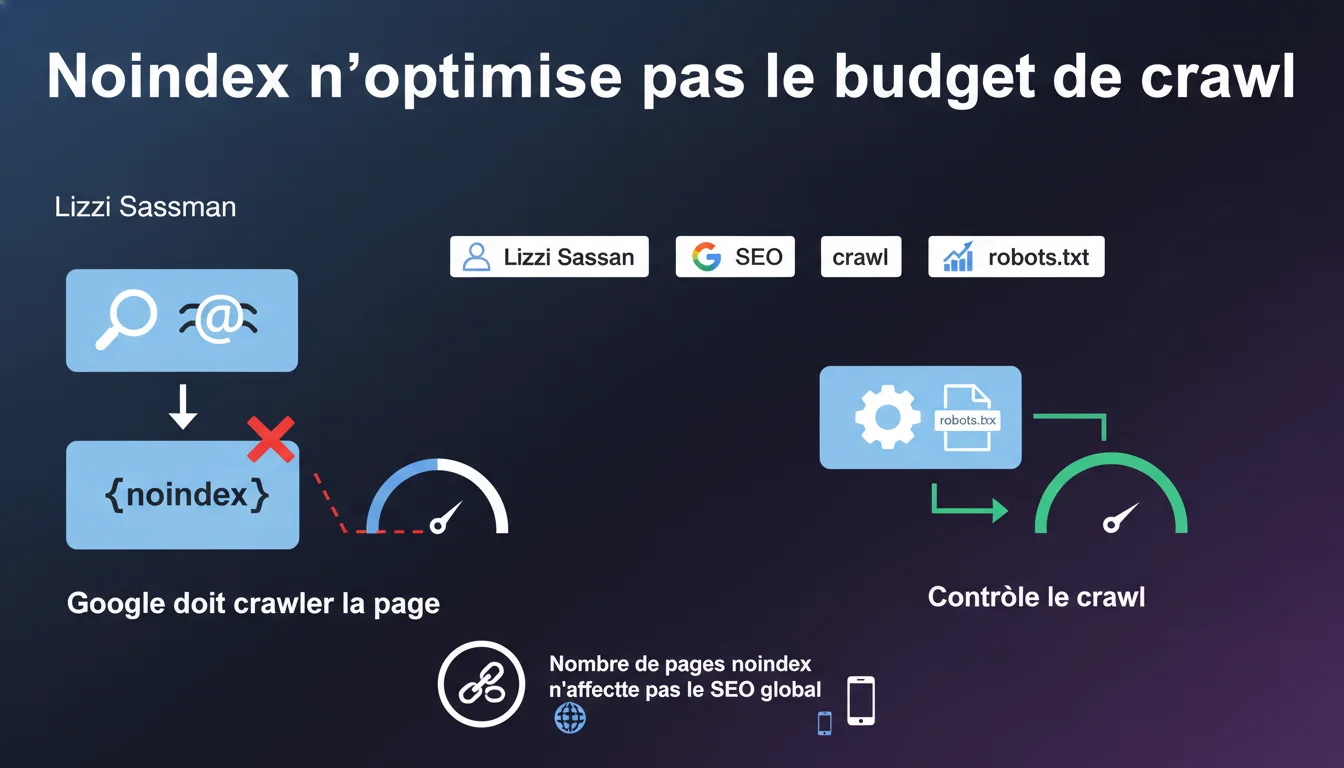

Google crawle les pages pour détecter le noindex — l'utiliser pour économiser du budget de crawl est donc contre-productif. Seul robots.txt bloque réellement le crawl. Le nombre de pages en noindex n'impacte pas la qualité SEO globale du site.

Ce qu'il faut comprendre

Pourquoi le noindex ne peut-il pas économiser du budget de crawl ?

Le mécanisme est simple : pour qu'un moteur découvre la directive noindex, il doit d'abord crawler la page, charger le HTML (ou consulter les en-têtes HTTP si c'est un X-Robots-Tag), puis identifier l'instruction. Le crawl a déjà eu lieu.

Si l'objectif est de préserver des ressources de crawl — par exemple sur un site avec des millions de pages ou des sections générées dynamiquement — ajouter noindex ne fait qu'alourdir le traitement : Googlebot visite, lit, indexe temporairement, puis retire la page de l'index. Bref, c'est inefficace.

Quelle est la différence entre noindex et robots.txt pour le crawl ?

Le robots.txt bloque le crawl en amont. Googlebot consulte ce fichier avant de visiter une URL et, si elle est interdite, il ne la crawle pas du tout. Pas de requête HTTP, pas de consommation de budget.

Le noindex, lui, agit après le crawl, au niveau de l'indexation. La page est visitée, analysée, mais ne figurera pas dans les résultats de recherche. Deux logiques différentes, deux étapes différentes du pipeline.

Le nombre de pages noindex pénalise-t-il le SEO global du site ?

Selon cette déclaration, non. Google affirme que le volume de pages marquées noindex n'affecte pas la qualité perçue du site dans son ensemble. Ce qui compte, c'est la pertinence et la qualité des pages indexables, pas le nombre de pages exclues.

Cela contredit une croyance tenace : celle qu'un trop grand nombre de pages noindex enverrait un signal négatif (« ce site cache des problèmes de qualité »). [A vérifier] sur des sites à très large échelle — mais la position officielle est claire.

- Le noindex ne bloque pas le crawl, il bloque l'indexation après crawl

- Robots.txt est le seul levier pour contrôler le budget de crawl en amont

- Le nombre de pages noindex n'est pas un facteur de pénalité selon Google

- Utiliser noindex pour économiser du crawl est un contresens technique

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, dans les grandes lignes. Sur des sites avec un budget de crawl contraint (e-commerce multi-référence, marketplaces, médias éditoriaux massifs), bloquer via robots.txt est beaucoup plus efficace qu'espérer qu'un noindex allège la charge.

Cela dit, la notion de « budget de crawl » elle-même est souvent surestimée. Google l'a répété : pour la majorité des sites, ce n'est pas un goulot d'étranglement. Le vrai enjeu, c'est la qualité des pages crawlées, pas leur quantité absolue.

Dans quels cas le noindex reste-t-il pertinent ?

Le noindex garde tout son sens pour gérer l'indexation, pas le crawl. Pages de résultats de recherche interne, fiches produits en rupture définitive, contenus obsolètes mais à conserver pour l'historique utilisateur — autant de cas où on veut que Google crawle (pour suivre les liens, détecter les mises à jour), mais sans indexer.

Le piège, c'est de confondre les deux objectifs. Si tu veux que Googlebot ne touche jamais une section (fichiers admin, annexes techniques, PDF sensibles), robots.txt est la bonne approche. Si tu veux qu'il explore mais n'affiche pas dans la SERP, noindex fait le job.

Quelle nuance faut-il apporter sur le volume de pages noindex ?

Google dit que ça n'affecte pas le SEO global. Techniquement exact — mais attention à l'effet indirect. Si la majorité de ton site est en noindex, ça pose une vraie question stratégique : pourquoi créer autant de contenu non indexable ?

Un ratio trop élevé de pages noindex peut révéler des problèmes structurels : duplication non maîtrisée, génération automatique de pages de faible valeur, mauvaise architecture. Ce n'est pas le volume de noindex qui pénalise, c'est ce qu'il signale. [A vérifier] sur des cas extrêmes (90% de pages noindex), mais la logique tient.

Impact pratique et recommandations

Que faut-il faire concrètement pour optimiser le budget de crawl ?

Si tu veux vraiment contrôler ce que Googlebot crawle, utilise robots.txt de manière chirurgicale. Identifie les sections qui consomment des ressources sans apporter de valeur SEO : facettes infinies, filtres combinatoires, archives de pages obsolètes.

Ensuite, surveille via la Search Console le volume de crawl par type de page. Google rapporte le nombre de requêtes par jour, le temps de réponse moyen, les erreurs serveur. Si ces métriques sont saines, tu n'as probablement pas de problème de budget de crawl.

Quelles erreurs éviter avec noindex et robots.txt ?

Erreur classique : bloquer une URL dans robots.txt ET ajouter noindex. Google ne peut pas crawler, donc ne voit jamais la directive noindex — résultat, la page peut rester dans l'index avec un snippet tronqué (« Aucune information disponible »). Il faut choisir : soit tu bloques le crawl, soit tu bloques l'indexation, rarement les deux.

Autre piège : utiliser noindex sur des pages stratégiques par peur de la duplication. Si le contenu est légitime et utile, canonicalize plutôt que noindex. Le noindex supprime toute chance de positionnement, la canonical concentre les signaux.

Comment vérifier que mon site est configuré correctement ?

Commence par un audit de crawl (Screaming Frog, OnCrawl, Botify) pour identifier les pages noindex et leur volume. Croise avec les logs serveur pour voir si Googlebot les visite fréquemment malgré le noindex.

Ensuite, compare avec le robots.txt : y a-t-il des sections bloquées qui devraient être crawlées pour transmettre du PageRank ? Y a-t-il des pages noindex qui pourraient être bloquées en amont via robots.txt pour alléger la charge ?

- Utiliser robots.txt pour bloquer le crawl des sections non stratégiques (facettes, filtres, archives)

- Réserver le noindex aux pages qu'on veut voir crawlées mais pas indexées (recherche interne, contenus temporaires)

- Ne jamais combiner robots.txt et noindex sur la même URL

- Auditer régulièrement le ratio pages indexables / pages totales pour détecter les incohérences

- Surveiller les métriques de crawl dans la Search Console (requêtes/jour, erreurs, temps de réponse)

- Privilégier la canonical au noindex pour gérer la duplication légitime

❓ Questions frequentes

Peut-on combiner robots.txt et noindex sur la même page ?

Le noindex transmet-il du PageRank via les liens internes ?

Un trop grand nombre de pages noindex peut-il pénaliser un site ?

Quand utiliser robots.txt plutôt que noindex ?

Comment savoir si mon site souffre d'un problème de budget de crawl ?

🎥 De la même vidéo 20

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 21/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.