Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Pourquoi robots.txt suffit-il (presque toujours) à bloquer l'indexation d'un site de staging ?

- □ La protection par mot de passe est-elle vraiment la solution pour bloquer l'indexation d'un site de staging ?

- □ Les pages orphelines sont-elles vraiment invisibles pour Google ?

- □ Google peut-il vraiment découvrir tous vos sous-domaines ?

- □ Faut-il vraiment soumettre manuellement ses pages importantes au lancement d'un site ?

- □ Faut-il vraiment craindre de publier 7000 articles d'un coup ?

- □ La qualité du contenu bloque-t-elle réellement l'indexation de masse ?

- □ Un nom de domaine propre améliore-t-il vraiment la mémorisation de votre marque ?

- □ Les listes blanches IP suffisent-elles vraiment à protéger vos sites de staging du crawl Google ?

- □ Faut-il vraiment faire du SEO pour un site à fonctionnalité ?

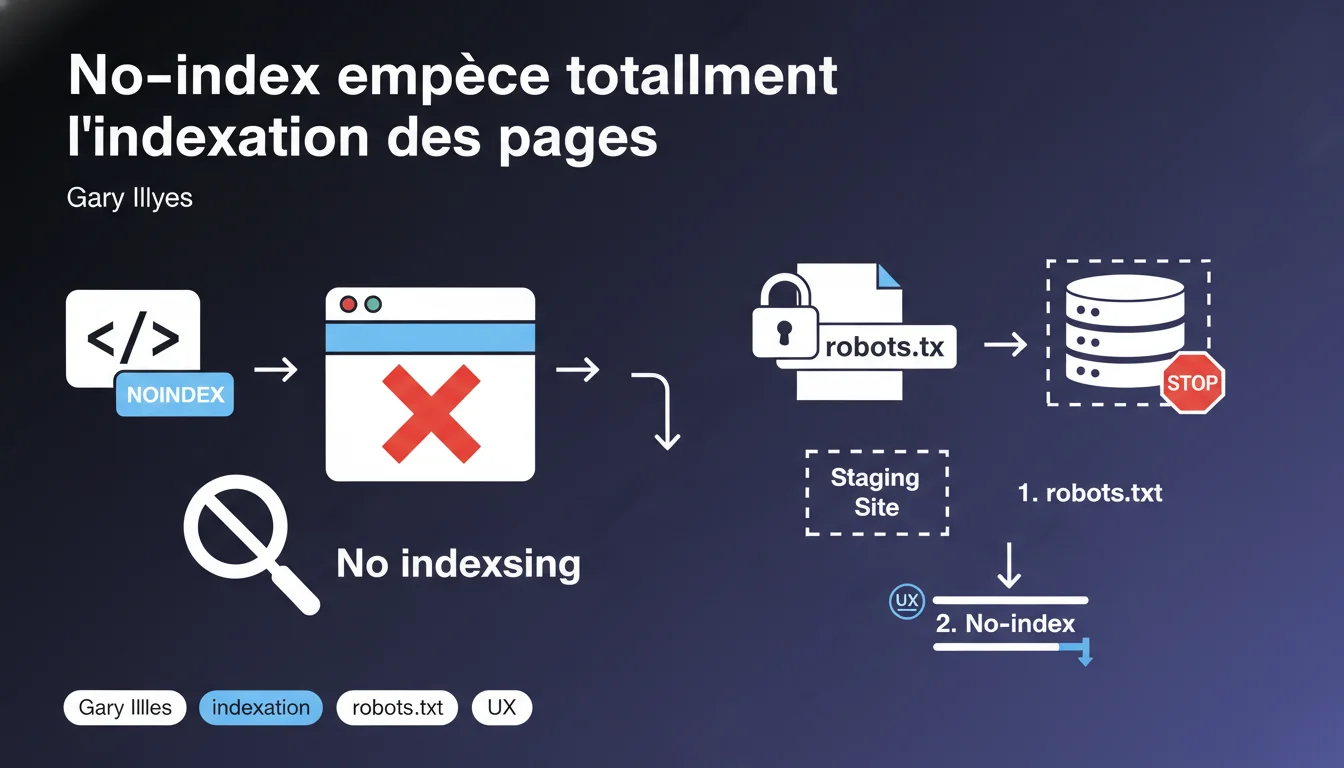

Gary Illyes confirme que la balise no-index empêche totalement l'indexation des pages, à condition que l'élément head ne soit pas modifié. C'est la deuxième option recommandée après robots.txt pour bloquer un environnement de staging. L'affirmation semble absolue, mais mérite d'être nuancée face à certaines observations terrain.

Ce qu'il faut comprendre

Que dit exactement Google sur le fonctionnement du no-index ?

La déclaration de Gary Illyes est claire : une balise no-index empêche absolument l'indexation des pages concernées. Mais il ajoute une condition importante — « surtout si vous ne modifiez pas l'élément head d'une manière quelconque ». Cette formulation laisse entendre qu'une manipulation du head pourrait compromettre l'efficacité de la directive.

Google positionne explicitement le no-index comme deuxième choix après robots.txt pour bloquer un site de staging. C'est une hiérarchie qui peut surprendre : beaucoup de praticiens considèrent le no-index comme plus fiable que le Disallow dans robots.txt, notamment parce qu'il nécessite un crawl de la page pour être pris en compte.

Pourquoi cette précision sur la modification du head ?

La mention « si vous ne modifiez pas l'élément head » soulève des questions. Concrètement, cela pourrait viser les modifications JavaScript post-chargement : si une balise no-index est insérée ou retirée dynamiquement via JS après le rendu initial, Googlebot pourrait ne pas la détecter ou l'interpréter correctement.

Autre hypothèse : des conflits entre directives. Si le head contient à la fois un no-index en meta et un canonical vers une URL indexable, ou si X-Robots-Tag en HTTP header contredit la balise HTML, Google pourrait adopter un comportement imprévisible — même si, en théorie, le no-index devrait l'emporter.

Le no-index est-il vraiment infaillible en pratique ?

L'affirmation « elles ne seront absolument pas indexées » semble catégorique. Pourtant, sur le terrain, certains SEO ont observé des pages no-index apparaissant temporairement dans l'index — souvent avec un snippet vide ou une description tronquée. Ces cas restent rares et concernent généralement des pages récemment passées en no-index, avant que Google ne recrawle et supprime définitivement l'URL.

Le délai de suppression peut aussi varier selon le crawl budget et l'autorité du site. Une page no-index sur un petit site peut disparaître en quelques jours, alors qu'une URL ancienne sur un domaine puissant peut persister plusieurs semaines dans l'index avant d'être effectivement retirée.

- La balise no-index empêche l'indexation, mais nécessite un crawl préalable pour être prise en compte

- Robots.txt bloque le crawl en amont, d'où son statut de « premier choix » pour les environnements de staging

- Modifier le head dynamiquement (JS, conflits de directives) peut compromettre l'efficacité du no-index

- Des apparitions temporaires dans l'index peuvent survenir avant que Google ne recrawle et supprime l'URL

- Le délai de retrait dépend du crawl budget et de l'autorité du domaine

Avis d'un expert SEO

Cette hiérarchie robots.txt > no-index est-elle vraiment cohérente ?

Positionner robots.txt comme « premier choix » pour bloquer un staging peut sembler contre-intuitif. En effet, si une URL est bloquée par robots.txt, Google ne peut pas crawler la page — donc ne peut pas voir une éventuelle balise no-index présente dans le head. Si des liens externes pointent vers ces URLs bloquées, elles peuvent quand même apparaître dans l'index sans description, justement parce que Googlebot n'a jamais pu vérifier le contenu.

Le no-index, lui, nécessite que Google crawle la page pour lire la directive, mais une fois détectée, l'URL est retirée de l'index de manière plus propre. Soyons honnêtes : en environnement de staging, le risque de liens externes est faible — d'où la recommandation de Google. Mais pour un site en production avec des URLs déjà crawlées, le no-index reste plus fiable.

Quelles nuances faut-il apporter à cette affirmation absolue ?

L'expression « absolument pas indexées » mérite d'être tempérée. Dans les faits, on observe des cas limites : pages no-index qui restent brièvement visibles dans l'index après un changement de directive, URLs bloquées par robots.txt qui s'affichent quand même (sans snippet), pages no-index détectées tardivement si le crawl budget est serré.

Autre point : la mention « surtout si vous ne modifiez pas l'élément head » laisse une zone grise. [À vérifier] Qu'entend exactement Google par « modification » ? Une balise canonical ajoutée ultérieurement ? Un changement de langue en hreflang ? Un no-index injecté via JavaScript côté client ? La formulation reste floue et mériterait des tests contrôlés pour cartographier les scénarios problématiques.

Dans quels cas cette règle ne s'applique-t-elle pas comme prévu ?

Plusieurs situations peuvent poser problème. Premier cas : conflit entre X-Robots-Tag HTTP et meta robots HTML. Si le serveur renvoie un header « X-Robots-Tag: index » tandis que le HTML contient un no-index, Google devrait théoriquement privilégier le header — mais le comportement peut varier selon les versions de Googlebot.

Deuxième cas : no-index ajouté après indexation. Si une page est déjà dans l'index et que vous ajoutez un no-index, elle ne disparaîtra qu'après un nouveau crawl. Durant cette période, elle reste techniquement indexée. Pour un retrait urgent, passer par la Search Console (suppression temporaire) reste plus rapide.

Impact pratique et recommandations

Que faut-il faire concrètement pour bloquer un environnement de staging ?

Pour un site de staging, la recommandation de Google est claire : privilégiez robots.txt avec un Disallow total en première ligne. Ajoutez également une authentification HTTP (htpasswd) pour empêcher tout accès non autorisé — c'est la barrière la plus sûre, bien avant toute directive SEO.

Si vous optez pour le no-index (deuxième choix selon Google), placez la balise en dur dans le HTML, pas via JavaScript. Vérifiez qu'aucun conflit n'existe avec d'autres directives dans le head : canonical, hreflang, X-Robots-Tag en header. Testez l'URL via la Search Console pour confirmer que Google détecte bien le no-index.

Quelles erreurs éviter avec la balise no-index ?

Erreur classique : bloquer une page no-index dans robots.txt. Résultat : Google ne peut pas crawler, ne voit jamais le no-index, et si des backlinks pointent vers cette URL, elle apparaît dans l'index sous forme de squelette (titre = URL, pas de description).

Deuxième erreur : modifier le no-index dynamiquement. Si votre CMS ou un plugin insère la balise via JavaScript après le DOM initial, Googlebot peut ne pas l'interpréter — surtout si le JS met du temps à s'exécuter ou si le rendu échoue. Gardez cette directive au plus près du HTML statique, idéalement dans les premières lignes du head.

Troisième erreur : laisser un no-index sur des pages stratégiques en production. Ça arrive plus souvent qu'on ne le pense : un no-index oublié après une phase de dev, une règle globale mal configurée dans le CMS, une condition PHP qui s'applique par erreur. Un audit régulier des balises meta robots sur vos pages clés est indispensable.

Comment vérifier que votre no-index fonctionne correctement ?

Utilisez l'outil d'inspection d'URL dans la Search Console. Entrez l'URL concernée, lancez un test en direct, et vérifiez dans l'onglet « Couverture » que Google détecte bien « Exclue par la balise 'noindex' ». Si ce n'est pas le cas, inspectez le HTML rendu pour voir si la balise est présente et correctement formatée.

En complément, un crawl Screaming Frog ou Oncrawl permet de cartographier toutes les pages no-index sur votre site. Croisez cette liste avec vos URLs stratégiques : si une page importante apparaît en no-index, vous avez un problème. Automatisez cette vérification mensuellement pour détecter les dérives.

- Privilégiez robots.txt + authentification HTTP pour bloquer un staging

- Si vous utilisez no-index, placez-le en dur dans le HTML, pas en JavaScript

- Ne combinez jamais no-index et Disallow sur la même URL

- Vérifiez l'absence de conflits avec canonical, X-Robots-Tag, hreflang

- Testez chaque URL no-index via l'outil d'inspection de la Search Console

- Auditez régulièrement vos pages stratégiques pour détecter les no-index indésirables

- Documentez vos règles no-index dans un fichier de configuration centralisé

❓ Questions frequentes

Peut-on combiner no-index et Disallow dans robots.txt sur la même URL ?

Combien de temps faut-il pour qu'une page no-index disparaisse de l'index ?

Un no-index inséré via JavaScript est-il pris en compte par Google ?

Que se passe-t-il si un header X-Robots-Tag contredit la balise no-index en HTML ?

Pourquoi Google recommande-t-il robots.txt avant no-index pour bloquer un staging ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.