Declaration officielle

Autres déclarations de cette vidéo 10 ▾

- □ Pourquoi robots.txt suffit-il (presque toujours) à bloquer l'indexation d'un site de staging ?

- □ La protection par mot de passe est-elle vraiment la solution pour bloquer l'indexation d'un site de staging ?

- □ La balise no-index bloque-t-elle vraiment toute indexation sans exception ?

- □ Les pages orphelines sont-elles vraiment invisibles pour Google ?

- □ Google peut-il vraiment découvrir tous vos sous-domaines ?

- □ Faut-il vraiment soumettre manuellement ses pages importantes au lancement d'un site ?

- □ La qualité du contenu bloque-t-elle réellement l'indexation de masse ?

- □ Un nom de domaine propre améliore-t-il vraiment la mémorisation de votre marque ?

- □ Les listes blanches IP suffisent-elles vraiment à protéger vos sites de staging du crawl Google ?

- □ Faut-il vraiment faire du SEO pour un site à fonctionnalité ?

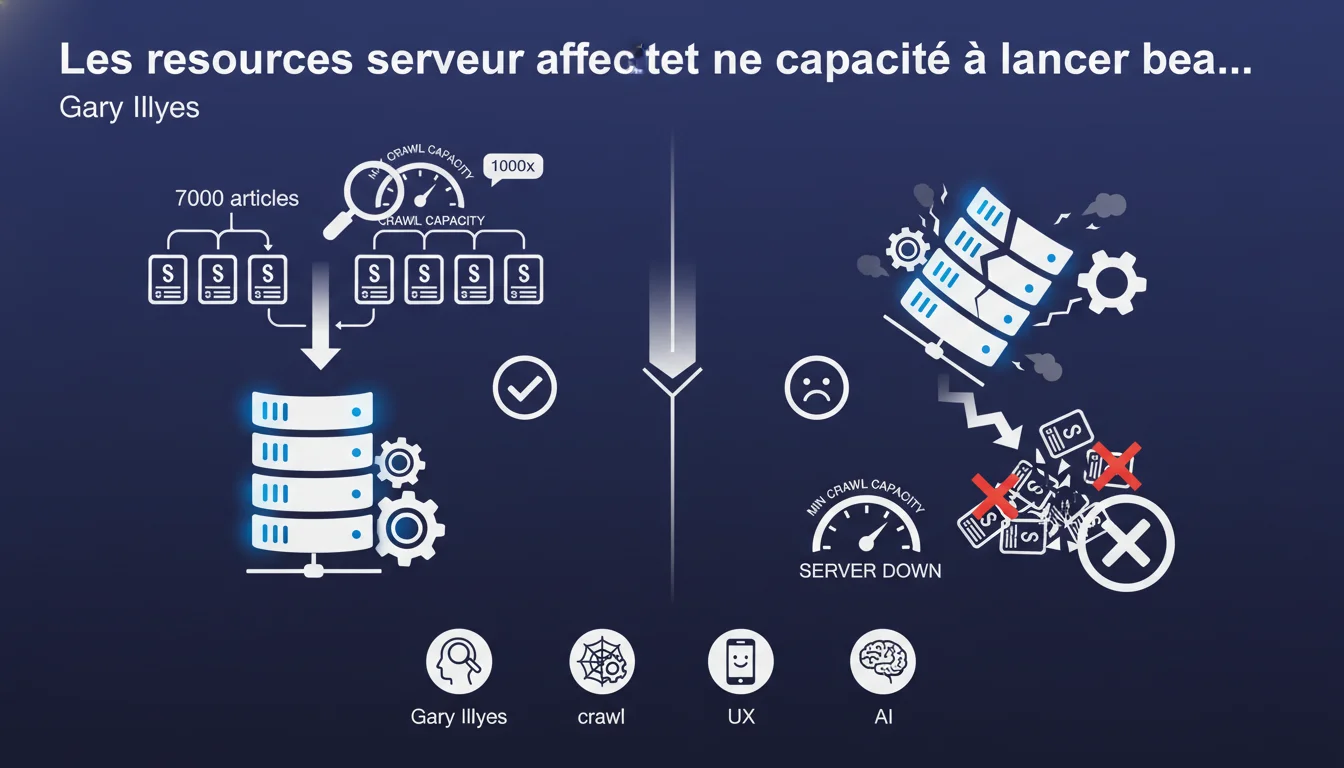

Gary Illyes confirme qu'un lancement massif de contenu (7000 articles par exemple) ne pose aucun problème côté indexation si votre serveur peut encaisser un crawl multiplié par 1000. Dans le cas contraire, votre infrastructure risque de s'effondrer sous la charge. Le goulot d'étranglement n'est pas chez Google, mais dans vos ressources serveur.

Ce qu'il faut comprendre

Pourquoi Google parle-t-il de crawl multiplié par 1000 ?

Google ne se contente pas de crawler chaque URL une seule fois lors d'un lancement massif. L'algorithme va tester la fraîcheur du contenu, vérifier les ressources liées (CSS, JS, images), explorer le maillage interne et revisiter les pages pour détecter les modifications.

Un site qui publie 7000 pages nouvelles peut facilement générer plusieurs dizaines de milliers de requêtes serveur en quelques heures. Si votre infrastructure n'est pas dimensionnée pour absorber ce pic brutal, les temps de réponse explosent et Googlebot ralentit automatiquement — ou pire, votre serveur plante.

Est-ce que cela signifie que Google n'a aucune limite de son côté ?

Non. Google dispose d'un crawl budget alloué à chaque site selon sa popularité, son autorité et la qualité de ses contenus. Ce que Gary Illyes précise ici, c'est que ce n'est pas ce budget qui sera le facteur limitant dans un lancement massif.

Le vrai problème se situe côté serveur : si vous ne pouvez pas servir les pages assez rapidement, Googlebot va espacer ses requêtes pour ne pas vous saturer. Résultat : votre indexation prendra des semaines au lieu de quelques jours.

Quels sont les critères pour déterminer si mon serveur tiendra le choc ?

Il faut mesurer plusieurs indicateurs : temps de réponse moyen (TTFB), capacité de traitement simultané (nombre de requêtes concurrentes), ressources CPU/RAM disponibles et taux d'erreur 5xx sous charge. Un serveur correctement dimensionné doit maintenir un TTFB inférieur à 200ms même avec 500 requêtes/seconde.

Les infrastructures mutualisées bas de gamme ou les petits VPS vont s'effondrer. Un CDN, une mise en cache agressive et une architecture scalable (cloud auto-scalable, serveurs dédiés performants) sont indispensables.

- Un lancement massif de contenu génère un crawl multiplié par 1000 ou plus

- Le crawl budget de Google n'est pas le facteur limitant — c'est votre serveur

- Un serveur sous-dimensionné ralentit l'indexation ou plante complètement

- TTFB, capacité concurrente et taux d'erreur 5xx sont les métriques clés

- Un CDN et une infrastructure scalable sont obligatoires pour absorber le pic

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. J'ai vu des sites avec du contenu de qualité rester bloqués pendant des semaines après un lancement massif, non pas parce que Google refusait d'indexer, mais parce que le serveur ne suivait pas. Les logs montrent clairement Googlebot qui espace ses requêtes quand les temps de réponse dépassent 500ms.

À l'inverse, des sites avec une architecture solide (Cloudflare + serveurs dédiés + cache optimisé) ont vu 10 000 pages indexées en moins de 72h. La différence ne vient pas du crawl budget mais de la capacité à servir le contenu rapidement.

Quelles nuances faut-il apporter à cette affirmation ?

Gary Illyes simplifie volontairement. [À vérifier] : la notion de « crawl multiplié par 1000 » reste floue. Est-ce une moyenne constatée ? Un maximum théorique ? Aucune donnée précise n'est fournie.

De plus, cette recommandation suppose que le contenu lancé est de qualité suffisante pour mériter l'indexation. Si Google détecte du spam ou du thin content, même avec un serveur béton, l'indexation sera bridée. La puissance serveur ne compense jamais la médiocrité éditoriale.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Sur des sites totalement nouveaux avec zéro autorité, le crawl budget initial est tellement faible qu'un lancement massif n'a aucun intérêt. Google va crawler 50 pages par jour quoi qu'il arrive — que vous en publiiez 100 ou 10 000 ne change rien.

Autre exception : les sites avec des pénalités algorithmiques ou un historique de contenu dupliqué. Même avec un serveur NASA, l'indexation restera volontairement ralentie par Google pour limiter la pollution de l'index.

Impact pratique et recommandations

Que faut-il faire concrètement avant un lancement massif ?

Avant toute chose, testez votre infrastructure sous charge. Utilisez des outils comme Apache Bench, JMeter ou LoadImpact pour simuler 500-1000 requêtes/seconde et observer comment votre serveur réagit. Si le TTFB dépasse 300ms ou que des erreurs 503 apparaissent, vous n'êtes pas prêt.

Déployez un CDN performant (Cloudflare, Fastly, Akamai) et configurez une mise en cache agressive. Les ressources statiques (images, CSS, JS) ne doivent jamais solliciter votre serveur d'origine. Activez le cache HTML pour les pages anonymes si votre CMS le permet.

Préparez un sitemap XML propre et segmenté avec uniquement les nouvelles URLs. Soumettez-le via Search Console juste avant le lancement pour signaler à Google qu'un gros volume arrive. Surveillez ensuite les logs serveur en temps réel pour détecter toute anomalie.

Quelles erreurs éviter absolument ?

Ne lancez jamais 7000 pages sans avoir préalablement audité la qualité du contenu. Google ne va pas indexer aveuglément : si les pages sont thin, dupliquées ou bourrées de mots-clés, vous gaspillez des ressources serveur pour rien.

Évitez également de publier tout d'un coup un vendredi soir ou juste avant un week-end férié. Si un problème technique survient (crawl qui fait planter le serveur, indexation bloquée), vous n'aurez personne pour réagir rapidement. Planifiez le lancement un mardi ou mercredi matin.

Ne négligez pas le monitoring post-lancement. Installez des alertes sur les métriques critiques : pics de CPU, temps de réponse, taux d'erreur 5xx, et taux d'indexation dans Search Console. Une dégradation progressive peut passer inaperçue sans outils de surveillance.

Comment vérifier que mon infrastructure est adaptée ?

Regardez vos Core Web Vitals sous charge réelle. Un LCP qui explose à 4 secondes quand le crawl bat son plein indique un serveur sous-dimensionné. Consultez aussi les rapports « Statistiques d'exploration » dans Search Console : un temps de réponse moyen supérieur à 500ms est un signal d'alarme.

Testez la scalabilité horizontale de votre stack. Si vous êtes sur un VPS unique, envisagez de migrer vers une architecture cloud (AWS, GCP, Azure) avec auto-scaling. Un serveur qui peut doubler sa capacité en 5 minutes absorbe bien mieux un pic imprévu.

- Tester l'infrastructure avec 500-1000 requêtes/seconde simulées

- Déployer un CDN performant et activer le cache HTML agressif

- Segmenter le sitemap XML et le soumettre juste avant le lancement

- Auditer la qualité du contenu avant publication massive

- Planifier le lancement un jour ouvré avec équipe disponible

- Installer un monitoring temps réel sur CPU, TTFB, erreurs 5xx

- Vérifier les Core Web Vitals et temps de réponse dans Search Console

- Prévoir une scalabilité horizontale (cloud auto-scalable)

❓ Questions frequentes

Quel est le bon moment pour lancer 7000 articles d'un coup ?

Un CDN suffit-il à absorber un crawl massif ?

Combien de temps faut-il pour indexer 7000 pages dans le meilleur des cas ?

Faut-il augmenter le crawl budget manuellement avant un lancement massif ?

Que faire si le serveur plante pendant le crawl massif ?

🎥 De la même vidéo 10

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/04/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.