Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Google choisit-il vraiment les titres de page indépendamment de la requête de l'utilisateur ?

- □ Changer un nom de ville suffit-il à créer des doorway pages condamnables par Google ?

- □ Faut-il vraiment centraliser son contenu compétitif plutôt que le dupliquer ?

- □ Découvert mais non indexé : Google n'a-t-il vraiment jamais crawlé ces pages ?

- □ Pourquoi Google refuse-t-il d'indexer un site techniquement parfait ?

- □ Faut-il encore corriger les redirections cassées longtemps après une migration ?

- □ Passer d'un ccTLD à un gTLD suffit-il pour conquérir de nouveaux marchés internationaux ?

- □ Sous-domaine ou sous-répertoire : Google a-t-il vraiment une préférence ?

- □ Pourquoi les clics par page et par requête diffèrent-ils dans Search Console ?

- □ Les erreurs de données structurées bloquent-elles vraiment l'indexation de vos pages ?

- □ Le maillage interne révèle-t-il vraiment l'importance de vos pages à Google ?

- □ L'attribut target des liens a-t-il un impact sur le référencement Google ?

- □ Faut-il vraiment supprimer tous les breadcrumbs schema sauf un pour éviter la confusion ?

- □ Pourquoi vos images CSS background-image sont-elles invisibles pour Google Images ?

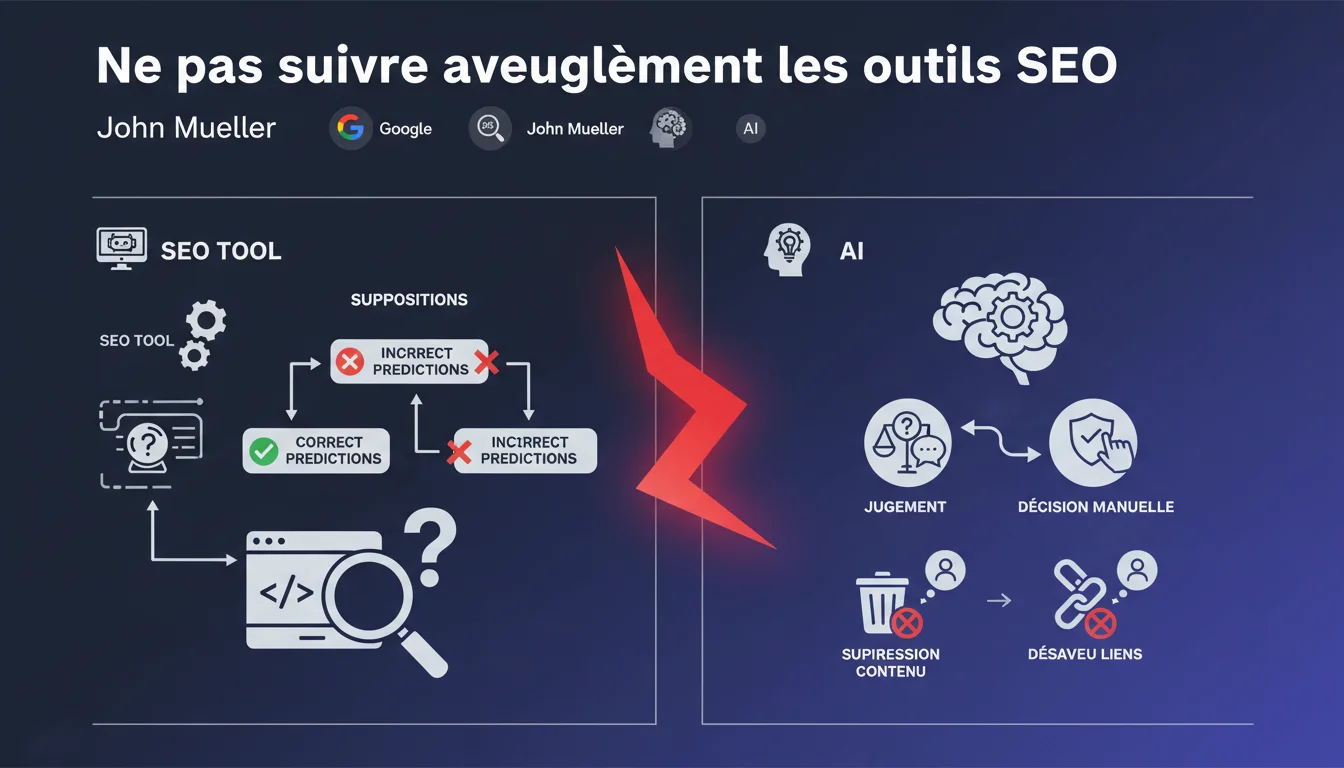

Les outils SEO fonctionnent sur des hypothèses qui peuvent être fausses sur la manière dont Google évalue réellement votre site. Mueller met en garde contre l'application mécanique de leurs recommandations, notamment sur la suppression de contenu ou le désaveu de liens — deux actions irréversibles qui peuvent détruire votre visibilité si elles reposent sur de mauvaises prémisses.

Ce qu'il faut comprendre

Pourquoi Google remet-il en question la fiabilité des outils SEO ?

Les outils SEO — qu'ils s'appellent Ahrefs, Semrush, Screaming Frog ou autre — reposent sur des modèles prédictifs. Ils analysent des corrélations, extrapolent des patterns, et tentent de deviner ce que Google valorise ou pénalise. Le problème ? Ces modèles ne reflètent pas le fonctionnement interne de l'algorithme. Ils observent des résultats et en déduisent des causes.

Un outil peut par exemple affirmer qu'un lien est toxique parce qu'il provient d'un site à faible autorité. Mais Google n'a jamais confirmé utiliser cette métrique. Pire : désavouer ce lien peut parfois supprimer un signal positif que l'algorithme prenait en compte via d'autres dimensions (contexte sémantique, pertinence thématique, etc.).

Quelles actions sont particulièrement risquées selon Mueller ?

Deux recommandations reviennent systématiquement dans les audits automatisés : supprimer du contenu jugé « faible » et désavouer des liens « toxiques ». Ces deux actions sont irréversibles à court terme et peuvent détruire des années de travail si elles reposent sur de fausses hypothèses.

La suppression de contenu peut faire chuter vos positions si Google y trouvait une valeur sémantique ou un contexte d'autorité que l'outil n'a pas su détecter. Le désaveu de liens peut annuler des signaux positifs que Google exploitait — mais que l'outil a mal interprétés faute d'accès aux critères réels de l'algorithme.

Les outils SEO sont-ils pour autant inutiles ?

Non. Mais ils doivent être considérés comme des indicateurs, pas comme des prescripteurs. Ils détectent des anomalies, identifient des tendances, mettent en lumière des opportunités. Mais la décision finale doit reposer sur une analyse humaine qui prend en compte le contexte métier, l'historique du site, et les objectifs stratégiques.

Un outil peut alerter sur 500 pages dupliquées. À vous de déterminer si ces pages servent réellement les utilisateurs, si elles génèrent du trafic qualifié, ou si elles sont effectivement du bruit inutile. L'outil ne peut pas faire cette distinction — il applique une règle générique à un contexte particulier.

- Les outils SEO modélisent Google, ils ne le reproduisent pas

- Supprimer du contenu ou désavouer des liens sont des actions irréversibles à risque

- Les recommandations automatiques doivent être filtrées par votre jugement et votre connaissance du site

- Un outil détecte des patterns, mais seul un humain peut interpréter leur pertinence dans un contexte donné

Avis d'un expert SEO

Cette mise en garde est-elle cohérente avec les pratiques observées sur le terrain ?

Absolument. On observe régulièrement des sites qui appliquent à la lettre les recommandations d'un audit automatique et perdent 30 à 50 % de leur trafic organique dans les semaines suivantes. Cas typique : suppression massive de « contenu faible » détecté par un outil qui se base uniquement sur le nombre de mots ou le taux de rebond.

Sauf que Google ne raisonne pas comme ça. Une page courte peut être parfaitement pertinente si elle répond précisément à l'intention de recherche. Un taux de rebond élevé peut signifier que l'utilisateur a trouvé sa réponse immédiatement — pas que la page est mauvaise. Les outils ne captent pas ces nuances.

Dans quels cas les outils se trompent-ils le plus souvent ?

Les profils de liens atypiques sont le premier piège. Un site de niche peut avoir un backlink profile « bizarre » selon les standards génériques (ratio follow/nofollow inhabituel, ancres suroptimisées dans un secteur où c'est la norme), mais parfaitement légitime dans son contexte sectoriel.

Second cas classique : les contenus à faible volume de recherche. Un outil va signaler qu'une page ne génère que 10 visites/mois et recommander sa suppression. Mais si ces 10 visites convertissent à 40 % et génèrent un panier moyen élevé, cette page a plus de valeur business que 100 pages générant 1 000 visites à 0,5 % de conversion.

[À vérifier] Les outils qui prétendent mesurer la « toxicité » d'un lien se basent sur des métriques propriétaires dont la corrélation réelle avec les pénalités Google n'a jamais été démontrée publiquement. Aucune étude à grande échelle ne valide que leurs scores prédisent effectivement un risque de sanction.

Quand faut-il quand même suivre les recommandations d'un outil ?

Quand elles portent sur des problèmes techniques objectifs : balises title dupliquées, pages en 404 liées depuis votre site, temps de chargement excessif, absence de HTTPS, robots.txt bloquant des ressources critiques. Ces diagnostics sont factuels — soit c'est cassé, soit ça ne l'est pas.

En revanche, dès qu'on entre dans l'interprétation qualitative (« ce contenu est trop court », « ce lien est toxique », « cette page n'a pas assez d'autorité »), le jugement humain doit reprendre la main. L'outil signale, vous décidez.

Impact pratique et recommandations

Comment évaluer la pertinence d'une recommandation outil avant de l'appliquer ?

Première étape : croiser les sources. Si trois outils différents signalent le même problème technique (balise manquante, lien cassé), c'est probablement fondé. Si un seul outil vous alerte sur du « contenu faible » que les autres ne détectent pas, creusez avant d'agir.

Deuxième étape : analyser l'impact réel. Avant de supprimer une page ou désavouer un lien, regardez les données Analytics et Search Console. Cette page génère-t-elle du trafic qualifié ? Ce lien envoie-t-il des visiteurs qui convertissent ? Si oui, pourquoi la supprimer sous prétexte qu'un algorithme externe la juge « faible » ?

Troisième étape : tester à petite échelle. Si vous avez un doute sur une recommandation massive (supprimer 200 pages, désavouer 1 000 liens), commencez par un échantillon de 10 à 20 éléments et observez l'effet sur 4 à 6 semaines avant de généraliser.

Quelles erreurs éviter absolument avec les outils SEO ?

Ne jamais appliquer en bloc une action suggérée par un bouton « Corriger automatiquement » ou « Appliquer les recommandations ». Ces fonctionnalités sont conçues pour simplifier, mais elles ne peuvent pas prendre en compte votre contexte métier, votre historique, vos objectifs spécifiques.

Évitez aussi de désavouer des liens sans avoir d'abord vérifié manuellement leur nature. Un outil peut signaler comme toxique un lien provenant d'un annuaire sectoriel parfaitement légitime simplement parce que ce site héberge aussi d'autres annuaires moins qualitatifs. Google sait faire la part des choses — pas l'outil.

- Croiser les diagnostics de plusieurs outils avant de prendre une décision

- Consulter Analytics et Search Console pour mesurer l'impact réel du « problème » détecté

- Tester les recommandations sur un échantillon réduit avant toute action massive

- Ne jamais supprimer du contenu ou désavouer des liens sans analyse humaine préalable

- Privilégier les corrections techniques objectives (404, redirections, vitesse) aux optimisations qualitatives subjectives

- Documenter chaque modification pour pouvoir revenir en arrière si les résultats se dégradent

Qui peut vous accompagner pour interpréter correctement ces données ?

Face à la complexité croissante des algorithmes et à la multiplication des outils, interpréter correctement les recommandations automatiques demande une expertise pointue et une veille permanente. Un mauvais diagnostic peut coûter des mois de trafic et de revenus.

Si votre équipe interne n'a pas les ressources ou l'expérience pour auditer ces recommandations en profondeur, faire appel à une agence SEO spécialisée peut vous éviter des erreurs coûteuses. Un regard externe et expérimenté permet souvent d'identifier les priorités réelles, de filtrer le bruit généré par les outils, et de construire une stratégie d'optimisation adaptée à votre contexte — pas à des règles génériques.

❓ Questions frequentes

Peut-on faire confiance aux scores d'autorité de domaine (DA, DR, etc.) ?

Combien d'outils SEO faut-il utiliser pour avoir une vision complète ?

Un audit automatique peut-il remplacer une analyse humaine ?

Faut-il désavouer tous les liens marqués comme toxiques par un outil ?

Les recommandations de contenu des outils sont-elles fiables ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.