Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Google choisit-il vraiment les titres de page indépendamment de la requête de l'utilisateur ?

- □ Changer un nom de ville suffit-il à créer des doorway pages condamnables par Google ?

- □ Faut-il vraiment centraliser son contenu compétitif plutôt que le dupliquer ?

- □ Découvert mais non indexé : Google n'a-t-il vraiment jamais crawlé ces pages ?

- □ Pourquoi Google refuse-t-il d'indexer un site techniquement parfait ?

- □ Faut-il vraiment faire confiance aux recommandations de vos outils SEO ?

- □ Faut-il encore corriger les redirections cassées longtemps après une migration ?

- □ Passer d'un ccTLD à un gTLD suffit-il pour conquérir de nouveaux marchés internationaux ?

- □ Sous-domaine ou sous-répertoire : Google a-t-il vraiment une préférence ?

- □ Les erreurs de données structurées bloquent-elles vraiment l'indexation de vos pages ?

- □ Le maillage interne révèle-t-il vraiment l'importance de vos pages à Google ?

- □ L'attribut target des liens a-t-il un impact sur le référencement Google ?

- □ Faut-il vraiment supprimer tous les breadcrumbs schema sauf un pour éviter la confusion ?

- □ Pourquoi vos images CSS background-image sont-elles invisibles pour Google Images ?

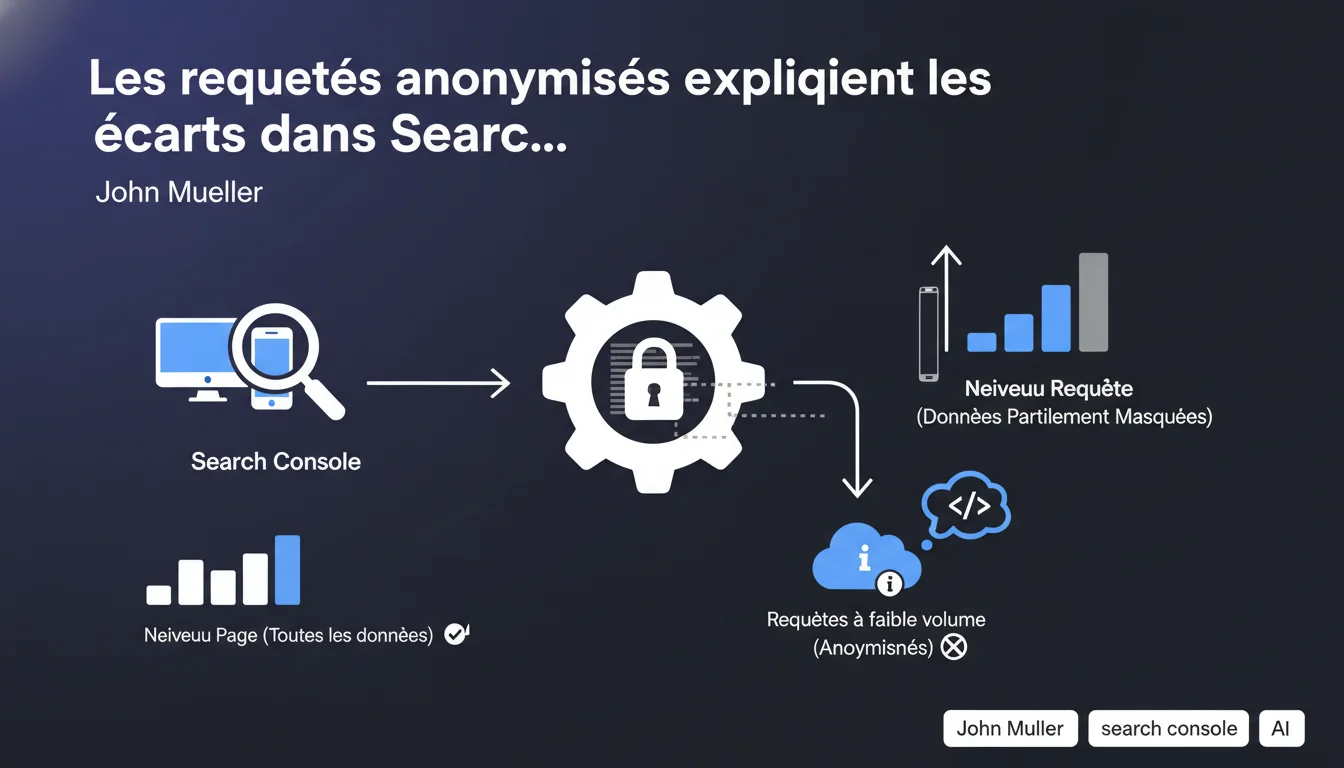

Google confirme que les écarts entre clics au niveau page et clics au niveau requête dans Search Console s'expliquent par l'anonymisation de certaines requêtes à faible volume. Les données globales au niveau page restent complètes, mais certaines requêtes individuelles disparaissent du rapport détaillé pour protéger la confidentialité des utilisateurs.

Ce qu'il faut comprendre

Quelle est la différence entre les deux rapports de clics ?

Search Console propose deux angles d'analyse : un rapport au niveau page qui agrège tous les clics reçus par une URL, et un rapport au niveau requête qui détaille les clics par mot-clé.

Le premier affiche le total exact de clics. Le second filtre certaines requêtes considérées comme trop peu volumineuses ou potentiellement identifiantes. Résultat : la somme des clics des requêtes individuelles est souvent inférieure au total page.

Pourquoi Google anonymise-t-il certaines requêtes ?

Google applique un seuil de confidentialité pour éviter qu'un propriétaire de site puisse déduire l'identité d'un utilisateur via une requête ultra-spécifique avec un seul clic. Ce seuil n'est pas documenté publiquement, mais on observe empiriquement qu'il concerne les requêtes à très faible volume.

Concrètement, si une requête génère 1 à 3 clics sur une période donnée, elle peut être masquée dans le rapport détaillé. Cela touche surtout la longue traîne, qui représente pourtant une part significative du trafic organique.

Quelles sont les implications pour l'analyse SEO ?

Les données agrégées restent fiables : le nombre total de clics, d'impressions et le CTR moyen au niveau page sont exacts. En revanche, si vous tentez de reconstituer ce total en sommant les clics par requête, vous aurez systématiquement un écart.

Ce décalage est plus marqué pour les sites avec un trafic diversifié et une forte proportion de longue traîne. Pour un site e-commerce avec des milliers de références, l'écart peut atteindre 20 à 30 % du volume total.

- Les clics au niveau page reflètent la réalité complète du trafic organique

- Les requêtes anonymisées concernent principalement la longue traîne à faible volume

- L'écart est structurel et ne signale pas une erreur de tracking

- Les données de positionnement moyen et d'impressions peuvent aussi être impactées

Avis d'un expert SEO

Cette explication tient-elle la route face aux observations terrain ?

Oui. Les tests que nous menons depuis des années confirment ce mécanisme d'anonymisation. Sur des sites à fort trafic avec une longue traîne développée, on observe systématiquement un delta de 15 à 35 % entre la somme des clics par requête et le total page.

Ce qui est moins documenté — et que Google ne précise pas ici — c'est le seuil exact déclenchant l'anonymisation. D'après nos observations, il varie selon la période analysée : une requête peut apparaître sur 28 jours mais disparaître sur 7 jours si le volume quotidien est trop faible. [A vérifier] : aucune documentation officielle ne détaille ces seuils dynamiques.

Quels sont les angles morts de cette déclaration ?

Mueller ne dit rien sur la manière dont Google calcule le positionnement moyen pour les pages avec de nombreuses requêtes anonymisées. Si 30 % des requêtes disparaissent du rapport détaillé, le « position moyenne » affiché est-il calculé sur l'ensemble des requêtes ou uniquement sur celles affichées ?

Nos tests suggèrent que la métrique « position moyenne » au niveau page inclut bien toutes les requêtes, y compris anonymisées. Mais au niveau requête, l'absence de certaines données peut fausser l'analyse concurrentielle si vous comparez votre visibilité à celle d'un concurrent dont le profil de requêtes est différent.

Peut-on contourner cette limitation ?

Non, et c'est assumé par Google pour des raisons légales (RGPD, CCPA). En revanche, vous pouvez croiser les sources : Google Analytics (ou GA4) capte toutes les sessions organiques sans anonymisation côté requête si vous avez paramétré le tracking des termes de recherche via Search Console.

Le hic : GA4 ne reçoit plus les mots-clés organiques depuis le passage au « not provided » — sauf si vous liez Search Console. Même là, l'API Search Console transmise à GA4 applique la même règle d'anonymisation. Bref, aucune échappatoire technique propre.

Impact pratique et recommandations

Comment interpréter correctement vos données Search Console ?

Utilisez systématiquement les rapports au niveau page pour mesurer la performance globale d'une URL (clics totaux, CTR, impressions). Ne vous fiez pas à la somme des clics par requête pour reconstituer le total — c'est structurellement faussé.

Pour l'analyse de la visibilité par mot-clé, concentrez-vous sur les requêtes à volume significatif. Si une requête génère moins de 5 clics sur la période analysée, considérez qu'elle peut disparaître ou apparaître selon le filtre temporel appliqué.

Quelles erreurs d'analyse éviter absolument ?

Ne diagnostiquez jamais une « perte de trafic » en comparant la somme des clics par requête entre deux périodes. L'écart peut simplement refléter une variation du nombre de requêtes anonymisées, pas une vraie baisse de performance.

Évitez aussi de conclure qu'une page « n'apparaît pas » sur une requête parce qu'elle n'est pas listée dans le rapport détaillé. Elle peut très bien ranker et générer quelques clics, mais sous le seuil d'affichage.

Que faire concrètement pour piloter votre SEO malgré cette limite ?

- Exportez les données au niveau page pour vos analyses de trafic global et vos reportings clients

- Croisez Search Console avec vos logs serveur pour identifier les requêtes réelles même anonymisées côté GSC

- Utilisez des outils de rank tracking tiers pour suivre vos positions sur des requêtes stratégiques, indépendamment de Search Console

- Segmentez vos rapports par type de page (catégorie, fiche produit, article) pour mieux comprendre où se concentre la longue traîne anonymisée

- Privilégiez les tendances relatives (évolution du CTR, variation du nombre d'impressions) plutôt que les valeurs absolues reconstituées

❓ Questions frequentes

Pourquoi la somme des clics par requête est-elle inférieure au total page ?

Quel est le seuil de clics en dessous duquel une requête est anonymisée ?

Les données de position moyenne sont-elles affectées par l'anonymisation ?

Peut-on récupérer les requêtes anonymisées via l'API Search Console ?

Comment mesurer l'impact réel de la longue traîne si une partie est anonymisée ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.