Declaration officielle

Autres déclarations de cette vidéo 14 ▾

- □ Google choisit-il vraiment les titres de page indépendamment de la requête de l'utilisateur ?

- □ Changer un nom de ville suffit-il à créer des doorway pages condamnables par Google ?

- □ Faut-il vraiment centraliser son contenu compétitif plutôt que le dupliquer ?

- □ Découvert mais non indexé : Google n'a-t-il vraiment jamais crawlé ces pages ?

- □ Faut-il vraiment faire confiance aux recommandations de vos outils SEO ?

- □ Faut-il encore corriger les redirections cassées longtemps après une migration ?

- □ Passer d'un ccTLD à un gTLD suffit-il pour conquérir de nouveaux marchés internationaux ?

- □ Sous-domaine ou sous-répertoire : Google a-t-il vraiment une préférence ?

- □ Pourquoi les clics par page et par requête diffèrent-ils dans Search Console ?

- □ Les erreurs de données structurées bloquent-elles vraiment l'indexation de vos pages ?

- □ Le maillage interne révèle-t-il vraiment l'importance de vos pages à Google ?

- □ L'attribut target des liens a-t-il un impact sur le référencement Google ?

- □ Faut-il vraiment supprimer tous les breadcrumbs schema sauf un pour éviter la confusion ?

- □ Pourquoi vos images CSS background-image sont-elles invisibles pour Google Images ?

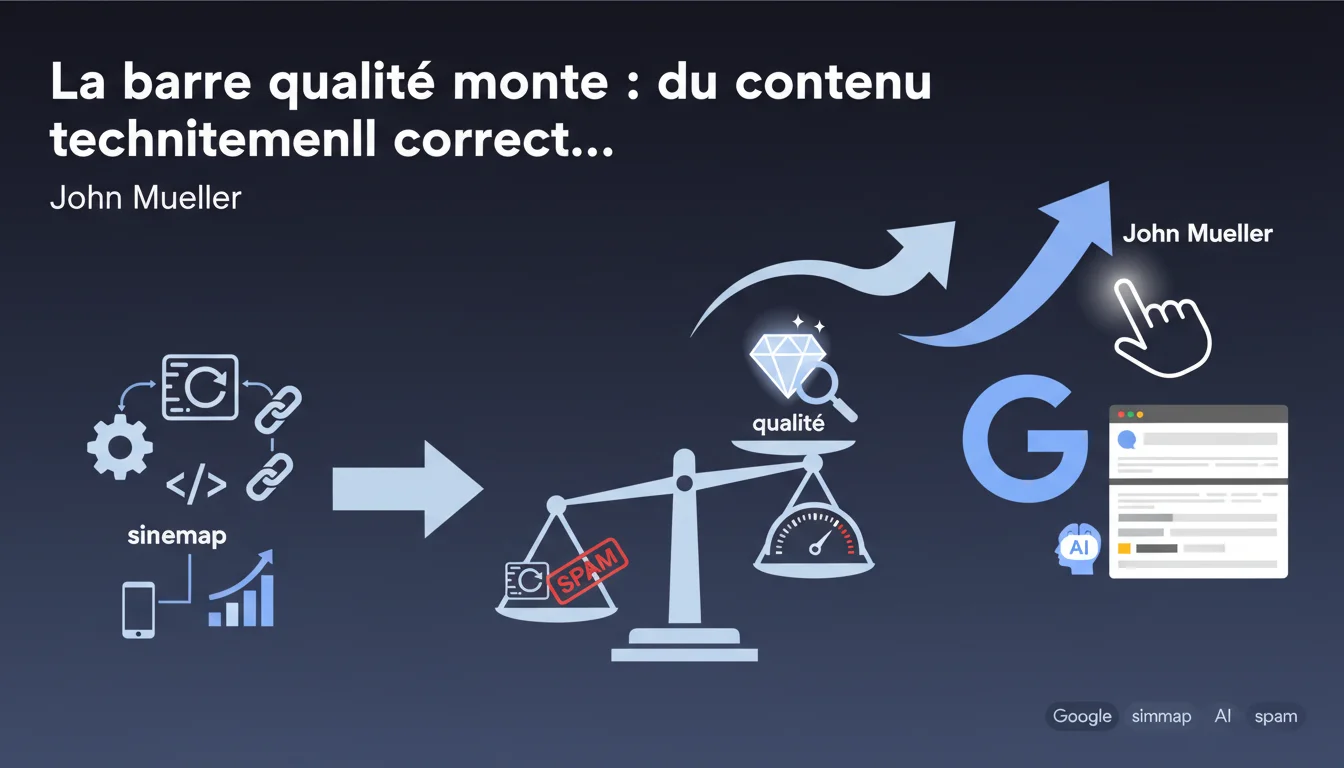

Google indexe de moins en moins de pages, même sur des sites techniquement irréprochables. La barre qualité s'élève : avoir un sitemap propre et des liens internes cohérents ne garantit plus rien. Seul le contenu jugé « critique » par l'algorithme mérite une place dans l'index.

Ce qu'il faut comprendre

Que signifie « techniquement correct » selon Google ?

Un site techniquement correct respecte les fondamentaux : sitemap XML à jour, structure de liens internes logique, absence de spam détectable. Ces critères étaient autrefois des conditions quasi-suffisantes pour l'indexation.

Aujourd'hui, Google affirme que ces éléments sont devenus la norme. Trop de sites cochent ces cases basiques pour que cela constitue un différenciateur. Le moteur doit donc filtrer autrement.

Qu'est-ce que Google entend par « contenu critique » ?

Le terme reste volontairement flou. Google parle de contenu critique pour les utilisateurs, sans préciser les métriques exactes. On peut supposer qu'il s'agit de pages répondant à une intention de recherche claire, apportant une valeur unique, ou générant de l'engagement.

Concrètement, cela signifie que Google trie désormais en amont : certaines pages ne franchiront jamais la porte de l'index, même si elles sont crawlables et sans erreur technique.

Pourquoi cette barre qualité s'élève-t-elle maintenant ?

L'explosion quantitative du web force Google à être plus sélectif. Les ressources de crawl et d'indexation ne sont pas infinies. Le moteur privilégie donc la qualité perçue pour limiter la taille de son index.

Cette montée de la barre coïncide aussi avec l'arrivée massive de contenus générés automatiquement ou par IA, souvent techniquement propres mais pauvres en valeur ajoutée. Google doit filtrer cette production industrielle.

- La conformité technique est devenue un prérequis, pas un avantage concurrentiel

- Google indexe de moins en moins de pages, même sur des sites bien structurés

- Le critère « contenu critique » reste subjectif et difficilement mesurable côté SEO

- Cette sélectivité vise à réduire la charge d'indexation face à la croissance exponentielle du web

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui, massivement. Depuis plusieurs mois, de nombreux sites rapportent une chute brutale des pages indexées, sans corrélation avec une dégradation technique. Des sections entières disparaissent de l'index alors que Search Console ne remonte aucune erreur.

Google semble désormais trier à la source : certaines catégories de contenu (pages produits à faible différenciation, articles informatifs génériques, pages low content) ne passent plus le filtre initial. Le crawl a lieu, mais l'indexation ne suit pas.

Quelles nuances faut-il apporter à ce message ?

Mueller ne précise pas comment Google évalue ce caractère « critique ». [A vérifier] : s'agit-il de signaux comportementaux (CTR, temps sur page), de backlinks, de trafic existant, ou d'une évaluation sémantique automatique ? Le flou est total.

Autre point crucial : cette élévation de la barre n'affecte pas tous les sites de la même manière. Les sites d'autorité établie semblent moins touchés que les nouveaux entrants ou les sites de niche. La confiance historique joue probablement un rôle tampon.

Dans quels cas cette règle ne s'applique-t-elle pas ?

Les sites d'actualité, paradoxalement, semblent moins concernés. Google indexe rapidement du contenu d'actualité même peu différencié, probablement parce que la fraîcheur reste un critère prioritaire dans certains contextes.

De même, les pages transactionnelles (e-commerce) continuent d'être indexées si elles présentent une offre unique ou rare. Le caractère « critique » semble aussi lié à la disponibilité de l'information ailleurs sur le web : si personne d'autre ne traite ce produit spécifique, Google indexe. Si 50 sites vendent le même article avec la même description fabricant, la sélection devient drastique.

Impact pratique et recommandations

Que faut-il faire concrètement pour franchir cette nouvelle barre qualité ?

Arrêtez immédiatement la production de contenu par volume. Mieux vaut 10 pages excellentes indexées que 100 pages moyennes ignorées. Concentrez vos ressources sur la profondeur et l'unicité du traitement.

Travaillez les signaux d'engagement : temps de lecture, taux de rebond, interactions. Si Google évalue le caractère « critique » via des métriques comportementales, ces indicateurs deviennent stratégiques. Un contenu que personne ne lit ne sera jamais jugé critique.

- Auditez votre index actuel via Search Console : identifiez les pages crawlées mais non indexées

- Analysez ces pages refusées pour détecter des patterns : contenu thin, duplication interne, faible engagement

- Renforcez la différenciation éditoriale : expertise unique, données propriétaires, angle original

- Réduisez le nombre de pages : fusionnez les contenus faibles, supprimez les doublons sémantiques

- Augmentez la visibilité interne des pages stratégiques via le maillage et les menus

- Mesurez l'engagement réel : installez des outils de scroll tracking, heatmaps, temps de lecture effectif

- Travaillez les backlinks sur les pages refusées : un signal externe fort peut forcer l'indexation

Quelles erreurs éviter dans ce nouveau contexte ?

Ne misez plus tout sur le sitemap XML. Ce n'est plus un levier d'indexation garanti, juste une suggestion que Google peut ignorer. Certains SEO continuent d'ajouter massivement des URLs au sitemap en espérant forcer l'indexation — ça ne fonctionne plus.

Évitez aussi de produire du contenu IA en série sans enrichissement humain. Google détecte probablement les patterns de génération automatique et les classe d'emblée en « non critique ». L'IA peut aider, mais le contenu final doit passer par une vraie curation.

Comment vérifier que mon contenu est jugé « critique » ?

Il n'existe pas d'outil officiel. Le seul indicateur fiable reste l'indexation effective, vérifiable via site:votredomaine.com ou Search Console. Si une page disparaît de l'index sans erreur technique, c'est qu'elle a été jugée non critique.

Mesurez aussi les impressions organiques sur vos nouvelles pages. Un contenu critique génère rapidement des impressions, même avec peu de clics. Un contenu ignoré reste à zéro impression pendant des semaines, signe qu'il n'a jamais été considéré pour le ranking.

❓ Questions frequentes

Un site peut-il être parfaitement optimisé techniquement et ne pas être indexé ?

Comment savoir si mon contenu est jugé « critique » par Google ?

Faut-il supprimer les pages non indexées pour améliorer le crawl budget ?

Le contenu généré par IA est-il automatiquement exclu de l'index ?

Cette barre qualité affecte-t-elle tous les types de sites de la même manière ?

🎥 De la même vidéo 14

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 22/03/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.