Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi le rendu côté client (CSR) met-il votre indexation Google en danger ?

- □ Pourquoi un échec de rendu JavaScript peut-il retarder votre indexation de plusieurs semaines ?

- □ Le JavaScript est-il vraiment indexé par Google ou faut-il encore s'en méfier ?

- □ Pourquoi le rendu côté client pose-t-il un problème structurel pour le crawl Google ?

- □ Faut-il abandonner le rendu côté client pour améliorer son référencement naturel ?

- □ Faut-il vraiment privilégier le code 410 au 404 pour signaler une page supprimée ?

- □ Est-ce que Google traite vraiment les codes 429, 503 et 500 de la même manière ?

- □ Les domaines Web3 (.eth) sont-ils crawlables par Google ?

- □ Pourquoi vos utilisateurs tapent-ils le nom de votre marque dans Google plutôt que votre URL ?

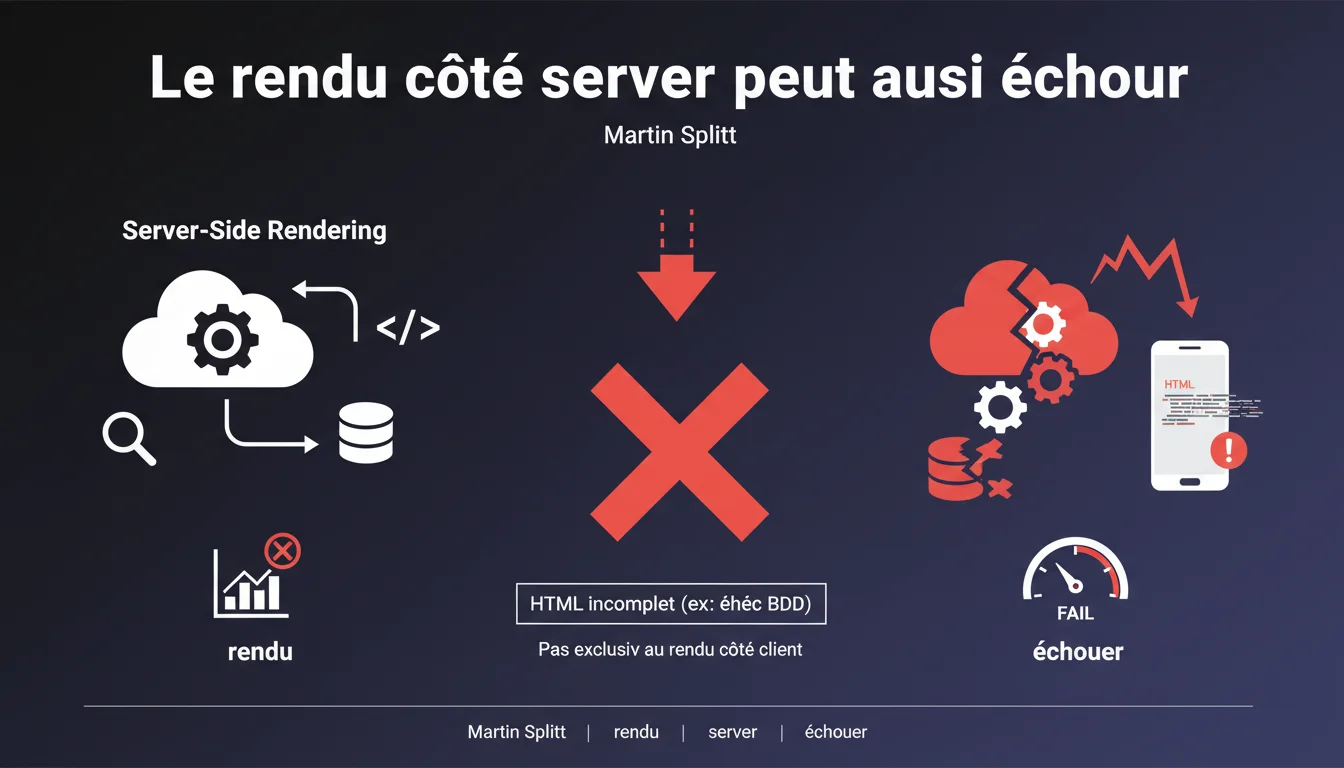

Google rappelle que le SSR (rendu côté serveur) peut aussi produire du HTML incomplet en cas d'échec technique — connexion base de données, timeout, erreur applicative. Le CSR (rendu côté client) reste plus fragile, mais le SSR n'est pas une garantie absolue d'indexabilité si la chaîne backend foire.

Ce qu'il faut comprendre

Pourquoi Google nuance-t-il l'opposition SSR vs CSR ?

La déclaration de Martin Splitt intervient dans un contexte où beaucoup de praticiens SEO considèrent le rendu côté serveur comme la solution ultime pour garantir l'indexation. Google rappelle ici que le SSR repose sur une chaîne technique backend — base de données, API, serveur applicatif — qui peut elle aussi tomber en panne.

Si votre serveur Node.js ne parvient pas à se connecter à PostgreSQL lors de la requête de Googlebot, le HTML renvoyé sera incomplet ou vide. Même logique qu'un site en CSR qui plante au chargement du JavaScript, sauf que l'échec se produit avant que le HTML n'atteigne le navigateur.

Le CSR est-il vraiment plus fragile dans les faits ?

Oui, et Splitt le confirme explicitement. Le rendu côté client dépend de plusieurs couches : téléchargement du JS, parsing, exécution, hydratation, appel d'API. Chaque étape peut échouer — timeout réseau, erreur JS, budget de rendu dépassé, JavaScript désactivé chez Googlebot (rare mais possible en cas de mode dégradé).

Le SSR élimine ces risques côté client, mais en introduit d'autres côté serveur. La différence ? Les pannes backend sont généralement visibles dans les logs serveur et détectables via monitoring, alors qu'une erreur JS côté Googlebot peut passer inaperçue pendant des semaines.

Que faut-il retenir pour la fiabilité de l'indexation ?

- Le SSR réduit les points de défaillance côté client, mais n'est pas une garantie si la stack backend est instable.

- Un site en CSR bien architecturé avec fallback HTML peut être plus fiable qu'un SSR fragile avec une DB surchargée.

- Google continue de crawler et indexer du CSR — le problème n'est pas binaire, c'est une question de fiabilité statistique.

- Les erreurs SSR (500, timeout) sont visibles dans Search Console, les erreurs CSR (JS qui plante) ne le sont pas toujours.

- La résilience d'un site dépend autant de l'architecture backend que du mode de rendu choisi.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Totalement. On observe régulièrement des sites en SSR qui servent du HTML partiel ou vide à Googlebot suite à des timeouts de base de données, des caches Redis qui tombent, des microservices indisponibles. Le crawler ne fait pas la différence entre un SSR qui échoue et un CSR qui plante — il voit juste du HTML incomplet.

Ce qui change ? La fréquence des échecs. Un CSR mal optimisé peut échouer pour 10-20% des crawls Googlebot (erreurs JS, budget dépassé), alors qu'un SSR bien monitoré échoue moins de 1% du temps. Mais quand il échoue, l'impact peut être massif si c'est un problème de config global.

Quelles nuances faut-il apporter à ce message ?

Splitt parle d'échecs techniques, pas de complexité d'implémentation. Un SSR Next.js ou Nuxt correctement déployé sur Vercel ou Netlify est statistiquement plus fiable qu'un SPA React pur. Mais un SSR custom mal architecté, avec une DB non répliquée et sans circuit breaker, peut devenir un cauchemar d'indexation.

Autre point : Google ne précise pas si ces échecs SSR impactent le classement ou juste l'indexation ponctuelle. [A vérifier] — on manque de données sur la tolérance de Google aux erreurs SSR intermittentes. Est-ce que 5% d'échecs backend dégradent le ranking ? Aucune donnée officielle là-dessus.

Dans quels cas le SSR pose-t-il plus de problèmes que le CSR ?

Quand le site dépend de données externes en temps réel pour chaque page — API tierces, bases de données distantes, calculs lourds côté serveur. Si votre SSR attend 3 secondes pour interroger une API avant de renvoyer le HTML, Googlebot risque de timeout avant de recevoir le contenu.

Le CSR avec skeleton screen et hydratation progressive peut dans ce cas être plus résilient : le HTML de base se charge immédiatement, le JS complète ensuite. Google voit au moins la structure de la page, même si le contenu dynamique met du temps.

Impact pratique et recommandations

Que faut-il faire concrètement pour sécuriser un site SSR ?

Monitorer les erreurs serveur 5xx dans Search Console et vos logs backend. Un pic d'erreurs 500 lors du crawl Googlebot signale un problème SSR que vous ne verrez pas forcément côté utilisateur (cache, CDN).

Implémenter des fallbacks gracieux : si la connexion DB échoue, servez quand même un HTML minimal avec les balises title, meta description, et structure sémantique. Mieux vaut un contenu partiel qu'une page blanche.

Tester la résilience avec des chaos engineering tests : simulez des pannes DB, des timeouts API, des surcharges serveur pendant que Googlebot crawle. Vérifiez que votre SSR dégrade proprement au lieu de crasher.

Quelles erreurs éviter lors d'une migration SSR ?

- Ne pas mettre en place de monitoring backend avant la migration — vous découvrirez les problèmes trop tard.

- Supposer que le SSR résout tous les problèmes d'indexation — si votre contenu dépend d'appels API lents, le problème persiste.

- Oublier de configurer des timeouts côté serveur — un SSR qui attend 30 secondes pour une réponse DB va perdre Googlebot.

- Migrer vers du SSR sans avoir vérifié la capacité de charge de votre backend — le crawl massif de Googlebot peut saturer votre DB.

- Ne pas prévoir de circuit breaker : si votre DB tombe, tous les rendus SSR échouent en cascade.

Comment vérifier que votre SSR est fiable pour Googlebot ?

Inspectez les pages via URL Inspection Tool dans Search Console et comparez le HTML rendu avec ce que vous obtenez en simulant une requête serveur (curl avec user-agent Googlebot). Si le contenu diffère ou si vous voyez des erreurs, c'est que votre SSR n'est pas stable.

Analysez les logs serveur : filtrez les requêtes Googlebot et cherchez les codes 500, 502, 503, 504. Un taux d'erreur supérieur à 2-3% mérite investigation. Regardez aussi les temps de réponse — un TTFB supérieur à 1 seconde risque de provoquer des timeouts de crawl.

❓ Questions frequentes

Est-ce que Google préfère le SSR au CSR pour l'indexation ?

Quels types d'échecs SSR empêchent l'indexation ?

Un site en CSR peut-il quand même bien se classer dans Google ?

Comment détecter qu'un problème SSR impacte mon indexation ?

Le pré-rendering statique est-il plus fiable que le SSR dynamique ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 30/05/2023

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.