Declaration officielle

Autres déclarations de cette vidéo 4 ▾

- □ Les codes HTTP 1xx nuisent-ils au crawl de votre site par Googlebot ?

- □ Pourquoi vos erreurs TCP/UDP bloquent-elles réellement le crawl de Google ?

- □ Faut-il encore se préoccuper du choix entre redirections 301 et 302 ?

- □ Pourquoi Google insiste-t-il autant sur les codes HTTP pour le référencement ?

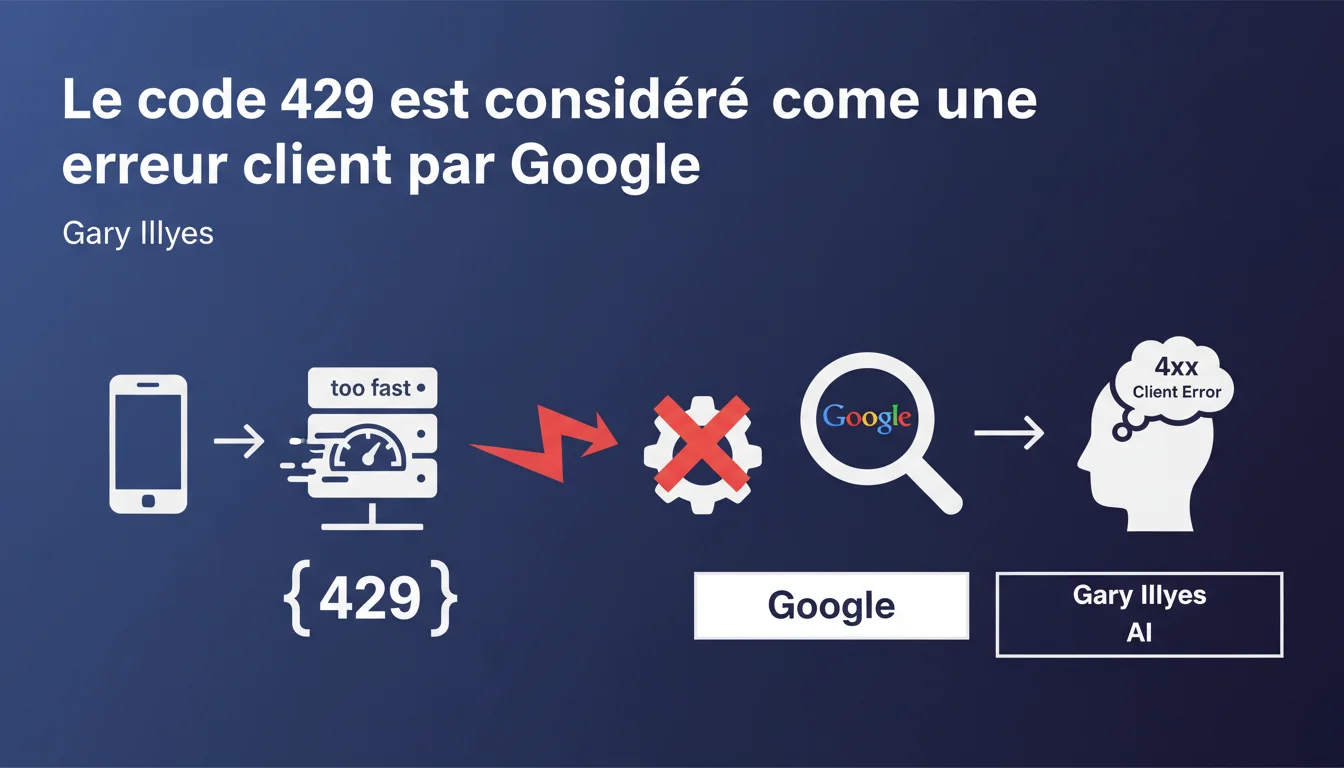

Google traite le code HTTP 429 (Too Many Requests) comme une erreur client (4xx), pas comme une erreur serveur. Concrètement, votre serveur limite l'accès à une ressource pour cause de sur-sollicitation — et Googlebot le comprend comme une instruction directe du site, pas comme un dysfonctionnement technique.

Ce qu'il faut comprendre

Qu'est-ce que le code HTTP 429 et pourquoi Google le traite-t-il comme une erreur client ?

Le code HTTP 429 signale qu'un client (navigateur, bot) envoie trop de requêtes dans un laps de temps donné. C'est un mécanisme de protection côté serveur, souvent déclenché par un rate limiting ou un pare-feu applicatif.

Google le classe dans les erreurs 4xx parce que la restriction vient d'une règle définie par le propriétaire du site, pas d'un problème technique imprévu. Le serveur fonctionne correctement — il refuse simplement de répondre à cette cadence de requêtes.

Quelle différence avec un code 5xx du point de vue de Googlebot ?

Les erreurs 5xx (500, 502, 503) indiquent un dysfonctionnement serveur : surcharge, crash, indisponibilité temporaire. Google peut réessayer plus tard en supposant que le problème est transitoire.

Avec un 429, Google comprend que le serveur est volontairement restrictif. Si le bot reçoit ce signal de manière répétée, il ajuste son rythme de crawl pour respecter les limites définies — mais cela peut réduire le crawl budget alloué au site.

Quelles sont les implications pour l'indexation et le crawl ?

Un 429 ponctuel n'aura pas d'impact significatif. Mais si Googlebot rencontre ce code fréquemment, il peut interpréter cela comme une demande explicite de ralentir.

Résultat : moins de pages crawlées par session, délais accrus pour l'indexation de contenus frais, et risque de désindexation progressive pour les URLs renvoyant systématiquement ce code.

- Le 429 est une erreur client (4xx), pas serveur (5xx)

- Google adapte son rythme de crawl si le 429 se répète

- Un usage excessif peut réduire le crawl budget alloué au site

- Les ressources bloquées par 429 ne seront pas indexées

Avis d'un expert SEO

Cette déclaration reflète-t-elle vraiment le comportement observé de Googlebot ?

Oui, dans les grandes lignes. Les logs serveur montrent que Googlebot respecte généralement les limites de taux et adapte sa fréquence de crawl lorsqu'il reçoit des 429 répétés.

Mais il y a une nuance importante : certains bots Google (images, mobile, Desktop) peuvent avoir des seuils différents. Et dans des contextes de pic de crawl après une mise à jour, on observe parfois une persistance du bot malgré des 429 — ce qui suggère que Google peut ignorer temporairement ces signaux pour des raisons internes. [A vérifier] dans quelle mesure cette exception s'applique systématiquement.

Faut-il réellement se préoccuper d'un 429 occasionnel ?

Soyons honnêtes : si tu renvoies un 429 sur 0,1 % des requêtes de Googlebot, personne ne va s'en apercevoir. Le problème surgit quand le rate limiting est mal calibré et frappe le bot de façon systématique.

Les cas critiques concernent les sites à forte volumétrie (e-commerce, actualités) où un CDN ou un WAF mal configuré bloque Googlebot par défaut. Là, tu peux perdre une partie substantielle de ton crawl budget sans même t'en rendre compte.

Google donne-t-il des recommandations chiffrées sur les seuils acceptables ?

Non, et c'est frustrant. Gary Illyes confirme que le 429 est traité comme une erreur client, mais aucun seuil précis n'est communiqué : combien de 429 avant un ralentissement du crawl ? Quel délai avant réajustement ?

Cette opacité pose problème pour calibrer correctement les systèmes de protection. En pratique, on recommande de monitorer les logs et d'ajuster le rate limiting en fonction du comportement réel de Googlebot — mais c'est de l'empirisme pur, pas une science exacte.

Impact pratique et recommandations

Comment vérifier si mon site renvoie des 429 à Googlebot ?

Commence par consulter la Search Console, section Paramètres > Statistiques d'exploration. Tu y verras l'évolution du nombre de requêtes par jour et les réponses d'hôte, dont les 429.

Ensuite, analyse tes logs serveur. Filtre par user-agent Googlebot et cherche les réponses HTTP 429. Si tu en trouves régulièrement, c'est que ton rate limiting ou ton WAF est trop restrictif.

Que faire si mon serveur envoie trop de 429 à Google ?

Première étape : identifier la source du blocage. Cloudflare ? Nginx ? Un plugin WordPress ? Une règle mod_security ?

Une fois identifié, ajuste les seuils de rate limiting pour whitelister ou assouplir les limites pour Googlebot. Attention cependant à ne pas ouvrir la porte à du scraping abusif — l'équilibre est délicat.

- Vérifier les statistiques d'exploration dans la Search Console

- Analyser les logs serveur pour repérer les 429 envoyés à Googlebot

- Identifier la couche responsable (CDN, pare-feu, serveur web)

- Ajuster les règles de rate limiting pour Googlebot sans compromettre la sécurité

- Surveiller l'évolution du crawl budget après modification

- Documenter les seuils appliqués pour faciliter les ajustements futurs

❓ Questions frequentes

Le code 429 impacte-t-il le référencement de mon site ?

Dois-je whitelister complètement Googlebot pour éviter les 429 ?

Comment Google différencie-t-il un 429 légitime d'un blocage abusif ?

Un CDN comme Cloudflare peut-il provoquer des 429 invisibles pour moi ?

Combien de temps Google met-il à réajuster son crawl après suppression des 429 ?

🎥 De la même vidéo 4

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 15/05/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.