Declaration officielle

Autres déclarations de cette vidéo 4 ▾

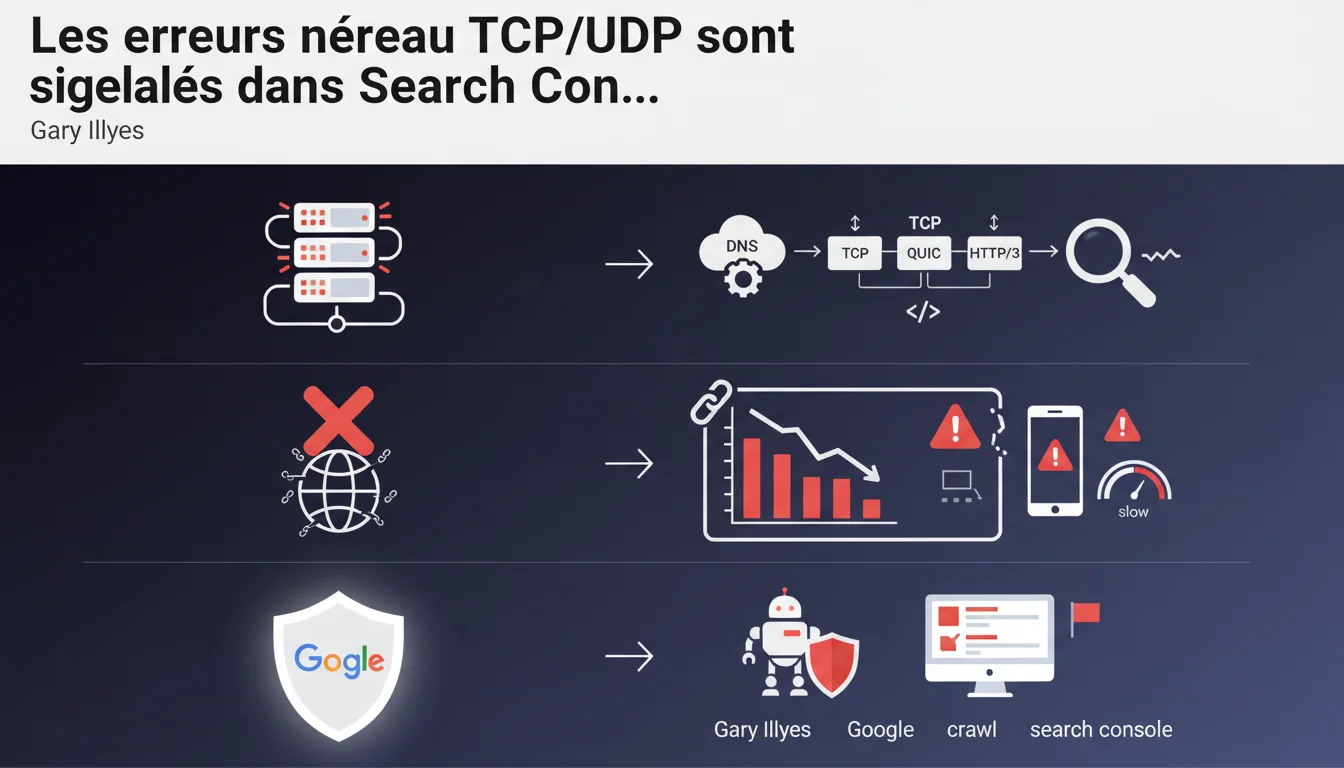

Google signale désormais dans Search Console les erreurs de connexion réseau au niveau des couches TCP, UDP, QUIC et DNS. Ces problèmes techniques empêchent purement et simplement Googlebot d'accéder à vos pages. Concrètement : pas de connexion réseau stable = pas de crawl = pas d'indexation.

Ce qu'il faut comprendre

Qu'est-ce que ces erreurs réseau ont à voir avec le SEO ?

Google crawle vos pages via des protocoles réseau standards : TCP pour HTTP/HTTPS classique, UDP et QUIC pour HTTP/3, DNS pour la résolution de noms de domaine. Quand l'une de ces couches basses plante, Googlebot ne peut même pas établir de connexion — oubliez le rendu JavaScript ou les Core Web Vitals, on parle d'un blocage avant même la première requête HTTP.

Search Console affiche désormais ces erreurs explicitement : messages de blocage réseau, problèmes de connexion, timeouts DNS. Ce n'est pas nouveau dans les faits — ces bugs existaient déjà —, mais Google rend enfin visible ce qui se passait dans une boîte noire.

Pourquoi Google remonte-t-il ces erreurs maintenant ?

L'adoption massive de HTTP/3 et du protocole QUIC (basé sur UDP) multiplie les cas de figure où un site peut être partiellement accessible. Votre serveur répond en TCP/HTTP2 mais plante en UDP/QUIC ? Google teste les deux, et si QUIC échoue, ça génère une erreur visible.

Par ailleurs, les infrastructures cloud et CDN — Cloudflare, Fastly, AWS CloudFront — introduisent des couches intermédiaires qui peuvent foirer au niveau réseau sans que le serveur origine bronche. Google veut que vous voyiez où ça coince : chez vous, chez votre hébergeur, ou entre les deux.

Quelles sont les erreurs réseau signalées concrètement ?

- TCP connection timeout : le serveur ne répond pas dans le délai imparti (souvent 10-15 secondes).

- DNS resolution failure : impossible de résoudre le nom de domaine en adresse IP — problème de nameservers, propagation DNS, ou zone DNS cassée.

- QUIC handshake error : échec de la négociation HTTP/3 — firewall mal configuré, pare-feu bloquant UDP, ou serveur qui ne supporte pas QUIC alors qu'il l'annonce.

- UDP packet loss : paquets perdus en route — réseau instable, routeur surchargé, ou filtrage agressif.

- Network unreachable : routes réseau cassées, IP blacklistée, ou infrastructure cloud en rade.

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. On observe depuis des mois des sites avec crawl budget dégradé sans raison apparente — pas de robots.txt bloquant, pas de surcharge serveur, logs vides. Le problème ? Des erreurs réseau intermittentes que Search Console ne remontait pas clairement. Maintenant, ça saute aux yeux.

Par contre — et c'est là que ça coince — Google ne dit pas combien de temps ces erreurs doivent persister avant d'impacter réellement l'indexation. Une erreur TCP ponctuelle à 3h du mat' ? Probablement bénin. Des timeouts DNS répétés pendant 48h ? Là, vous avez un vrai problème. [À vérifier] : Google ne donne aucun seuil de tolérance chiffré.

Quelles nuances faut-il apporter ?

Tous les protocoles ne se valent pas. Un échec QUIC/HTTP3 n'empêche pas Google de crawler en TCP/HTTP2 — c'est un fallback automatique. Donc une erreur QUIC seule ne bloque pas l'indexation, elle ralentit juste le crawl (latence accrue, bande passante réduite).

En revanche, un problème DNS ou TCP pur et dur ? C'est game over. Pas de connexion possible, point final. La nuance est cruciale : toutes les erreurs réseau ne tuent pas votre SEO de la même manière.

Dans quels cas ces erreurs sont-elles faussement positives ?

Google crawle depuis plusieurs datacenters, parfois avec des IP géolocalisées bizarrement. Si votre firewall bloque certaines plages IP Google (volontairement ou par erreur), Search Console remonte des erreurs réseau alors que 95% du crawl passe sans souci.

Autre cas classique : les sites derrière Cloudflare avec "Under Attack Mode" activé. Cloudflare sert un challenge JavaScript… que Googlebot peut contourner, mais pas toujours du premier coup. Ça génère des timeouts TCP intermittents. [À vérifier] : est-ce que Google distingue un blocage volontaire d'une vraie panne réseau ? La doc ne le dit pas.

Impact pratique et recommandations

Que faut-il faire concrètement dès maintenant ?

Ouvrez Search Console, section Pages → Problèmes de connexion. Si vous voyez des erreurs réseau sur des URLs stratégiques, agissez vite. Vérifiez d'abord les logs serveur : est-ce que Googlebot tente réellement de se connecter et échoue, ou est-ce qu'il n'essaie même pas ?

Testez la résolution DNS depuis plusieurs points du globe : dig +trace votredomaine.com ou des outils comme DNSChecker. Un nameserver lent ou une propagation DNS bancale peut générer des erreurs intermittentes invisibles depuis votre bureau.

Si vous utilisez HTTP/3, vérifiez que UDP port 443 est bien ouvert sur votre firewall et load balancer. Beaucoup d'admins sys oublient ça — ils n'autorisent que TCP 443. Google teste QUIC, ça timeout, erreur remontée.

Quelles erreurs éviter absolument ?

- Ne pas bloquer les IP de Googlebot dans iptables, fail2ban ou un WAF trop agressif — vérifiez la liste officielle régulièrement.

- Ne pas annoncer le support HTTP/3 (header Alt-Svc) si votre infra ne gère pas réellement QUIC — mieux vaut désactiver proprement.

- Ne pas ignorer les timeouts DNS « rares » — une seule panne de nameserver peut suffire à plomber le crawl pendant des heures.

- Ne pas confondre erreur réseau et erreur serveur (5xx) — ce n'est pas le même niveau de debug, pas les mêmes outils.

Comment monitorer ces problèmes en continu ?

Search Console, c'est bien, mais réactif — vous découvrez le problème après que Google ait échoué. Mettez en place un monitoring réseau actif : Pingdom, UptimeRobot, ou des sondes DNS/TCP/UDP custom via Datadog ou Grafana.

Configurez des alertes si la latence TCP dépasse 2 secondes, ou si la résolution DNS prend plus de 500ms. Google n'attend pas indéfiniment — un timeout, c'est souvent 10-15 secondes max, et après, il passe à autre chose.

❓ Questions frequentes

Une erreur TCP ponctuelle peut-elle dégrader mon indexation ?

Dois-je désactiver HTTP/3 si Search Console remonte des erreurs QUIC ?

Comment savoir si l'erreur vient de mon serveur ou de mon CDN ?

Les erreurs DNS sont-elles aussi graves que les erreurs TCP ?

Search Console affiche-t-il le détail technique de chaque erreur réseau ?

🎥 De la même vidéo 4

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 15/05/2025

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.