Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google remplace-t-il vos balises title par des H1 ?

- □ Google indexe-t-il vraiment les titres modifiés par JavaScript côté client ?

- □ Faut-il abandonner le rendu JavaScript côté client pour réussir son SEO ?

- □ Faut-il abandonner le dynamic rendering pour le SEO ?

- □ L'outil d'inspection d'URL montre-t-il vraiment ce que Google voit lors du rendu JavaScript ?

- □ Le contenu modifié après le HTML initial pose-t-il vraiment problème pour l'indexation Google ?

- □ Google maîtrise-t-il vraiment le JavaScript ou reste-t-il des pièges à éviter ?

- □ Lighthouse peut-il vraiment diagnostiquer vos problèmes de rendu critique pour Google ?

- □ Faut-il vraiment crawler son site tous les trois mois pour éviter les problèmes techniques ?

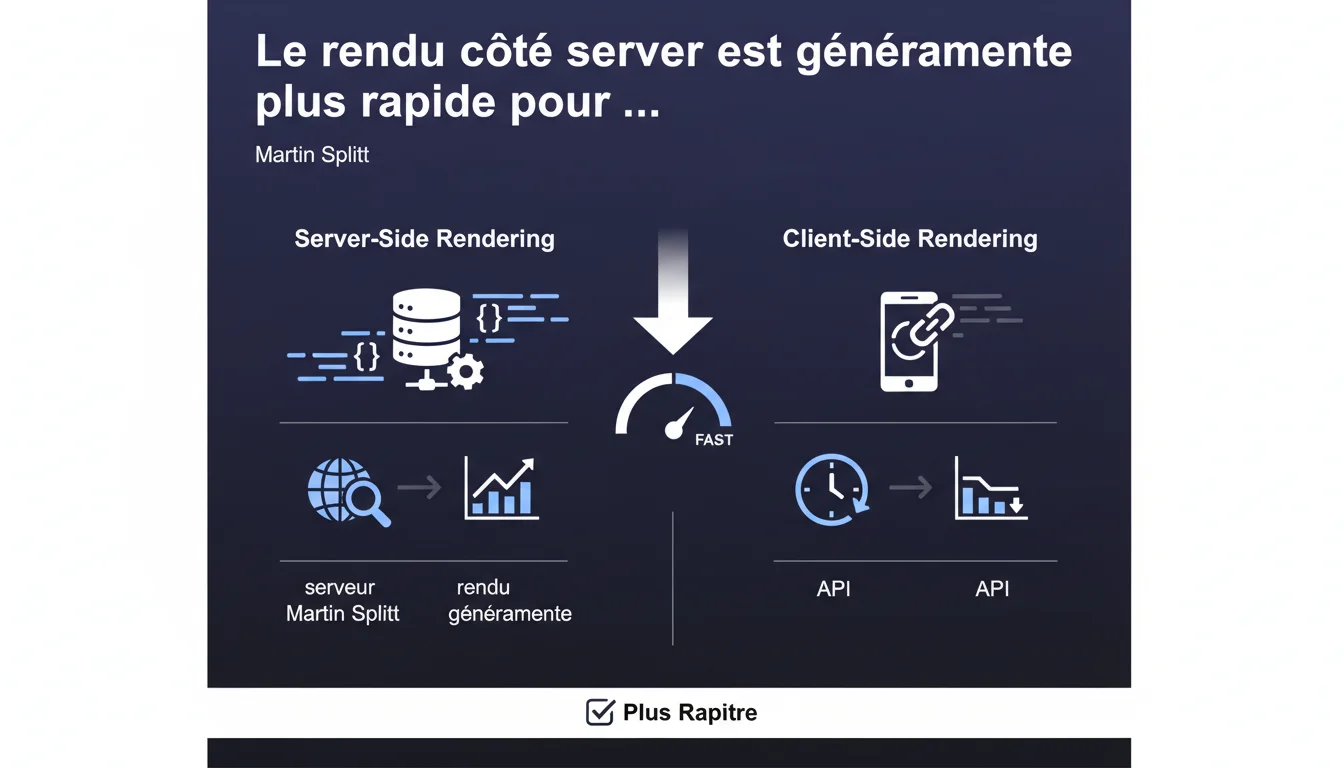

Google confirme que le SSR (Server-Side Rendering) offre généralement une meilleure performance utilisateur que le CSR (Client-Side Rendering), mais pose une condition : l'implémentation doit être correcte. Cette nuance est cruciale — un SSR mal configuré peut dégrader l'expérience plutôt que l'améliorer.

Ce qu'il faut comprendre

Martin Splitt, Developer Advocate chez Google, rappelle une vérité souvent idéalisée : le rendu côté serveur n'est pas une garantie automatique de rapidité. Beaucoup de développeurs adoptent le SSR en pensant résoudre leurs problèmes de performance, sans comprendre les pièges d'implémentation.

Cette déclaration s'inscrit dans le débat persistant entre SSR, CSR et stratégies hybrides comme l'hydratation progressive. Google ne tranche pas brutalement — il contextualise.

Pourquoi Google insiste-t-il sur la « bonne implémentation » ?

Parce qu'un SSR mal configuré peut générer des temps de réponse serveur catastrophiques. Si votre serveur met 2 secondes à compiler le HTML avant de l'envoyer, vous perdez tout l'avantage du rendu serveur.

Le problème classique : des frameworks comme Next.js ou Nuxt.js rendent le SSR accessible, mais créent une fausse impression de simplicité. Un mauvais cache, des requêtes API bloquantes en cascade, un serveur sous-dimensionné — et votre TTFB explose.

Le CSR est-il condamné pour autant ?

Non. Google ne dit pas que le rendu côté client est intrinsèquement lent. Il dit que le SSR est « généralement » plus rapide pour l'utilisateur final, car le navigateur reçoit du HTML déjà construit.

Mais si votre application CSR utilise du prefetching agressif, du code-splitting intelligent et un CDN bien configuré, l'écart peut être minime. Le vrai enjeu reste le First Contentful Paint et le Largest Contentful Paint — des métriques où le SSR prend souvent l'avantage.

Qu'est-ce que ça change pour Googlebot ?

Googlebot sait maintenant exécuter du JavaScript, mais ça ne signifie pas qu'il attend indéfiniment. Avec du SSR, le contenu est immédiatement crawlable sans dépendre d'un budget de rendu JS.

Le CSR impose un double travail : Googlebot doit télécharger le HTML vide, charger le JS, l'exécuter, puis indexer. Ce délai peut impacter votre crawl budget et retarder l'indexation de nouvelles pages.

- SSR bien implémenté = HTML complet dès la première requête, réduction du temps de traitement côté Googlebot

- CSR = dépendance au budget de rendu JavaScript, risque de contenu invisible si le JS échoue

- Hybridation (SSR initial + hydratation) = compromis optimal pour la plupart des projets modernes

- TTFB critique : un SSR avec TTFB > 1s annule ses propres bénéfices

- Core Web Vitals : le LCP favorise naturellement le SSR si le serveur répond vite

Avis d'un expert SEO

Cette déclaration est-elle vraiment surprenante ?

Franchement, non. Google répète depuis des années que la rapidité perçue par l'utilisateur prime. Ce qui est intéressant, c'est la prudence dans la formulation : « généralement » et « correctement implémenté ».

Splitt évite volontairement de diaboliser le CSR ou de sanctifier le SSR. Pourquoi ? Parce que Google sait que des géants comme Gmail, Google Maps ou Twitter (avant sa refonte) fonctionnent en CSR intensif avec d'excellentes performances.

Où cette règle ne s'applique-t-elle pas vraiment ?

Pour les applications web complexes (dashboards, SaaS, outils métier), le SSR peut être contre-productif. Si votre interface dépend d'interactions temps réel et de mises à jour fréquentes, le CSR avec du state management optimisé battra souvent le SSR.

Le SSR brille surtout pour les sites de contenu : e-commerce, médias, blogs, sites vitrine. Là où l'objectif est de livrer rapidement du contenu statique ou semi-statique.

Quelles nuances manquent dans cette déclaration ?

Google ne parle pas du streaming SSR (React Server Components, par exemple) ni de l'Islands Architecture (Astro, Fresh). Ces approches hybrides permettent de rendre côté serveur uniquement les parties critiques, tout en gardant du CSR pour l'interactivité.

[À vérifier] : Google ne précise pas comment Googlebot traite les erreurs SSR. Si votre serveur renvoie une 500 pendant le rendu, que se passe-t-il ? Fallback sur une version en cache ? Recrawl différé ? Cette zone reste floue dans la doc officielle.

Impact pratique et recommandations

Que faut-il faire concrètement si vous êtes en CSR pur ?

Pas de panique. Si vos Core Web Vitals sont au vert et que Google indexe correctement votre contenu, migrer vers le SSR par dogmatisme SEO est probablement inutile.

Par contre, si votre LCP dépasse 2,5s ou que certaines pages peinent à s'indexer malgré des sitemaps propres, le SSR devient une piste sérieuse. Mais attention — ne pas confondre SSR et pré-rendu statique (SSG).

Comment vérifier que votre SSR est « correctement implémenté » ?

Trois indicateurs clés : TTFB, FCP et LCP. Si votre TTFB dépasse 600-800ms, votre SSR est mal configuré. Le serveur met trop de temps à générer le HTML.

Utilisez les outils de surveillance comme WebPageTest en mode Waterfall pour repérer les goulots. Souvent, le problème vient de requêtes API synchrones au moment du rendu — chaque appel bloque la génération du HTML.

- Mesurer le TTFB en conditions réelles (pas uniquement en local) — cible < 600ms

- Activer un cache serveur pour les pages semi-statiques (Redis, Varnish, CDN edge caching)

- Utiliser du prefetching de données côté serveur pour éviter les waterfalls d'API

- Tester le rendu avec Mobile-Friendly Test et vérifier que le HTML source contient bien le contenu

- Comparer les Core Web Vitals avant/après migration SSR sur un échantillon de pages

- Monitorer les erreurs 500 en production — un SSR qui plante renvoie souvent du HTML vide

- Évaluer le coût infrastructure : SSR = plus de charge CPU/RAM qu'un simple serveur de fichiers statiques

Quelles erreurs éviter absolument ?

Ne pas dimensionner correctement votre serveur. Un SSR sous Node.js peut consommer 10 à 50 fois plus de ressources qu'un site statique. Si votre trafic explose, prévoyez du scaling horizontal ou du serverless (Vercel, Netlify Functions).

Évitez aussi le piège du « SSR partout ». Certaines pages interactives (panier, compte utilisateur, dashboards) n'ont aucun intérêt SEO et peuvent rester en CSR pur. L'approche hybride est souvent la plus pragmatique.

❓ Questions frequentes

Le SSR améliore-t-il automatiquement le référencement ?

Peut-on mixer SSR et CSR sur un même site ?

Quelle est la différence entre SSR et SSG ?

Google pénalise-t-il les sites en CSR pur ?

Un mauvais SSR peut-il être pire qu'un bon CSR ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.