Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google remplace-t-il vos balises title par des H1 ?

- □ Google indexe-t-il vraiment les titres modifiés par JavaScript côté client ?

- □ Faut-il abandonner le dynamic rendering pour le SEO ?

- □ L'outil d'inspection d'URL montre-t-il vraiment ce que Google voit lors du rendu JavaScript ?

- □ Le contenu modifié après le HTML initial pose-t-il vraiment problème pour l'indexation Google ?

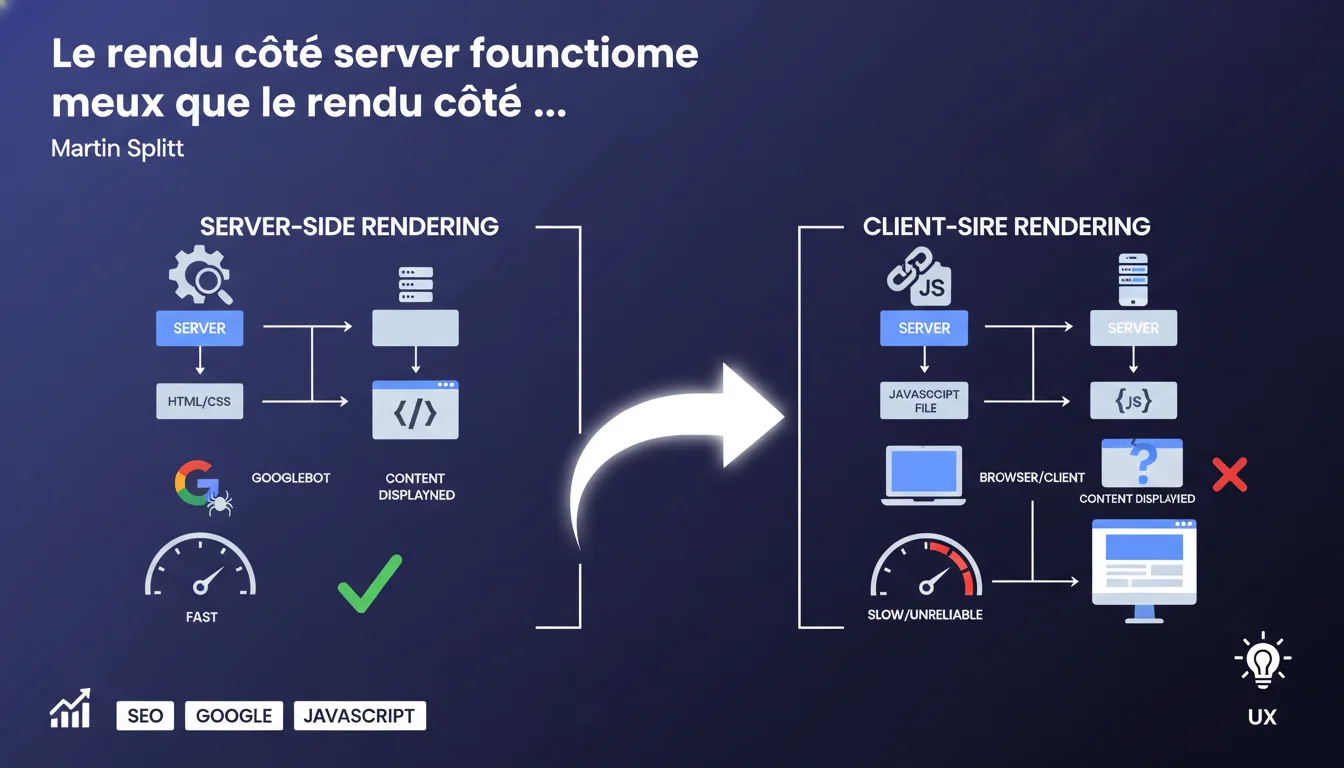

- □ Le rendu côté serveur est-il vraiment plus rapide que le rendu côté client pour le SEO ?

- □ Google maîtrise-t-il vraiment le JavaScript ou reste-t-il des pièges à éviter ?

- □ Lighthouse peut-il vraiment diagnostiquer vos problèmes de rendu critique pour Google ?

- □ Faut-il vraiment crawler son site tous les trois mois pour éviter les problèmes techniques ?

Google affirme que le rendu côté serveur (SSR) reste la meilleure pratique SEO car le moteur ne parvient pas toujours à récupérer correctement le contenu généré par JavaScript côté client. Cette déclaration confirme que malgré les progrès de Googlebot sur le JS, la fiabilité d'indexation reste meilleure avec un rendu serveur. Concrètement : si votre contenu critique dépend du JavaScript client, vous prenez un risque mesurable.

Ce qu'il faut comprendre

Pourquoi Google préfère-t-il le rendu côté serveur au rendu côté client ?

La distinction est simple : le rendu côté serveur (SSR) envoie du HTML complet directement au navigateur, tandis que le rendu côté client (CSR) livre une coquille vide et laisse JavaScript construire le contenu dans le navigateur.

Pour Googlebot, le SSR signifie que tout est immédiatement lisible lors du premier accès. Avec le CSR, Google doit d'abord télécharger le HTML, identifier les scripts, les exécuter, attendre les appels API, puis récupérer le contenu final — un processus à plusieurs étapes où chaque maillon peut casser.

Que signifie concrètement "ne pas toujours récupérer correctement" le contenu JS ?

Google utilise une formulation prudente qui cache une réalité terrain plus rugueuse. Dans certains cas, Googlebot échoue purement et simplement à exécuter le JavaScript : timeout, erreurs dans le code, ressources bloquées par robots.txt, budgets de rendu dépassés.

Dans d'autres cas, l'exécution fonctionne mais arrive trop tard dans le processus de crawl. Le contenu rendu en JS passe alors dans une file d'attente de rendu différée, ce qui retarde l'indexation de plusieurs jours voire semaines pour certains sites.

Quels sont les risques concrets d'un site full JavaScript côté client ?

- Indexation partielle ou absente des pages dont le contenu dépend entièrement de JS

- Délais d'indexation significativement plus longs qu'avec du HTML statique

- Perte de contenu si le JavaScript génère des éléments critiques (titres, descriptions, liens internes)

- Consommation accrue du crawl budget car Google doit revenir plusieurs fois sur la même URL

- Incohérences entre ce que voit Googlebot et ce que voit l'utilisateur final

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Depuis des années, les audits révèlent que les sites en React, Vue ou Angular sans SSR rencontrent des problèmes récurrents d'indexation. Google a beau améliorer son moteur de rendu JavaScript, la réalité reste têtue : un site SSR est indexé plus rapidement et plus complètement.

Les cas problématiques les plus fréquents ? Les sites e-commerce avec filtres et pagination en JS pur, les applications SPA (Single Page Applications) qui chargent le contenu via des appels API asynchrones, et les sites dont les balises meta et structured data sont injectées par JavaScript. Sur ces derniers, on observe régulièrement des rich snippets manquants ou erronés.

Dans quels cas le rendu côté client reste-t-il acceptable ?

Soyons honnêtes : tout n'est pas noir ou blanc. Si votre contenu critique — titres, descriptions, corps de texte principal, maillage interne — est présent dans le HTML initial, vous pouvez vous permettre d'enrichir l'expérience utilisateur avec du JS côté client pour des éléments secondaires.

Les zones où le CSR pose moins de problèmes : interfaces utilisateur interactives (accordéons, onglets), fonctionnalités post-chargement (commentaires, contenu recommandé), éléments purement UX sans valeur SEO (animations, transitions). Mais dès qu'un élément impacte le référencement, la prudence commande de le rendre côté serveur.

Que faire si migrer vers du SSR n'est pas envisageable à court terme ?

Dans ce cas, le pre-rendering ou le rendu dynamique peuvent servir de solutions transitoires. Le pre-rendering génère des versions HTML statiques de vos pages lors du build, tandis que le rendu dynamique détecte les bots et leur sert du HTML complet tout en gardant le CSR pour les utilisateurs.

[A vérifier] : Google affirme ne pas pénaliser le cloaking légitime (rendu différent pour les bots), mais cette tolérance reste floue et peut évoluer. Le risque existe, même s'il est faible pour un usage purement technique sans manipulation des classements.

Impact pratique et recommandations

Que faut-il faire concrètement sur un site existant en CSR ?

Première étape : auditer ce que voit réellement Googlebot. Utilisez l'outil d'inspection d'URL dans Google Search Console, comparez le HTML brut (Ctrl+U dans Chrome) avec le DOM rendu, et vérifiez que tous vos éléments critiques apparaissent dans la version "crawlée".

Si vous constatez des écarts significatifs — contenu manquant, liens absents, balises meta vides — vous avez un problème de rendu JS qui impacte directement votre indexation. C'est là que ça coince : votre référencement repose sur un process fragile que Google ne garantit pas.

Quelles architectures privilégier pour les nouveaux projets ?

Pour un site vitrine ou un blog, privilégiez les générateurs de sites statiques (Gatsby, Next.js en mode export, Hugo, Eleventy) qui produisent du HTML pur. Performance maximale, SEO garanti, hébergement simple et bon marché.

Pour une application web complexe ou un site e-commerce, optez pour du SSR avec hydratation : Next.js, Nuxt.js, SvelteKit. Vous gardez l'interactivité JavaScript côté client tout en servant du HTML complet initial. Le meilleur des deux mondes, même si l'infrastructure est plus lourde.

Comment vérifier que mon implémentation SSR fonctionne correctement ?

- Désactivez JavaScript dans votre navigateur et vérifiez que le contenu principal reste visible

- Testez vos URLs avec l'outil "Tester l'URL en direct" de Google Search Console

- Comparez le code source (view-source:) avec ce qu'affiche le navigateur

- Vérifiez que vos balises meta, titres et structured data apparaissent dans le HTML initial

- Contrôlez les temps de réponse serveur — le SSR peut ralentir le TTFB si mal optimisé

- Suivez l'évolution de votre indexation dans la Search Console après migration

❓ Questions frequentes

Le rendu côté client est-il complètement à proscrire pour le SEO ?

Googlebot exécute-t-il vraiment JavaScript en 2025 ?

Quelle est la différence entre SSR, SSG et pre-rendering ?

Le rendu dynamique (cloaking pour bots) est-il autorisé par Google ?

Puis-je utiliser un framework moderne comme React tout en faisant du SEO ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.