Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google remplace-t-il vos balises title par des H1 ?

- □ Google indexe-t-il vraiment les titres modifiés par JavaScript côté client ?

- □ Faut-il abandonner le rendu JavaScript côté client pour réussir son SEO ?

- □ Faut-il abandonner le dynamic rendering pour le SEO ?

- □ L'outil d'inspection d'URL montre-t-il vraiment ce que Google voit lors du rendu JavaScript ?

- □ Le contenu modifié après le HTML initial pose-t-il vraiment problème pour l'indexation Google ?

- □ Le rendu côté serveur est-il vraiment plus rapide que le rendu côté client pour le SEO ?

- □ Google maîtrise-t-il vraiment le JavaScript ou reste-t-il des pièges à éviter ?

- □ Lighthouse peut-il vraiment diagnostiquer vos problèmes de rendu critique pour Google ?

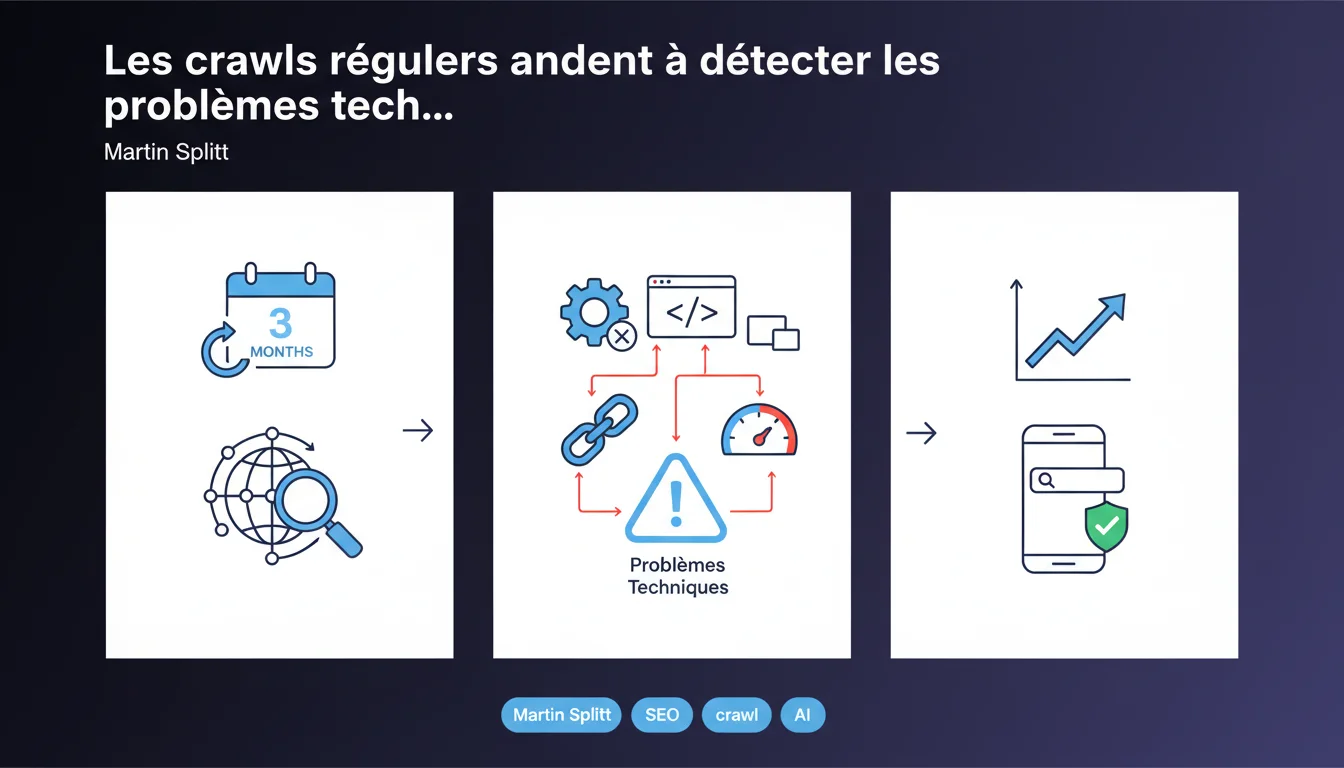

Martin Splitt recommande de crawler son site tous les trois mois pour détecter les problèmes techniques (titres dupliqués, erreurs d'indexation) avant qu'ils n'impactent les performances. C'est une approche préventive qui permet d'anticiper plutôt que de subir. Mais la fréquence dépend de la vélocité de votre site.

Ce qu'il faut comprendre

Pourquoi Google insiste-t-il sur les crawls réguliers ?

Google ne crawle pas votre site en temps réel. Entre deux passages de Googlebot, des problèmes techniques peuvent apparaître sans que vous le sachiez : titres dupliqués suite à une migration, balises canonical cassées, redirections en chaîne.

Splitt pointe un fait simple : attendre que Google détecte le problème, c'est déjà trop tard. Les performances en recherche ont déjà chuté. Un crawl régulier vous place en position de contrôle, pas de réaction.

Tous les trois mois, est-ce une règle absolue ?

C'est une recommandation générique. Pour un site e-commerce qui publie 500 produits par semaine, trois mois c'est une éternité. Pour un site vitrine de 20 pages qui ne bouge jamais, c'est peut-être excessif.

La logique : plus votre site évolue vite, plus vous devez crawler fréquemment. Un site dynamique demande une surveillance quasi-continue. Un site statique peut se contenter de contrôles trimestriels.

Quels problèmes techniques un crawl peut-il révéler ?

Splitt mentionne les titres dupliqués, mais c'est la partie émergée. Un crawl identifie aussi : les erreurs 404, les chaînes de redirection, les balises hreflang incorrectes, les pages orphelines, les profondeurs excessives.

Ces dysfonctionnements passent souvent inaperçus jusqu'à ce qu'un audit les expose. Et entre-temps, ils sabotent votre crawl budget et votre capacité à ranker.

- Crawl trimestriel recommandé par Google comme fréquence de base

- Détection préventive plutôt que correction tardive

- Problèmes ciblés : titres dupliqués, erreurs 404, redirections, balises techniques

- Fréquence adaptable selon la vélocité du site

Avis d'un expert SEO

Cette fréquence trimestrielle est-elle réaliste pour tous les sites ?

Soyons honnêtes : trois mois, c'est un minimum syndical. Pour un site qui déploie du code chaque semaine, qui gère des milliers de pages produits ou qui publie quotidiennement, attendre trois mois pour crawler, c'est jouer avec le feu.

À l'inverse, si votre site ne bouge pas — un site institutionnel, un portfolio —, vous pouvez espacer. Mais dès qu'il y a du contenu dynamique, de l'automation, des catégories qui se créent, la fréquence doit suivre le rythme.

Google détecte-t-il vraiment ces problèmes avant qu'ils n'impactent ?

C'est là que ça coince. Google dit que les crawls réguliers permettent de détecter avant que les performances ne chutent. Mais comment définir « avant » ? [À vérifier]

Dans la réalité terrain, on constate souvent que Google a déjà indexé des pages avec des titres dupliqués, des canonical cassées ou des redirections foireuses. Quand vous détectez le problème via votre crawl, Google l'a parfois déjà intégré dans son index. L'impact est déjà là.

Les outils de crawl suffisent-ils ou faut-il analyser manuellement ?

Un outil comme Screaming Frog, OnCrawl ou Botify va sortir les alertes techniques. Mais il ne va pas vous dire si un titre dupliqué est un vrai problème ou un faux positif contextuel.

Exemple : deux pages avec le même titre parce qu'elles traitent d'un sujet identique dans deux langues différentes avec hreflang bien configuré. Le crawler va signaler la duplication, mais c'est normal. L'analyse humaine reste indispensable pour trier signal et bruit.

Impact pratique et recommandations

Que faut-il faire concrètement pour mettre en place ces crawls réguliers ?

Première étape : choisir un outil de crawl adapté à la taille de votre site. Screaming Frog pour les petits sites (< 10 000 URLs), OnCrawl ou Botify pour les gros volumes. Configurez un crawl complet tous les trois mois minimum.

Ensuite, définissez les métriques prioritaires à surveiller : titres dupliqués, meta descriptions dupliquées, erreurs 404, redirections 301/302, profondeur de crawl, temps de réponse serveur. Ne cherchez pas à tout analyser d'un coup.

Comment prioriser les corrections après un crawl ?

Tous les problèmes détectés ne se valent pas. Un titre dupliqué sur deux pages à faible trafic, ce n'est pas urgent. Une chaîne de redirections sur votre page d'accueil, c'est critique.

Classez par impact SEO potentiel : d'abord les pages stratégiques (celles qui génèrent du trafic ou des conversions), puis les pages secondaires. Corrigez en priorité ce qui affecte le crawl budget et l'indexation.

Quelles erreurs éviter lors de l'analyse des résultats ?

Ne corrigez pas aveuglément toutes les alertes. Certains « problèmes » sont des faux positifs : pagination, versions AMP, pages de filtres. Validez manuellement avant de modifier.

Autre piège : vouloir tout corriger d'un coup. Déployez les corrections par lots, testez, mesurez l'impact. Une correction massive mal calibrée peut créer plus de problèmes qu'elle n'en résout.

- Planifier un crawl complet tous les 3 mois (ou plus fréquent selon la vélocité du site)

- Utiliser un outil adapté à la taille du site (Screaming Frog, OnCrawl, Botify)

- Définir les métriques prioritaires : titres, meta, redirections, erreurs, profondeur

- Classer les corrections par impact SEO (pages stratégiques d'abord)

- Valider manuellement les alertes pour éviter les faux positifs

- Déployer les corrections par lots et mesurer l'impact

- Documenter chaque crawl pour suivre l'évolution dans le temps

❓ Questions frequentes

Quel outil de crawl choisir pour un site de 50 000 pages ?

Les crawls réguliers consomment-ils du crawl budget Google ?

Que faire si le crawl détecte 500 titres dupliqués ?

Peut-on automatiser la détection de problèmes entre deux crawls ?

Un crawl trimestriel suffit-il pour un site e-commerce à fort turnover ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 05/10/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.