Declaration officielle

Autres déclarations de cette vidéo 23 ▾

- □ Google compte-t-il vraiment tous les liens visibles dans Search Console ?

- □ Faut-il vraiment concentrer son contenu sur moins de pages pour ranker ?

- □ Les critères d'avis produits Google s'appliquent-ils même si votre site n'est pas classé comme site d'avis ?

- □ L'API Indexing de Google fonctionne-t-elle vraiment pour tous les contenus ?

- □ L'E-A-T influence-t-il vraiment le classement Google ou n'est-ce qu'un mythe ?

- □ Les mentions de marque sans lien ont-elles un impact sur votre référencement ?

- □ Les commentaires d'utilisateurs améliorent-ils vraiment le classement dans Google ?

- □ Les certificats SSL premium influencent-ils vraiment le référencement Google ?

- □ PDF et HTML avec le même contenu : faut-il craindre une cannibalisation dans les SERPs ?

- □ Peut-on vraiment piloter l'indexation des PDF via les headers HTTP ?

- □ Faut-il encore utiliser rel=next et rel=prev pour la pagination ?

- □ Googlebot peut-il vraiment indexer vos contenus en défilement infini ?

- □ Faut-il vraiment indexer toutes les pages de son site ?

- □ Faut-il s'inquiéter de la page référente affichée dans Google Search Console ?

- □ Faut-il vraiment rediriger l'ancien sitemap en 301 ou soumettre le nouveau directement ?

- □ Pourquoi 97% de crawl refresh est-il un signal positif pour votre site ?

- □ Comment Google détermine-t-il réellement la vitesse de crawl de votre site ?

- □ Vitesse de crawl et Core Web Vitals : pourquoi Google fait-il la distinction ?

- □ Pourquoi Google ralentit-il son crawl après un changement d'hébergement ?

- □ Le CTR peut-il vraiment pénaliser le reste de votre site ?

- □ Le maillage interne est-il vraiment l'élément le plus déterminant pour le SEO ?

- □ Le linking interne agit-il vraiment instantanément après recrawl ?

- □ Faut-il s'inquiéter si Google ne crawle pas toutes vos pages ?

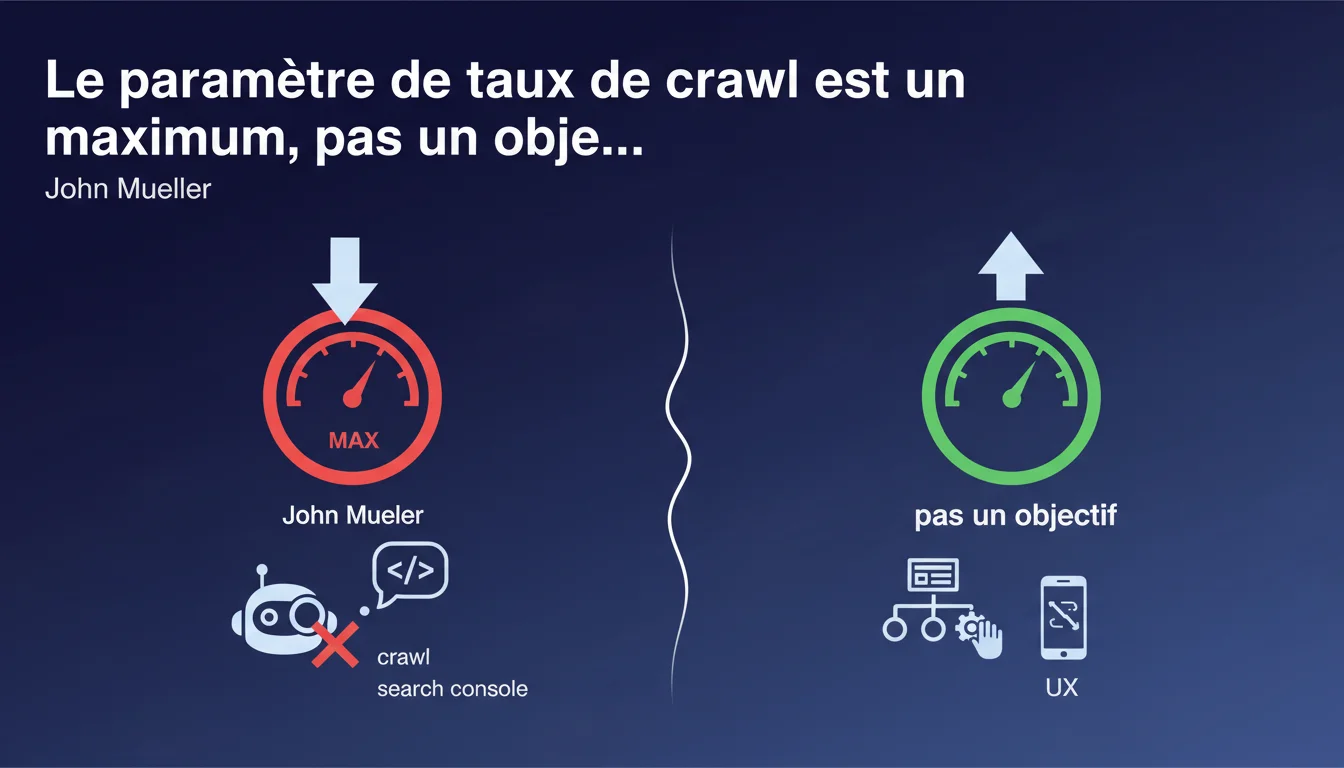

Le paramètre de taux de crawl dans Search Console fonctionne comme un limiteur, pas comme une cible à atteindre. Google ne s'engage pas à crawler davantage si vous augmentez ce plafond — il sert uniquement à protéger votre infrastructure contre une charge excessive. Augmenter ce paramètre n'améliore donc pas votre crawl budget.

Ce qu'il faut comprendre

Quelle est la fonction réelle du paramètre de taux de crawl ?

Ce paramètre agit comme un garde-fou technique, pas comme un levier d'optimisation. Concrètement, il limite le nombre de requêtes par seconde que Googlebot peut envoyer à votre serveur. Si vous définissez 10 requêtes/seconde, le bot ne dépassera jamais ce seuil — mais rien ne l'oblige à atteindre cette limite.

L'idée reçue consiste à croire qu'en augmentant ce paramètre, on incite Google à crawler plus activement. C'est faux. Google détermine lui-même l'intensité de crawl optimale selon ses propres critères : fraîcheur du contenu, popularité des pages, qualité technique du site. Le paramètre ne fait que plafonner cette intensité si elle menace vos ressources serveur.

Pourquoi cette confusion persiste-t-elle chez les professionnels SEO ?

L'interface Search Console peut induire en erreur. Quand on voit un curseur permettant d'augmenter ou réduire une valeur, le réflexe est de penser qu'on contrôle activement le comportement du bot. Or, on ne contrôle que la partie haute de la fourchette.

Beaucoup de sites sous-crawlés cherchent désespérément des leviers pour accélérer l'indexation. Toucher à ce paramètre donne l'illusion d'agir, alors qu'en réalité, les vrais blocages se situent ailleurs : architecture médiocre, contenu dupliqué, serveurs lents, budget crawl gaspillé sur des URL inutiles.

Dans quels cas ce paramètre devient-il réellement utile ?

Il sert principalement aux sites qui subissent une pression excessive de Googlebot — typiquement lors de migrations massives, de refonte, ou sur des infrastructures fragiles. Si votre serveur sature à cause du crawl, réduire ce plafond protège votre disponibilité.

Inversement, l'augmenter n'a de sens que si Google frappe déjà à la porte avec une intensité proche du plafond actuel ET que votre infrastructure peut encaisser davantage. Autrement dit, c'est un cas de figure rare. La plupart des sites n'atteignent jamais la limite configurée.

- Maximum, pas objectif — Google ne cherche pas à atteindre la limite que vous fixez

- Protection serveur — Le paramètre évite la surcharge, il n'améliore pas l'indexation

- Crawl budget réel — Déterminé par Google selon ses propres critères (popularité, fraîcheur, qualité)

- Cas d'usage légitime — Réduire le plafond si le serveur souffre de la charge Googlebot

- Illusion de contrôle — Augmenter la limite ne force pas Google à crawler plus

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Absolument. Sur des centaines d'audits, jamais l'augmentation de ce paramètre n'a provoqué une hausse mesurable du crawl. En revanche, sa réduction a parfois stabilisé des serveurs saturés — ce qui valide la logique de limiteur unidirectionnel.

Le vrai levier du crawl budget reste la qualité architecturale : éliminer les chaînes de redirection, bloquer les facettes inutiles, optimiser le maillage interne, corriger les erreurs serveur. Ces actions ont un impact direct et mesurable. Jouer avec le curseur de Search Console ? Zéro effet observable.

Pourquoi Google ne communique-t-il pas plus clairement sur ce point ?

Parce que l'opacité autour du crawl budget sert ses intérêts. Si Google détaillait précisément comment il alloue ses ressources, chaque site chercherait à optimiser agressivement ces critères — et le système serait rapidement saturé de manipulations.

La formulation de Mueller reste volontairement floue sur comment augmenter réellement le crawl. Il dit ce que le paramètre ne fait pas, mais n'explique pas ce qui influence positivement l'allocation du budget. [À vérifier] — aucune donnée publique ne détaille les pondérations exactes entre popularité, fraîcheur et qualité technique dans l'équation du crawl budget.

Dans quels cas cette règle pourrait-elle ne pas s'appliquer ?

Sur des plateformes géantes avec des millions de pages et une infrastructure élastique ultra-performante, il existe une zone grise. Si votre serveur peut encaisser 50 requêtes/seconde sans broncher et que Google crawle actuellement à 30 req/s, augmenter le plafond à 60 pourrait — théoriquement — lui laisser plus de marge pour intensifier ponctuellement son crawl lors d'événements spécifiques (gros batch de nouvelles pages, par exemple).

Mais même dans ce scénario, rien ne garantit que Google exploitera cette marge supplémentaire. Il reste le maître à bord. Soyons honnêtes : pour 99 % des sites, ce débat est purement académique — le plafond n'est jamais atteint.

Impact pratique et recommandations

Que faut-il faire concrètement avec ce paramètre ?

Ne pas y toucher dans 95 % des cas. La valeur par défaut convient à la majorité des sites. Si votre serveur n'est pas en souffrance et que votre crawl n'atteint pas le plafond configuré, modifier ce paramètre est une perte de temps.

Concentrez-vous plutôt sur les leviers qui influencent réellement le crawl : nettoyer les URL parasites, optimiser les temps de réponse serveur, structurer intelligemment votre maillage interne pour guider Googlebot vers vos pages stratégiques.

Quelles erreurs éviter absolument ?

Ne jamais augmenter ce paramètre dans l'espoir d'accélérer l'indexation de nouvelles pages. Ça ne marchera pas. Si vos pages ne sont pas crawlées, le problème se situe ailleurs : profondeur dans l'arborescence, absence de liens internes, robots.txt trop restrictif, contenu dupliqué qui dilue le budget.

Inversement, ne réduisez pas agressivement le plafond sans raison valable. Si Google crawle actuellement à 5 req/s et que vous bridez à 2 req/s « par précaution », vous créez artificiellement un goulot d'étranglement qui ralentira effectivement votre indexation — là, pour le coup, vous aurez un impact négatif mesurable.

Comment vérifier que votre configuration est optimale ?

Consultez le rapport « Statistiques de l'exploration » dans Search Console. Regardez le nombre de requêtes par jour et la courbe sur plusieurs semaines. Si cette courbe est stable et bien en dessous du plafond configuré, tout va bien — inutile de toucher quoi que ce soit.

Si vous observez des pics de crawl qui coïncident avec des ralentissements serveur (vérifiez vos logs serveur ou votre monitoring), alors oui, réduire le plafond peut avoir du sens. Mais documentez précisément la corrélation avant d'agir.

- Vérifier le rapport « Statistiques de l'exploration » dans Search Console régulièrement

- Comparer le volume de crawl réel avec le plafond configuré — s'il y a un écart large, le paramètre n'est pas le problème

- Monitorer la charge serveur lors des pics de crawl Googlebot (logs serveur, temps de réponse)

- Réduire le plafond uniquement si le serveur sature ET que le crawl atteint régulièrement la limite

- Ne jamais augmenter le plafond en espérant améliorer l'indexation — travailler plutôt l'architecture et la qualité du contenu

- Auditer régulièrement les URL crawlées pour identifier celles qui gaspillent du budget (facettes, paramètres inutiles, duplicatas)

- Optimiser les temps de réponse serveur pour maximiser l'efficacité du crawl alloué

❓ Questions frequentes

Augmenter le paramètre de taux de crawl va-t-il accélérer l'indexation de mes nouvelles pages ?

Dans quel cas dois-je réduire le taux de crawl maximum ?

Comment savoir si mon crawl budget est bien utilisé ?

Google peut-il crawler plus si j'ai un serveur très performant ?

Y a-t-il une valeur de taux de crawl idéale ?

🎥 De la même vidéo 23

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.