Declaration officielle

Autres déclarations de cette vidéo 23 ▾

- □ Google compte-t-il vraiment tous les liens visibles dans Search Console ?

- □ Faut-il vraiment concentrer son contenu sur moins de pages pour ranker ?

- □ Les critères d'avis produits Google s'appliquent-ils même si votre site n'est pas classé comme site d'avis ?

- □ L'API Indexing de Google fonctionne-t-elle vraiment pour tous les contenus ?

- □ L'E-A-T influence-t-il vraiment le classement Google ou n'est-ce qu'un mythe ?

- □ Les mentions de marque sans lien ont-elles un impact sur votre référencement ?

- □ Les commentaires d'utilisateurs améliorent-ils vraiment le classement dans Google ?

- □ Les certificats SSL premium influencent-ils vraiment le référencement Google ?

- □ PDF et HTML avec le même contenu : faut-il craindre une cannibalisation dans les SERPs ?

- □ Faut-il encore utiliser rel=next et rel=prev pour la pagination ?

- □ Googlebot peut-il vraiment indexer vos contenus en défilement infini ?

- □ Faut-il vraiment indexer toutes les pages de son site ?

- □ Faut-il s'inquiéter de la page référente affichée dans Google Search Console ?

- □ Faut-il vraiment rediriger l'ancien sitemap en 301 ou soumettre le nouveau directement ?

- □ Pourquoi 97% de crawl refresh est-il un signal positif pour votre site ?

- □ Comment Google détermine-t-il réellement la vitesse de crawl de votre site ?

- □ Vitesse de crawl et Core Web Vitals : pourquoi Google fait-il la distinction ?

- □ Pourquoi Google ralentit-il son crawl après un changement d'hébergement ?

- □ Le paramètre de taux de crawl est-il vraiment un plafond et non un objectif ?

- □ Le CTR peut-il vraiment pénaliser le reste de votre site ?

- □ Le maillage interne est-il vraiment l'élément le plus déterminant pour le SEO ?

- □ Le linking interne agit-il vraiment instantanément après recrawl ?

- □ Faut-il s'inquiéter si Google ne crawle pas toutes vos pages ?

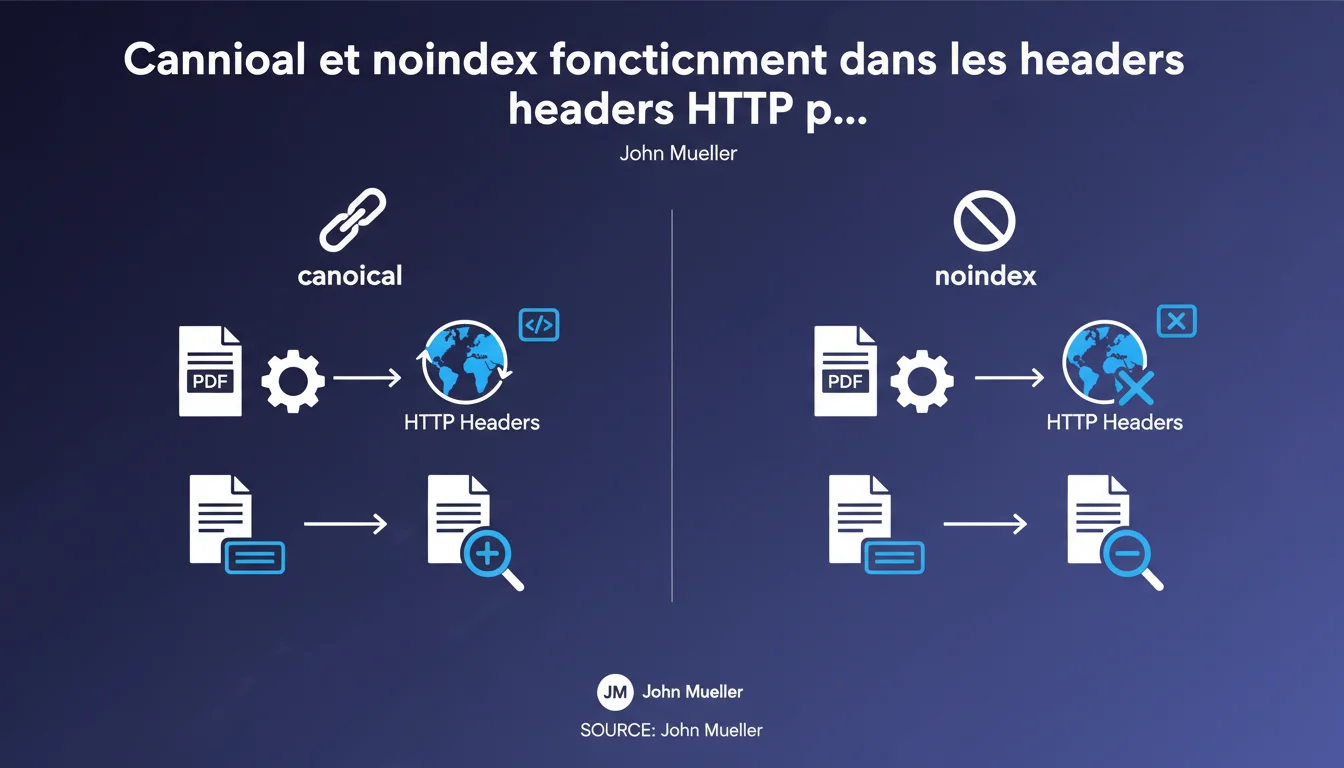

Google confirme que les balises canonical et noindex fonctionnent via headers HTTP pour les fichiers PDF. Concrètement, vous pouvez contrôler l'indexation et éviter la duplication de contenu sur vos PDF sans modifier le fichier lui-même, directement au niveau serveur. Une flexibilité technique souvent ignorée mais redoutablement efficace.

Ce qu'il faut comprendre

Pourquoi cette précision sur les PDF est-elle importante ?

Les fichiers PDF posent un problème récurrent en SEO : ils sont crawlés et indexés par Google, mais leur optimisation reste complexe. Contrairement aux pages HTML, on ne peut pas insérer de balises meta directement dans leur code source.

Cette déclaration de Mueller lève l'ambiguïté : les headers HTTP peuvent transmettre ces directives. Ça signifie qu'un fichier PDF peut recevoir une instruction canonical ou noindex sans modification du fichier original, uniquement via la configuration serveur.

Comment fonctionnent concrètement ces headers pour les PDF ?

Lorsque Googlebot crawle un PDF, il lit d'abord les headers HTTP de la réponse serveur. Si vous configurez un header Link: <URL>; rel="canonical", Google l'interprétera comme une balise canonical classique.

Même logique pour le noindex : un header X-Robots-Tag: noindex indiquera à Google de ne pas indexer le document. Cette mécanique fonctionne exactement comme pour les pages HTML — la seule différence, c'est le canal de transmission.

Quels sont les cas d'usage concrets ?

Premier cas : vous avez un PDF accessible via plusieurs URLs (avec/sans paramètres, versions miroirs). Le header canonical évite la duplication en consolidant les signaux vers une URL maître.

Deuxième cas : certains PDF doivent rester accessibles pour les utilisateurs mais ne méritent pas d'être indexés (documents internes, versions brouillons, fiches techniques trop techniques). Le header noindex règle ça proprement.

- Les headers HTTP permettent de piloter l'indexation des PDF sans modifier les fichiers

- Le header

Linktransmet une directive canonical - Le header

X-Robots-Taggère le noindex/nofollow - Cette méthode fonctionne aussi pour d'autres types de fichiers (images, vidéos, etc.)

- La configuration se fait au niveau serveur (Apache, Nginx, CDN...)

Avis d'un expert SEO

Cette déclaration change-t-elle vraiment la donne ?

Pas vraiment. Les headers X-Robots-Tag sont documentés depuis des années dans la documentation officielle Google. Ce qui est intéressant, c'est que Mueller confirme explicitement que ça marche aussi pour les PDF — certains SEO doutaient encore.

Par contre — et c'est là que ça coince — cette technique reste sous-utilisée en pratique. Pourquoi ? Parce qu'elle nécessite un accès à la config serveur et une compréhension technique que beaucoup d'équipes n'ont pas. Les CMS ne proposent pas d'interface pour ça par défaut.

Quelles sont les limites à connaître ?

Premier point : Google doit crawler le PDF pour lire les headers. Si votre fichier n'est jamais crawlé (robots.txt bloquant, crawl budget insuffisant), les headers ne servent à rien. Évident, mais trop souvent oublié.

Deuxième point : les headers canonical ne garantissent pas que Google suivra la directive à 100%. Comme pour les pages HTML, c'est un signal fort, pas une directive absolue. Google peut décider d'indexer une variante si elle lui semble plus pertinente. [À vérifier] dans vos cas edge — surveillez la Search Console.

Troisième point : certains CDN ou serveurs proxy peuvent modifier ou supprimer les headers en cours de route. Testez toujours avec un curl ou un outil de diagnostic headers pour vérifier que les directives arrivent bien jusqu'à Googlebot.

Dans quels cas cette technique est-elle vraiment indispensable ?

Soyons honnêtes : si vous n'avez que quelques PDF et qu'ils ne posent pas de problème de duplication, vous n'en avez probablement pas besoin. Les vrais cas d'usage concernent les sites avec de gros volumes de documents : e-commerce avec catalogues PDF, sites B2B avec documentation technique, plateformes d'édition.

Dans ces contextes, la gestion par headers devient stratégique. Elle permet de centraliser les règles d'indexation au niveau infrastructure plutôt que de bidouiller fichier par fichier. C'est scalable, maintenable, et ça évite les erreurs humaines.

Impact pratique et recommandations

Comment configurer ces headers sur votre serveur ?

Sur Apache, utilisez un fichier .htaccess ou la config serveur. Pour ajouter un canonical : Header set Link "<https://exemple.com/document-principal.pdf>; rel=\"canonical\"". Pour un noindex : Header set X-Robots-Tag "noindex".

Sur Nginx, ajoutez dans votre bloc location : add_header Link "<https://exemple.com/document-principal.pdf>; rel=\"canonical\""; ou add_header X-Robots-Tag "noindex";. N'oubliez pas de recharger la config après modification.

Si vous passez par un CDN (Cloudflare, Fastly, AWS CloudFront), vérifiez que vos headers personnalisés ne sont pas écrasés. La plupart permettent de définir des règles spécifiques par type de fichier.

Quelles erreurs éviter absolument ?

Erreur classique : appliquer un noindex global sur /pdf/ alors que certains documents méritent d'être indexés. Affinez vos règles par sous-répertoire ou par pattern d'URL. Le diable est dans les détails.

Autre piège : oublier que les headers canonical nécessitent une URL absolue, pas relative. Google ne devinera pas votre domaine. Testez systématiquement avec un outil pour valider la syntaxe exacte reçue par le bot.

Dernier point : ne mélangez pas headers et meta tags si vous générez des PDF dynamiques avec des meta embarquées. En cas de conflit, Google suit généralement les headers, mais [À vérifier] — autant éviter l'ambiguïté.

Comment vérifier que vos directives sont bien prises en compte ?

Utilisez la Search Console pour monitorer l'indexation de vos PDF. Si vous avez appliqué un noindex, vérifiez que les URLs disparaissent progressivement de l'index (ça prend quelques semaines).

Pour les canonical, inspectez l'URL dans la Search Console : Google indique quelle URL il considère comme canonique. Si ce n'est pas celle que vous avez définie, creusez — problème de header mal configuré, conflit avec d'autres signaux, ou décision éditoriale de Google.

Testez aussi avec curl -I https://votresite.com/document.pdf pour voir les headers renvoyés côté serveur. Si vous ne voyez pas vos directives, elles n'arrivent pas jusqu'à Googlebot non plus.

- Identifiez les PDF posant des problèmes de duplication ou ne méritant pas l'indexation

- Choisissez la méthode de configuration adaptée à votre stack technique (Apache, Nginx, CDN)

- Testez d'abord sur un échantillon restreint avant déploiement global

- Vérifiez les headers effectivement envoyés avec curl ou un outil de diagnostic

- Monitorez l'impact dans la Search Console (indexation, canonical détectée)

- Documentez vos règles pour faciliter la maintenance future

❓ Questions frequentes

Les headers HTTP canonical fonctionnent-ils uniquement pour les PDF ou aussi pour d'autres types de fichiers ?

Que se passe-t-il si j'ai à la fois un header canonical et un sitemap pointant vers une URL différente ?

Puis-je utiliser X-Robots-Tag pour d'autres directives que noindex ?

Combien de temps faut-il pour que Google prenne en compte un header noindex sur un PDF déjà indexé ?

Les headers canonical consomment-ils du crawl budget ?

🎥 De la même vidéo 23

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 18/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.