Declaration officielle

Autres déclarations de cette vidéo 12 ▾

- □ Le texte caché est-il toujours considéré comme du spam par Google ?

- □ Le contenu généré aléatoirement fait-il vraiment partie des pratiques spam selon Google ?

- □ Les backlinks sont-ils devenus inutiles pour le référencement naturel ?

- □ Le HTML valide est-il vraiment nécessaire pour bien se classer dans Google ?

- □ Pourquoi Google insiste-t-il autant sur les vraies balises <a href> ?

- □ Faut-il vraiment abandonner les images CSS au profit des balises <img> pour le SEO ?

- □ Le noindex est-il vraiment une règle absolue ou Google prend-il des libertés ?

- □ HTTPS est-il vraiment obligatoire pour être indexé par Google ?

- □ Pourquoi Google recommande-t-il d'abandonner les plugins pour afficher du contenu web ?

- □ Pourquoi Google ne déclenche-t-il pas les événements de scroll ou de clic pour crawler votre contenu ?

- □ L'alt text des images reste-t-il vraiment indispensable face à la vision par ordinateur de Google ?

- □ Les directives SEO de Google sont-elles vraiment fiables sur la durée ?

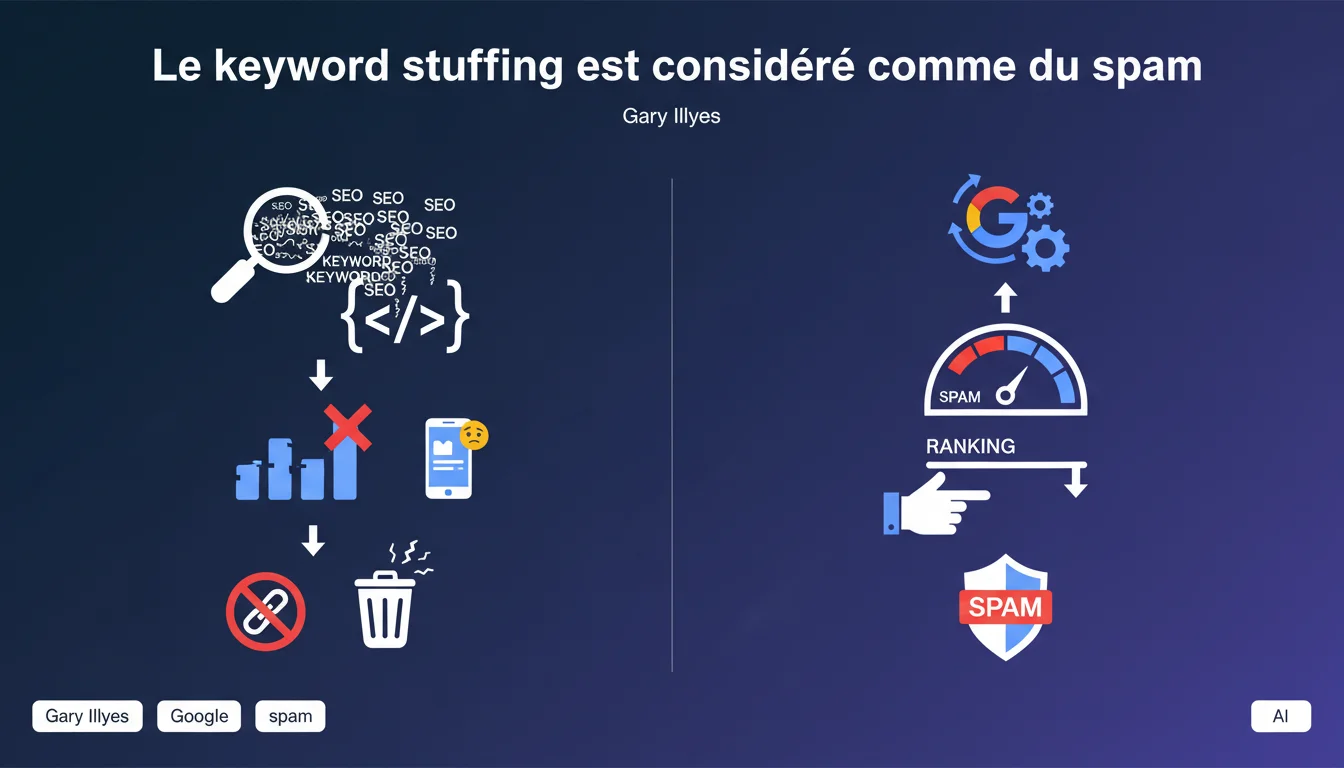

Google identifie le bourrage de mots-clés comme du spam et peut ajuster manuellement le classement des sites qui l'utilisent. La technique n'apporte aucune valeur aux utilisateurs et expose à des actions manuelles. Miser sur la répétition excessive reste une stratégie perdante.

Ce qu'il faut comprendre

Qu'est-ce que Google considère exactement comme du keyword stuffing ?

Le keyword stuffing désigne la répétition artificielle et excessive d'un mot-clé dans le contenu, les balises ou les métadonnées. L'objectif historique était de manipuler les algorithmes en augmentant la densité de mots-clés, une pratique qui fonctionnait dans les années 2000.

Aujourd'hui, Google détecte ces schémas via ses algorithmes de traitement du langage naturel et via des évaluations manuelles. La frontière ? Quand la répétition nuit à la lisibilité et que le texte semble écrit pour des robots plutôt que pour des humains.

Pourquoi cette déclaration arrive-t-elle maintenant ?

Le bourrage de mots-clés n'a jamais complètement disparu — certains praticiens persistent à croire qu'une densité optimale existe. Gary Illyes rappelle ici que cette approche relève du spam, pas de l'optimisation.

Google continue d'affiner ses systèmes de détection automatique, mais conserve la capacité d'intervenir manuellement sur les cas flagrants. Cette déclaration sert d'avertissement : les sanctions existent et peuvent être appliquées sans préavis.

Quelle est la différence avec une optimisation légitime ?

Répéter un mot-clé n'est pas en soi problématique. Ce qui compte, c'est l'intention et le résultat utilisateur. Un article technique peut naturellement utiliser un terme spécifique de nombreuses fois sans que cela soit du spam.

La ligne rouge ? Quand la répétition ne sert qu'à forcer le placement, quand les phrases deviennent bancales, quand le texte perd en clarté. Google analyse le contexte sémantique global, pas juste la fréquence brute.

- Le keyword stuffing crée un texte artificiel et peu lisible

- Google peut sanctionner manuellement les sites qui en abusent

- L'optimisation légitime privilégie le contexte sémantique et la valeur utilisateur

- Les algorithmes modernes détectent la sur-optimisation via le traitement du langage naturel

- Aucune densité de mots-clés "idéale" n'existe — seule la pertinence compte

Avis d'un expert SEO

Cette position est-elle cohérente avec ce qu'on observe sur le terrain ?

Globalement, oui. Les sites qui abusent du bourrage de mots-clés finissent par stagner ou régresser, surtout depuis les mises à jour Helpful Content. Les algorithmes privilégient clairement la richesse sémantique et la variété lexicale.

Mais — et c'est là que ça coince — certains secteurs ultra-compétitifs montrent encore des pages sur-optimisées en première position. Ces cas sont souvent des anomalies temporaires, ou des niches où la concurrence qualitative est faible. [À vérifier] : la définition exacte de ce seuil de sur-optimisation reste floue.

Quelle est la limite entre répétition naturelle et manipulation ?

Google ne donne jamais de chiffres précis — et c'est volontaire. Pas de pourcentage magique, pas de formule à appliquer. L'évaluation repose sur des critères qualitatifs : fluidité du texte, diversité des formulations, pertinence contextuelle.

Un rédacteur qui maîtrise son sujet utilisera naturellement des synonymes, des reformulations, des variations. Un contenu bourré de mots-clés trahit souvent une rédaction mécanisée ou un manque de compréhension du sujet. Les Quality Raters sont formés pour repérer ces schémas.

Les sanctions manuelles sont-elles vraiment fréquentes pour ce motif ?

Non, les actions manuelles pour keyword stuffing pur sont rares aujourd'hui. La plupart des cas sont gérés algorithmiquement : le site stagne, ne monte pas, ou perd progressivement du terrain.

Les interventions manuelles visent plutôt les abus massifs et récurrents, souvent couplés à d'autres techniques spam. Un site isolé avec quelques pages sur-optimisées ne déclenchera probablement pas d'action manuelle, mais souffrira de performances médiocres. C'est une pénalité silencieuse.

Impact pratique et recommandations

Comment identifier le keyword stuffing sur son propre site ?

Lisez vos pages à voix haute. Si certaines phrases sonnent bizarres, si un mot-clé revient de façon gênante, si le texte semble écrit pour un robot, vous avez un problème. L'analyse humaine reste le meilleur détecteur.

Complétez avec des outils : vérifiez la variété lexicale de vos contenus, analysez le champ sémantique couvert. Un texte de 1000 mots qui ne contient que 10 termes différents est suspect. Utilisez des extracteurs de N-grams pour repérer les répétitions excessives.

Quelles actions correctives appliquer concrètement ?

Réécrire les passages sur-optimisés en privilégiant les synonymes, les cooccurrences naturelles, les formulations variées. Ne sacrifiez pas la clarté pour forcer un placement — si le mot-clé ne s'intègre pas naturellement, reformulez.

Diversifiez votre stratégie sémantique : travaillez les entités nommées, les concepts associés, les questions connexes. Google comprend le contexte — exploitez cette capacité plutôt que de marteler un mot-clé isolé.

Comment éviter de retomber dans ce travers ?

Formez vos rédacteurs aux principes du SEO sémantique moderne. Un bon texte optimisé ne ressemble pas à un texte optimisé. Il informe, structure, répond aux questions des utilisateurs sans forcer la présence de mots-clés.

Mettez en place des processus de relecture qualitative avant publication. Un contenu qui apporte de la valeur se positionnera mieux qu'un contenu bourré de mots-clés creux. Privilégiez toujours l'expérience utilisateur.

- Auditer les pages actuelles pour repérer les répétitions excessives

- Réécrire les passages sur-optimisés avec des formulations naturelles

- Varier le vocabulaire : synonymes, cooccurrences, reformulations

- Élargir le champ sémantique : entités, concepts associés, questions connexes

- Former les rédacteurs aux principes du SEO sémantique moderne

- Instaurer une relecture qualitative systématique avant publication

- Abandonner les outils qui calculent une densité "idéale" de mots-clés

- Privilégier la valeur utilisateur et la fluidité de lecture

❓ Questions frequentes

Existe-t-il une densité de mots-clés idéale recommandée par Google ?

Le keyword stuffing peut-il entraîner une désindexation complète ?

Comment différencier une répétition légitime d'un bourrage abusif ?

Les balises meta et les attributs alt sont-ils aussi concernés ?

Peut-on utiliser des outils pour détecter automatiquement le keyword stuffing ?

🎥 De la même vidéo 12

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 03/02/2022

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.