Declaration officielle

Autres déclarations de cette vidéo 9 ▾

- □ Pourquoi Google n'indexe-t-il jamais l'intégralité d'un site web ?

- □ Pourquoi vos pages restent-elles en 'Découvert - actuellement non indexé' ?

- □ Comment Googlebot ajuste-t-il sa vitesse de crawl en fonction des performances de votre serveur ?

- □ Comment diagnostiquer les problèmes serveur qui freinent le crawl de Google ?

- □ Les problèmes de serveur ne touchent-ils vraiment que les très gros sites ?

- □ Pourquoi Google refuse-t-il d'indexer vos pages en statut 'Découvert' ?

- □ Google peut-il vraiment ignorer des pans entiers de votre site à cause d'un pattern de faible qualité ?

- □ Le maillage interne suffit-il vraiment à faire indexer vos pages découvertes ?

- □ Faut-il vraiment se préoccuper des pages non indexées par Google ?

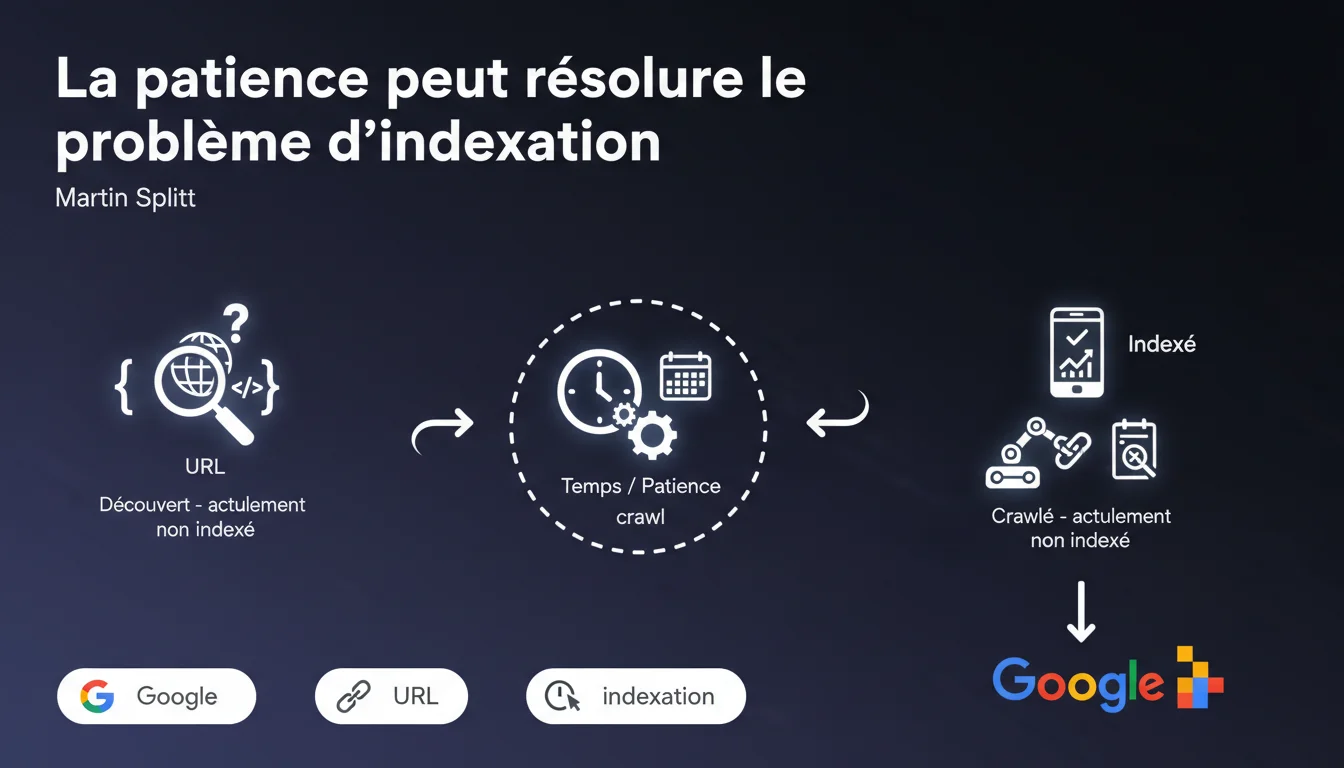

Martin Splitt de Google affirme que le statut 'Découvert - actuellement non indexé' se résout souvent par la patience. Googlebot finira par crawler l'URL quand il aura le temps, qui passera ensuite au statut 'Crawlé - actuellement non indexé' ou sera indexée. Une déclaration qui soulève plus de questions qu'elle n'apporte de réponses concrètes sur les délais et les critères réels d'indexation.

Ce qu'il faut comprendre

Que signifie concrètement ce statut 'Découvert - actuellement non indexé' ?

Ce statut apparaît dans la Google Search Console quand Googlebot a identifié une URL (via un sitemap, un lien interne ou externe) mais n'a pas encore eu les ressources pour la crawler. Google connaît l'existence de cette page, mais ne l'a pas encore visitée ni analysée son contenu.

La déclaration de Splitt suggère une file d'attente : votre page attend son tour. Le problème ? Aucune indication sur la durée d'attente ni sur les critères de priorisation dans cette file.

Quelle différence entre 'Découvert' et 'Crawlé - actuellement non indexé' ?

Le passage de 'Découvert - actuellement non indexé' à 'Crawlé - actuellement non indexé' marque une étape : Googlebot a visité la page et analysé son contenu, mais a décidé de ne pas l'indexer pour le moment.

C'est là que ça coince. Si la page est crawlée mais non indexée, la patience seule ne résoudra rien — il y a probablement un problème de qualité, de duplication ou de pertinence que Google ne juge pas suffisante pour mériter une place dans son index.

Quels sont les facteurs qui déterminent la vitesse d'indexation ?

Splitt mentionne vaguement que Googlebot crawlera "quand il aura le temps", mais ne précise pas ce qui influence cette allocation de temps. En réalité, plusieurs facteurs entrent en jeu :

- Le crawl budget alloué à votre site (PageRank interne, autorité globale, fréquence de mise à jour)

- La profondeur de la page dans l'arborescence (plus elle est enterrée, plus elle attend)

- La qualité et la fraîcheur du contenu perçues par Google

- Les signaux de popularité (backlinks, signaux sociaux)

- La performance technique du site (vitesse, stabilité serveur)

Avis d'un expert SEO

Cette déclaration est-elle cohérente avec les observations terrain ?

Oui et non. [A vérifier] — la patience fonctionne parfois, notamment pour des sites établis avec un bon crawl budget. J'ai vu des pages passer de 'Découvert' à 'Indexé' en 48h sur des sites autoritaires. Mais j'ai aussi vu des pages rester bloquées en 'Découvert' pendant des mois sur des sites moyens.

Ce que Splitt omet de dire : la patience seule ne suffit pas si les fondamentaux SEO ne sont pas solides. Attendre sans agir, c'est souvent perdre du temps. Sur un site avec des problèmes de crawl budget, de maillage interne faible ou de contenu médiocre, rien ne se passera — même après six mois.

Quand la patience devient-elle une excuse pour l'inaction ?

Soyons honnêtes : cette déclaration peut être interprétée comme un "attendez et voyez", ce qui arrange Google mais frustre les SEO. Dans ma pratique, j'ai constaté que les sites qui attendent passivement perdent face à ceux qui agissent.

Si après 2-3 semaines une page importante reste en 'Découvert', c'est un signal d'alarme. Il faut investiguer — pas attendre béatement. Booster le maillage interne, ajouter des backlinks ciblés, améliorer le contenu : ces actions accélèrent drastiquement le processus.

Que révèle cette déclaration sur la communication de Google ?

Cette affirmation illustre parfaitement le style Google : rassurer sans s'engager sur des délais précis. "Quand il aura le temps" est volontairement flou — ça peut signifier 24h comme 6 mois. Aucune métrique concrète, aucun seuil, aucun levier actionnable.

Pour un professionnel SEO, c'est insuffisant. On ne peut pas bâtir une stratégie sur "attendez, ça viendra peut-être". Les clients veulent des résultats mesurables dans des délais raisonnables — et c'est notre job de créer les conditions optimales pour accélérer l'indexation.

Impact pratique et recommandations

Que faut-il faire concrètement face à ce statut 'Découvert' ?

Ne restez pas passif. Oui, la patience a parfois un rôle, mais elle doit s'accompagner d'optimisations tactiques pour accélérer la prise en compte par Googlebot. Commencez par diagnostiquer pourquoi la page n'a pas été priorisée.

Vérifiez d'abord le maillage interne : combien de clics séparent cette page de la homepage ? Plus elle est profonde, plus elle attendra. Ensuite, analysez le crawl budget global du site via les logs serveur — si Googlebot visite peu votre site, augmenter la fréquence de crawl devient prioritaire.

Quelles actions concrètes pour forcer l'indexation ?

- Renforcer le maillage interne vers la page en 'Découvert' depuis des pages déjà indexées et crawlées fréquemment

- Soumettre l'URL via l'outil d'inspection d'URL dans la Search Console pour demander une indexation prioritaire

- Ajouter ou mettre à jour la page dans le sitemap XML et soumettre le sitemap

- Obtenir quelques backlinks de qualité pointant directement vers cette URL pour augmenter sa priorité perçue

- Améliorer la qualité et l'unicité du contenu si celui-ci est faible ou dupliqué

- Vérifier qu'aucune directive technique (noindex, canonical, robots.txt) ne bloque l'indexation

- Monitorer les logs serveur pour confirmer que Googlebot visite effectivement la page

Quelles erreurs éviter absolument ?

L'erreur la plus fréquente : attendre indéfiniment sans agir. J'ai vu des équipes laisser des pages stratégiques en 'Découvert' pendant des trimestres entiers, perdant ainsi du trafic et des conversions potentielles.

Autre piège : soumettre massivement des dizaines d'URLs via l'outil d'inspection. Google limite les demandes d'indexation manuelle — utilisez cette carte uniquement pour vos pages prioritaires. Enfin, ne négligez pas l'analyse des logs : c'est là que vous verrez si Googlebot vient réellement, et à quelle fréquence.

❓ Questions frequentes

Combien de temps faut-il attendre avant qu'une page en 'Découvert' soit crawlée ?

Peut-on forcer Google à crawler une page en 'Découvert - actuellement non indexé' ?

Quelle différence entre 'Découvert' et 'Crawlé - actuellement non indexé' ?

Le fait de soumettre manuellement une URL via la Search Console garantit-il son indexation ?

Comment savoir si mon crawl budget est trop faible ?

🎥 De la même vidéo 9

Autres enseignements SEO extraits de cette même vidéo Google Search Central · publiée le 20/08/2024

🎥 Voir la vidéo complète sur YouTube →

💬 Commentaires (0)

Soyez le premier à commenter.